DeepSeek在元旦期间悄悄放出的“大招”——mHC新架构。

想象一下,传统的AI模型就像一条单车道高速公路(标准残差连接),信息只能一辆车接一辆车地顺序通行。而Hyper-Connections(HC)技术相当于把单车道扩建成了四车道,理论上通行效率应该大大提升。

但问题来了:多车道虽然宽敞,却没有合理的交通指挥系统!车辆(信息)在各个车道间随意变道、抢道,导致有的车道拥堵不堪,有的车道空空如也。这就是HC面临的训练不稳定问题。

#mHC的巧妙解法:安装“智能交通信号灯”

DeepSeek的mHC架构核心思路很聪明:不是简单禁止车辆变道,而是安装一套智能交通控制系统,确保每个路口的车流都能合理分配。

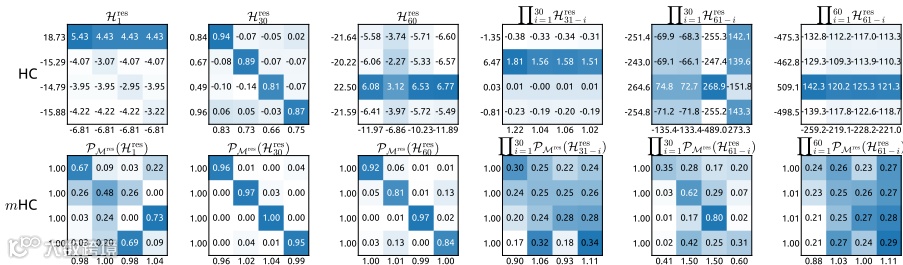

具体来说,mHC通过Sinkhorn-Knopp算法将连接矩阵约束在“双随机矩阵”的流形上。这听起来很复杂,但其实就像要求每个路口的进口和出口车流量必须平衡——不会出现某个方向车辆堆积,也不会让某些车道闲置。

#核心技术原理拆解

1. 恒等映射的重要性

传统残差连接有个美妙特性:信息可以从浅层直接“跳过”中间层到达深层,就像电梯的直达功能。HC丢失了这个特性,而mHC通过数学约束重新找了回来。

2. 双随机矩阵的魔法

双随机矩阵的特点是每行每列的和都是1。这意味着信息传递时:

-

不会无故放大信号(避免梯度爆炸)

-

不会无故缩小信号(避免梯度消失)

-

保持信号总量的稳定守恒

#实战表现:既稳又强,鱼与熊掌兼得

让我们看看mHC在实际训练中的表现:

#训练稳定性大幅提升

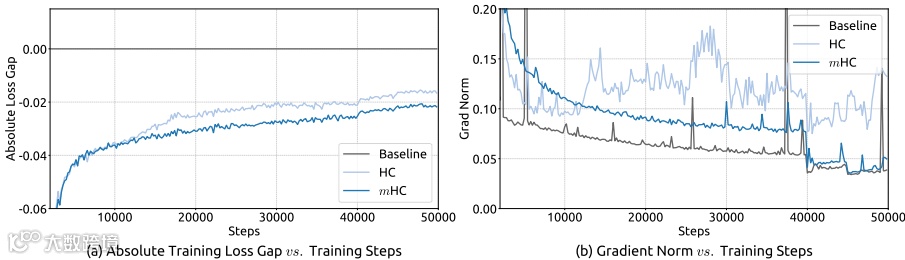

从实验曲线可以看出,HC在训练到约12k步时出现了明显的损失突增(就像开车突然失控),而mHC始终保持着平滑的训练轨迹。

#性能全面提升

在8个主流基准测试中,mHC不仅全面超越基线模型,在多数任务上也优于原始的HC:

-

推理能力增强:在BBH(复杂推理)任务上提升2.1%

-

阅读理解提升:在DROP任务上提升2.3%

-

数学能力:GSM8K数学推理达到53.8%的准确率

#技术创新的背后:极致优化带来的高效实现

你可能担心:这么复杂的技术,会不会拖慢训练速度?DeepSeek团队给出了令人惊叹的答案:仅增加6.7%的时间开销!

这得益于三大优化策略:

1. 内核融合技术

就像把多个零散的小作坊整合成一条自动化生产线,减少了中间环节的搬运成本。

2. 智能重计算

只在需要时重新计算中间结果,而不是全部存储,大大节省了内存空间。

3. 通信计算重叠

让计算和通信同时进行,就像一边做饭一边备菜,效率最大化。

#为什么这项技术很重要?

mHC的意义不仅在于提升当前模型性能,更重要的是它为AI架构设计开辟了新方向:

-

scalability(可扩展性):让超大规模模型训练更加稳定可靠

-

灵活性:为不同的学习目标定制不同的流形约束

-

启发性:重新点燃了对宏观架构设计的关注

#展望未来:AI架构的“城市规划”时代

如果说以前的AI模型像自然生长的小镇,那么mHC代表的是一种“城市规划”思维——在保持发展活力的同时,确保基础设施的稳定性和效率。

正如论文作者所说,mHC只是一个开始。未来我们可能会看到更多基于几何约束的智能架构,在塑性和稳定性之间找到更优的平衡点。

这项技术正在DeepSeek的大模型训练中发挥重要作用,也许不久的将来,我们就能在各类AI应用中体验到它带来的性能提升。

不得不说,DeepSeek这次元旦的“技术拜年”,确实给AI社区带来了一份厚礼!