一

行业背景介绍

(一)ADAS概念

ADAS(Advanced Driver Assistance System),即高级辅助驾驶,是利用安装在车上的各种传感器(毫米波雷达、激光雷达、单/双目摄像头以及卫星导航)感知周围环境、收集数据,通过算法的模型识别和计算,辅助驾驶员做出决策,有效增加汽车驾驶的舒适性和安全性。

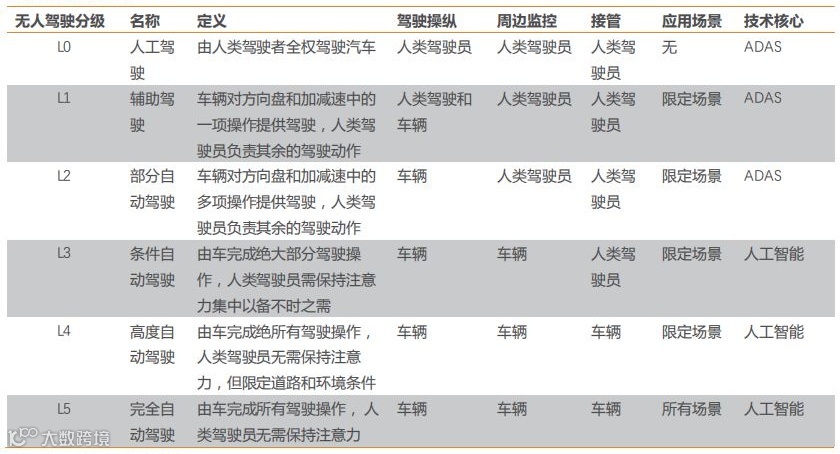

全球对于自动驾驶的行业标准普遍遵循国际汽车工程学会SAE的分类,分为6个等级。ADAS 功能覆盖范围主要是L0~L2级别,L3级及以上被视为“高级别自动驾驶”。L2级的ADAS是实现高等级自动驾驶的基础,目前全球自动驾驶处于L2向L3级别转化的过程。

常见的“智能驾驶”概念包含了现阶段的ADAS及未来将逐渐实现的自动驾驶。

表1:SAE对自动驾驶的分级标准体系

资料来源:公开资料整理

(二)ADAS技术架构

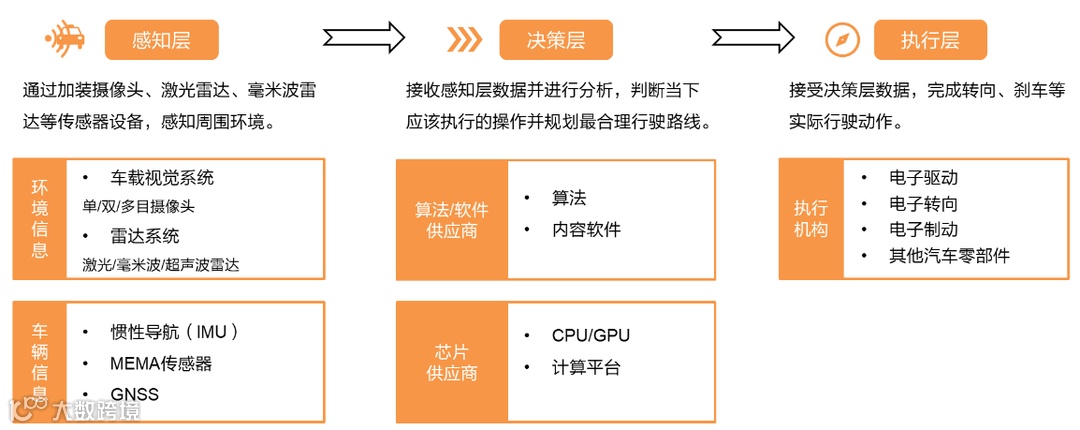

ADAS技术架构分为感知层、决策层、执行层三层运行架构。

感知层用于收集及预处理周围环境的信息,是实现智能驾驶功能的先决条件,解决“在哪里”的问题(即感知和定位);决策层对收集的数据整合、分析与判断,解决“去哪儿”的问题(即决策和规划);执行层根据判断结果做出实时反应,解决“怎么去”的问题(即控制和执行)。

图1:智能驾驶架系统构示意图

资料来源:亿欧智库,天风证券

(三)感知层传感器构成

感知层是“智能驾驶之眼”,承担环境感知功能,是实现智能驾驶的基础。

感知层传感器主要包括摄像头、毫米波雷达、超声波雷达、激光雷达等智能传感器设备。

摄像头主要用于视觉传感,分辨率高于其他传感,可获取足够多的环境细节,但是受天气等外部环境影响较大;

毫米波雷达能够穿透雾、烟、灰尘等,受环境影响小,但由于波长原因探测距离有限,也无法感知行人;

激光雷达能对视觉+毫米波雷达的方案形成很好的补充,可形成高精度3D环境地图,但成本较高。

表2:车载传感器对比

资料来源:新智驾,华安证券研究所

二

ADAS视觉解决方案

ADAS视觉解决方案涉及感知层和决策层,核心要素包括车载摄像头、以及基于车载摄像头的方案集成开发(包含芯片及算法),以帮助实现特定ADAS及自动驾驶功能。

(一)产业链分析

表3:ADAS视觉产业链

数据来源:盖世汽车研究所

(二)摄像头

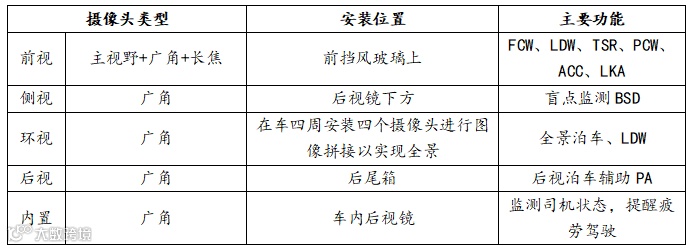

车载摄像头主要包括前视、侧视、环视、后视以及内置摄像头。

前视是最主要的车载摄像头,承担了最多的感知功能,有单目/双目/三目等不同配置,前视会搭配长焦、广角共同使用。

侧视同样承担感知功能;环视以360全景成像为主;后视主要用于泊车辅助;而车内摄像头用于驾驶员状态监测;这些位置的摄像头以广角镜头为主。

表4:摄像头对比

资料来源:前瞻产业研究院

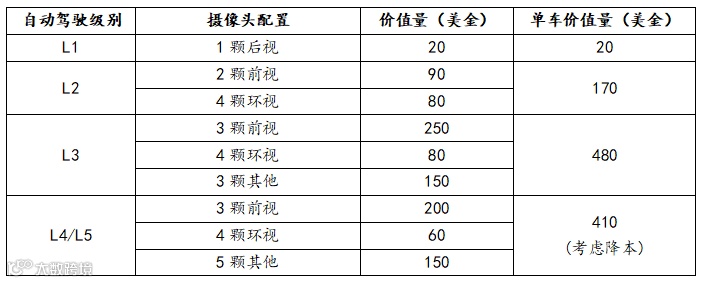

根据测算,L2等级(对应当前的ADAS水平)平均需配置6颗摄像头,单车价值量约170美金。未来L4/L5等级平均需配备12颗摄像头,考虑降本因素,单车价值量约410美金,是L2等级的2.4倍。

表5:摄像头价值量示意

资料来源:华安证券研究所

车载摄像头主要的硬件结构包括光学镜头(镜片、滤光片、保护膜)、CIS(图像传感器)、图像信号处理器ISP、串行器等。

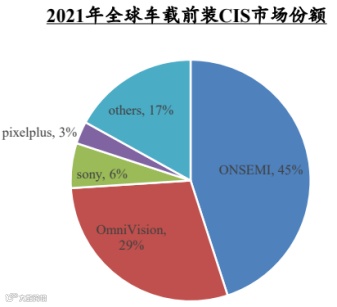

镜头方面,舜宇光学稳定占据全球第一的市场份额;车载摄像头CIS领域,豪威2021年占据前装市场份额为29%,仅次于安森美;摄像头模组领域,以传统的海外Tier1厂商为主导,但国内模组厂商如舜宇光学、联创电子、欧菲光正跑步进场。

图2:车载摄像头硬件竞争格局

信息来源:华经产业研究院,华安证券研究所

从辅助驾驶发展至自动驾驶过程中,单车搭载摄像头的数量持续增加,国内自主品牌更为激进,摄像头数量都在10颗以上,如小鹏P7/P5搭载14颗、蔚来ET7搭载11颗、极狐阿尔法S搭载13颗等。

ADAS等级的提升对摄像头分辨率要求越来越高,以实现对更远距离的监测。500万、800万高清摄像头导入车辆。

汽车电子电气架构集中化发展趋势下,ECU由分布式变成集中式,镜头成为采集信息的硬件设备,计算功能剥离至域控单元/中央处理器集中计算,摄像头硬件结构简化,成本下降,有助于渗透率提升。

表6:部分新能源车型摄像头配置

资料来源:华安证券研究所

(三)算法及芯片

基于硬件的车载视觉算法在ADAS产业链中地位的重要性逐渐提升,前视方案等面临软硬件的升级,新兴视觉方案(虚拟后视镜等)提升安全性与驾驶体验。

车载视觉的源头是计算机视觉,遵循图像输入、预处理、特征提取、特征分类、匹配、完成识别几个步骤。

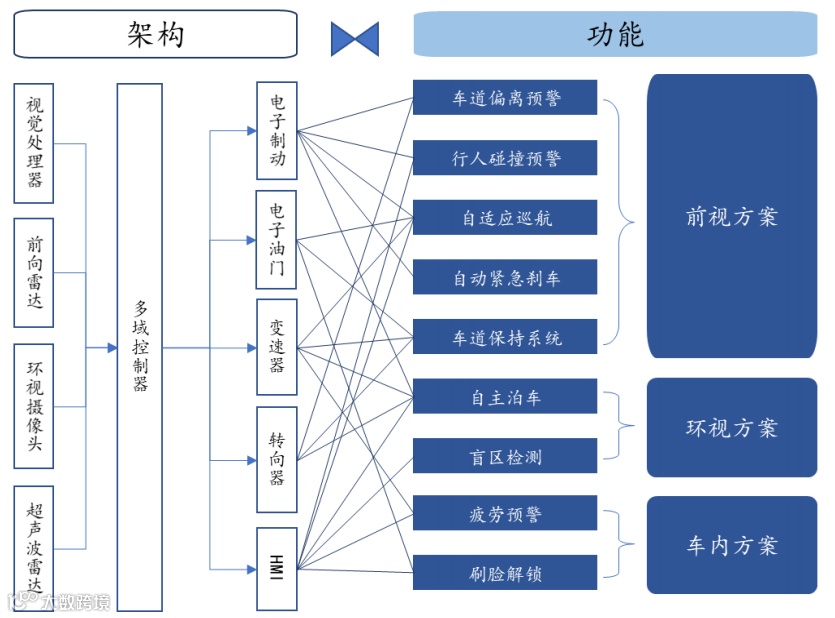

传统汽车电子控制系统中,传感器经处理后的数字信号传导至对应ECU(电子控制单元),不同ECU对应不同系统。自动驾驶时代的汽车电子控制系统中信号传至MDC多域控制器,即通过一块ECU对不同传感器信号进行分析和处理,再由执行机构(电子阀门、执行马达等)发送指令以控制车辆的关键部件(发动机等)完成控制/转向等功能,或向车载信息系统(In-Vehicle Infotainment)和HMI(人机交互界面)发送指令。

车载视觉从广义上分为两种应用场景:

指代由机器获取信息反馈至驾驶员的应用场景,在智能系统控制下完成车道保持、超车并道、交通标识识别等功能,无需人为操控或介入。该场景主要包括前视方案和环视方案。

通过机器与人的交互,增强驾驶体验或在特定情况下完成驾驶任务。该场景主要包括车内摄像头方案、虚拟后视镜方案等。

机器-机器和机器-人为应用场景的分类,用途可能存在交叉,即同一功能可能既需要向机器传达指令,也需要向人传达预警以确保在必要时干预。

图3:ADAS视觉方案架构

数据来源:Synopsys、CSDN、广发证券发展研究中心

前视方案通过高清摄像头采集图像数据,然后从图像数据上得到距离信息,该方案可细分为单目与双目方案。

单目方案传感器为一个单目摄像头,通常内嵌于车内后视镜;其算法原理为先识别物体,后根据图像大小测距。

双目方案传感器为一个双目摄像头,通常置于车内后视镜上方挡风玻璃处;其算法原理为通过视差直接测距,类似于人眼的感知。

a.单目方案

算法原理:单目摄像头遵循图像输入、预处理、特征提取、特征分类、匹配、完成识别几个步骤,其测距原理是先匹配识别后估算距离:通过图像匹配识别出目标类别,随后根据图像大小估算距离。单目测距的算法包括传统机器学习算法与深度学习中的卷积神经网络

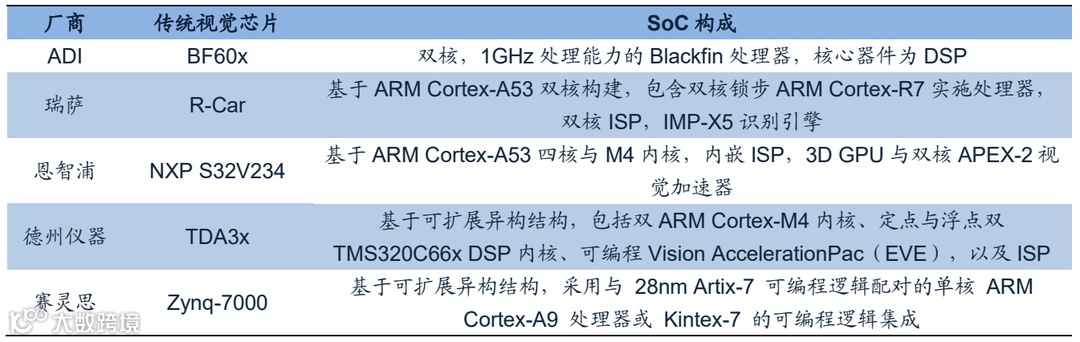

单目芯片:适用于传统视觉算法的处理器有NXP的S32V234、MPC567xK,TI的TDA2x、TDA3x,瑞萨的R-Car V3M,ADI的BF60x等,其中TI TDA2x、NXP S32V234等配备视觉加速器。

表7:代表性单目传统视觉处理SoC

数据来源:瑞萨等

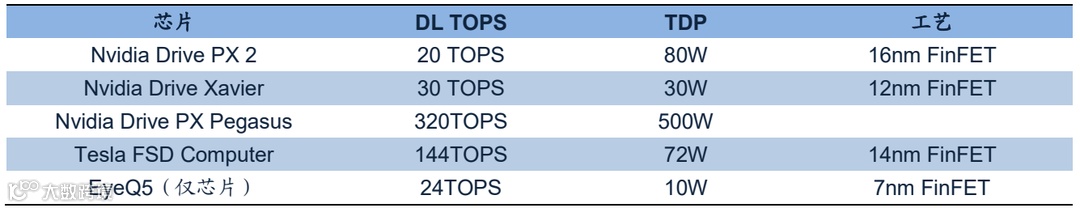

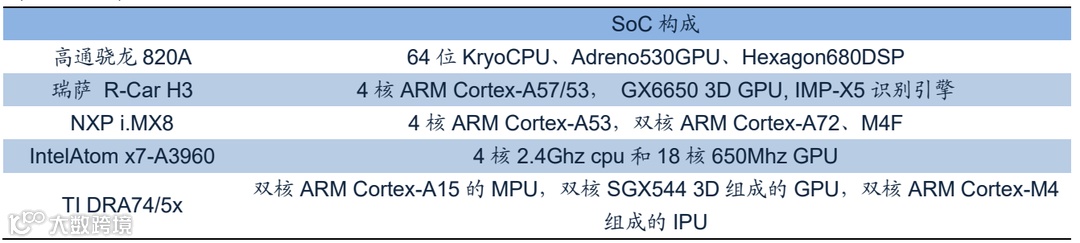

适用于传统算法叠加深度学习算法且符合车规级别的SoC包括Mobileye的EyeQ,特斯拉的FSD,英伟达的DRIVE PX等。

EyeQ芯片的能耗在下表对比中最低,但是是唯一一款基于单一芯片的参数。

英伟达的Drive PX, Drive Xavier, Pegasus以及特斯拉的FSD均为平台。

叠加深度学习算法的高性能芯片多数功耗都较高。硬件的局限性促成了深度学习在落地应用中的轻量化。

表8:代表性车规级深度学习平台/芯片

数据来源:英伟达等

b.双目方案

算法原理:双目摄像头的测距通过视差直接测距,类似于人眼的运作方式。双目测距从视差的大小倒推出物体的距离,视差越大,距离越近。

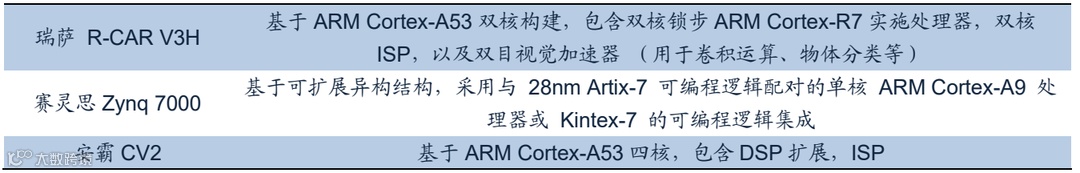

双目芯片:在车规级的 FPGA,L1-L3级别中赛灵思占据领先地位。随着双目的普及化,全球两大处理器厂家推出了专用双目设计的处理器(瑞萨的R-CAR V3H和NXP的S32V3系列),安霸也相继推出自动驾驶芯片CV1与CV2。

表9:代表性双目传统视觉处理SoC

数据来源:瑞萨、赛灵思等

单双目方案各有优劣,对比如下:

表10:单双目方案对比

数据来源:车云网

该方案通常将2个广角摄像头置于左右两侧外后视镜的后侧或下方,1个广角摄像头置于后备箱,1个置于引擎盖,拼接得到360度环视。该系统提供车身周围实时的俯视图像,用全景图像消除车身周围的视野盲区,提供相对方位与距离信息。

算法原理:环视方案通常经过摄像头标定-配准的流程。

标定阶段,内参在出厂时即可得到,外参需要进行标定,得到摄像头安装的高度和角度。拼接阶段需要配准,为避免盲点、模糊及其他景深产生的问题。一般可以基于区域(FFT变换)或基于特征(SIFT,SURF等)进行配准。鱼眼相机需要额外的畸变矫正再进行拼接。

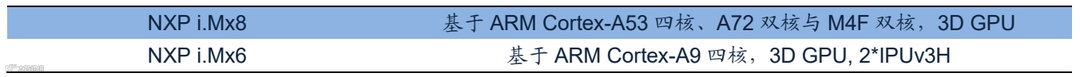

芯片:恩智浦S32V234、瑞萨R-Car V3M、TDA3x等SoC兼顾前视摄像头与环视摄像头。专门针对环视方案设计的有恩智浦的i.MX6和i.MX8系列等。

表11:NXP环视方案芯片

数据来源:恩智浦

驾驶员监控系统的功能主要针对驾驶员的疲劳、分神、不规范驾驶等危险情况进行预警,要求在全部工况环境下(包含暗光、夜晚、逆光等)工作,且不受驾驶员衣着的妨碍。

DMS算法原理:DMS的视觉算法基于深度学习。

以伟世通旗下AllGo Embedded系统为例,其通过对驾驶员进行人脸检测(判断是否检测到人脸)、头部特征识别(俯仰角、偏航角、滚动角)、眨眼检测(眨眼频率、时长)、眼神检测(俯仰角、偏航角)等,来判断驾驶员是否疲劳驾驶。

芯片:目前车规级的芯片包括高通的骁龙820A、瑞萨 R-Car H3、英特尔的IntelAtom和德州仪器的Jacinto DRAx等。

表12:代表性DMS芯片

数据来源:高通等

(四)视觉方案优劣势

视觉方案的最大优点在于整体落地成本低。以特斯拉的纯视觉方案为例,在去除了毫米波雷达后,其纯视觉方案仅需要八个摄像头,而单个摄像头的成本在 30 美元左右,其视觉方案整体硬件成本仅为 200 美元左右。

而对于多感知器融合方案,其中的激光雷达成本高昂。尽管近几年来激光雷达的成本不断降低,但单颗仍在 600-2000 美元左右,其成本远远高于视觉方案。

视觉方案的潜在缺点为对光源有一定要求,遇到过曝光或者逆光的情况下(如出隧道场景时)以及极端环境下识别会受到影响。视觉方案依赖于摄像头的数据输入,因此在强逆光场景下,该方案存在对于白色物体检测不佳的情况。而对于纯视觉方案,解决这类问题的出路在于继续扩展数据量,以在模糊、缺失部分数据的情况下 仍能够推算出完整情况。

此外,有观点认为纯视觉方案缺乏对未知障碍物的识别能力,基于识别的视觉感知必须在集中训练过类似的物体后才能进行避障,对于从未见过的异形障碍物则无能为力。

(五)未来发展趋势

1. 多传感器融合

目前自动驾驶的实现路径分两大阵营:特斯拉的纯视觉方案以及多传感器融合方案。

纯视觉方案在高级别自动驾驶上准确率会降低,无法满足复杂情况下的环境监测;多传感器融合的方案以技术冗余来保证安全性,是目前实现L4/L5级别自动驾驶的主流路径。

2. 传感设备搭载数量增加

实现自动驾驶这一终极目标需要增加传感硬件设备的搭载数量。

在新势力品牌推出的新车型中,单车感知部件的搭载数量普遍超过30个,其中标配12颗超声波雷达、5颗毫米波雷达,10颗+摄像头数量、1~3颗不等的激光雷达等。传感器的增加使汽车对周围环境的感知更加灵敏准确,为实现未来的自动驾驶提供决策基础。

三

ADAS前视视觉方案前装市场规模

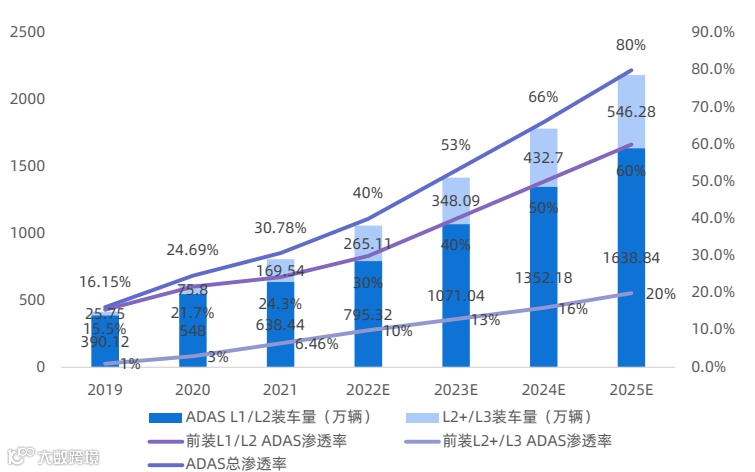

前视方案为自动驾驶实现的核心,根据我国每年ADAS L1/L2及L2+/L3装车量、前视视觉方案价格(800-1000元,假设性能升级和价格递减相抵消),可以测算2022-2024年我国ADAS前视视觉方案前装市场规模分别为95亿、128亿、161亿左右。

图4:中国智能驾驶市场装机量及渗透

数据来源:高工智能汽车公众号、佐思汽研公众号

四

业内企业布局

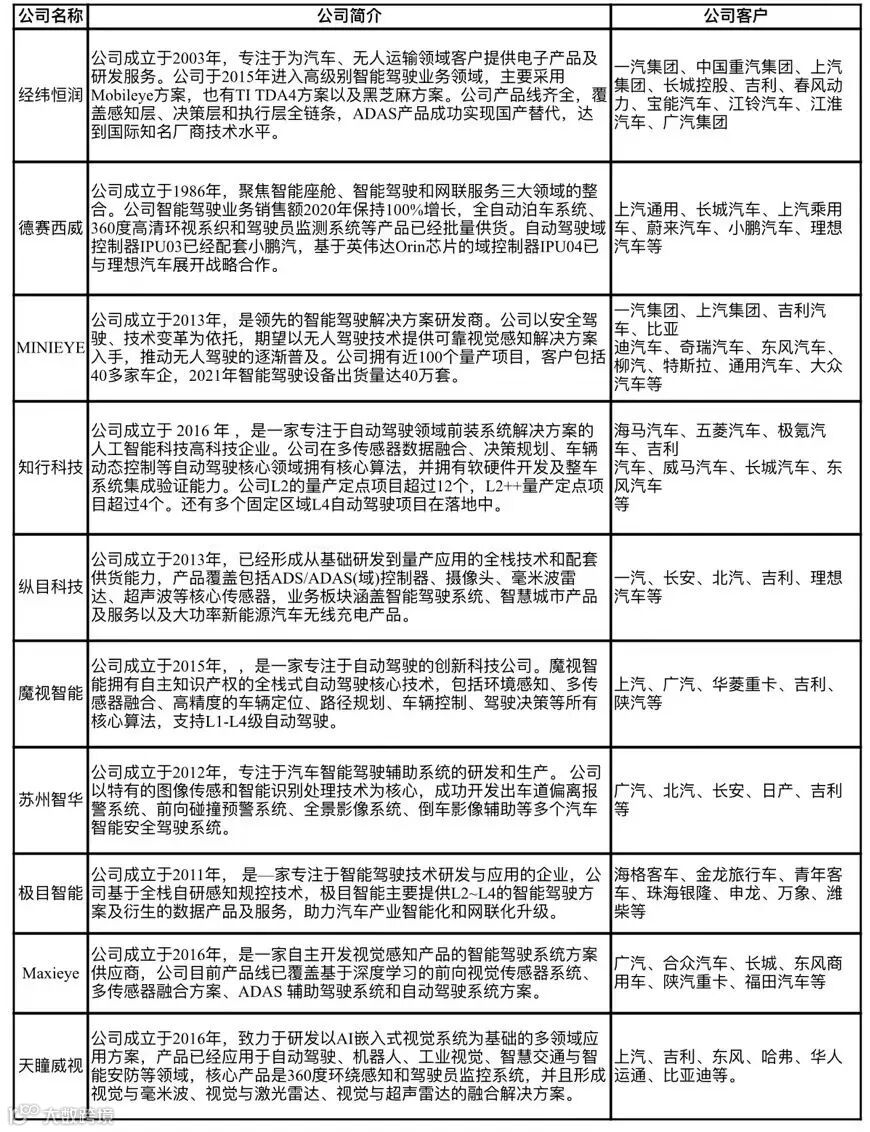

近年来我国相关企业发展迅速,部分代表性企业如下:

五

永鑫观点

永鑫方舟投资团队认为:随着汽车智能化、网联化快速发展,ADAS的渗透率也快速提升,ADAS视觉方案市场将保持稳定增长。该行业门槛高、验证周期长、技术人才壁垒高、市场空间大、大机构和产业投资争相布局。

汽车产业正经历类似功能手机向智能手机过渡的进程之中,永鑫方舟投资抓住变化赋予的时代机遇,积极布局该产业上下游。公司投资的知行科技专注于自动驾驶领域前装系统解决方案,在多传感器数据融合、决策规划、车辆动态控制等自动驾驶核心领域拥有核心算法,并拥有软硬件开发及整车系统集成验证能力,公司L2的量产定点项目超过12个,L2++量产定点项目超过4个。

在汽车领域,永鑫还投资了已经上市的汽车隔离芯片龙头企业纳芯微和汽车充电桩核心MOSFET供应商东微半导体、新能源汽车屏幕全贴合企业桐力光电、汽车加速度计传感器芯片领先企业明皜传感、车规级MCU设计公司云途半导体、以及动力电池导电剂SP炭黑国内唯一大批量量产企业东恒新材料等。未来,永鑫还要在智能座舱、新能源汽车测试服务等领域加大投资布局。

本文件所提供之任何信息仅供阅读者参考,既不构成未来本公司管理之基金进行投资决策之必然依据,亦不构成对阅读者或投资者的任何实质性投资建议或承诺。本公司并不保证本文件所载文字及数据的准确性及完整性,也不对因此导致的任何第三方投资后果承担法律责任。基金有风险,投资需谨慎。

本文所载的意见仅为本文出具日的观点和判断,在不同时期,永鑫资本可能会发出与本文所载不一致的意见。如需转载、翻版、复制、刊登、发表或引用本文的全部或任何部分,请标注来源。

永鑫方舟

永鑫资本自2015年成立以来,专注于投资芯片半导体、5G通讯、智能制造、新能源、新材料、医疗器械等领域具有高成长潜力的优质硬科技项目。截至目前,永鑫资本已发行11支私募基金,累计管理规模近20亿元,已投资科技型企业50余家,其中已上市企业包括中际旭创、昀冢科技、罗博特科、东微半导、纳芯微等,所投企业多数已成为国内外细分领域龙头及行业标准制定者。2021年永鑫资本被时代财智评选为“亚洲最具远见投资公司”。

永鑫方舟立足于苏州本土和高端智能制造的主赛道,致力于建设有特色的赋能共创型基金,践行“让创业不再艰难”的深刻使命,为企业深度赋能,与企业共创成长,深度打造基金与企业共荣发展生态圈。

推荐阅读

► 永鑫Portfolio|半导体Niche Market行业研究之晶圆切割研磨工具