这两天我的朋友圈又炸了。

原本以为这周的 AI 圈子总能消停会儿了吧,毕竟大家都要去过感恩节或者准备黑五剁手了。

结果 Black Forest Labs 那帮人是? 不是疯啦~大半夜的,突然扔出来个 FLUX.2。

之前的 FLUX.1 已经把 Midjourney 逼得够呛,现在 2 代直接贴脸开大。

我看了一眼官方演示。

❝这不是升级,这玩意儿是直接换代啊。

以前抽卡,现在“定向爆破”

老粉都知道,我之前吐槽过很多次。

用 AI 做连续的角色或者产品图,真的很麻烦。

你得用 LoRA,得调 ControlNet,得写提示词,最后生成的图,just soso。

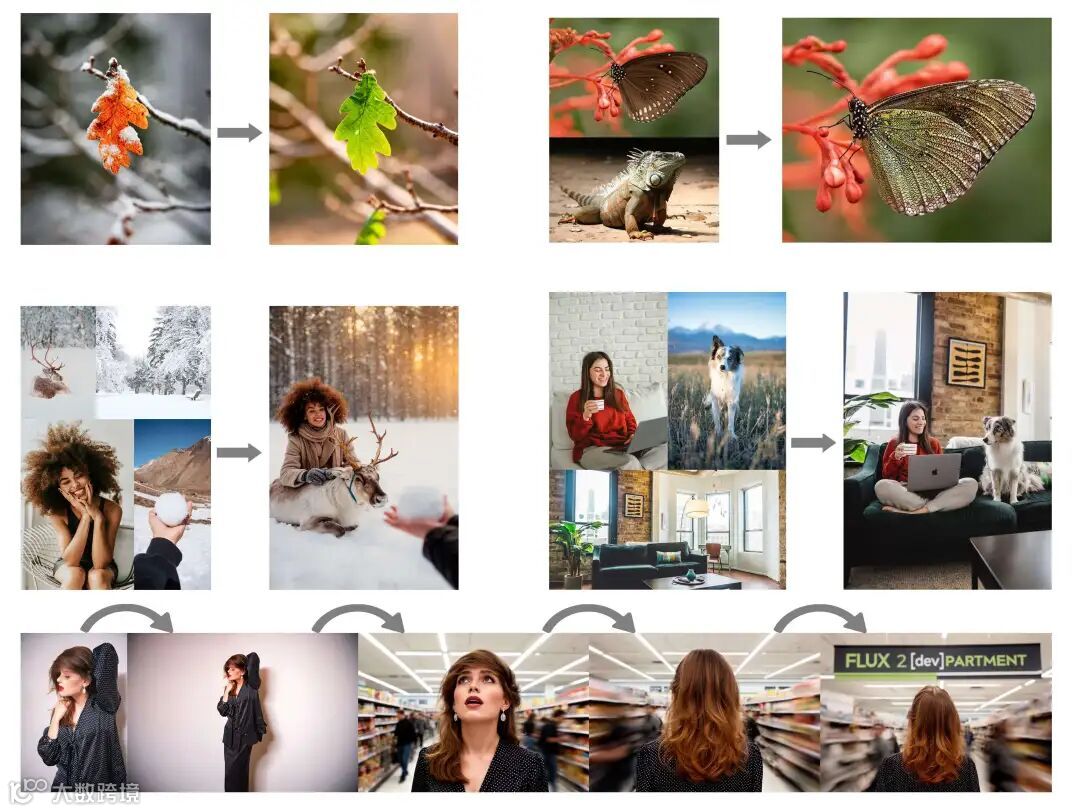

但 FLUX.2 可不一样啊:

支持 10 张参考图。

注意,是 10 张。

这是个什么概念呢?

你可以把一个角色的正面、侧面、大头照、全身照,甚至是他穿不同衣服的照片,全部全部丢给它垫个图。

然后告诉它:“给我生成这个人在火星喝咖啡。”

它不需要你去跑几个小时的训练,不需要你懂什么是 rank 什么是 alpha。

它直接就能懂这个人的长相、神态、甚至穿衣风格。

做连载漫画的,主角的脸终于不用每一格都像“异父异母的亲兄弟”了。

这种“即插即用”的一致性,才是生产力工具该有的样子。

既然聊到了生产力,就不得不提 FLUX.2 的另一个杀手锏。

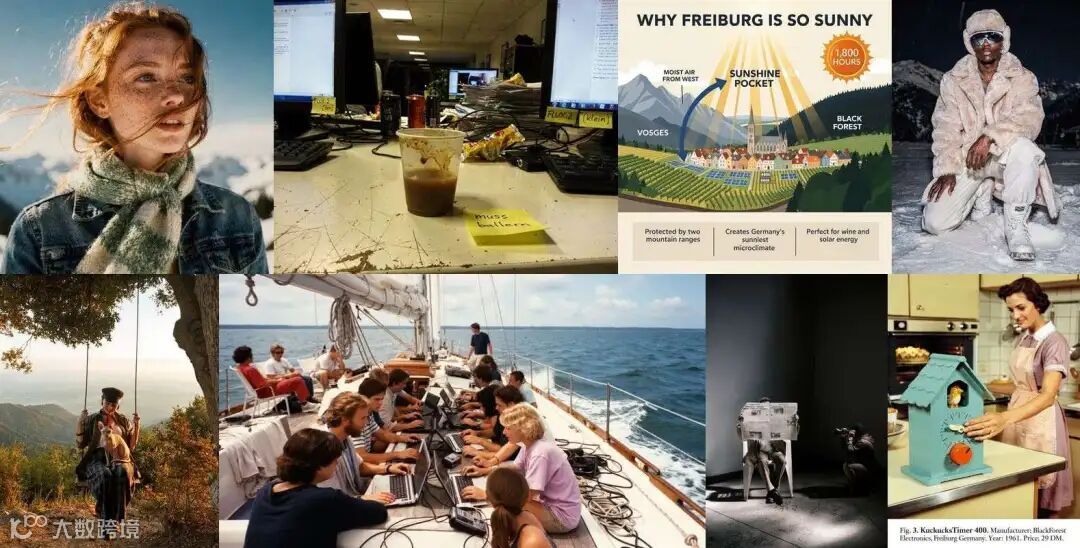

文字渲染了。

还记得以前用 AI 画图,如果画面里有文字,出来的基本都是“鬼画符”或者乱码吗?

虽然后来的模型有所改进,但遇到复杂的排版还是会翻车的。

FLUX.2 这次好像是去哪儿进修过了。

它不仅能写对单词,还能处理复杂的排版、信息图表,甚至直接生成 UI 界面。

如果你是做 UI/UX 的,输入 prompt,它能给你出一套带文字、带 icon 且布局合理的界面原型。

这哪是画图,这是在抢设计师的草稿纸。

为了实现这些,Black Forest Labs 也是下了血本。

FLUX.2 结合了 Mistral-3 24B —— 这是一个参数量巨大的视觉语言模型。

emm。。。你可以理解为,直接给画师配了一个懂百科全书的文案策划。

这让它对物理世界的理解——光照怎么打、空间怎么透视、物体怎么堆叠,有了质的飞跃。

这就是为什么它生成的图片,逻辑感特别强。

那这么多版本,怎么选?

这次 Black Forest Labs 依然很良心,但也开始搞商业化分层了。

毕竟电费都挺贵的。

一共四个版本,我给大伙儿盘一下:

-

FLUX.2 [pro]:完全体,最强性能,当然也得付费或者走 API。不差钱的土豪们直接上哈。 -

FLUX.2 [flex]:这个有点意思,顾名思义,灵活版。适合极客或者开发者去摸索模型的边界。 -

FLUX.2 [dev]:重点来了。开源权重版!虽然是不可商用的开源(得看具体协议),但对于我们这种想在本地部署玩一玩、或者做学术研究的人来说,足够了。Hugging Face 上已经能拖下来了。 -

FLUX.2 [klein]:目前还是个大饼。官方说是专门给开发者准备的开源版本,估计体积会小一点,跑得快一点?还在 Beta 测试,感兴趣的可以去填个表排队。

对了,还有一个彩蛋捏。

他们发布了一个新的 VAE(变分自编码器)。

这玩意儿就像是图像的“压缩解压引擎”,新的 VAE 解决了长期以来困扰业界的“可学习性-质量-压缩率”的不可能三角。

人话就是:图更清晰了,生成效率还没丢。

写在最后

测完这一圈,我有个很强烈的感受。

AI 绘图的门槛,正在经历两极分化。

一方面,像 FLUX.2 这样的工具,让“普通人”也能通过简单的对话和几张参考图,做出大师级的作品。技术门槛在地板上摩擦。

但另一方面。

审美的门槛在天上。

当工具不再是瓶颈,拼的就是谁的脑洞更大,谁的审美更好,谁更懂得如何“调教”这些数字生命。

以前我们卷技法,以后我们卷想法。

FLUX.2 [dev] 已经在 HuggingFace 上了。

只要你显卡顶得住。

赶紧去试试吧。

那种看着屏幕里诞生出完全符合你想象画面时的快感。

真的。

比打游戏爽多了。 这种“造物”的爽感,一旦体验过,就真的回不去了。

目前 Hugging Face 上已经有 dev 版本的权重了,本地显存够的朋友,可以去动手试试。

别问我显存要多少。

问就是借的卡。

❝友情提示:FLUX.2 毕竟是新出的,生态还没 1.0 那么成熟,LoRA 和插件估计得缓一阵才能跟上。

但未来已来,不是吗? 项目地址在这里:

官网介绍:bfl.ai/blog/flux-2

HuggingFace模型库:huggingface.co/collections/black-forest-labs/flux2

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~谢谢你看我的文章,我们,下次再见。