| 极市线上分享 第105期 |

一直以来,为让大家更好地了解学界业界优秀的论文和工作,极市已邀请了超过100位技术大咖嘉宾,并完成了104期极市线上直播分享。往期分享请前往bbs.cvmart.net/topics/149或直接阅读原文,也欢迎各位小伙伴自荐或推荐更多优秀的技术嘉宾到极市进行技术分享,与大家一起交流学习~~

目前最先进的视觉自注意力模型 (Vision Transformer)通常需要先在超 大规模的图像或者视频数据集上进行预训练, 才能在相对较小的数据集上展示出卓越的性能。如何在不使用任何其他预训练模型或额外图像数据的情况下,从视频数据自身中有效地训练Vision Transformer,仍然是一个没有被解决的问题。与图像数据集相比,现有的视频数据集的规模相对更小,这进一步增加了直接在视频数据集上训练Vision Transformer的难度。

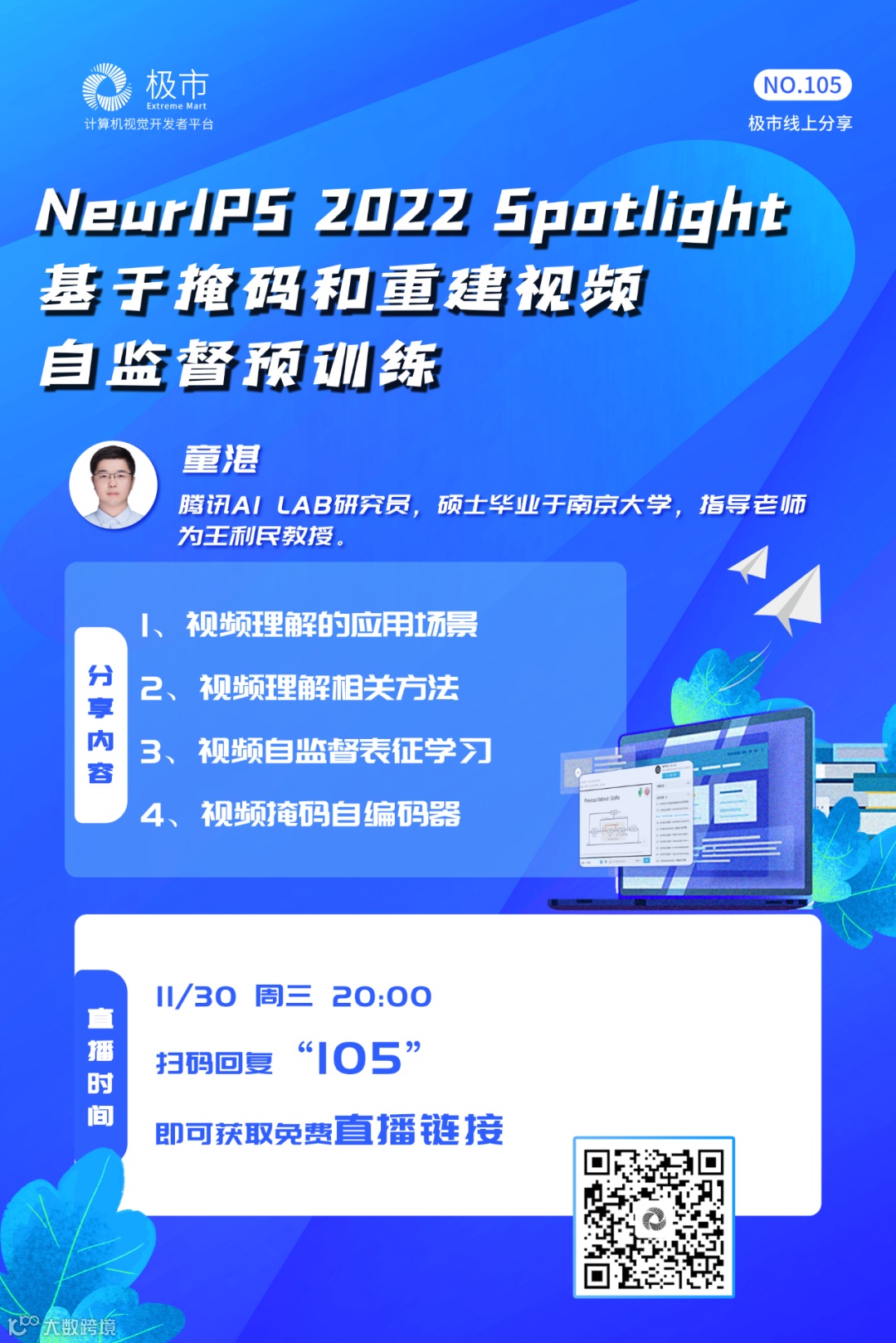

在本次分享中,我们邀请到了腾讯AI Lab研究员童湛,将主要介绍他们在这个问题上的探索工作:

VideoMAE: Masked Autoencoders are Data-Efficient Learners for Self-Supervised Video Pre-Training(NeurIPS 2022 Spotlight)

“其中,我们尝试利用掩码式自监督预训练的方式对Vision Transformer进行预训练。进一步地,我们设计了一种带有极高掩码比率的管道式掩码策略,并且提出了视频掩码自编码器(VideoMAE),释放Vision Transformer在视频理解相关任务上的强大表征能力。”

01

直播信息

时间

2022年11月30日(周三):20:00-21:00

主题

02

嘉宾介绍

童湛

腾讯AI Lab研究员。硕士毕业于南京大学, 指导老师为王利民教授。研究方向为计算机视觉, 包括视频理解、 动作识别和视频自监督学习等。

03

关于分享

➤论文

论文链接:https://arxiv.org/abs/2203.12602

代码地址:https://github.com/MCG-NJU/VideoMAE

04

参与方式

关注“极市平台”公众号,回复“105”可获取免费直播链接。

04

往期回顾

CVPR 2022-南开大学郑兆晖:目标检测定位蒸馏

NTIRE 2022 冠军方案:用于轻量级图像超分辨率的蓝图可分离残差网络

严彬-Unicorn:走向目标跟踪的大一统(ECCV2022 Oral)

CVPR 2022-唐业辉:量子启发的新型视觉主干模型WaveMLP

港科大陈启峰:图像处理与复原中的可逆性问题

陈使明:零样本学习的关键问题研究

郑哲东丨从行人重识别到无人机定位

陈鑫:CVPR 2021-TransT: 基于Transformer的高性能单目标跟踪算法

更多往期分享请浏览:极市计算机视觉技术分享集锦

# CV技术社群邀请函 #

备注:姓名-学校/公司-研究方向-城市(如:小极-北大-目标检测-深圳)

即可申请加入极市目标检测/图像分割/工业检测/人脸/医学影像/3D/SLAM/自动驾驶/超分辨率/姿态估计/ReID/GAN/图像增强/OCR/视频理解等技术交流群

每月大咖直播分享、真实项目需求对接、求职内推、算法竞赛、干货资讯汇总、与 10000+来自港科大、北大、清华、中科院、CMU、腾讯、百度等名校名企视觉开发者互动交流~