具身智能开源企业对比一览

表:十大具身智能领域开源企业及其核心开源要素概览。

1. Open Robotics(开源机器人基金会)

Open Robotics是全球机器人领域最具影响力的开源组织之一,由Willow Garage衍生成立,包含Open Source Robotics Foundation (OSRF)等机构。其使命是通过开源协作加速机器人技术发展。从早期的ROS 1到如今的ROS 2框架,Open Robotics提供了机器人操作系统ROS这一事实标准平台,被广泛应用于学术和产业界的各类机器人项目。ROS为机器人的感知、控制、规划提供了丰富的软件包和工具,例如激光雷达驱动、SLAM建图、运动规划MoveIt等,大大降低了开发门槛。

开源时间线与项目:Open Robotics的里程碑始于2007年ROS最初版本问世,此后不断扩充功能;2010年推出PR2双臂移动机器人作为ROS示范平台;2017年发布ROS 2以支持工业实时应用。此外,Open Robotics还维护了Gazebo(现改名Ignition Gazebo)仿真器、Open-RMF机器人车队协调框架等项目。2022年末,Open Robotics的核心开发团队加盟Alphabet旗下Intrinsic公司,ROS项目本身仍以开源社区方式独立运作。

开源内容分类:Open Robotics专注于机器人软件框架的开源,包括机器人中间件(消息通信、分布式协调)、算法库和开发工具等。ROS框架模块化地涵盖从硬件驱动(传感器、执行器接口)到算法包(如导航、控制、识别)再到仿真工具(Gazebo模拟环境)等完整生态。其中,Gazebo提供了逼真的物理仿真平台,支持多人协作开发和测试机器人算法。Open Robotics本身不直接开源实体机器人硬件,但通过ROS支持了众多硬件平台的标准化接口,使得开源软件可方便地应用到各种机器人上。

典型开源项目与机器人:ROS框架的成功催生了许多典型的开源机器人平台。例如TurtleBot系列移动机器人由Open Robotics与合作企业推出,是一个低成本开源机器人本体项目。最新的TurtleBot3采用模块化设计,配备LIDAR、深度摄像头等传感器和OpenCR控制板,其设计文件和软件均开源,使开发者可以像搭积木一样组装并编程。这一平台证明了ROS在小型服务机器人上的应用,也成为教学和研究中的入门工具。另外,ROS社区中还有大量开源机器人模型,如两足人形机器人DARwin-OP/ROBOTIS OP系列(由ROBOTIS发布,使用ROS架构)等,均受益于Open Robotics的软件支持。

感知模态与控制架构:作为软件平台,ROS本身并不限定特定传感器,但它提供了驱动和接口去整合视觉、激光雷达、IMU、力传感器等各种模态数据。在ROS架构下,感知模块可以发布如点云、图像等话题,其他节点订阅后进行融合处理。这种松耦合架构方便开发者试验多传感器融合算法。在控制方面,ROS拥有ros_control框架,可实现机器人的关节空间和任务空间控制控制器插件;还有MoveIt!等运动规划框架支持机械臂的运动学求解、避障路径规划。ROS强调模块化和通信中间件,将感知、决策、控制各功能解耦,通过消息在发布/订阅架构中交互。这种架构极大提高了机器人的系统集成效率,使不同机构的开发者都能贡献自己的算法模块并共享给社区使用。总之,Open Robotics通过ROS营造了一个开放生态,支持从低层驱动到高层智能各环节的开源研发,大幅加速了具身智能机器人的研发迭代。

项目主页及资源入口:Open Robotics的主要项目ROS可在其官方网站ros.org获取,包含文档和教程。源码则托管在GitHub的ros组织下。此外,ROS Discourse论坛和ROS Answers问答平台汇集了开发者社区智慧。Gazebo仿真器的最新信息在其Ignition Robotics官网提供。Open Robotics的开源成果已经被全球成千上万机器人项目采用,成为名副其实的“机器人界Linux”。

2. Meta AI开源计划(Habitat仿真、ReSkin触觉等)

Meta(原Facebook)近年来在具身智能研究上投入显著,并坚持以开源方式发布其成果。Meta AI的开源工作涵盖仿真平台、传感器硬件、机器人控制库和大型数据集等多个方面,旨在推动机器人理解和交互能力的进步。

企业背景:Meta AI(原Facebook AI Research, FAIR)是Meta公司的研究部门。除了在自然语言、视觉等领域的工作,他们也积极探索Embodied AI(具身智能),即赋予AI以物理身体在环境中感知行动的智能。Meta认为,仿真和现实相结合的研究范式有助于培养AI的通用智能,因此投入开发了高性能模拟环境和真实传感器,使研究者能训练并测试机器人智能体。

开源时间线与代表项目:

• 2019年,Meta开源了AI Habitat模拟平台。Habitat允许在高度逼真3D环境中训练虚拟机器人智能体,提供了居家场景的照片级渲染和高效物理引擎。研究者可利用Habitat对机器人进行导航、路径规划、物体搜索等任务训练,这是Embodied AI研究的一大基础设施。

• 2021年,Meta与卡内基梅隆大学合作开源了ReSkin,这是一款廉价高灵敏度的柔性触觉传感皮肤。ReSkin厚度不到2毫米,内嵌磁性微粒与传感芯片,可以每秒400Hz频率感知触碰压力变化。这使机器人具备触觉感知能力,为Manipulation研究提供了新维度。

• 2022年,Meta AI机器人团队发布Polymetis开源框架。Polymetis可让研究者用PyTorch编写机器人控制策略,一套代码在仿真和真实机械臂上均可运行,解决了仿真-实物迁移难题。它内置针对Franka Emika等机械臂的控制接口,并支持强化学习和模仿学习算法对接。

• 2024年,Meta在触觉与人机协作领域取得重要进展,开源了Digit 360触觉传感器和Digit Plexus集成平台。Digit 360是一种指尖形状的高分辨率触觉传感器,指尖表面布有800万+压敏元件,可360°捕获微小形变。Meta公开了其硬件设计与代码,方便社区改进。Digit Plexus则提供了将多个触觉传感器集成到机器人手上的软硬件平台。同年,Meta还发布了PARTNR基准——基于Habitat的10万多个人类与机器人协作任务数据,用于评测大模型驱动的机器人在听从人类指令完成任务方面的能力。

开源内容分类:Meta的开源贡献主要分几类:

• 仿真平台:AI Habitat是其代表,提供模拟环境与工具链,包含Habitat-Sim引擎和Habitat-Lab任务定义库。Habitat支持导入真实场景扫描和物理交互,可用于训练视觉导航、房间重排等任务的智能体。

• 数据集:Meta发布过Ego4D(自我视角视频数据集,2021)以及Habitat相关的数据,如Replica 3D环境数据、PartNR任务集等。这些开放数据推动了多模态学习和视觉语言导航研究。

• 传感与硬件:Meta开源了触觉传感器(ReSkin、Digit 360)及低成本机器人平台(如LoCoBot移动操纵机器人,Meta提供了其控制软件PyRobot)。这些硬件的图纸、驱动代码公开降低了复制门槛。

• 算法与框架:除了Polymetis,Meta还开源了诸如PyTorch3D(用于机器人视觉)、VVISO等库,以及在研机器人项目的代码(如用于Dexterous Hands的模型)。这些软件涵盖强化学习、视觉感知到控制策略训练等方面。

典型开源机器人及参数:

• 模拟平台代表:Habitat虚拟机器人。Habitat中广泛使用的是LoCoBot的虚拟模型:一个配备摄像头和机械臂的室内移动机器人。LoCoBot真实高度约50 cm,履带或轮式底盘,上装5自由度机械臂和RGB-D摄像头。Habitat提供了LoCoBot在公寓环境中的数字孪生,使智能体可学习导航、抓取等。

• 传感硬件代表:Digit 360触觉传感器。它形似人类指尖,直径约2 cm,内置多层硅胶和摄像芯片,提供800万触觉像素。核心参数如触觉分辨率和灵敏度全球领先,可分辨0.1N以下细微力变化。配合Digit Plexus,可将多个Digit传感器安装到机器人手指上,实现全手触觉覆盖。

• 操控平台代表:Franka Emika熊猫机械臂 + ReSkin。Meta常用这一7-DOF机械臂测试触觉和操作算法。Franka臂长约0.8 m,末端加装ReSkin触觉皮肤的机械手夹爪,可用于测试灵巧操作(如精细抓取、旋拧)。Meta开源的Polymetis框架正是针对这类臂手系统设计,使之具备编程和学习新技能的能力。

感知模态与控制架构:Meta的开源项目强调多模态感知融合和人机协作。例如,在Habitat中,虚拟机器人可以获得RGB图像、深度图甚至仿真触觉等感知,其AI模型需理解视觉和语言指令来规划动作。在真实机器人上,Meta通过Digit 360赋予机器人类人触觉;结合视觉(摄像头)和语言(大模型指令),实现更自然的操作。控制架构方面,Meta既探索经典控制也深耕机器学习:Polymetis允许用强化学习训练抓取政策,然后通过模拟到真实无缝转移执行;Digit Plexus提供统一接口将多触觉信号编码并实时传输,类似机器人的“中枢神经”,以毫秒级低延迟反馈控制。Meta开源的机器人算法常与深度学习、模仿学习结合,例如PARTNR基准旨在利用LLM(大语言模型)规划协作动作。总体而言,Meta AI通过开源视觉+触觉+语言感知和智能控制组件,为构建具有人类般感知行动能力的机器人奠定了基础。

项目主页/GitHub:Meta的AI Habitat有独立官网 提供文档和源码。触觉传感器Digit 360和Digit Plexus的硬件设计与代码在GitHub (facebookresearch/Digit) 上公开。Polymetis框架代码在Facebook Research仓库(facebookresearch/Polymetis)可获取。此外,Meta AI发布的研究通常附带项目页面或博客说明(如ai.facebook.com/blog),方便开发者了解使用方法和贡献改进。通过这些开源渠道,科研与工程人员可直接使用Meta的最新技术成果,加速机器人触觉、仿真和智能决策方面的研发。

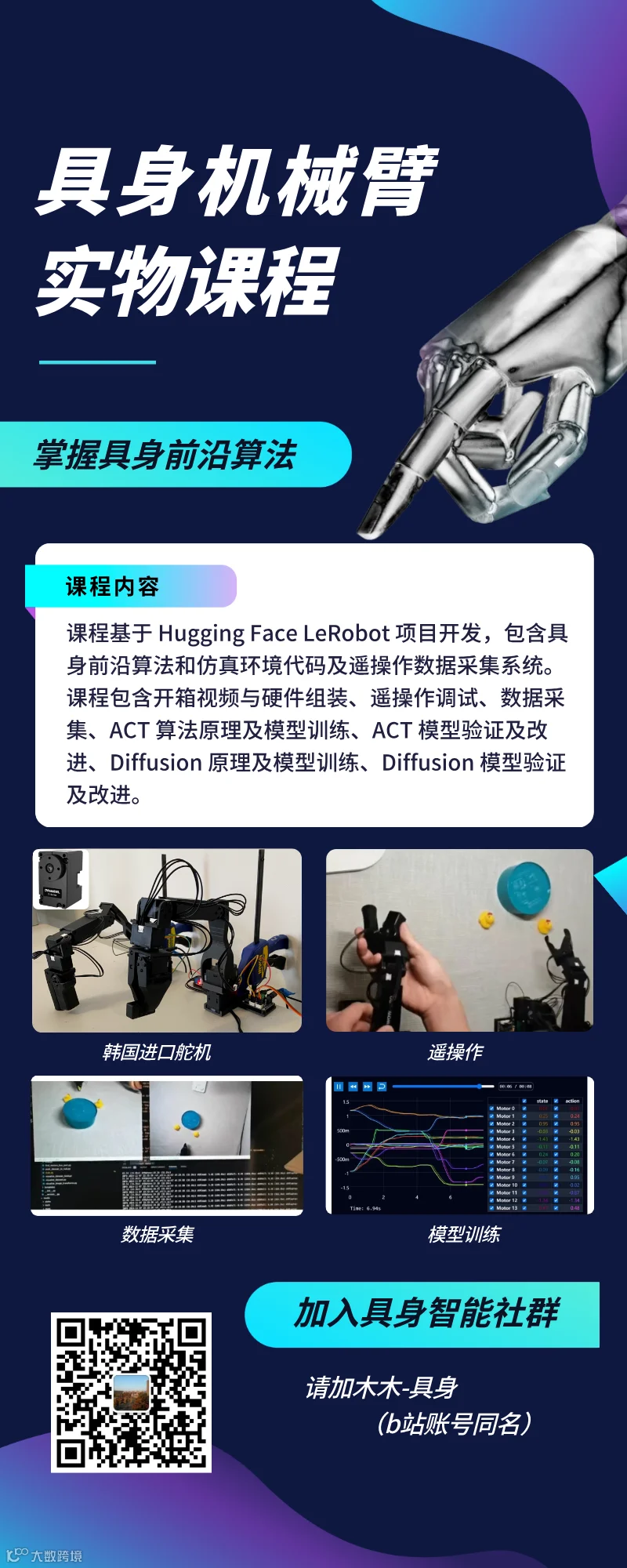

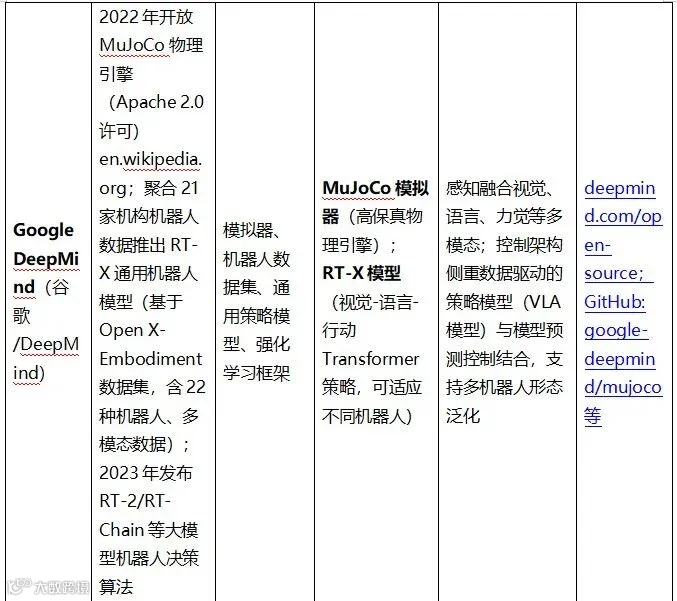

3. Google DeepMind开源项目(MuJoCo模拟、通用机器人策略等)

Google及旗下DeepMind在机器人与Embodied AI领域进行了大量前沿探索,并以开源形式提供了重要工具和资源,涵盖物理引擎、控制套件、大规模数据集和通用策略模型等。这些开源成果不仅支撑了学术研究,也引领了行业技术方向。

企业背景:Google长期在机器人软件、机器学习方面投入,曾组建Google X机器人团队、收购波士顿动力等。2018年后Google将一部分机器人研发并入Google AI/Brain部门,另一部分在子公司Intrinsic继续。DeepMind作为Google旗下AI研究机构,也在强化学习机器人控制上取得突破。二者融合为Google DeepMind后,更加注重通过AI算法提升机器人感知决策能力。在开源方面,Google秉承其开放科研的理念,持续开放关键代码和数据,与社区共享。

开源时间线与代表项目:

• 模拟与控制工具:Google在2017年开源了DeepMind Control Suite,提供一系列虚拟机器人任务和统一接口,方便比较不同算法绩效。其后,Google于2021年收购业界知名物理引擎MuJoCo并于2022年5月完全开源en.wikipedia.org。MuJoCo(Multi-Joint dynamics with Contact)被认为是速度快、精度高的机器人动力学仿真库,开源后研究者可自由使用和改进en.wikipedia.org。同时,Google还发布了MuJoCo基础上的MJPC(MuJoCo MPC)实时运动预测控制库,用于求解机器人操作中的最优控制问题。

• 大规模机器人数据:Google深知数据对训练通用机器人智能的重要性。2022-2023年,Google Brain/Robotics联合多家机构整理了Open X-Embodiment机器人数据集。该集融合了21个研究单位的22种不同机器人平台、共80万+段操作演示数据octo-models.github.io,涵盖机械手、移动机器人、仿人等多种形态,任务包括抓取、工具使用、多步骤操作等。Google将此数据开放,供学界训练大模型。这被视为机器人领域的“ImageNet时刻”aibase.com。

• 通用策略模型:利用上述数据,Google DeepMind在2023年发布了名为RT-2(Robotics Transformer 2)的模型,以及更进一步的RT-X项目。其中RT-2将视觉Transformer与语言模型结合,让机器人通过视觉理解指令再执行操作。RT-X则代表一个Vision-Language-Action统一模型训练框架。Google开源了部分代码和模型检查点,使社区能够复现和改进这些成果。此外,Google还提出了SayCan(将LLM用于规划机器人行动)等新思路,并 often 在研究论文附带开源实验代码,让开发者尝试在自己机器人上实现类似功能。

开源内容分类:

• 仿真与引擎:MuJoCo作为高性能物理引擎开源后,搭配Gym接口,成为强化学习训练机器人的常用模拟平台。DeepMind Control Suite提供了如平衡摆、抓块等标准任务环境。Google还开源了Android Humanoid Simulator等特殊仿真,用于如Parkour行为研究。

• 数据集:Open X-Embodiment是最新的大规模开放数据集。更早些时候,Google发布过Robosuite任务套件和Robonet抓取视频数据等,但规模较小。Open X-Embodiment汇集多来源,为训练通用机器人政策提供了丰富多样的数据octo-models.github.io。

• 模型与算法:Google将大量机器人学习算法实现开源,例如强化学习库Dopamine、进化策略库EVOL。针对机器人大模型,Google公布了RT-1/RT-2的训练细节和部分模型权重,便于复现。在路径规划领域,谷歌开源过Cartographer激光SLAM库等经典算法。

• 硬件设计:相较软件,Google鲜少直接开源机器人硬件,但曾分享过低成本机器人手(如DX机器人手)的设计以及iRobot合作的廉价抓取平台。不过这些影响不及软件开源广泛。

典型开源项目与机器人:

• 模拟器代表:MuJoCo + DM Control。MuJoCo擅长模拟连续控制机器人,如典型任务Half-Cheetah(半猎豹双足机器人)和Humanoid人形机器人平衡走路等都是社区常用基准。MuJoCo仿真的人形高度约1.5 m、质量约62 kg,可模拟复杂关节动力学。研究表明MuJoCo在这些场景下每秒仿真步数远高于开源Bullet等引擎,这对训练RL代理节约大量时间。

• 数据集代表:Open X-Embodiment合集收录了多款真实机器人数据,其中有Franka Emika机械臂在厨房环境中执行摆放器具任务的数据,也有Spot机器人在野外导航的数据等。一个具体实例是来自Stanford的Broadband Arm数据,包含机器人手臂用各种工具(刀、刷子)的操作视频。这些异质数据统一格式开放,为训练通用模型提供前所未有的广度。

• 策略模型代表:Robotics Transformer X (RT-X)模型。它是一个具有数亿参数的Transformer,通过学习视觉、语言、动作三模态关联,能够对不同机器人的状态做出合理响应。例如让摄像头看到杂乱桌面,RT-X能用抓取机器人执行“收拾桌面”的多步骤动作。此类模型对机器人硬件不敏感,具有跨形态泛化能力,被认为是通向通用机器人智能的重要方向。

感知模态与控制架构:Google DeepMind的开源工作体现了从模型驱动角度重塑机器人架构的思路。他们强调融合视觉与语言感知:RT系列模型接收相机图像和人类指令(文本),输出机器人动作序列。这一架构让机器人能够“看懂”场景并按照语义目标行动。不仅如此,Google也在尝试让模型利用触觉、力反馈等信息,近期论文例如VC-1也探索多模态融合。控制方面,Google支持经典模型预测控制(MPC)在机器人上的应用,如开源的MJPC库能让机械臂实时优化轨迹。另一方面,端到端强化学习仍是重要范式,Open X数据和RT模型正体现将高层决策交由深度网络完成,而低层控制由模型输出关节角度或速度直接驱动。这种架构在简单任务上已表现出色,但在高精度需求时仍结合了传统反馈控制。如谷歌在自研折纸机器人中就采用RL负责策略选择,PID精调每步动作。总的来说,Google DeepMind开源项目正引领机器人大模型与数据驱动控制的潮流,将多模态感知、决策和低层控制有机结合,朝着通用智能机器人迈进。

项目主页及资源:MuJoCo现由DeepMind维护,源代码在GitHub的google-deepmind/mujoco仓库,可自由下载使用en.wikipedia.org。Open X-Embodiment数据集及说明在官方网站(robotics-transformer-x.github.io)提供,也有论文详细描述octo-models.github.io。Robotics Transformer系列模型的部分代码发布在GitHub的google-research组织下。Google Research还运营着博客和GitHub,对外发布最新开源成果。对于开发者而言,可关注Google AI GitHub以及Google开放研究的专页,以获取最新的机器人开源项目资讯和代码。

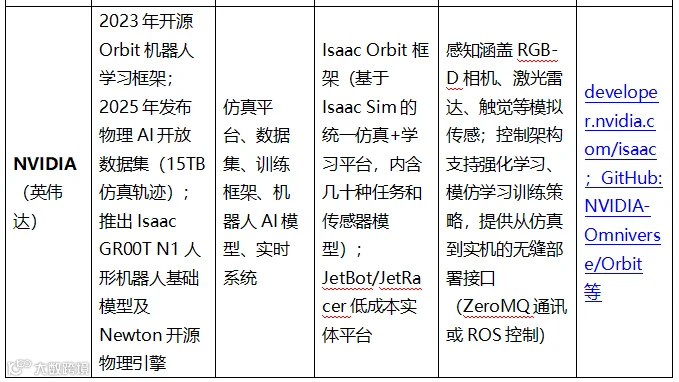

4. NVIDIA开源计划(Isaac平台、仿真与数据)

NVIDIA作为AI计算领域的领导者,在机器人具身智能方面也布局广泛。它利用自身优势提供高性能仿真平台、开源机器人学习框架和大规模合成数据,帮助研究者和工程师加速机器人研发。近年来,NVIDIA更进一步开放了机器人AI模型和物理引擎,与业界协作构建机器人生态。

企业背景:NVIDIA以GPU著称,近年大力推进机器人业务线Isaac。目前NVIDIA的机器人方案包括Isaac平台(软硬件结合的机器人开发套件)、Jetson嵌入式AI计算模块和行业应用方案等。NVIDIA认识到机器人研发的痛点在于仿真和数据匮乏,因此通过其图形和计算优势打造逼真的模拟环境和合成数据,从而训练可靠的机器人智能体。同时,NVIDIA积极参与开源社区,支持ROS 2在内的中间件和算法发展。

开源时间线与代表项目:

• 仿真平台:2019年,NVIDIA发布Isaac Sim仿真平台,在Omniverse(物理仿真和渲染引擎)上构建,提供高度逼真的场景、物理和光照。最初Isaac Sim为商业软件,但NVIDIA免费提供给开发者使用,并在2021-2022年不断更新支持ROS接口等。2023年3月,NVIDIA的研究团队联合ETH苏黎世等开源了Isaac Orbit框架。Orbit基于Isaac Sim,统一了机器人学研究中的模拟实验流程。它内置了数十种基准任务(如机械臂叠积木、布料折叠)和多种传感器、机器人模型封装,以及与强化学习库的接口。Orbit开放源码,允许开发者自定义环境、添加新机器人的URDF模型,并将训练的策略部署到真实机器人上。Orbit的开源标志着NVIDIA将其强大的仿真能力贡献给了学术和开源社区。

• 机器人数据与模型:NVIDIA利用仿真能力生成了海量数据。2025年3月的GTC大会上,NVIDIA宣布推出Physical AI Dataset物理智能数据集,并开放首批数据。这份数据集涵盖了超过32万条机器人交互轨迹,容量达15 TB,通过HuggingFace发布。其中包括仓储机器人搬运、工业臂装配等多场景的标准数据,可用于预训练机器人模型或验证算法。此外,NVIDIA还联合Google DeepMind、迪士尼研发新一代开源物理引擎Newton。在机器人AI模型上,2025年NVIDIA推出了全球首个开放人形机器人基础模型Isaac GR00T N1。GR00T N1是一个经过预训练的通用模型,赋予人形机器人推理和技能,NVIDIA承诺将其开放给开发者使用,从而加速各行业机器人应用落地。这一系列动作表明NVIDIA正致力于构建开放的“机器人大模型+模拟+数据”体系。

开源内容分类:

• 仿真与开发框架:Isaac Sim是NVIDIA机器人模拟的核心,但其本身非开源(免费提供二进制)。Orbit框架在Isaac Sim之上,源码完全开放。Orbit包括任务套件、学习算法接口、机器人工具函数等,大幅降低了使用Isaac进行研究的门槛。NVIDIA还提供了Isaac Gym(早期RL仿真库)及Isaac Lab等资源,后者将常用机器人研究流程整合,使其也开源供使用。

• 数据集与资产:Physical AI Dataset是NVIDIA开创的合成数据资源,持续扩充中。NVIDIA还推动USD(通用场景描述)标准,许多逼真的3D资产(场景、物件、机器人模型)通过SimReady等项目开放。这些高保真资产可供模拟训练或数字孪生应用。

• AI模型:NVIDIA在机器人AI上开始开放模型权重。GR00T N1作为通用人形AI基础模型已经发布,可定制微调。此外,NVIDIA开源过TAO Toolkit(可训练视觉模型用于机器人感知)和Isaac ROS GEMs(加速版AI算法用于ROS)等,使开发者能用到最先进的视觉、路径规划算法。

• 硬件平台与软件:NVIDIA支持一些开源机器人硬件,例如与科技社区合作推出JetBot(基于Jetson Nano的开源小车机器人)和Carter、Kayak等参考平台,提供3D设计与软件。软件方面,NVIDIA将许多机器人算法以ROS 2软件包形式开源(统称Isaac ROS),包括立体视觉、AprilTag定位、人体姿态估计等模块,方便在NVIDIA硬件上高效运行。

典型开源项目与机器人:

• 框架代表:Isaac Orbit。Orbit的突出特点是在逼真仿真中预置了丰富的机器人和任务。例如,有Franka Emika机械臂与YCB物块的操作任务、Allegro机械手操纵小球任务,ANYmal四足机器人的行走任务等。它封装NVIDIA PhysX物理模拟,可模拟接触、布料柔性。在Orbit中训练的政策,可通过ZeroMQ通信模块无缝对接现实ROS机器人执行。这一框架成为学术界模拟实验的新基准。

• 数据代表:开放物理AI数据集。其中机器人部分包含如仓库环境中的搬箱子任务(移动机器人+机械臂协作搬运多个尺寸的箱子),也有医疗场景手术机器人辅助操作的数据。每条轨迹包含机器人传感器读数、执行的控制命令等,可用于模仿学习或验证安全性。NVIDIA还将1000个以上逼真3D资产(车辆、人、家具等)开放给开发者,降低模拟构建成本。

• 机器人AI模型代表:Isaac GR00T N1。这是一个针对类人机器人(双足+双臂)的通用模型,采用双系统架构:一套负责感知和决策,另一套负责运动和技能。GR00T N1经过海量模拟数据和实际数据的训练,掌握了平衡行走、抓取搬运、人与环境交互等泛化技能。其设计可由开发者在自己的人形机器人上微调适配,以获得类似ChatGPT那样“预训练+微调”的效果,加快机器人应用开发。

感知模态与控制架构:NVIDIA开源项目覆盖了机器人从感知到控制的多个层次。在仿真中,Orbit等平台支持多种传感器模拟,包括RGB-D相机、激光雷达、力触觉传感器等,因此训练的智能体能够习惯融合多源信息。NVIDIA也注重边缘AI计算,Jetson模组和Isaac ROS加速算法让真实机器人可以本地实时处理视觉、激光等感知数据。控制架构上,NVIDIA提供了双管齐下的方案:一方面,通过强化学习、模仿学习在仿真中训练策略网络来执行高层决策(如走路、避障、操作物体);另一方面,也提供可靠的低层控制接口(如EffortControllers、MPC优化器)确保机器运动平稳。例如,在Orbit的双臂搬运任务中,策略网络决定抓取/放置时机和路径,而具体关节轨迹由低层解算保证动态稳定。值得一提的是,NVIDIA正在将生成式AI引入机器人控制——GR00T这样的基础模型可以被视为一种具备认知和运动技能的“大脑”,配合底层控制器(相当于“脊髓”),形成类似生物的分层控制结构。这种架构有望让机器人在复杂环境下自主决策,同时保持运动安全可靠。

项目主页及开源入口:NVIDIA的机器人仿真与开发资源集中在Isaac系列,其官方开发者页面提供软件下载和教程:developer.nvidia.com/isaac-sim。Isaac Orbit的源码和文档在GitHub仓库NVIDIA-Omniverse/Orbit中公开,可直接获取。物理AI开放数据集可在NVIDIA官方HuggingFace页面下载。关于GR00T模型和Newton物理引擎的进展,可参考2025 GTC发布的NVIDIA新闻稿。另外,NVIDIA在GitHub的IsaacROS组织下有大量ROS2软件包开源。通过这些渠道,研究人员能利用NVIDIA强大的模拟和计算资源,为具身智能算法开发提速。

5. ROBOTIS开源项目(开放式机器人硬件与软件)

ROBOTIS是一家来自韩国的机器人公司,以其DYNAMIXEL智能舵机和开源机器人平台闻名。多年来,ROBOTIS致力于打造模块化、开源的机器人硬件,并配套开源软件库,在教育和研究领域具有广泛影响。ROBOTIS的代表性开源产品包括小型人形机器人、机械臂和移动平台等,培养了一代机器人开发者。

企业背景:ROBOTIS成立于1999年,最初生产机器人执行器(舵机)。其推出的DYNAMIXEL系列伺服由于集成度高、可串联通信,成为许多机器人(尤其开源项目)的首选驱动器。为了展示舵机的强大功能,ROBOTIS与学术界合作开发了一系列开源机器人平台,例如DARwIn-OP人形机器人、Bioloid可编程机器人套件等。这些平台在RoboCup机器人比赛和高校实验室中获得成功。ROBOTIS由此坚定走开源路线,通过共享硬件设计和软件代码,与全球开发者共同进步。

开源时间线与代表项目:

• DARwIn-OP人形机器人:2010年左右,ROBOTIS联合美国多所大学发布DARwIn-OP(Open Platform)。这是一个约45cm高的小型人形机器人,拥有20个自由度,完全开源硬件和软件设计。DARwIn-OP可以视作全球第一个真正开源的人形机器人平台,其CAD图纸、控制代码公开,研究者可以自行组装或在此基础上改进。后续ROBOTIS推出升级版ROBOTIS OP2、OP3等,延续了开源理念。

• TurtleBot移动机器人:ROBOTIS也涉足移动机器人。2016年起与Open Robotics合作开发TurtleBot3,并在2017年正式发布。TurtleBot3是一款低成本开源移动平台,具有圆盘形底盘,两轮差动驱动。ROBOTIS为其设计了3D可打印机身和OpenCR控制板并开源,让用户可以打印零件、购买标准电子元件自行组装。TurtleBot3配备DYNAMIXEL舵机用于摄像头云台、LDS激光雷达用于SLAM,支持ROS软件栈,是教学和原型开发的理想平台。

• OpenManipulator机械臂:2018年,ROBOTIS发布OpenManipulator系列,它是小型开源机械臂套件。OpenManipulator-X采用4个DYNAMIXEL X舵机作为关节,负载约0.5kg,可以安装在TurtleBot上组成移动操作机器人。ROBOTIS开放了其机械结构图纸、电路以及ROS控制软件,开发者能够据此搭建自己的机械臂系统并进行二次开发。

开源内容分类:

ROBOTIS的开源贡献涵盖:

• 机器人本体硬件:如DARwIn-OP/OP3人形的机械设计、OpenManipulator机械臂的结构件和装配指南、TurtleBot3底盘的激光切割图等。这些硬件设计遵循开源硬件规范发布。

• 驱动与控制软件:ROBOTIS提供开源的DYNAMIXEL SDK,支持多种语言,方便控制舵机的位置、速度、力矩。他们还针对各平台编写了ROS Package,例如turtlebot3软件包包含SLAM、导航、遥控等功能。OpenManipulator也有ROS控制包,将正解逆解、轨迹规划等功能开源。

• 教程与文档:ROBOTIS在其e-Manual网站上详细公开了各产品的装配和使用说明,对爱好者和教育用户非常友好。还通过YouTube等分享开源机器人的演示和教学视频,培养社区。

典型开源机器人及核心参数:

• ROBOTIS OP3人形机器人:身高约51cm,质量约3.5 kg,20个 DOF(每腿6,每臂3,头2)。它采用Intel NUC计算机作为主控,DYNAMIXEL XM430舵机为关节驱动,头部有摄像头用于视觉。OP3完全兼容ROS,常用于学术研究(如RoboCup人形组比赛)。其机械设计和控制源码自DARwIn-OP时代就开源,便于实验室根据需要调整传感器或算法。

• TurtleBot3 Burger:直径约138mm的圆形底盘,高度0.18 m,重约1.5 kg。两个轮子差速驱动,最高速度约0.22 m/s;配备30m测距激光雷达、9轴IMU,可选装摄像头。控制板OpenCR基于32位ARM MCU,支持Arduino编程和ROS串口通讯。TurtleBot3开源硬件许可,允许用户打印改造底盘结构。

• OpenManipulator-X:4轴关节+夹爪的小型机械臂,工作空间半径约0.3 m,末端夹持重量最大500 grobotis.us。臂身由3D打印件和铝型材构成,各关节使用DYNAMIXEL XM430舵机(峰值扭矩约4 N·m)。它可以安装在TurtleBot等移动平台上。ROBOTIS开源了其运动学、动力学模型和控制算法(如拼写轨迹插值),使其能和ROS MoveIt无缝结合,实现抓取任务教学。

感知模态与控制系统:ROBOTIS的开源机器人多用于教学与入门研发,因此在感知和控制上追求简单有效而非高精尖。例如TurtleBot3主要依靠2D激光雷达和RGB摄像头感知环境,配合ROS SLAM算法构建地图并规划运动路径,控制上使用ROS Nav Stack进行目标点导航。这一套开源软硬件组合,使初学者很快掌握移动机器人的自主运行。对于OP3人形,其感知依赖单目摄像头(用于视觉识别球门等RoboCup任务)和IMU(用于姿态稳定)。控制上OP3采用零力矩控制维持平衡,步态算法和运动序列可以通过开源的Motion Editor调整。DYNAMIXEL舵机自带角度与温度反馈,ROS驱动包使得所有关节状态作为Topic发布,开发者可以很方便地获取状态闭环控制。ROBOTIS通过模块化设计实现控制架构解耦:例如OpenManipulator用DYNAMIXEL自带总线链接各关节,每个关节内置PID速度控制,ROS端发送高层位置命令即可,无需开发者处理底层驱动细节。同时,ROBOTIS也提供了一些高级算法的开源实现,如基于机器视觉的目标识别跟踪、机械臂的逆运动学解算等,方便用户直接调用。总而言之,ROBOTIS以开源硬件+标准化软件的模式,让感知和控制变得易于上手,其平台常被视为研究复杂算法之前的原型验证工具。

项目主页与开源入口:ROBOTIS官方的电子手册网站(e-Manual)详细列出了各产品的开源资源链接。例如,TurtleBot3的开源硬件和软件清单在其官方网站上可以找到,包括电路原理图、3D模型文件以及GitHub源码。ROBOTIS在GitHub的ROBOTIS-GIT账号下维护了数十个仓库,涵盖TurtleBot、Manipulator、OP机器人等全部代码。开发者也可以通过ROS官方的索引,找到ROBOTIS开源机器人的详细介绍和资源链接。凭借完善的文档和活跃的社区支持,ROBOTIS开源机器人已成为科研教学中的重要一环,并不断有新的模型和改进通过开源社区涌现。