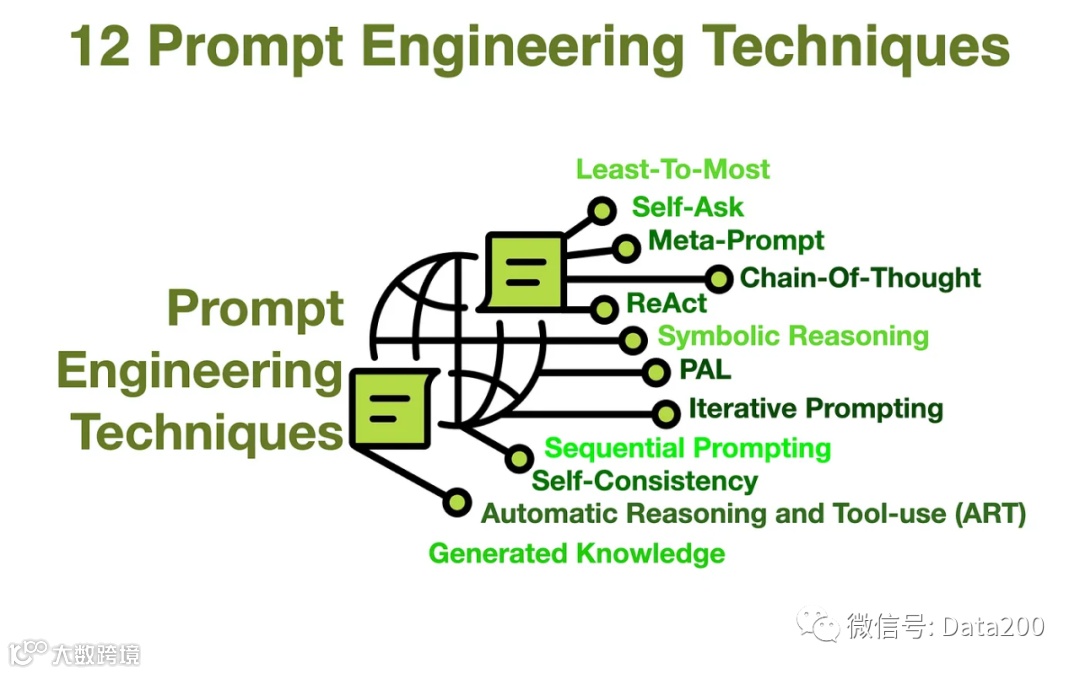

Prompt Engineering提示工程可以被描述为一种艺术形式,为大型语言模型 (LLM) 创建输入提示,可以确保输出的高质量。以下是制作单个或一系列提示的 12 种不同方法。

Least-To-Most 提示

Least-To-Most 提示是一种让大型语言模型(LLM)执行复杂推理的技术。这种技术的基础是,LLM 能够理解推理的概念,并能够将其应用于解决问题。

Least-To-Most 提示的基本思想是,将一个复杂的问题分解为一系列更简单的子问题。然后,LLM 将逐个解决这些子问题,并使用每个子问题的答案来促进下一个子问题的解决。

Least-To-Most 提示具有以下优势:

可以帮助 LLM 执行复杂推理:Least-To-Most 提示提供了一种结构化的框架,可以帮助 LLM 理解问题并生成解决方案。

可以提高 LLM 的学习效率:Least-To-Most 提示可以帮助 LLM 从示例中学习,并将这些知识应用到新的任务中。

可以提高 LLM 的灵活性:Least-To-Most 提示可以让 LLM 根据需要调整子问题的顺序,以适应不同的任务。

Least-To-Most 提示在以下领域具有广泛的应用前景:

自然语言处理:Least-To-Most 提示可以用于生成各种类型的文本内容,例如诗歌、代码、脚本、音乐作品等。

机器翻译:Least-To-Most 提示可以用于提高机器翻译的准确性和灵活性。

问答系统:Least-To-Most 提示可以用于提高问答系统的回答质量。

Self-Ask 提示

Self-Ask提示是一种让大型语言模型(LLM)执行复杂推理和生成自然语言的技术。这种技术的基础是,LLM 能够理解推理的概念,并能够将其应用于解决问题。

Self-Ask提示的基本思想是,将一个复杂的问题分解为一系列更简单的子问题,然后让 LLM 自己提出这些子问题。LLM 将使用自己的知识和推理能力来回答这些子问题,并最终得出最终答案。

Self-Ask提示具有以下优势:

可以帮助 LLM 执行复杂推理:Self-Ask 提示提供了一种结构化的框架,可以帮助 LLM 理解问题并生成解决方案。

可以提高 LLM 的学习效率:Self-Ask 提示可以帮助 LLM 从示例中学习,并将这些知识应用到新的任务中。

可以提高 LLM 的灵活性:Self-Ask 提示可以让 LLM 根据需要调整子问题的顺序,以适应不同的任务。

Self-Ask 提示在以下领域具有广泛的应用前景:

自然语言处理:Self-Ask 提示已被用于生成各种类型的文本内容,例如诗歌、代码、脚本、音乐作品等。例如,OpenAI 使用 Self-Ask 提示来生成创意文本格式,如诗歌、代码、脚本、音乐作品等。

机器翻译:Self-Ask 提示已被用于提高机器翻译的准确性和灵活性。例如,Google AI 使用 Self-Ask 提示来提高机器翻译的准确性和灵活性。

问答系统:Self-Ask 提示已被用于提高问答系统的回答质量。例如,Microsoft 使用 Self-Ask 提示来提高问答系统的回答质量。

Meta 提示

在提示工程中,Meta-Prompting 是一种让智能体反思自己的表现并相应地修改自己的指令的技术。这种技术的基础是,智能体能够理解自己的输出,并评估其与预期输出的差距。然后,智能体可以根据差距来修改自己的指令,以生成更符合预期的输出。

Meta-Prompting 通常使用一个总体元提示来指导智能体的反思过程。这个元提示可以是一个开放式问题,例如“你的输出与预期输出有何差距?”,也可以是一个具体的指示,例如“请修改你的指令,使你的输出更符合预期”。

Meta-Prompting 具有以下优势:

提高输出的准确性:Meta-Prompting 可以帮助智能体生成更符合预期的输出,从而提高输出的准确性。

提高输出的灵活性:Meta-Prompting 可以让智能体根据需要修改自己的指令,从而提高输出的灵活性。

提高智能体的学习能力:Meta-Prompting 可以帮助智能体从自己的错误中学习,从而提高智能体的学习能力。

Meta-Prompting 在以下领域具有广泛的应用前景:

自然语言处理:Meta-Prompting 可以用于生成各种类型的文本内容,例如诗歌、代码、脚本、音乐作品等。

机器翻译:Meta-Prompting 可以用于提高机器翻译的准确性和灵活性。

问答系统:Meta-Prompting 可以用于提高问答系统的回答质量。

思维链(CoT)提示

思维链(CoT)提示是一种让大型语言模型(LLM)执行复杂推理的技术。这种技术的基础是,LLM 能够理解思维链的概念,并能够将其应用于解决问题。

思维链是一种将一个更大的任务或问题分解为子任务,然后将这些子任务链接在一起的方法。使用一个子任务的输出作为下一个子任务的输入。

研究表明,当以 CoT 提示方式时,足够大的 LLM 可以使推理能力的出现成为可能。这是因为 CoT 提示提供了一种结构化的框架,可以帮助 LLM 理解问题并生成解决方案。

CoT 提示具有以下优势:

可以帮助 LLM 执行复杂推理:CoT 提示提供了一种结构化的框架,可以帮助 LLM 理解问题并生成解决方案。

可以提高 LLM 的学习效率:CoT 提示可以帮助 LLM 从示例中学习,并将这些知识应用到新的任务中。

可以提高 LLM 的灵活性:CoT 提示可以让 LLM 根据需要调整思维链,以适应不同的任务。

CoT 提示在以下领域具有广泛的应用前景:

自然语言处理:CoT 提示可以用于生成各种类型的文本内容,例如诗歌、代码、脚本、音乐作品等。

机器翻译:CoT 提示可以用于提高机器翻译的准确性和灵活性。

问答系统:CoT 提示可以用于提高问答系统的回答质量。

ReAct提示

ReAct提示是一种让大型语言模型(LLM)执行复杂推理和生成自然语言的技术。这种技术的基础是,LLM 能够理解推理和行动的概念,并能够将两者结合起来解决问题。

ReAct提示的基本思想是,将一个复杂的问题分解为一系列更简单的子问题,然后让 LLM 自己提出这些子问题,并根据需要生成行动来解决这些子问题。LLM 将使用自己的知识和推理能力来回答这些子问题,并最终得出最终答案。

ReAct提示具有以下优势:

可以帮助 LLM 执行复杂推理:ReAct 提示提供了一种结构化的框架,可以帮助 LLM 理解问题并生成解决方案。

可以提高 LLM 的学习效率:ReAct 提示可以帮助 LLM 从示例中学习,并将这些知识应用到新的任务中。

可以提高 LLM 的灵活性:ReAct 提示可以让 LLM 根据需要调整子问题的顺序,以适应不同的任务。

ReAct 提示在以下领域的应用:

自然语言处理:ReAct 提示已被用于生成各种类型的文本内容,例如诗歌、代码、脚本、音乐作品等。例如,OpenAI 使用 ReAct 提示来生成创意文本格式,如诗歌、代码、脚本、音乐作品等。

机器翻译:ReAct 提示已被用于提高机器翻译的准确性和灵活性。例如,Google AI 使用 ReAct 提示来提高机器翻译的准确性和灵活性。

问答系统:ReAct 提示已被用于提高问答系统的回答质量。例如,Microsoft 使用 ReAct 提示来提高问答系统的回答质量。

符号推理和PAL

LLM不仅应该能够进行数学推理,还应该能够进行符号推理,其中包括与颜色和对象类型有关的推理。

请考虑以下问题:

I have a chair, two potatoes, a cauliflower, a lettuce head, two tables, a cabbage, two onions, and three fridges. How many vegetables do I have?

LLM 应根据输入的数量将输入转换为包含实体和值的字典,同时过滤掉非植物实体。

最后,答案是字典值的总和,低于 LLM 的 PAL 输出:

# note: I'm not counting the chair, tables, or fridges

vegetables_to_count = {

'potato': 2,

'cauliflower': 1,

'lettuce head': 1,

'cabbage': 1,

'onion': 2

}

answer = sum(vegetables_to_count.values())

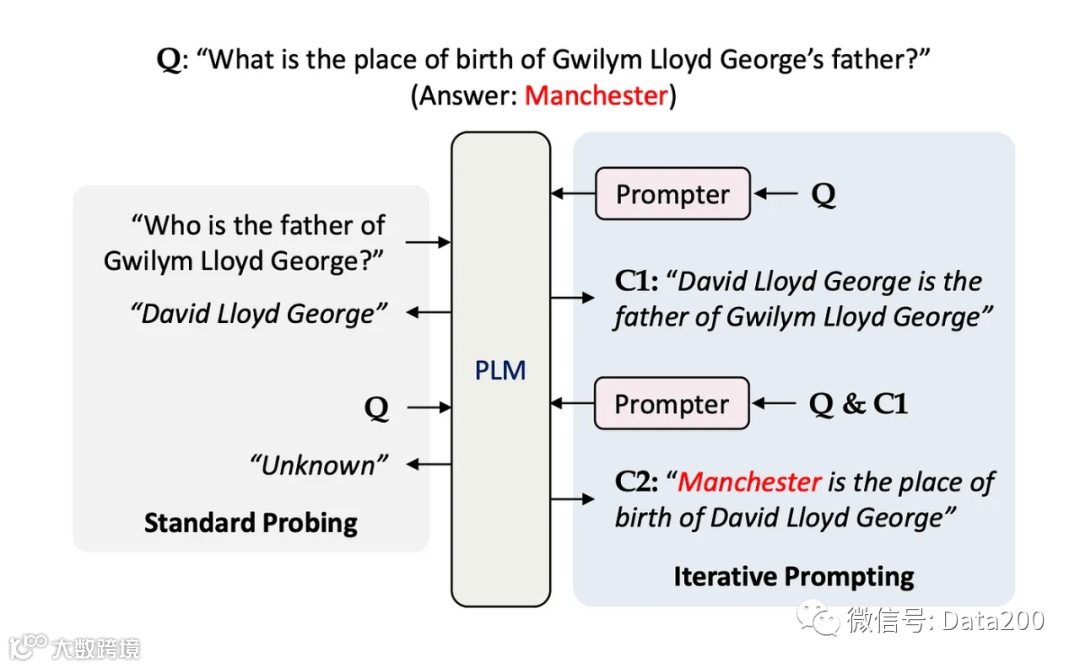

迭代提示

最近,重点已从LLM微调转移到增强的提示工程。确保提示与上下文相关,包含少量训练示例和对话历史记录。

确保提示通过迭代过程保存上下文信息。

迭代提示应该建立一个上下文的思维链,否定不相关事实和幻觉的产生。交互式上下文感知和上下文提示。

考虑到上图,在 C1 和 C2 中,知识对于准确回答问题很重要。迭代提示的方法包含思维链提示和管道的强元素。

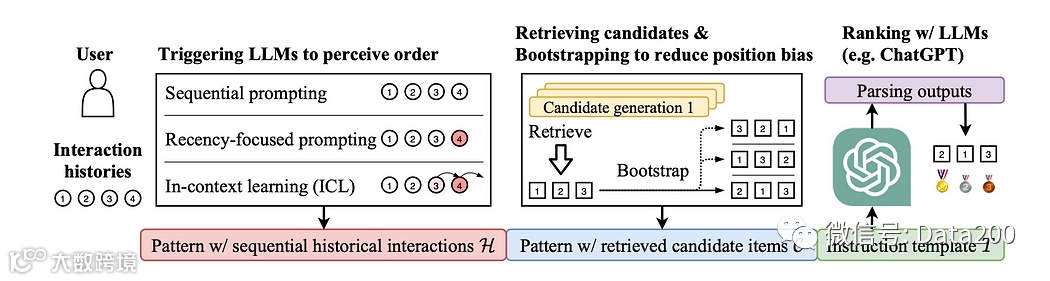

顺序提示

顺序提示考虑了用法学硕士建立有能力的推荐人的可能性。通常推荐系统是在管道架构中开发的,由多阶段候选生成(检索更多相关项目)和排名(将相关项目排名在更高位置)过程组成。

顺序提示侧重于推荐系统的排名阶段,因为 LLM 在大规模候选集上运行的成本更高。

排名表现对检索到的排名靠前的候选项目很敏感,更适合考察LLM推荐能力的细微差别。

自洽性

通过思维链推理,产生了一条思维路径,然后又遵循了该路径。相反,自洽利用了一种直觉,即一个复杂的推理问题通常允许多种不同的思维方式,从而得出其独特的正确答案。

自洽方法由三个步骤组成:

1.提示 LLM 生成思维链(CoT)推理部分。

2.生成一组不同的推理路径。

3.为最终答案选择最一致的输出。

自洽方法所遵循的方法可能会增加开销;特别是如果每个 CoT 的步骤都涉及调用外部工具和 API。开销将以完成往返的额外成本和时间的形式表现出来。

自动推理和工具使用(ART)

思维链(CoT)提示从 LLM 中引出复杂和顺序的推理。对于每个步骤,都可以使用外部工具来改进特定节点生成的输出。

开发这些方法的前提是利用冻结的大型语言模型(LLM)。因此,扩充了先前训练的带有时间戳的模型。

自动推理和工具使用(ART)是一个框架,它还利用冻结模型作为程序生成中间推理步骤。

ART的方法提醒了Agents的原则,即分解问题,并为每个分解步骤使用工具。

借助 ART,冻结的 LLM 会在适当的时候使用外部工具将新任务的实例分解为多个步骤。

ART 是一种无需微调的方法,可自动进行多步骤推理以及自动选择和使用工具。

Generated 知识

生成知识的原理是,知识可以在推理时进行整合。这表明可以使用参考知识来代替模型微调。

测试在多个数据集、常识推理等方面进行。生成知识的原理得到了 RAG、pipelines 等开发的支持。

生成知识是一种新的技术,它允许将知识集成到大型语言模型(LLM)中,而无需对模型进行微调。

这可以通过在推理时向 LLM 提供参考知识来实现。

研究表明,生成知识可以提高 LLM 在各种任务中的性能,包括常识推理、问答和文本生成。

生成知识的实现方法包括 RAG(Retrieval-Augmented Generation)和 pipelines。

RAG(Retrieval-Augmented Generation) 是一种将检索和生成结合起来的技术,可以提高 LLM 在各种任务中的性能。

pipelines 是指将多个模型或组件串联起来以完成更复杂的任务的技术。

生成知识的优势:

提高性能: 生成知识可以提高 LLM 在各种任务中的性能。

减少微调: 生成知识可以减少对模型微调的需求,从而节省时间和成本。

提高灵活性: 生成知识可以提高 LLM 的灵活性,使其能够适应新任务和新领域。

更多详情,搜公众号:Data200

本文原创,转载请扫上方二维码联系作者。