Potplayer 搭 Ollama:本地实时字幕生成的「黄金搭档」玩法

经常用 Potplayer 看片的朋友肯定懂那种痛 —— 遇到生肉资源没字幕,或者字幕和剧情对不上,反复拖动进度条找同步的功夫都够分心的。但自从发现它能和 Ollama 搭伙搞本地实时字幕,我直接把这对组合焊死在播放器里了,全程离线不碰云服务,隐私和体验都拉满。

老规矩,先分享好软件

内含 Potplaye+PotPlayer_ollama_Translate插件

夸克链接:https://pan.quark.cn/s/b8099ac52acd

百度链接: https://pan.baidu.com/s/1Vo8r3d2hBHfn_XM1ymP6kQ?pwd=dqrn

先搞懂:俩工具是怎么「分工干活」的

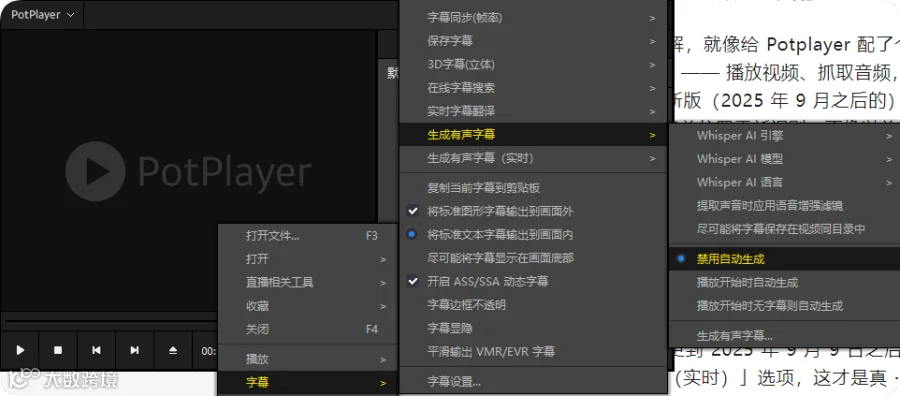

其实原理特好理解,就像给 Potplayer 配了个专属 AI 助手:Potplayer 负责「前端干活」—— 播放视频、抓取音频,还得把最终生成的字幕精准怼到画面上,最新版(2025 年 9 月之后的)还加了真・实时功能,拖进度条也能立刻从当前位置重新识别,不像以前得从头慢吞吞转写。Ollama 则是「幕后大脑」—— 本地跑着语音识别和翻译模型,Potplayer 抓来的音频流会传给它,它转成文字再翻成中文(或其他语言),完事儿再把结果扔回播放器显示,整个流程都在你电脑里打转,连网都不用开。

手把手带你搭:从安装到能用就三步

第一步:给 Potplayer 更到「能实时」的版本

老版本的「生成有声字幕」其实是伪实时,得从头慢悠悠转写,拖进度条就乱套。一定要更到 2025 年 9 月 9 日之后的版本,右键菜单里会多出「生成有声字幕(实时)」选项。

这才是真・随拖随更的核心功能。如果显卡支持 Vulkan API(可以下个小工具检测),后续选引擎时优先挑「whisper.cpp Vulkan」,识别速度能快一截。

Whisper是由OpenAI开发的开源自动语音识别(ASR)系统,2022年正式推出,截至2025年已发展为具备多语言、多方言支持的综合语音理解解决方案,标准英文场景下识别准确率达98.7%,支持100多种语言。Whisper采用Transformer架构的编码器-解码器结构,包含音频预处理模块、多语言模型头,2025年新增说话人分离功能,能区分多人对话中的不同说话人并标注标签,是目前最好的语音生成文本工具之一。

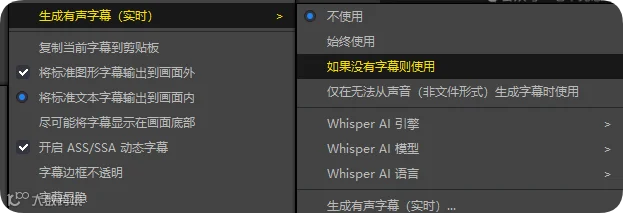

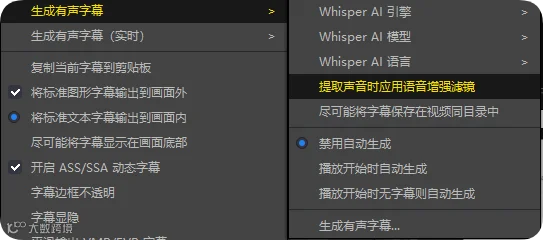

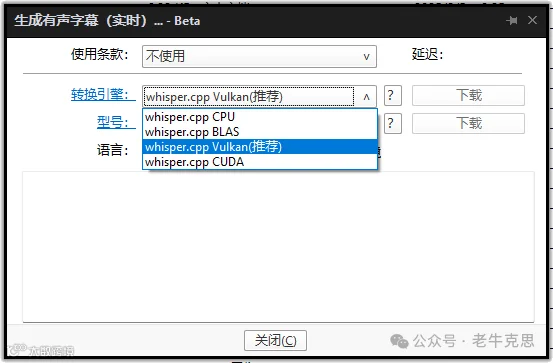

右键点击PotPlayer,弹出菜单项,选择“字幕→生成有声字幕(实时)→生成有声字幕(实时)”。

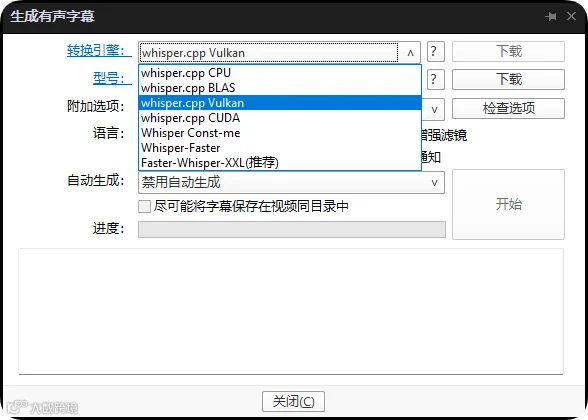

弹出“生成有声字幕”对话框,在这里对语音转换引擎、模型和语音等参数进行设置。

点击“转换引擎”下拉框,可以看到有4款版本可选。N卡选CUDA,A卡选Vukan,没有显卡选CPU。

非实时工作模式中还有Whisper-Faster、Whisper-Faster-XXL适合更高配置的电脑,

目前,实时字幕生成功能并不支持Faster-Whisper-XXL、Whisper-Faster等「转录速度更快」的引擎。

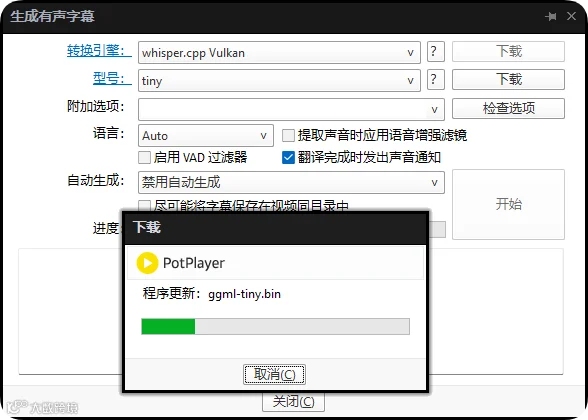

我的主机是MI50显卡,所以我选的Vukan。当我们选择了一个转换引擎以后,右边的“下载”按钮会根据该引擎是否已经下载到本地自动有效或变灰。然后点击“下载”,系统会自动下载引擎到本地。从上到下,也就是从tiny到lager,模型越大,翻译效果越好。新手推荐whisper-small,亲测 2-3 秒延迟刚好能用,识别准确率也在线;要是电脑配置一般,whisper-tiny

large-v3虽然准但延迟能到 20 秒,实在不适合实时场景

“语言”这里直接用”Auto”就可以了,让系统自行判断话音的语言国别。

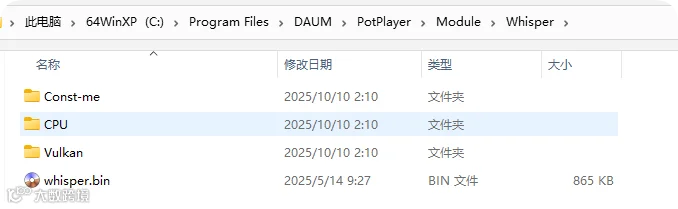

在缺省情况下,转换引擎存放在

“C:\Program Files\DAUM\PotPlayer\Module\Whisper”目录中。

模型存文件夹在

C:\Users\YourName\AppData\Roaming\PotPlayerMini64\Model

可以明显看到最小和最大差距有2倍

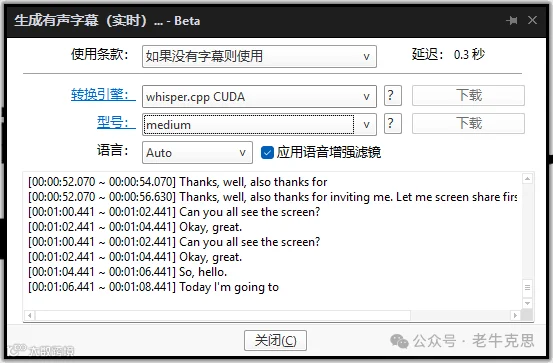

很快,在屏幕中实时显示了当前字幕。

同时,在对话框中同步显示了时间轴和相应的字幕。

第二步:给 Ollama 安个家,选对「AI 大脑」

Ollama 这工具特轻量,但默认装 C 盘,咱可以改路径:下载安装包后,在文件路径栏敲 CMD,输一句OllamaSetup.exe /DIR=你想放的文件夹,比如E:\MySoftware\Ollama,这样就不用心疼 C 盘空间了。

安装教程可以查看下历史Windows极速部署DeepSeek R1(Ollama保姆级教程)

接下来得给它装「干活的模型」:

- 翻译靠 Qwen3 更适配

:试了好几个模型,还是 Qwen3 最顺手,指令理解准还不挑格式。核显电脑装 1.7B 版本凑合用,独显直接上 8B,翻译出来的台词比内置的 Bing、DeepL 自然多了,连俚语都能翻明白。装模型特简单,Ollama 官网复制命令,比如ollama run qwen3:1.7b,ollama run qwen3:8b,粘贴到 CMD 里回车就行,等着它下载完自动就绪。 -

第三步:插个「翻译插件」,让俩工具通上话

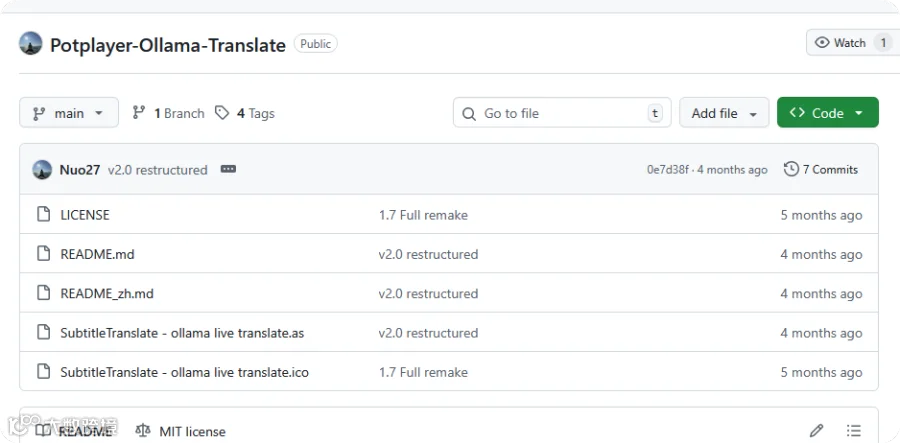

得给 Potplayer 装个桥接插件,直接去 GitHub 下PotPlayer_ollama_Translate项目(访问困难的话在本文顶部有提供网盘下载)。

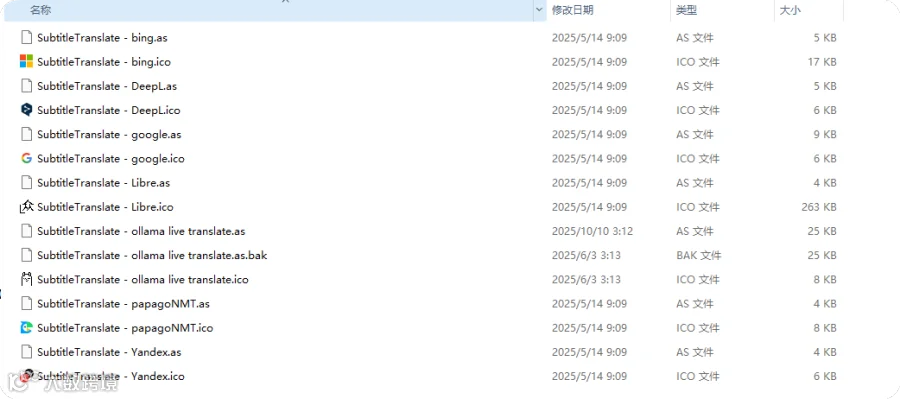

把解压出来的.as和.ico文件扔到 Potplayer 安装目录(默认C:\Program Files\DAUM\PotPlayer)的Extention\Subtitle\Translate文件夹里。

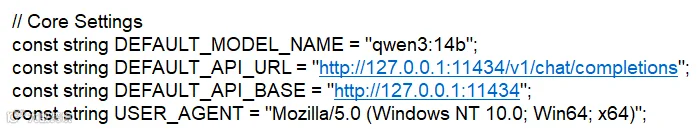

然后改个小配置:右键.as文件用记事本打开,把默认的模型名换成你刚装的(比如qwen3:1.7b),Ctrl+H 一键替换超方便。

最后在 Potplayer 里右键「字幕→实时字幕翻译设置」,选中 Ollama 插件就大功告成了。切记!Ollama 得一直后台开着,不然翻译功能会罢工,不过它占的资源真不多,日常挂着完全不卡。

实际用起来:这些细节得注意

- 性能平衡是关键

:我的电脑用 whisper-small+qwen3:8b,播放 1080P 视频完全不卡;要是你电脑配置实在一般,把模型换成更小的,虽然偶尔漏词,但总比没字幕强。 - 离线真的香

:出差住酒店没网,或者看一些敏感资源,全程本地处理,既不用等云服务加载,也不怕隐私泄露,这才是本地 AI 的精髓。 - 目前还有小遗憾

只支持本地视频,在线流媒体暂时用不了。 -

总的来说,这对组合把「看片自由」拉到了新高度 —— 不用求字幕组,不用等云翻译,自己电脑里的 AI 分分钟搞定。要是你也常跟无字幕资源打交道,真的可以试试,配置好一次能爽好久~