腾讯微视上线黄金圣斗士特效,背后技术全解析[k]

通过手机摄像头即可实现全身3D换装,微视团队揭秘人体Mesh重建与实时渲染技术[k]

童年经典动画《圣斗士星矢》中的黄金圣斗士再次点燃情怀。如今,用户只需打开腾讯微视App,即可通过特效变身十二黄金圣斗士之一,亲身体验“燃烧小宇宙”的热血瞬间。[k]

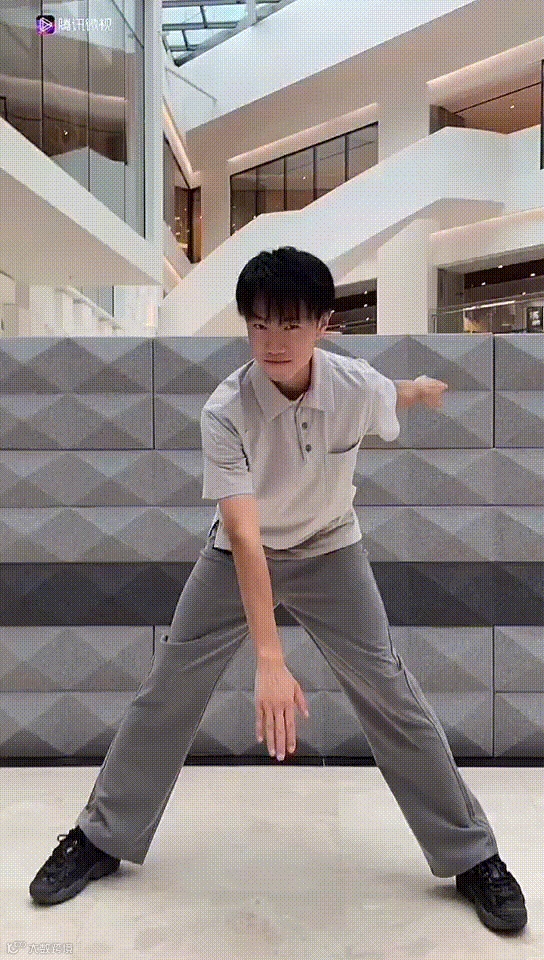

该特效名为“全身换装圣斗士”,用户在拍摄页面选择对应特效,并上传一张无遮挡正面照,即可完成黄金铠甲的虚拟穿戴。此外,通过摄像头实时捕捉动作,还可触发多个星座圣斗士的专属姿态,包括射手座、双子座撒加、处女座沙加、白羊座穆和天秤座童虎等。[k]

这一特效不仅支持静态图像,更可在动态视频中实现高精度贴合的全身铠甲渲染。其核心技术依赖于手机端实时人体3D Mesh重建,突破了姿态形变、体型差异、特征点不稳定等多重技术难题。[k]

运动捕捉与3D人体数据构建[k]

为实现精准换装,腾讯微视技术团队搭建了一套低成本高效率的动作捕捉系统,采用3台AzureKinect传感器与一台Windows电脑,通过标定算法在1分钟内完成多视角相机的空间对齐。[k]

系统采集RGBD数据、深度Mask及3D关键点,生成高质量3D点云,并通过Fitting优化算法重建人体Mesh,将重建误差控制在20mm以内。团队共采集上万段贴近真实使用场景的视频数据,覆盖日常动作与高难度姿态,构建出数十万帧训练样本。[k]

3D人体Mesh重建技术路径[k]

微视团队采用基于深度学习的model-free方案,直接从单帧图像回归人体Mesh的密集3D坐标,结合图神经网络建模关节点拓扑结构,提升重建稳定性。最终模型包含7000多个顶点与1.5万个面片,重建后的Mesh经过滤波处理消除抖动,确保视频序列中的平滑表现。[k]

移动端性能优化与渲染实现[k]

为实现在中高端手机上接近90 FPS的处理速度,微视团队从三方面进行优化:一是设计轻量化网络Backbone,结合HRNet与MobileNet优势;二是将原串行算法流程改为并行处理,提升整体效率;三是基于腾讯优图TNN框架进行底层算子优化,并引入NEON加速技术降低计算耗时,最终将单帧处理时间从15ms优化至11ms。[k]

在渲染层面,团队开发了AttachToBody方案,确保铠甲精准贴合人体表面,并支持PBR(基于物理的渲染)所需光照与材质信息。针对低端机型,采用Material Capture技术以低开销模拟真实感效果。同时集成IBL、SSAO等高级光影技术,提升视觉品质。[k]

项目历时10个月,技术与设计团队紧密协作,借助Light Studio工具链实现对服装SRT参数、材质属性与环境光的可视化调整,确保最终效果高度还原设计预期。[k]

微视发布器技术突破:三维人体重建特效再升级

经过设计、算法与特效团队的多轮优化,微视在衣物贴合度、身体比例协调性及视觉效果等方面取得显著进展,实现了高精度的三维人体重建效果[k]。

实际引擎渲染效果如下图所示,整体表现已达到理想水平[k]。

未来,微视发布器技术团队将持续聚焦三维人体重建技术,在3D重建精度上深入优化,拓展更多拍摄场景的适配能力[k]。同时,团队将在人体形变、虚拟角色驱动等图形图像技术方向推进创新,为用户带来更丰富、更沉浸的创意特效体验[k]。