苹果的AI布局:为何不用英伟达显卡?

从Apple Intelligence到自研AI服务器,苹果的AI战略深度解析

苹果将在秋季推出AI PC和AI手机新功能,但其AI战略却与行业主流路径截然不同,尤其在硬件选择上未大量采购英伟达显卡,引发广泛关注[k]

2024年WWDC上,苹果正式发布Apple Intelligence,宣布在iOS、macOS等系统中全面引入生成式AI功能[k]。作为消费电子领域的标杆企业,苹果此举对行业具有深远影响[k]。尽管其AI布局起步时间晚于部分竞争对手,但在芯片与中间件层面已有长期积累,例如早在2022年其芯片便已支持通过Core ML运行Stable Diffusion[k]。

然而,据SemiAnalysis追踪数据显示,苹果在数据中心级英伟达GPU的采购量几乎可以忽略,未进入行业前十,这与万亿市值科技巨头的身份形成鲜明反差[k]。

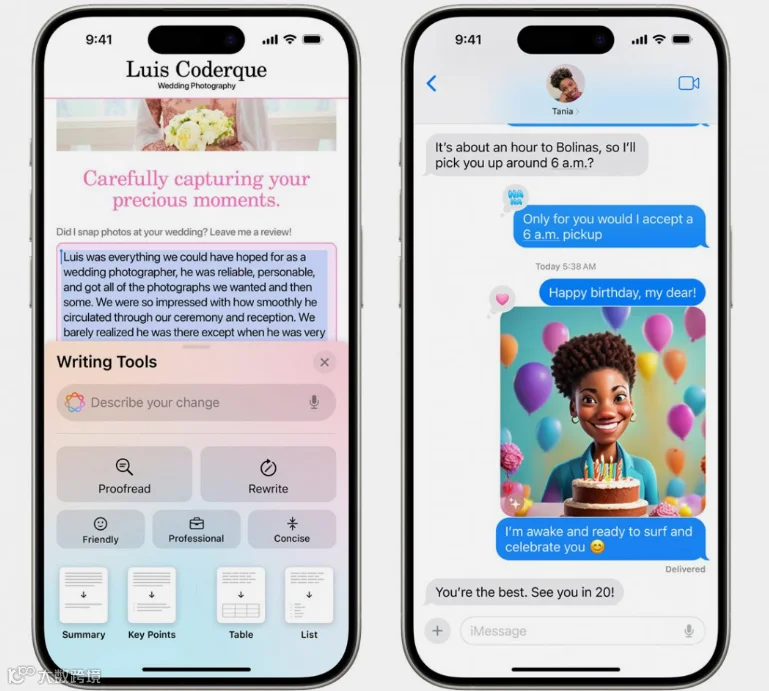

Apple Intelligence的功能与生态整合

Apple Intelligence涵盖语音转文字、AI照片编辑、Spotlight智能搜索等基础功能,并在生成式AI方面提供邮件摘要与撰写建议、通知内容总结、通话记录转写、自然语言驱动的图文搜索以及增强版Siri[k]。Siri可理解屏幕内容,结合用户上下文与使用习惯,实现更智能的响应[k]。

得益于全栈生态系统控制权,Apple Intelligence实现了跨应用协同操作,例如识别相册中的好友照片并生成生日贺卡直接发送,或调用驾照照片自动填写表单信息[k]。系统还能基于邮件中的航班信息提醒出行计划,或根据备忘录内容提示用餐安排,展现“行为智能”[k]。

自建AI服务器:M2 Ultra的可能角色

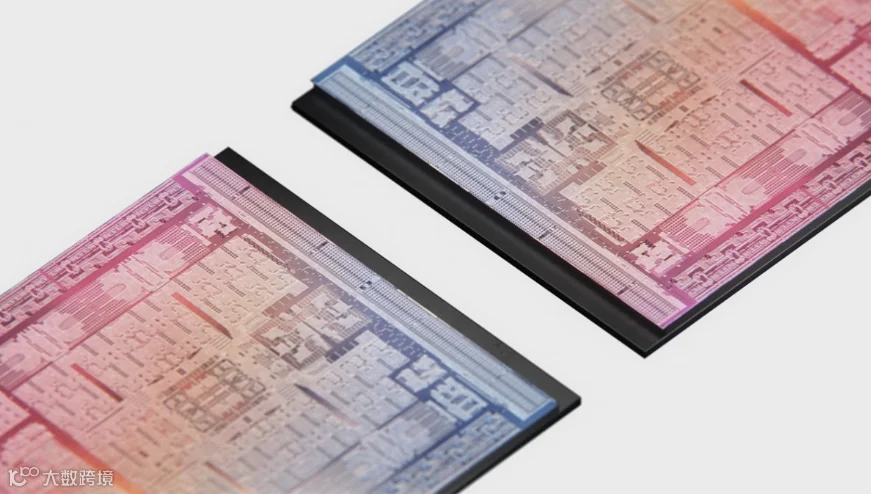

据5月MacRumors报道,苹果正利用M2 Ultra芯片构建AI服务器,富士康已开始组装相关设备,未来还将基于M4系列芯片推进[k]。6月WWDC上,苹果确认正在建设自有数据中心栈,采用私有云计算(Private Cloud Compute)架构,强调将Apple Silicon的安全性与性能延伸至云端[k]。

M2 Ultra具备1340亿晶体管和800GB/s内存带宽,采用台积电InFO-LSI 2.5D封装技术,虽非专为AI设计,但其高带宽与大规模集成特性使其具备数据中心应用潜力[k]。有消息称苹果数据中心已进行双倍扩容,预计明年将形成更大规模集群[k]。

为何不采用英伟达显卡?

尽管M2 Ultra在PC领域表现优异,但在专业AI数据中心面前仍显不足[k]。英伟达H200显存带宽高达4.8TB/s,FP16算力达1979 TFLOPS,远超M2 Ultra的800GB/s带宽与27.2 TFLOPS FP32算力[k]。此外,M2 Ultra缺乏高效芯片互联机制,难以支持大规模模型训练所需的跨节点协同[k]。

历史因素或也影响决策,苹果与英伟达过往存在商业纠纷[k]。更重要的是,苹果在AI训练环节已选择与谷歌合作——其发布的《Apple Intelligence Foundation Language Model》论文显示,AFM模型训练依托谷歌TPU v4与v5完成:服务器端模型使用8192颗TPU v4,端侧30亿参数模型使用2048颗TPU v5[k]。

端云协同与安全架构

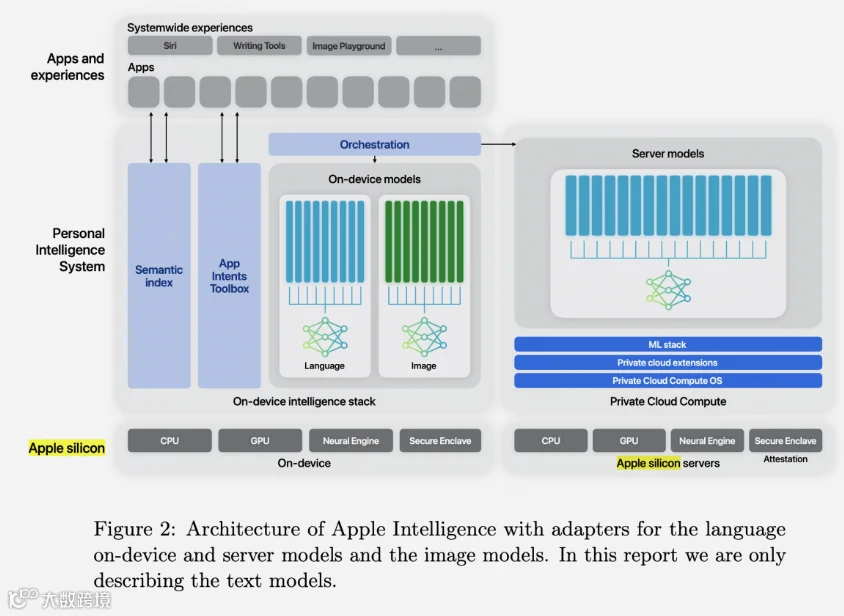

Apple Intelligence采用“端云协同”模式,训练在谷歌TPU上完成,推理则分布于用户设备与苹果自研的Private Cloud Compute服务器[k]。该云环境基于iOS/macOS子集打造,配备Secure Enclave、Secure Boot等硬件级安全机制,操作系统经加固以最小化攻击面[k]。

数据中心运维人员无法访问用户数据,确保隐私保护[k]。这种全栈自研环境有利于实现生态内AI功能的无缝协同,符合苹果一贯的垂直整合策略[k]。

未来展望与挑战

M2 Ultra用于AI服务器可能是短期过渡方案,长期来看苹果或需开发专用AI芯片以应对高性能计算需求[k]。此外,如何在中国市场推出本地化AI服务、协调第三方开发者生态、平衡控制权与合作机制,以及应对全球海量用户带来的基础设施压力,均是苹果必须面对的重大挑战[k]。