Apache Flink 作为实时计算的事实标准,应用广泛。但熟悉 Flink SQL 的开发者常面临一个痛点:每个作业都要重复手动定义源表和目标表:

手写 1 张源表 + 1 张目标表,没什么。那 100 张呢?200 张呢?500 张物理表呢?

——意味着你要重复敲几百次几乎一样的 CREATE TABLE,几百次配置连接器、对齐字段类型、调格式……

这不是在开发,这是在当“表结构打字员”。

所有 Flink SQL 开发者都懂这个痛:明明只想写业务逻辑,却被建表语句拖住手脚;作业一多,元数据就乱;作业一停,Schema 就丢。

根源很简单:Flink 默认的 Catalog 是基于内存实现的,作业之间天然隔离,根本没有“数仓”该有的统一元数据管理。

但如果我告诉你:有一个平台,能自动同步 MySQL 表结构,鼠标点一下,JDBC 表就秒变 Flink 表,零 DDL ——

你愿意试试吗?

它叫 Awestream。今天我们直接上手操作,从 MySQL 到 Flink 表,5 分钟跑通全流程,带你感受一下什么叫 “元数据管理,快到飞起”。

温馨提示:Awestream 支持接入的数据源包括但不限于 mysql、postgres、sqlserver、oracle、db2、derby、oceanbase、trino ......

Awestream 提供便捷高效的一键源表转 Flink 表功能,支持自动解析数据库表结构并生成标准化 Flink 表,无需手动编写 DDL,无需配置连接器参数,显著简化实时作业的前期建模流程,全面提升开发效率与数据一致性。本文将以 MySQL 为例,演示如何通过 Awestream 将数据库中的多张表一键导入为可直接使用的 Flink 表。

1.1 准备源数据库表

首先,我们需要在 MySQL 的 「test」 数据库中准备几张测试表,作为本次一键导入 Flink 表功能演示的源表数据,具体建表语句如下:

-- 用户表

CREATETABLEusers (

id BIGINTPRIMARY KEY AUTO_INCREMENT,

username VARCHAR(50) NOTNULL,

email VARCHAR(100),

age INT,

created_at

DATETIME DEFAULTCURRENT_TIMESTAMP

);

-- 订单表

CREATETABLE orders (

id BIGINTPRIMARY KEY AUTO_INCREMENT,

user_id BIGINTNOTNULL,

order_number VARCHAR(50) NOTNULL,

total_amount DECIMAL(10,2),

statusVARCHAR(20),

created_at DATETIME DEFAULTCURRENT_TIMESTAMP

);

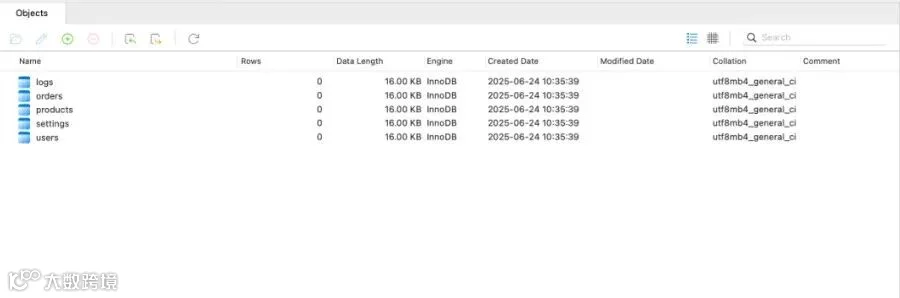

表创建完成后,可以通过 Navicat 或其他数据库客户端工具,连接到 「test」 数据库,查看刚刚创建的表结构,确认表已正确建好,便于后续一键同步操作。

1.2 Awestream 一键同步表结构

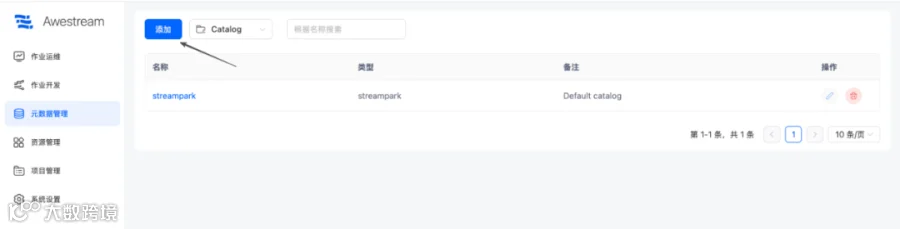

在 Awestream 平台中,完成一键导入操作非常简单,首先进入「元数据管理」模块,点击 【添加】按钮:

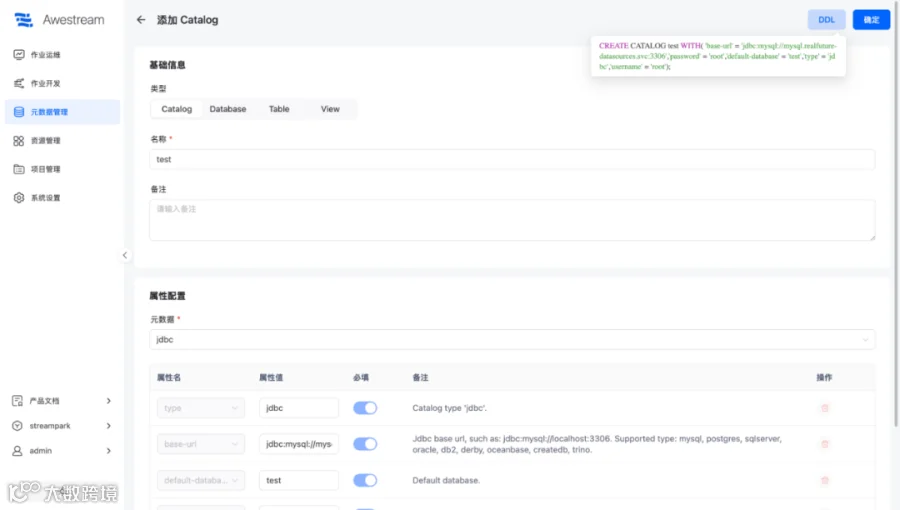

在弹出的配置页面中,选择类型为 Catalog,填写对应的名称、选择Catalog类型,后面会引导输入相关的必填属性,输入完成后点击【确定】(备注:点击 【DDL】按钮可以查看 Catalog 最终生成的创建语句)。

1.3 Flink 表详情查看与验证

配置保存成功后,返回元数据管理界面,将视图切换为【Table】类型,即可自动看到 「test」 数据库中的所有表结构,Awestream 平台已自动完成表结构解析与接入。

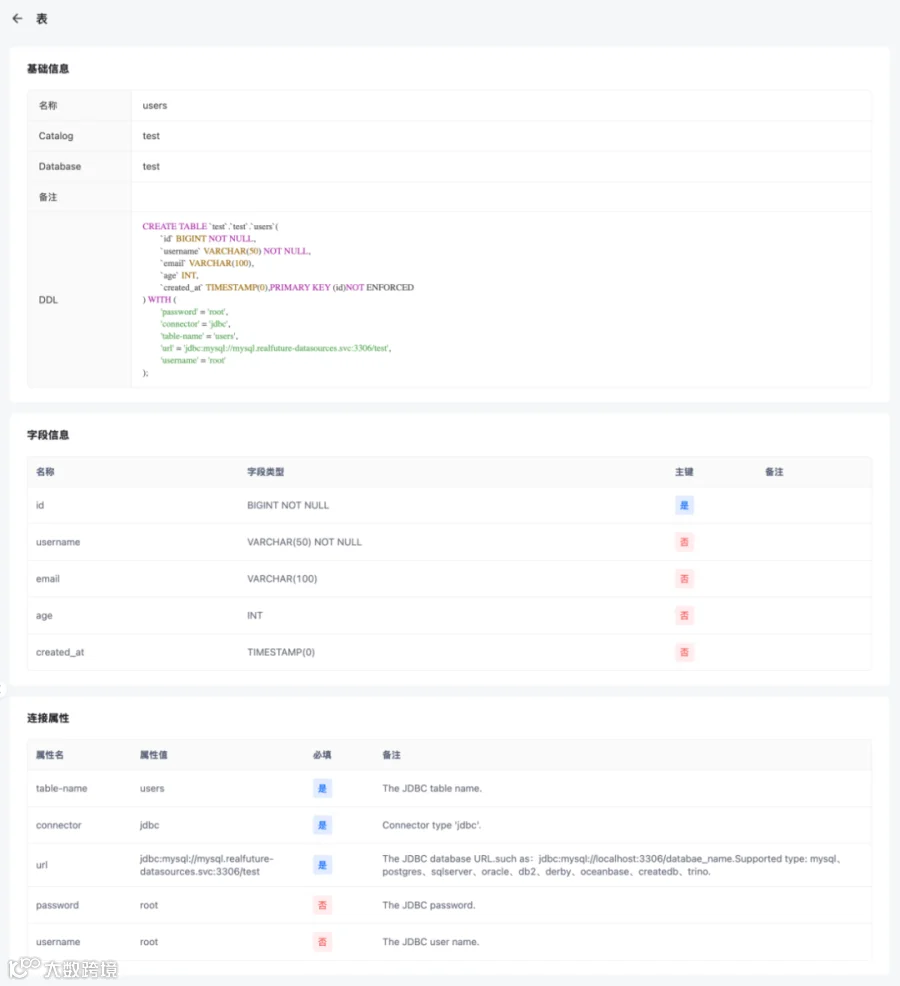

点击任意一张表(如:users表),即可查看系统自动生成的 Flink 表定义,包含字段映射、主键标识、连接器参数及完整 DDL 脚本,所有信息一目了然,无需手动配置。

不仅如此,在 Awestream 的作业开发页面中,开发者也可以直接点击表名,快速查看表结构、连接器参数及 DDL 配置,实时掌握表定义细节,辅助 SQL 编写与作业调试,全面提升开发效率。相关内容如下:

表连接器属性:

以及 DDL:

1.4 实践小结

接下来,让我们继续深入,全面解锁 Awestream 元数据管理的全套功能,体验一下从表结构管理、视图维护到实时 SQL 调试,如何做到既强大又好用。

2.1 可视化界面

点通过 Awestream 控制台,用户可以直观、统一地浏览和管理所有元数据对象,无论是数据库、表、视图,还是实时作业所需的元数据信息,都能一目了然。

-

📂 创建 / 修改 / 删除 Database(数据库) -

📋 创建 / 修改 / 删除 Table(数据表) -

🗂️ 创建 / 修改 / 删除 View(视图) -

🔍 快速查看元数据详情 -

⚡ 实时检索、定位元数据对象 -

🔧 其他常用管理操作……

2.2 SQL 控制台

除了可视化界面,Awestream 还提供了完整的 SQL 控制台,开发者可以通过标准 SQL 指令,灵活管理元数据以及实时调试数据,满足复杂场景下的开发需求。

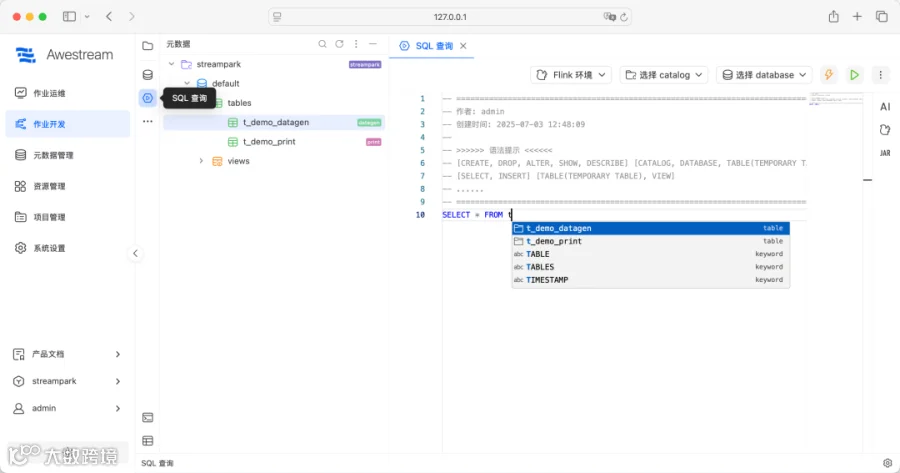

进入作业开发模块,依次点击 “导航面板” → “SQL 查询”:

如上图所示,点击 【SQL 查询】 按钮后,操作区域上方会固定出现 “SQL 查询” 页签,中间是你编写 Flink SQL 的主要工作区域,控制台内置语法提示与范例注释,便于快速上手开发。

2.2.2 常用 SQL 操作场景

-

CREATE: 创建 Catalog、数据库、表、视图等元数据对象 -

DROP:删除已存在的 Catalog、数据库、表、视图 -

ALTER:修改已有元数据属性或结构定义 -

SHOW:列出当前可用的 Catalog、数据库、表、视图、函数等 -

DESCRIBE:查看指定表或视图的结构详情 -

SELECT :实时预览流式数据 -

INSERT :将实时计算结果同步至目标表 -

……

2.2.3 元数据树

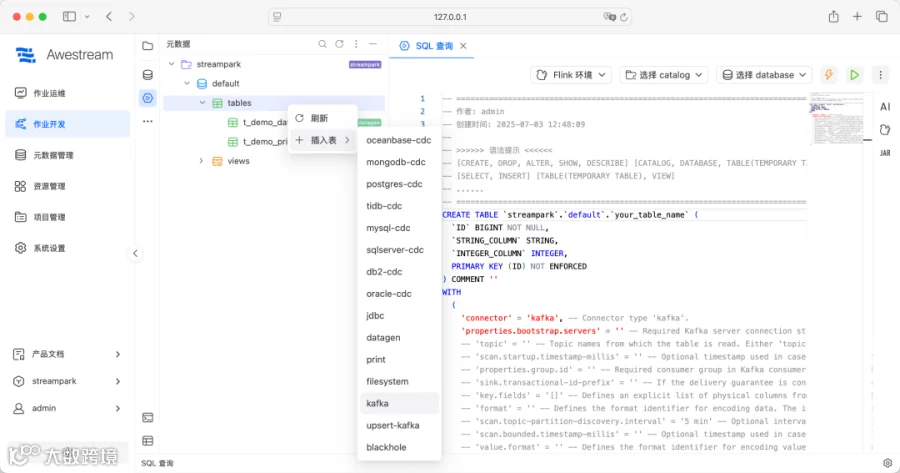

点为了进一步提升操作效率,Awestream 在元数据树节点上内置了右键快捷菜单,开发者无需手写 SQL。

-

📂 Catalog 节点:复制名称、插入 DDL -

🗂️ Database 节点:复制名称、插入 DDL -

📋 Tables 节点:刷新、插入表 -

📄 Table 节点:复制名称、插入 DDL、修改属性、删除表 -

👁️🗨️ Views 节点:刷新 -

📑 View 节点:复制名称、插入 DDL、删除视图

-

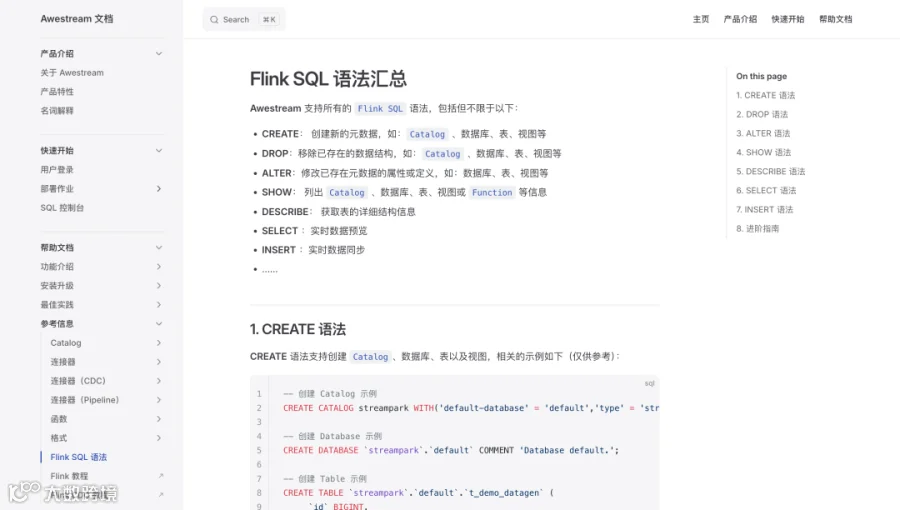

✅ Flink SQL 全量语法说明 -

✅ 各类连接器 DDL 示例 -

✅ 常用操作技巧与开发规范

-

✅ 多数据源接入一键转 Flink 表,零手动建表 -

✅ 全面可视化+SQL 双模式元数据管理,懂代码的爱用,不懂代码也能用 -

✅ 内置开发文档+可视化操作手册,降低学习门槛,提升开发效率 -

✅ 原生适配 Flink Catalog,统一元数据管理,保障数据一致性

当然,以上只是一部分能力。更多精彩,等你亲自探索。

🔗 官网:https://realfuture.cn

如果你正在搭建实时数仓、实时数据中台、实时指标体系或实时数据集成——Awestream 都值得你深入了解、上手体验。

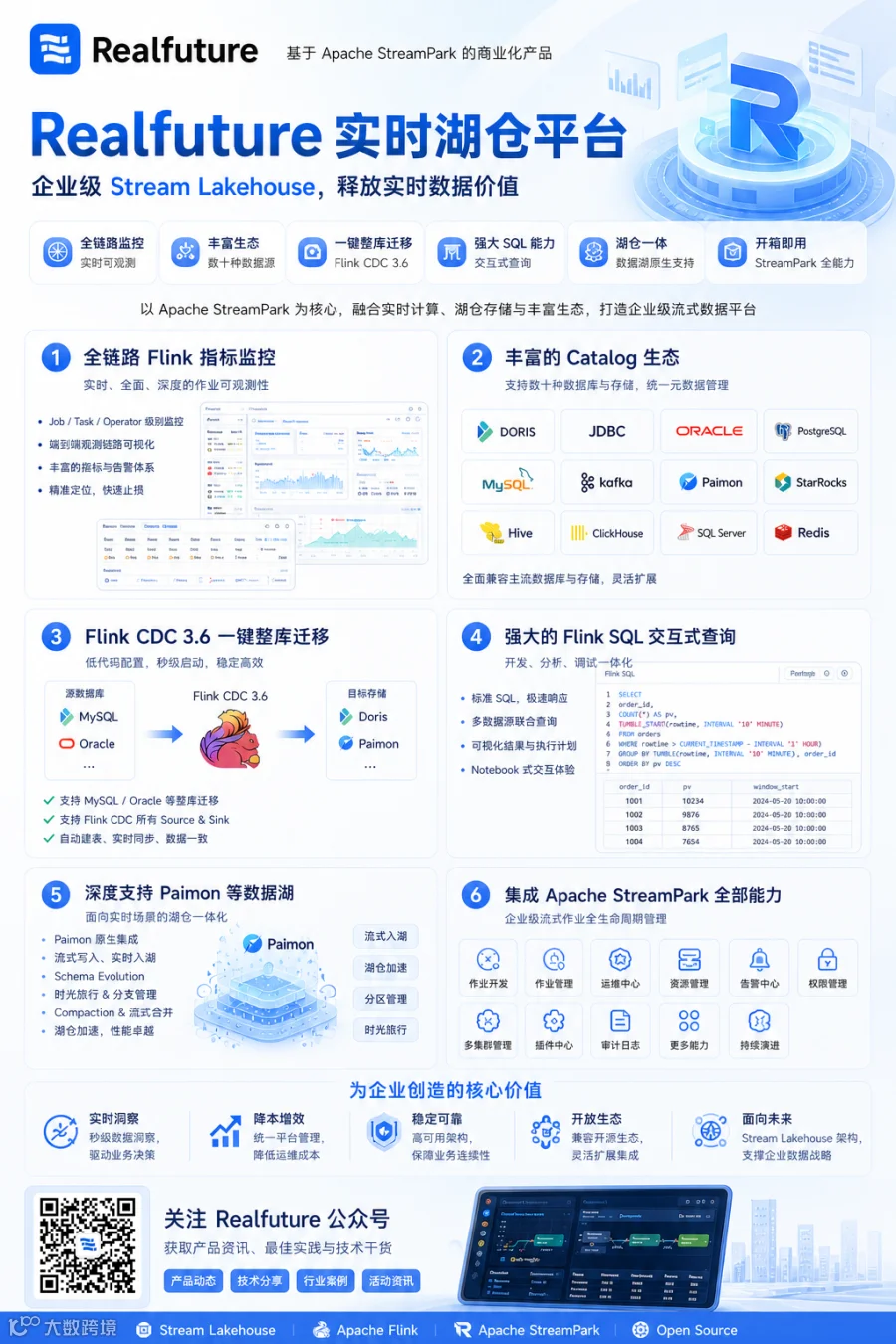

我们深知实时计算平台运维的复杂与痛点。作为 Apache StreamPark 项目的核心建设者,我们深耕 Flink 领域多年,持续服务并赋能了众多用户。这份深厚的经验与洞察,驱动我们打造了 Awestream 企业级实时湖仓平台。

它不仅是 StreamPark 的企业增强版,更是一套专为提升 Flink 作业开发运维效率、降低企业总拥有成本(TCO)而设计的全栈解决方案,定位是新一代实时湖仓平台。

选择 Awestream,是对专注与专业能力的信任,也是与我们一道,共同推动实时计算技术生态的成熟与繁荣。

现在开放免费 POC 和技术交流通道,欢迎立即体验,期待你的反馈。

(👉 欢迎在评论区交流使用体验,或提出你的问题!)