AI数据中心设计策略:

光纤连接驱动未来AI基础设施增长

AI 网络正以前所未有的速度演进,这主要得益于AI能力的指数级增长以及对算力需求激增。为应对这些需求,运营商正采用以下四大核心策略,构建具备强大性能、可扩展性且创新性的网络,以支持下一代AI应用:

互联 AI 数据中心,

实现更智能的运营

随着超大规模数据中心在电力、土地可用性以及数据中心内部物理空间方面面临多重限制,因此运营商正转向“远程AI数据中心”模式。这一趋势包括将AI工作负载分散至多个互联的园区中,构建能够跨越长距离连接多个数据中心地点的光纤网络。

对于大语言模型(LLMs)及其他AI系统而言,将计算、内存和电力分布到各个园区能够提升性能和效率。这种分布式方法需要低延迟、高带宽的光纤布线,以支撑AI对密集数据处理的严苛需求。长距离光纤网络正逐渐成为分布式AI基础设施的骨干,使网络能够在多个数据中心之间预训练和运行大规模AI模型,同时保持无缝连接。

为未来的可扩展性需求提前布局,

而非事后补救

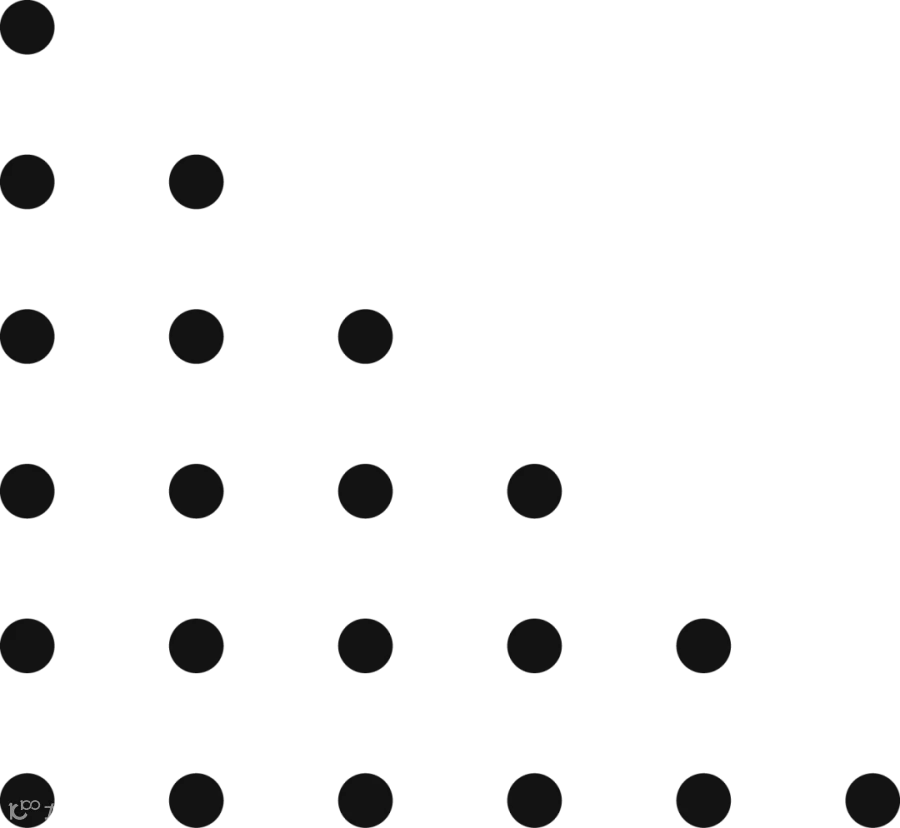

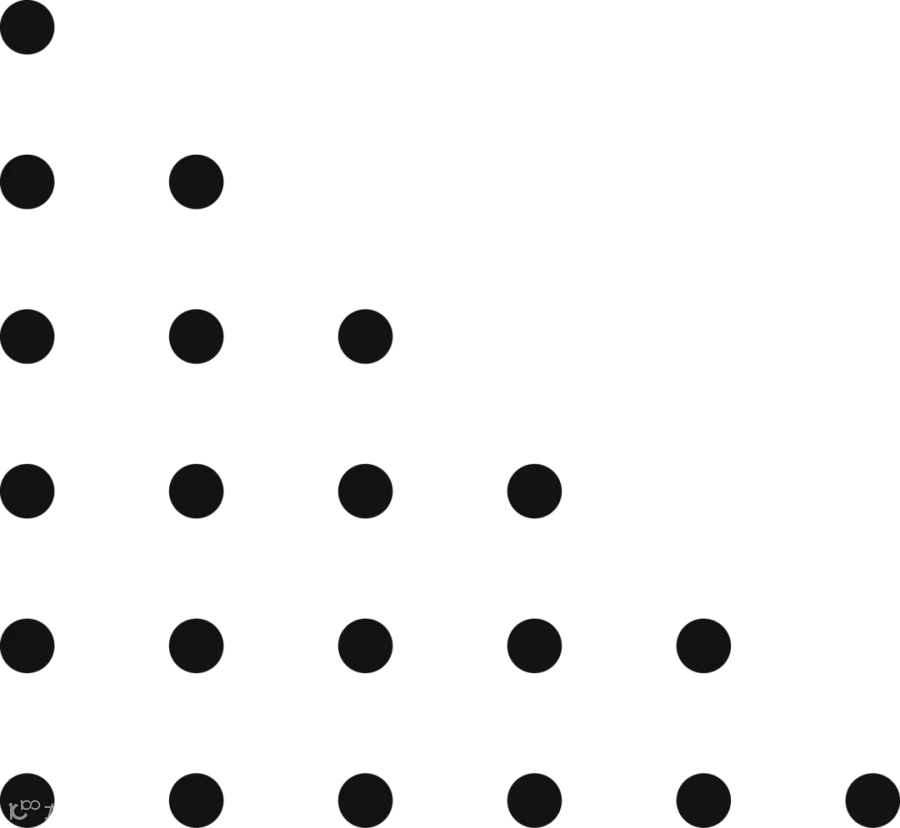

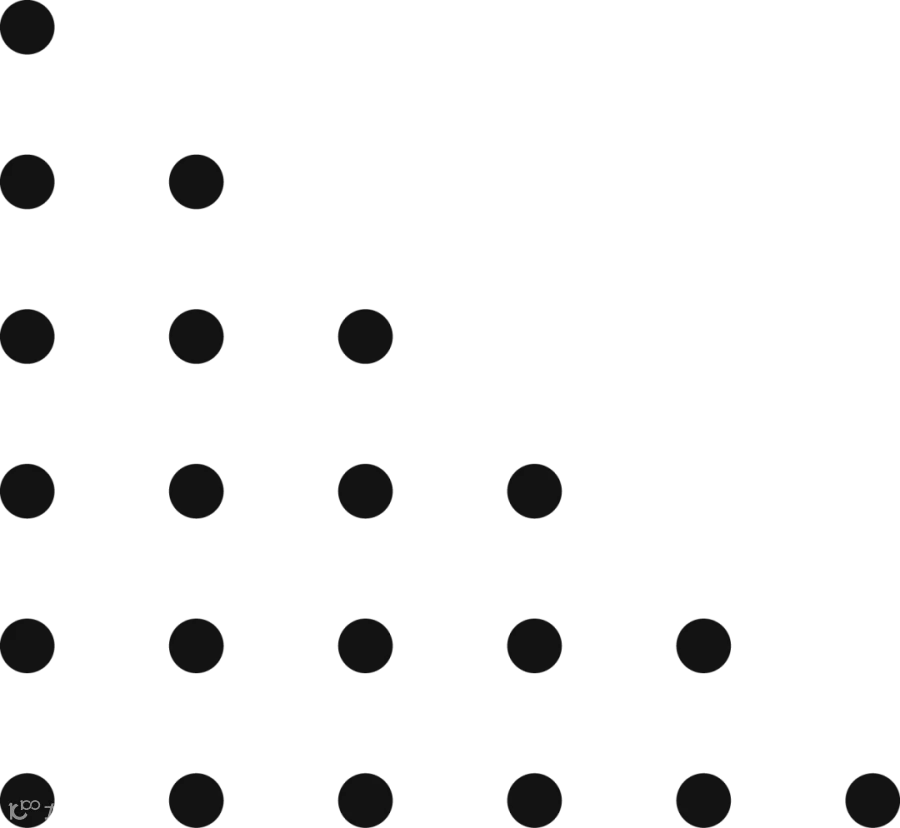

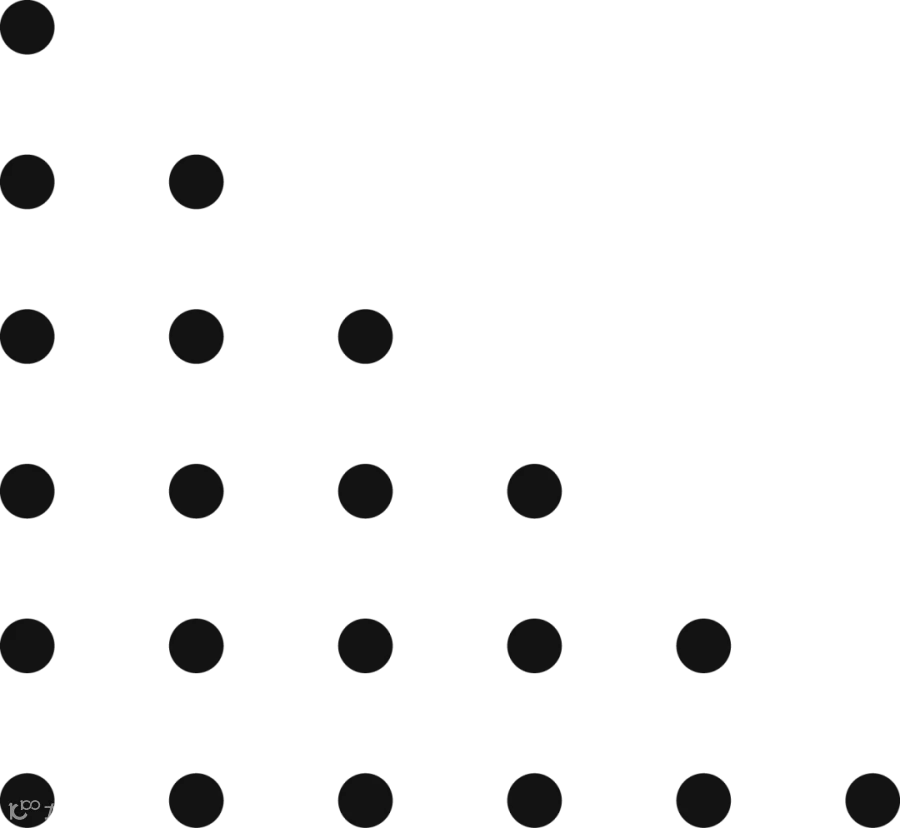

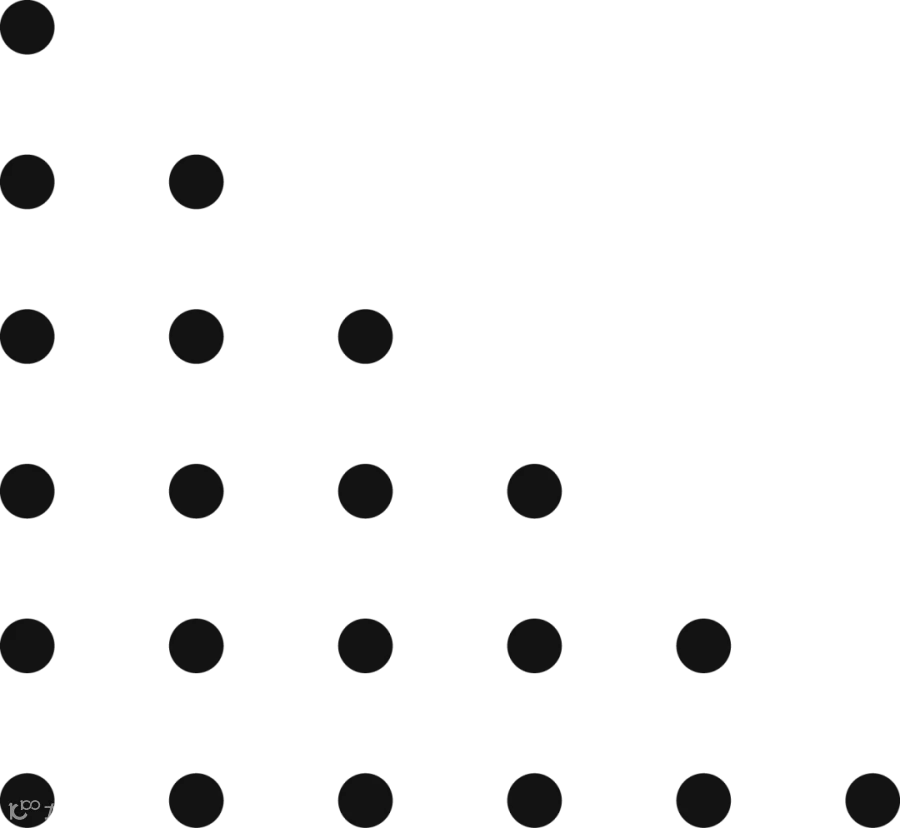

最成功的超大规模网络能够提前考虑未来的需求,而不是等到问题发生才做调整。可扩展性已成为数据中心建设中的决定性因素,尤其是在AI终端应用和工作负载日益复杂的背景下。现代AI模型需要更大规模、高带宽的GPU集群,并通过大规模光纤网络互联,以应对庞大的AI计算负载。这些集群不再局限于单台服务器或单个机架(即“纵向扩展”,scale-up),而是扩展至多个机架、多栋建筑,甚至多个园区——这种增长趋势被称为“横向扩展”(scale-out)。

这一演进需要更大型的交换机、多平面网络架构以及高密度布线架构,以实现GPU在可扩展单元内互联。随着AI节点扩展至更大网络,布线需求也成倍增加。生成式AI网络对光纤的需求量已是传统数据中心的10倍。过去,这类架构通常采用铜缆,但随着对更高带宽和更长距离连接(每米可达100Gbps)的需求不断增长,光纤已成为更经济且节省空间的选择。

通过光电共封装(CPO)技术

提升网络速度

光电共封装(Co-Packaged Optics, CPO)技术代表了网络设计领域的变革性创新,它将光器件与电子器件集成于同一封装中,从而提升处理速度和能效。通过将光学组件直接集成到交换机中,CPO省去了电信号在转换为光信号前长距离传输的步骤,有效降低了延迟并提升了性能。

采用CPO技术使运营商能够构建更大、更高效且具备更多端口的交换机,突破传统可插拔光模块的限制。这一转变对于应对AI工作负载所带来的巨大带宽需求至关重要,同时还能降低总体拥有成本(TCO)并提升可扩展性。随着下一代服务器正围绕CPO进行设计,该技术有望在超大规模网络跟上AI快速发展步伐中发挥核心作用。

创新光纤解决方案,

赋能 AI 未来发展

AI的爆发式增长正推动网络运营商大胆创新,以支撑网络基础设施的演进。从横向扩展GPU集群,到构建由长距离光纤互联的分布式园区,再到采用CPO技术,创新能力已成为在AI时代保持领先的关键。

康宁的GlassWorks™ AI解决方案组合的创新产品正处于这些技术进步的核心,为AI网络提供所需的带宽、低延迟与高能效。通过投资前沿光纤与连接技术,运营商能够构建足以支持日益复杂模型训练与推理的AI网络,同时降低运营成本。

AI 网络的未来路径已然清晰:运营商必须聚焦于基础设施的可扩展性、分布式部署与技术创新,以支撑下一代 AI 应用的发展。通过拥抱这四大关键趋势——可扩展性、分布式网络、CPO技术以及先进光纤解决方案——运营商能够“今日构建明日网络”,充分释放AI的全部潜能。

作者简介

关于作者Brian Rhoney

Brian Rhoney 在康宁公司拥有逾 24年经验,曾担任产品工程、系统工程及产品线管理等职务,现任数据中心市场发展总监,负责新产品创新工作。2005 年,Brian 被授予“Peter Bark 博士年度发明家”称号,并获得专业工程师执照。他拥有北卡罗来纳州立大学机械工程硕士学位,以及莱诺-莱恩大学(Lenoir-Rhyne University)工商管理硕士(MBA)学位。

如需了解更多信息,

敬请阅读原文

往期回顾