NVIDIA NVL72 GB200/GB300系统:

InfiniBand和以太网连接解决方案(四)

目录

2.6.2.连接2可扩展单元集群的布线

在图25中,用576台服务器、128个叶交换机、72个脊交换机和36个核心交换机连接一个2可扩展单元集群需要:

· 2304个节点到叶节点的MPO连接

· 2304个叶节点到脊节点的MPO连接

· 2304个脊节点到核心的MPO连接

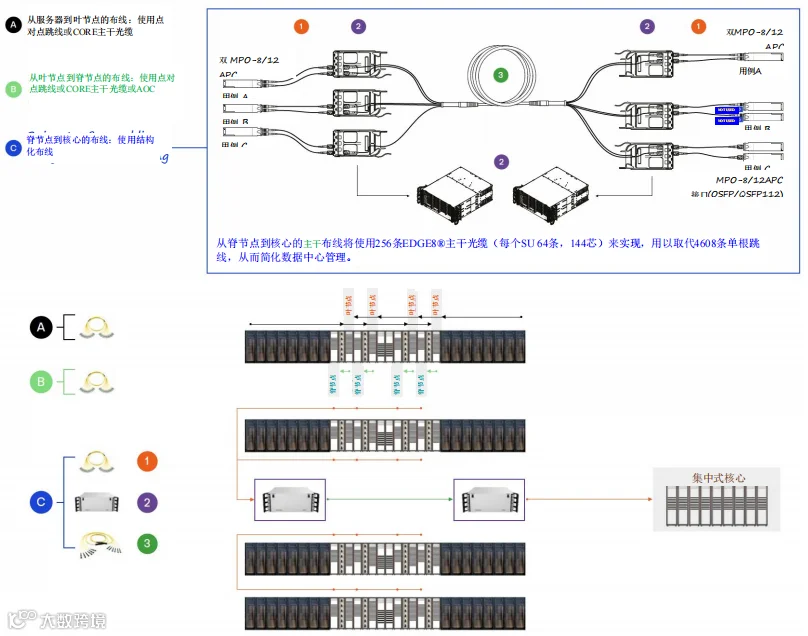

图25.连接2可扩展单元集群的布线

通过应用我们已探讨的不同布线层级,可以总结出以下配置:

· 数据中心运营商可以在可扩展单元中使用A级布线进行服务器到叶节点的布线,布线时可采用跳线或CORE主干光缆进行点对点布线连接。此方案下,每个可扩展单元需要2304条单根8芯跳线(长度可变),或者128条CORE主干光缆(每条144芯)(长度可变)。

· 在叶节点到脊节点的B级布线中,可以采用跳线或CORE主干光缆进行点对点布线。此方案下,每个可扩展单元需要2304条单根8芯跳线(长度可变)或128条CORE主干光缆(每条144芯)(长度可变)。

· 在脊节点到核心的C级布线中最好将结构化布线作为首选方法,特别是对于长距离(长达500米)的管理电缆。之所以建议采用这种方法,是因为核心交换机区域通常集中在数据中心内的不同区域或数据大厅。或者,也可以使用点对点布线;然而,在这种情况下,强烈建议使用CORE主干光缆(总共144条128芯CORE主干光缆,最长距离500米)来简化布线,尽量减少与单根跳线管理相关的复杂性。每种方法的具体细节如下:

·(1) 从脊交换机机架到配线面板的连接:

该连接可以通过以下方式实现:

- 144条128芯CORE主干光缆;或

- 2304条单根8芯跳线

·(2) 脊交换机机架上的配线面板:

需要带适配器面板的高密度EDGE8®4U配线架(见附件1)。共需8个配线架,每个脊交换机机架需一个。

·(3)主干布线:

EDGE8主干光缆将用作SU的脊交换机机架和集中式核心区域的核心交换机机架之间的主干布线。共需要128条EDGE8主干光缆(每条144芯),长度可达500米。

·(4) 核心交换机机架上的配线面板:

需要带适配器面板的高密度EDGE8®4U配线架(见附件1)。核心交换机机架区域共需要8个配线架。

·(5) 从配线面板到核心交换机机架的连接:

该连接可以通过以下方式实现:

- 144条128芯CORE主干光缆;或

- 2304条单根8芯跳线。

· C级总结:

- (1) 128芯CORE主干光缆数量:288条(从脊节点到配线面板需144条+从配线面板到核心交换机机架需144条);或

单根跳线的数量:4,608条 (从脊节点到配线面板需2304条+从配线面板到核心交换机机架需2304条).

- (2)带适配器面板的EDGE8®配线架的数量:16个(脊交换机机架需8个+核心交换机机架需8个)

- (3) 144芯EDGE8主干光缆的数量: 128 (用于主干布线).

在2可扩展单元集群中,每个叶交换机接收18个引自服务器的MPO连接,每个脊交换机接收从同一轨道内的各叶节点引出的两个MPO连接。因此,每个脊交换机共需32个MPO连接。然后,每个脊交换机再将8个MPO连接转发到核心交换机,如图26所示。

值得注意的是,每条轨道有9个脊交换机,这就是为什么有9组核心交换机的原因。连接的分布遵循以下逻辑:

· 核心组1接收所有轨道Spine-01交换机的所有连接。

· 核心组2接收所有轨道Spine-02交换机的所有连接,后续各核心组以此类推。

例如,每个Spine-01交换机(请参见图21中每个脊节点机架中的机架单元23)从每个轨道向核心组1中的Core-01交换机转发8个MPO连接。8乘以4(四个轨道)再乘以2(两个POD),可得出核心组1中的Core-01交换机总共有64个传入MPO连接。

2304 GPU集群使用9个核心组,每个核心组有4个交换机。在前面的图中,用9个核心机架,每个机架有4个核心交换机来表示。

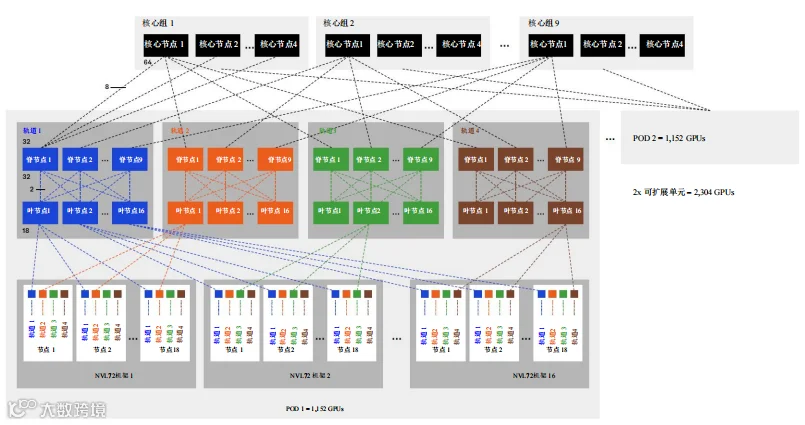

图26. 2可扩展单元集群计算网络

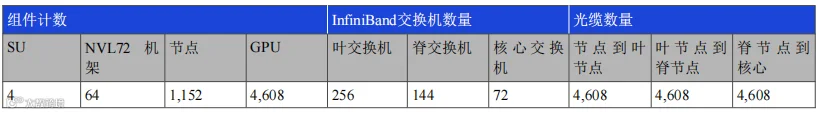

2.6.3.连接4可扩展单元集群的布线

在图27中,用1152台服务器、256个叶交换机、144个脊交换机和72个核心交换机连接一个4可扩展单元集群需要:

· 4608个节点到叶节点的MPO连接

· 4608个叶节点到脊节点的MPO连接

· 4608个脊节点到核心的MPO连接

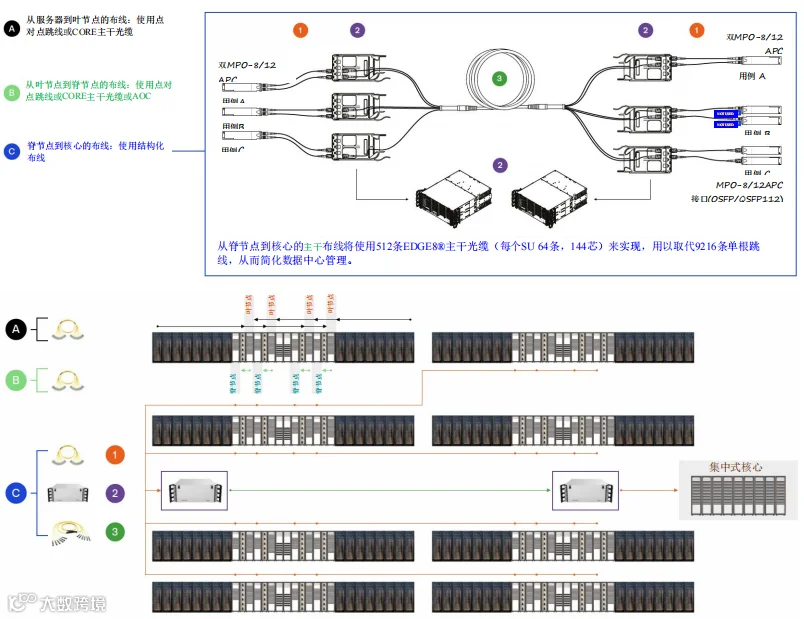

图27. 连接4可扩展单元集群的布线

通过应用我们已探讨的不同布线层级,可以总结出以下配置:

· 数据中心运营商可以在可扩展单元中使用A级布线进行服务器到叶节点的布线,布线时可采用跳线或CORE主干光缆进行点对点布线连接。此方案下,每个可扩展单元需要4608条单根8芯跳线(长度可变),或者256条CORE主干光缆(每条144芯)(长度可变)。

· 在叶节点到脊节点的B级布线中,可以采用跳线或CORE主干光缆进行点对点布线。此方案下,每个可扩展单元需要4608条单根8芯跳线(长度可变)或256条CORE主干光缆(每条144芯)(长度可变)。

· 在脊节点到核心的C级布线中最好将结构化布线作为首选方法,特别是对于长距离(长达500米)的管理电缆。之所以建议采用这种方法,是因为核心交换机区域通常集中在数据中心内的不同区域或数据大厅。或者,也可以使用点对点布线;然而,在这种情况下,强烈建议使用CORE主干光缆(总共288条128芯CORE主干光缆,最长距离500米)来简化布线,尽量减少与单根跳线管理相关的复杂性。每种方法的具体细节如下:

·(1) 从脊交换机机架到配线面板的连接:

该连接可以通过以下方式实现:

- 288条128芯CORE主干光缆;或

- 4608条单根8芯跳线

·(2) 脊交换机机架上的配线面板:

需要带适配器面板的高密度EDGE8®4U配线架(见附件1)。共需16个配线架,每个脊交换机机架需一个。

·(3)主干布线:

EDGE8主干光缆将用作SU的脊交换机机架和集中式核心区域的核心交换机机架之间的主干布线。共需要256条EDGE8主干光缆(每条144芯),长度可达500米。

·(4) 核心交换机机架上的配线面板:

需要带适配器面板的高密度EDGE8®4U配线架(见附件1)。核心交换机机架区域共需要16个配线架。

·(5) 从配线面板到核心交换机机架的连接:

该连接可以通过以下方式实现:

- 288条128芯CORE主干光缆;或

- 4608条单根8芯跳线。

· C级总结:

-(1) 128芯CORE主干光缆数量:576条(从脊节点到配线面板需288条+从配线面板到核心交换机机架需288条);或

单根跳线的数量:9216条 (从脊节点到配线面板需4608条+从配线面板到核心交换机机架需4608条).

-(2)带适配器面板的EDGE8®配线架的数量:32个(脊交换机机架需16个+核心交换机机架需16个)

-(3) 144芯EDGE8主干光缆的数量: 256 (用于主干布线).

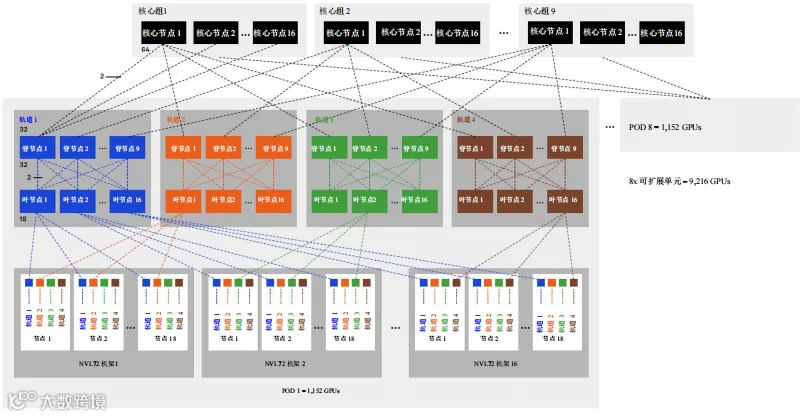

在4可扩展单元集群中,每个叶交换机接收18个引自服务器的MPO连接,每个脊交换机接收从同一轨道内的各叶节点引出的两个MPO连接。因此,每个脊交换机共需32个MPO连接。然后,每个脊交换机再将8个MPO连接转发到核心交换机,如图28所示。

因为每条轨道有9个脊交换机,所以有9组核心交换机。连接的分布遵循以下逻辑:

· 核心组1接收所有轨道Spine-01交换机的所有连接。

· 核心组2接收所有轨道Spine-02交换机的所有连接,后续各核心组以此类推。

例如,每个Spine-01交换机(请参见图21中每个脊节点机架中的机架单元23)从每个轨道向核心组1中的Core-01交换机转发4个MPO连接。4乘以4(四个轨道)再乘以4(四个POD),可得出核心组1中的Core-01交换机总共有64个传入MPO连接。

4608 GPU集群使用9个核心组,每个核心组有8个交换机。在前面的图中,用9个核心机架,每个机架有8个核心交换机来表示。

图28. 4可扩展单元集群计算网络

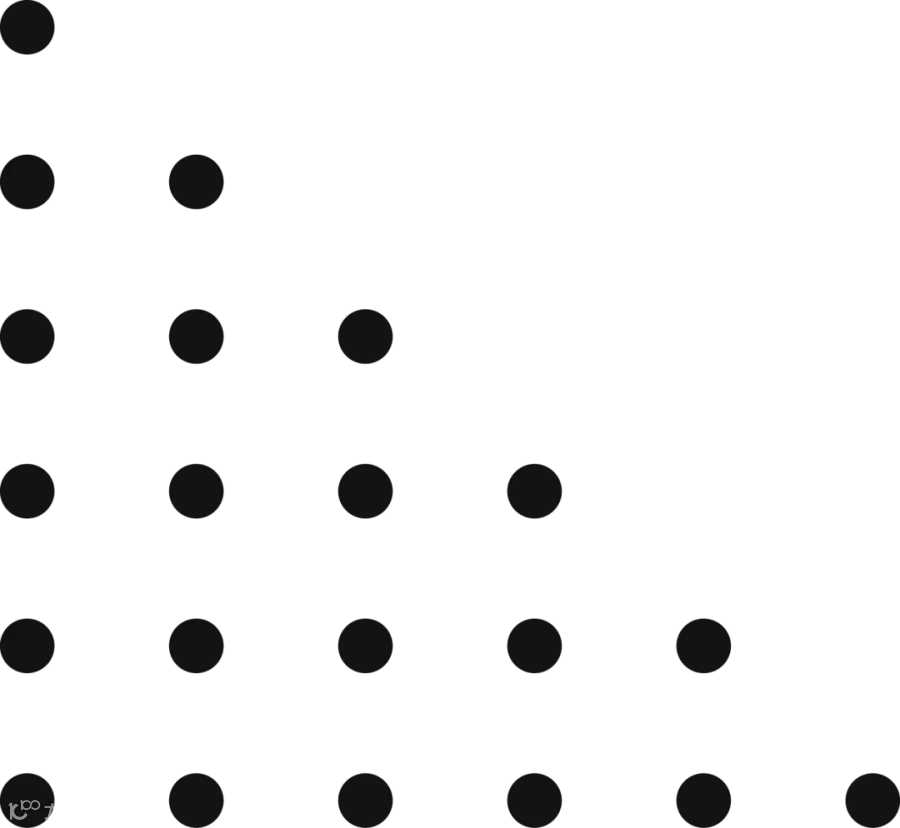

2.6.4.连接8可扩展单元集群的布线

在图29中,用2304台服务器、512个叶交换机、288个脊交换机和144个核心交换机连接一个8可扩展单元集群需要:

· 9216个节点到叶节点的MPO连接

· 9216个叶节点到脊节点的MPO连接

· 9216个脊节点到核心的MPO连接

图29. 连接8可扩展单元集群的布线

通过应用我们已探讨的不同布线层级,可以总结出以下配置:

· 数据中心运营商可以在可扩展单元中使用A级布线进行服务器到叶节点的布线,布线时可采用跳线或CORE主干光缆进行点对点布线连接。此方案下,每个可扩展单元需要9216条单根8芯跳线(长度可变),或者512条CORE主干光缆(每条144芯)(长度可变)。

· 在叶节点到脊节点的B级布线中,可以采用跳线或CORE主干光缆进行点对点布线。此方案下,每个可扩展单元需要9216条单根8芯跳线(长度可变)或512条CORE主干光缆(每条144芯)(长度可变)。

· 在脊节点到核心的C级布线中最好将结构化布线作为首选方法,特别是对于长距离(长达500米)的管理电缆。之所以建议采用这种方法,是因为核心交换机区域通常集中在数据中心内的不同区域或数据大厅。或者,也可以使用点对点布线;然而,在这种情况下,强烈建议使用CORE主干光缆(总共576条128芯CORE主干光缆,最长距离500米)来简化布线,尽量减少与单根跳线管理相关的复杂性。每种方法的具体细节如下:

·(1) 从脊交换机机架到配线面板的连接:

该连接可以通过以下方式实现:

- 576条128芯CORE主干光缆;或

- 9216条单根8芯跳线

·(2) 脊交换机机架上的配线面板:

需要带适配器面板的高密度EDGE8®4U配线架(见附件1)。共需32个配线架,每个脊交换机机架需一个。

·(3)主干布线:

EDGE8主干光缆将用作SU的脊交换机机架和集中式核心区域的核心交换机机架之间的主干布线。共需要512条EDGE8主干光缆(每条144芯),长度可达500米。

·(4) 核心交换机机架上的配线面板:

需要带适配器面板的高密度EDGE8®4U配线架(见附件1)。核心交换机机架区域共需要32个配线架。

·(5) 从配线面板到核心交换机机架的连接:

该连接可以通过以下方式实现:

- 576条128芯CORE主干光缆;或

- 9216条单根8芯跳线。

· C级总结:

-(1) 128芯CORE主干光缆数量:1152条(从脊节点到配线面板需576条+从配线面板到核心交换机机架需576条);或

单根跳线的数量:18432条 (从脊节点到配线面板需9216条+从配线面板到核心交换机机架需9216条).

-(2)带适配器面板的EDGE8®配线架的数量:64个(脊交换机机架需32个+核心交换机机架需32个)

-(3) 144芯EDGE8主干光缆的数量: 512 (用于主干布线).

在8可扩展单元集群中,每个叶交换机接收18个引自服务器的MPO连接,每个脊交换机接收从同一轨道内的各叶节点引出的两个MPO连接。因此,每个脊交换机共需32个MPO连接。然后,每个脊交换机再将8个MPO连接转发到核心交换机,如图30所示。

因为每条轨道有9个脊交换机,所以有9组核心交换机。连接的分布遵循以下逻辑:

· 核心组1接收所有轨道Spine-01交换机的所有连接。

· 核心组2接收所有轨道Spine-02交换机的所有连接,后续各核心组以此类推。

例如,每个Spine-01交换机(请参见图21中每个脊节点机架中的机架单元23)从每个轨道向核心组1中的Core-01交换机转发2个MPO连接。2乘以4(四个轨道)再乘以8(八个POD),可得出核心组1中的Core-01交换机总共有64个传入MPO连接。

9216 GPU集群使用9个核心组,每个核心组有16个交换机。在前面的图中,用9个核心机架,每个机架有16个核心交换机来表示。

图30. 8可扩展单元集群计算网络

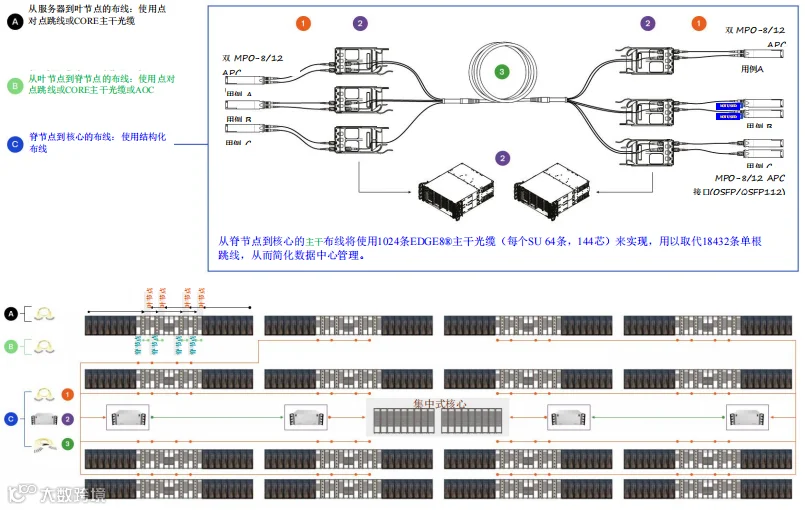

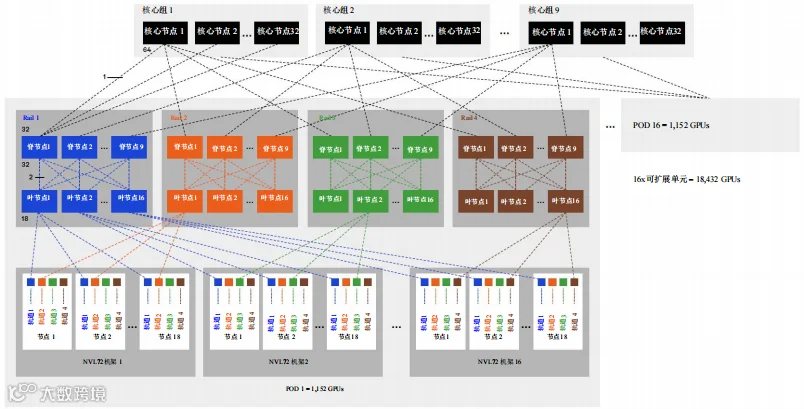

2.6.5.连接16可扩展单元集群的布线

在图31中,用4608台服务器、1024个叶交换机、576个脊交换机和288个核心交换机连接一个16可扩展单元集群需要:

· 18432个节点到叶节点的MPO连接

· 18432个叶节点到脊节点的MPO连接

· 18432个脊节点到核心的MPO连接

图31. 连接8可扩展单元集群的布线

通过应用我们已探讨的不同布线层级,可以总结出以下配置:

· 数据中心运营商可以在可扩展单元中使用A级布线进行服务器到叶节点的布线,布线时可采用跳线或CORE主干光缆进行点对点布线连接。此方案下,每个可扩展单元需要18432条单根8芯跳线(长度可变),或者1024条CORE主干光缆(每条144芯)(长度可变)。

· 在叶节点到脊节点的B级布线中,可以采用跳线或CORE主干光缆进行点对点布线。此方案下,每个可扩展单元需要18432条单根8芯跳线(长度可变)或1024条CORE主干光缆(每条144芯)(长度可变)。

· 在脊节点到核心的C级布线中最好将结构化布线作为首选方法,特别是对于长距离(长达500米)的管理电缆。之所以建议采用这种方法,是因为核心交换机区域通常集中在数据中心内的不同区域或数据大厅。或者,也可以使用点对点布线;然而,在这种情况下,强烈建议使用CORE主干光缆(总共1152条128芯CORE主干光缆,最长距离500米)来简化布线,尽量减少与单根跳线管理相关的复杂性。每种方法的具体细节如下:

·(1) 从脊交换机机架到配线面板的连接:

该连接可以通过以下方式实现:

- 1152条128芯CORE主干光缆;或

- 18432条单根8芯跳线

·(2) 脊交换机机架上的配线面板:

需要带适配器面板的高密度EDGE8®4U配线架(见附件1)。共需64个配线架,每个脊交换机机架需一个。

·(3)主干布线:

EDGE8主干光缆将用作SU的脊交换机机架和集中式核心区域的核心交换机机架之间的主干布线。共需要1024条EDGE8主干光缆(每条144芯),长度可达500米。

·(4) 核心交换机机架上的配线面板:

需要带适配器面板的高密度EDGE8®4U配线架(见附件1)。核心交换机机架区域共需要64个配线架。

·(5) 从配线面板到核心交换机机架的连接:

该连接可以通过以下方式实现:

- 1152条128芯CORE主干光缆;或

- 18432条单根8芯跳线。

· C级总结:

-(1) 128芯CORE主干光缆数量:2304条(从脊节点到配线面板需1152条+从配线面板到核心交换机机架需1152条);或

单根跳线的数量:36864条 (从脊节点到配线面板需18432条+从配线面板到核心交换机机架需18432条).

-(2)带适配器面板的EDGE8®配线架的数量:128个(脊交换机机架需64个+核心交换机机架需64个)

-(3) 144芯EDGE8主干光缆的数量:1024 (用于主干布线).

在8可扩展单元集群中,每个叶交换机接收18个引自服务器的MPO连接,每个脊交换机接收从同一轨道内的各叶节点引出的两个MPO连接。因此,每个脊交换机共需32个MPO连接。然后,每个脊交换机再将8个MPO连接转发到核心交换机,如图30所示。到核心组1中Core-01交换机的MPO连接。

因为每条轨道有9个脊交换机,所以有9组核心交换机。连接的分布遵循以下逻辑:

· 核心组1接收所有轨道Spine-01交换机的所有连接。

· 核心组2接收所有轨道Spine-02交换机的所有连接,后续各核心组以此类推。

例如,每个Spine-01交换机(请参见图21中每个脊节点机架中的机架单元23)从每个轨道向核心组1中的Core-01交换机转发2个MPO连接。2乘以4(四个轨道)再乘以8(八个POD),可得出核心组1中的Core-01交换机总共有64个传入MPO连接。

18432 GPU集群使用9个核心组,每个核心组有32个交换机。在前面的图中,用18个核心机架,每个机架有16个核心交换机来表示。

图 32. 16可扩展单元集群计算网络

未完待续![]()

往期回顾