NVIDIA NVL72 GB200/GB300系统:

InfiniBand和以太网连接解决方案(二)

目录

1.5. 场景5 - 800G和400G - 交换机到

交换机应用

使用点对点布线连接LC双工到LC双工

应用:InfiniBand Quantum-2 / 以太网 Spectrum-4 到 InfiniBand Quantum-2 / 以太网 Spectrum-4

场景5主要用于点对点布线应用,它涉及连接位于同一机架或同一机柜内的有源设备。但是,如果这些设备物理上位于数据中心内的不同区域,则不建议使用点对点布线。

双LC双工收发器的主要应用是将Quantum-2或Spectrum-4风冷交换机连接在一起,收发器上的亮绿色标记表示最大连接距离可达2km。

请参阅第1.7节表10,查看场景5和6中适用于用例A和B的收发器列表。

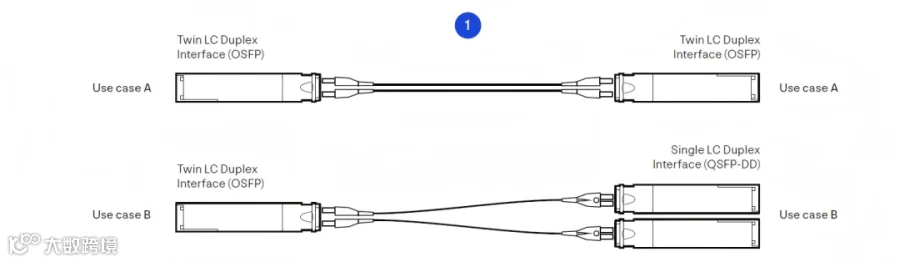

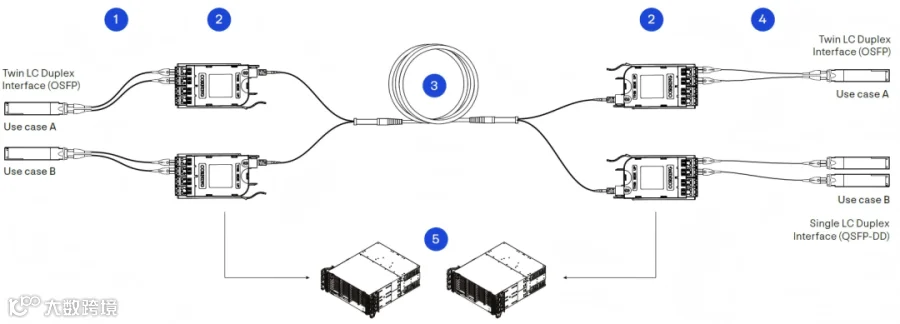

图5. 使用800G和400G收发器,结合LC双工的点对点布线用例

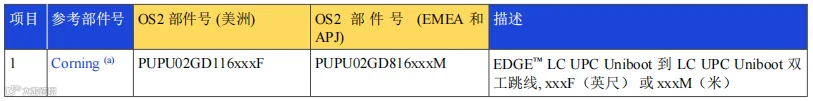

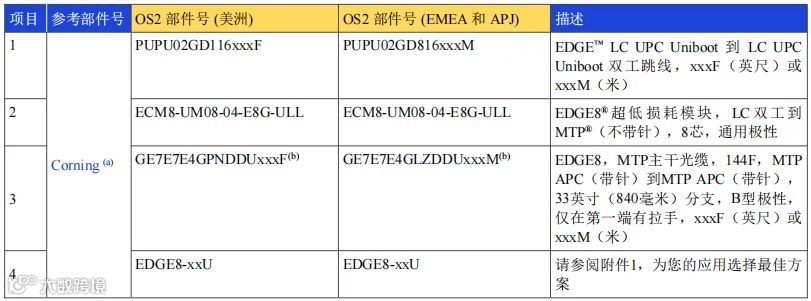

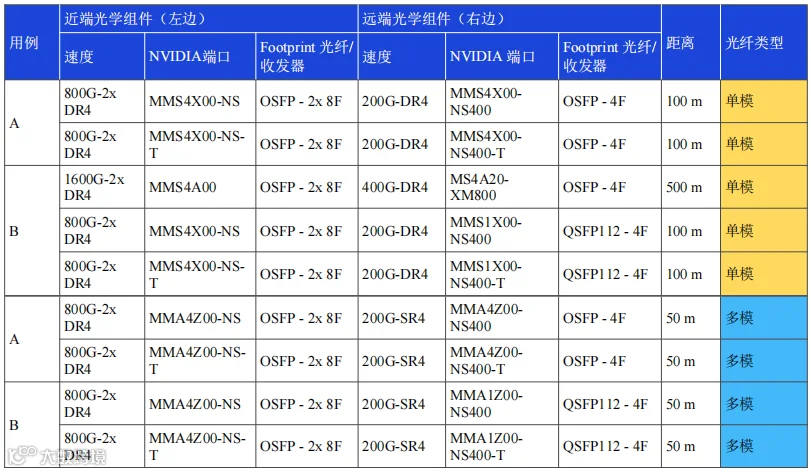

表6. 场景5 - 使用点对点布线与LC双工的 800G和 400G部件编号方案

注:

a) 美洲地区的康宁光缆使用Plenum光缆,而EMEA/APJ地区使用LSZH™/CPR额定光缆。跳线长度从1米到300米不等。美洲地区也提供以米为单位的长度选项。

b) 康宁光缆支持InfiniBand、以太网和NVLink协议。

c) 请查看康宁的极性图纸,详见附件 2。

1.6. 场景6 - 800G和400G - 交换机到

交换机应用

使用结构化布线,通过主干光缆在数据中心内连接LC双工到LC双工

应用: InfiniBand Quantum-2 / 以太网Spectrum-4 到 InfiniBand Quantum-2 / 以太网Spectrum-4

在场景6中,结构化布线的实现利用MPO-8/12光缆作为主干光缆。该应用用于连接不同的交换机,例如叶交换机到脊交换机。当两个不同的有源设备物理上位于数据中心内的不同区域时,推荐使用该选项。

双LC双工收发器的主要应用是将Quantum-2或Spectrum-4风冷交换机连接在一起。收发器上的亮绿色标记表示最大连接距离可达2km。

请参阅第1.7节表10,查看场景5和6中适用于用例A和B的收发器列表。

图6. 使用800G和400G收发器,结合LC双工的结构化布线用例

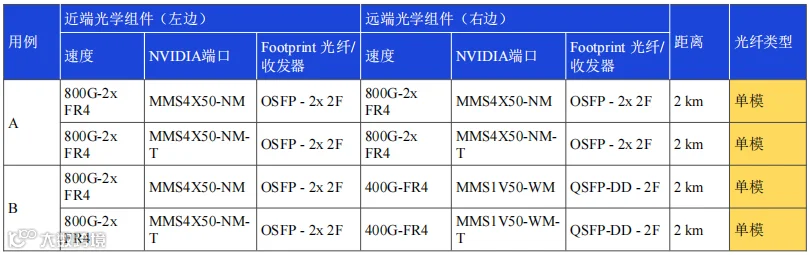

表7. 场景6 - 使用结构化布线,结合LC双工连接的 800G和 400G在有源设备上的部件编号方案

注:

a) 美洲地区的康宁光缆使用Plenum光缆,而EMEA/APJ地区使用LSZH™/CPR额定光缆。跳线长度从1米到300米不等。美洲地区也提供以米为单位的长度选项。

b) EDGE8®主干光缆有8到288芯光纤的规格。

c) 康宁光缆支持InfiniBand、以太网和NVLink协议。

d) 请查看康宁的极性图纸,详见附件 2。

1.7.每个场景的收发器选项

和端口拆分连接

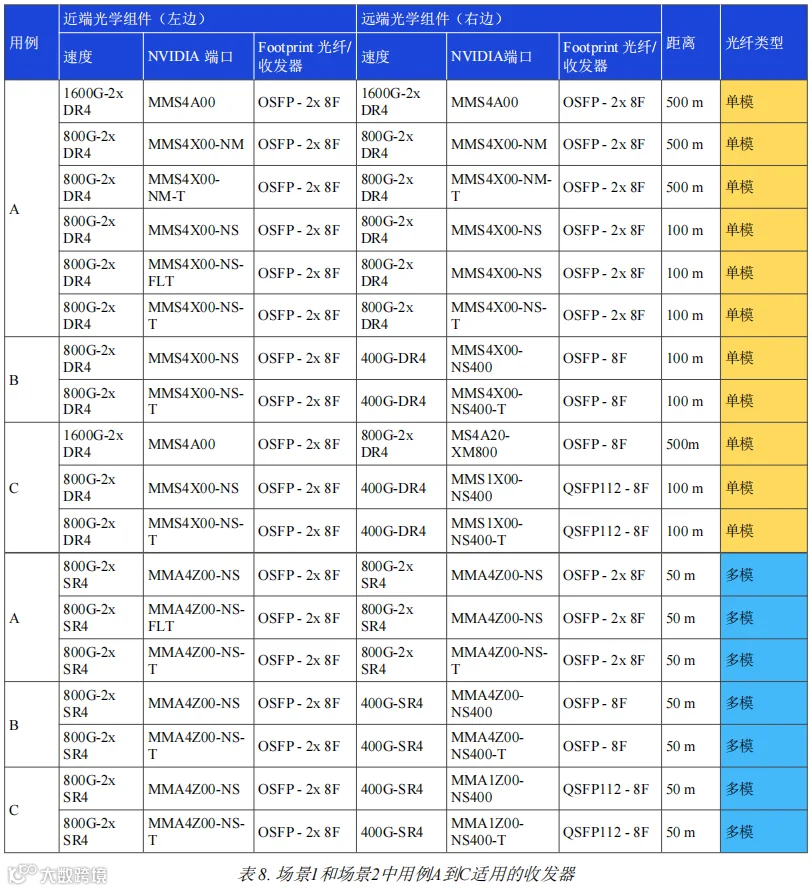

要阅读以下表格,请遵循示例:

示例1:在场景2,用例B中,使用表8,图中左侧的800G-2xDR4、MMS4X00-NS通过2个MPO-8/12 APC连接,可以连接到两个OSFP收发器MMS4X00-NS400,从而在右侧形成两个独立的400G连接。

示例2:在场景4,用例B中,使用表9,图中左侧的800G-2xDR4、MMS4X00-NS通过2个MPO-8/12 APC连接,可以利用Y型线束连接到四个200G-DR4、QSFP112、MMS1X00-NS400,从而在右侧形成四个独立的200G连接。

表 8. 场景1和场景2中用例A到C适用的收发器

表9. 场景3和场景4中用例A和B适用的收发器

表10. 场景5和场景6中用例A和B适用的收发器

2. NVIDIA NVL72系统布线架构

参考指南

在本节中,我们将回顾如何连接NVIDIA NVL72系统。虽然本指南使用NVIDIA NVL72 GB200 InfiniBand作为参考,但重要的是要注意,类似的布线组件和基础设施可用于涉及VL72 GB200 以太网,NVL72 GB300 InfiniBand和以太网的应用以及即将推出的Rubin平台。每个GPU集群的具体考虑事项取决于个别客户的设计需求。

NVL72集群由一定数量的可扩展单元(SU)组成,每个SU包含特定数量的节点(服务器)。此配置决定了集群中GPU的总数。可扩展单元是GPU集群的构建块。

了解集群的大小、系统(GB200或GB300)以及协议(InfiniBand或以太网)决定所需的NVL72机架、叶交换机、脊交换机和核心交换机的数量,这一点至关重要。基于该配置,我们可以计算所需的光缆或连接数量。

在图7中,我们可以看到InfiniBand GB200系统适用的组件计数。例如,一个包含16个可扩展单元的集群将总共有4608个节点(服务器),这相当于18432个GPU。此设置需要1024个IB叶交换机、576个IB脊交换机和288个IB核心交换机。适用于InfiniBand GB200的交换机是Quantum-2 Q9700。在本文档中将此集群的大小用作参考。

“光缆数量”这一列显示了连接系统所需的单个MPO-8/12 APC连接的数量。以我们含16个可扩展单元的集群为例:

•节点到叶交换机的连接:要将每个节点(服务器)连接到InfiniBand叶交换机,需要18432个MPO-8/12 APC连接。

•叶交换机到脊交换机的连接:要将InfiniBand叶交换机连接到InfiniBand脊交换机,还额外需要18432个MPO-8/12 APC连接。

•脊交换机到核心交换机的连接:要将InfiniBand脊交换机连接到InfiniBand核心交换机,还需要另外18432个MPO-8/12 APC连接。

在这个含16个可扩展单元的集群示例中,共计需要55296个MPO-8/12 APC连接。

图 7. InfiniBand GB200组件计数参考表

2.1. 了解NVL72机架节点 (服务器 )的

计算网络连接

NVIDIA NVL72 GB200/GB300机架具有InfiniBand或以太网计算网络、存储网络、带内管理网络和带外管理网络的连接端口。

根据需求权衡选择GB200和GB300时,还需要区分它们对拓扑设计的影响,了解单平面和多平面拓扑的概念。

网络架构中的平面是指集群内GPU和交换机之间独特的逻辑连接层。每个平面在本质上都是一个独立的网络路径,用于实现集群中设备间的通信。

考虑到这一点,对于计算网络,GB200和GB300拓扑之间的关键区别是什么呢?图8总结性地展示了我们可以期待的各方面内容。请记住,这里所说的所有MPO连接器都是8芯MPO连接器,也称为MPO-8、MPO-12或MPO-8/12。此外,无论是单模还是多模,它们都是斜角连接器(APC):

•NVL72 GB200 InfiniBand和NVL72 GB200以太网:

-每个节点(服务器)配备4个GPU,每个GPU在物理上以1个 400G NDR OSFP MPO-8/12表示。

-这相当于从单个NVL72机架中输出72个MPO-8/12计算/后端连接。

-此拓扑的交换机(Quantum-2 QM9700 或 Spectrum-4 SN5600)使用双MPO端口(2x MPO-8/12 = 2x 400G NDR OSFP)。

-此拓扑基于单平面设计(两层或三层架构)。

•NVL72 GB300 InfiniBand:

-每个节点(服务器)配备4个GPU,每个GPU在物理上以1个800G XDR OSFP MPO-8/12表示。

-这相当于从单个NVL72机架中输出72个MPO-8/12计算/后端连接。

-此拓扑的交换机(Quantum-3 Q3400-RA 或 Q3200-RA)使用双MPO端口(2x MPO-8/12 = 2x 800G XDR OSFP)。

-此拓扑基于双平面设计(两层或三层架构)。

•NVL72 GB300 以太网:

-每个节点(服务器)配备 4个GPU,每个GPU在物理上以2个400G OSFP MPO-8/12表示。

-这相当于从单个NVL72机架中输出144个MPO-8/12计算/后端连接。

-此拓扑的交换机(Spectrum-4 SN5600)使用双MPO端口(2x MPO-8/12 = 2x 400G OSFP)。

-此拓扑基于双平面(两层或三层架构)或四平面(两层架构)设计。

-GB300以太网在四平面拓扑中引入换线盒,从而降低了布线复杂性(图36)。

图8. NVL72(Grace Blackwell)GB200和GB300后端拓扑

2.2. 了解NVL72系统的交换机

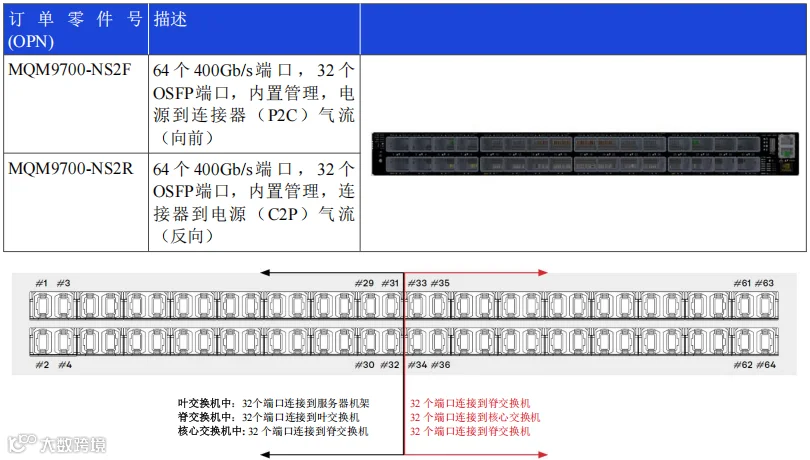

无论是400G NDR还是800G XDR,在NVL72集群中,叶交换机、脊交换机和核心交换机的选择都取决于所采用的数据速率。

图9概括了基于数据速率选择的每个交换机的应用及其端口数。

图9.基于后端网络数据速率的InfiniBand和以太网交换机应用

接下来让我们分析一下交换机应用:

•InfiniBand 400G NDR通常与NVL72 GB200系统配合使用,并选用Quantum-2交换机,该组合支持32个OSFP双MPO-8/12 APC端口。这意味着,每个交换机最多可以支持64个400G NDR端口。

图10展示了交换机级别的端口映射示例,可将其作为所有交换机类型的通用参考。此映射示例也可以扩展应用到InfiniBand Quantum-3和以太网Spectrum-4交换机。需要注意的是,这只是客户进行端口映射的一种方法。

Quantum-2交换机将在网络中作为叶节点、脊节点或核心节点等不同角色进行部署。

图 10. Quantum-2交换机端口映射示例

•InfiniBand 800G XDR通常与NVL72 GB300系统配合使用,并选用Quantum-3 Q3400-RA或Q3200-RA交换机。

Q3400-RA可用作叶交换机、脊交换机或核心交换机,支持72个OSFP 双 MPO-8/12 APC端口,这意味着每个交换机最多可以支持144个800G XDR单端口。

Q3200-RA可用作叶交换机。单个Q3200-RA机箱可同时作为两个独立交换机运行(一个在机箱左侧,一个在机箱右侧)。每侧支持18个OSFP双 MPO-8/12 APC端口,即每侧最多支持36个800G XDR单端口,使整个机箱最多支持72个800G XDR单端口。

•以太网400G通常与NVL72 GB200和GB300系统配合使用,并选用Spectrum-4 SN5600或SN5400交换机。

SN5600可用作叶交换机、脊交换机或核心交换机,支持64个OSFP双MPO-8/12 APC端口,这意味着每个交换机最多可以支持128个400G的单端口。

SN5400可用作叶交换机。支持64个400G QSFP-DD单MPO-8/12 APC端口。

2.3. 了解GPU集群的构建块

——可扩展单元的概念

NVL72集群由称为可扩展单元(SU)的构建块构建。InfiniBand GB200和GB300中,每个SU包含16个NVL72系统或机架。以太网GB200中,每个SU包含4个NVL72系统。以太网GB300中,每个SU包含2个NVL72系统。在任何情况下,都可以使用SU快速部署各种规模的系统。

在本指南中,我们将重点介绍InfiniBand NVL72 GB200的部署示例。InfiniBand NVL72 GB200 中每个SU包含:

•1152个GPU(分布在16个NVL72机架上)

•64个叶交换机(Quantum-2)

•36个脊交换机(Quantum-2)

在GB300 InfiniBand和GB300以太网部署中,交换机的数量会有所不同;然而,这些集群适用相同的产品、逻辑和概念。

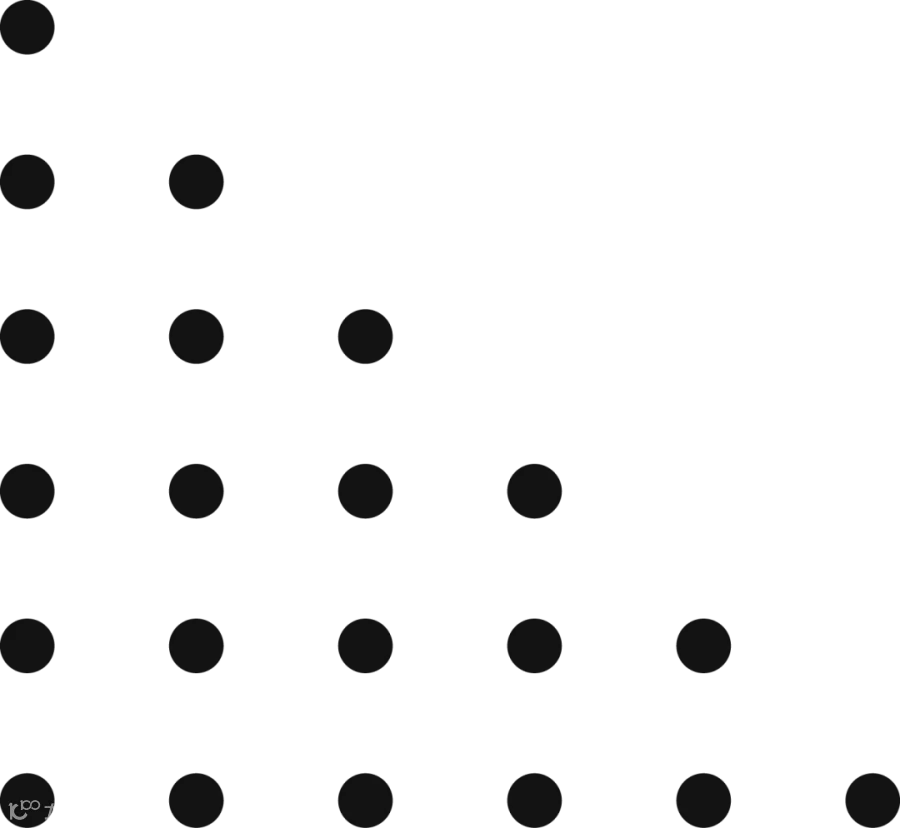

与DGX SuperPOD H100/H200和B100/B200一样,NVL72系统的架构也经过了轨道优化。区别在于NVL72系统采用基于4轨的架构,而H100/H200和B100/B200采用8轨架构。轨道是指来自每个节点的具有相同端口号的主机通道适配器(HCA)连接到同一个叶交换机。例如,NVL72机架中18台服务器的所有1号端口连接都代表轨道1,所有2号端口连接都代表轨道2,所有3号端口连接都代表轨道3,所有4号端口连接都代表轨道4(见图13)。

NVL72机架中,每个轨道的每组18个连接将连接到它们各自的叶交换机,这意味着每个NVL72机架中的每个轨道都有一个叶交换机。因为可扩展单元由16个NVL72机架组成,这意味着轨道1、轨道2、轨道3和轨道4都各有16个不同的叶交换机。

在DGX SuperPOD架构中,可扩展单元(SU)仅由服务器和叶交换机组成,而NVL72 SU还包含脊层。对于16个NVL72 GB200 SU,需要9个脊交换机。同一轨道的叶交换机通过脊交换机机架中各脊交换机的2个端口连接,从而对所有轨道1连接进行整合。同样,轨道2、轨道3和轨道4也各需要9个脊交换机(各自配独立机架)。

NVL72 GB200架构由Quantum-2 9700 InfiniBand交换机和2个400G双端口OSFP收发器构建而成。

可扩展单元的布局是可以配置的。图11展示了一些可能的布局示例及相关计算网络组件。需要注意的是,还可以实现其他类型的布局。因此,在设计阶段与康宁工程团队保持密切沟通至关重要,以验证您的设计选择的最佳布线方案。

图 11.可配置的可扩展单元(SU)

未完待续![]()

往期回顾