NVIDIA英伟达 800G InfiniBand

和以太网连接人工智能布线指南

目录

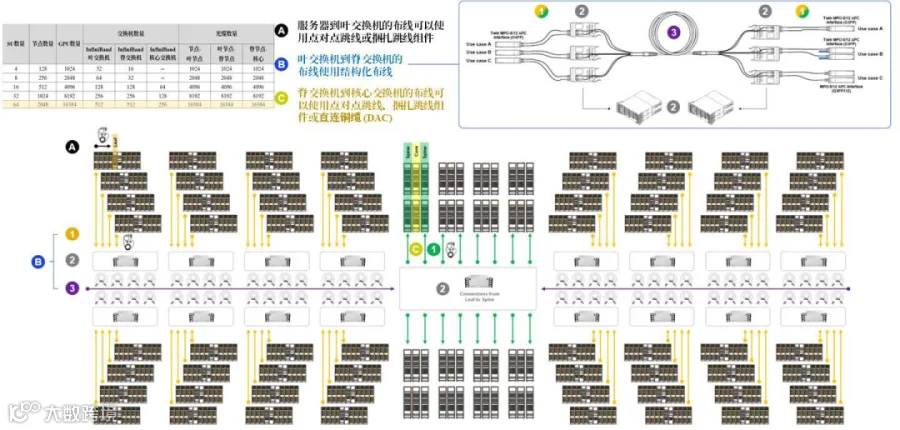

2.6 整体概览

现在我们已经了解了不同的集群或POD尺寸,以及如何在计算布线系统的活动设备之间进行布线,让我们通过图示总结一下可以使用的组件。这些组件将取决于具体的设计,但主要基于我们在本文中回顾的不同产品和部件编号。

2.6.1 连接4个可扩展

单元(SU)集群/POD的布线

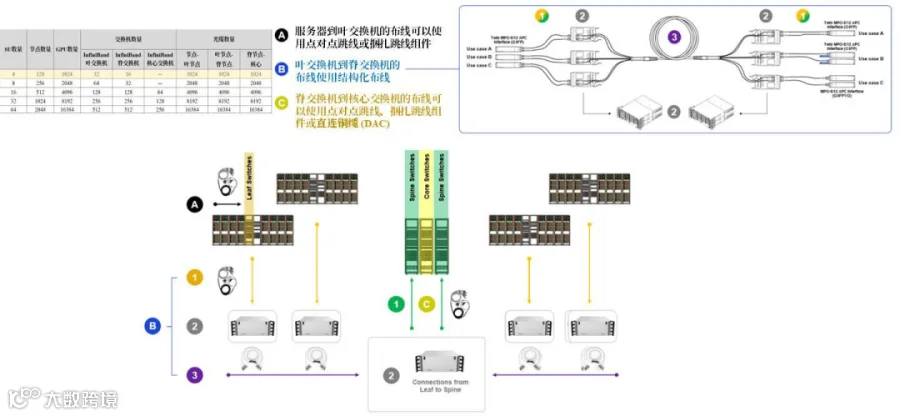

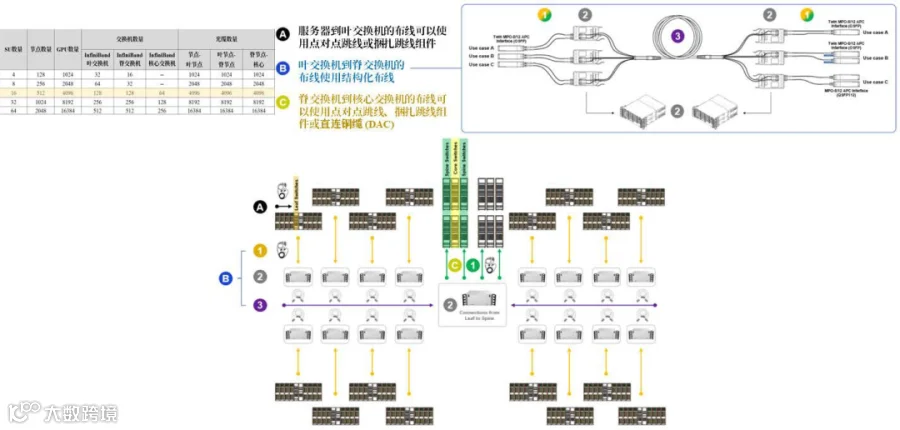

在图19中,将4个SU POD与128台服务器、32台叶节点交换机和16台脊节点交换机进行布线需要:

• 1,024个从节点到叶节点的连接

• 1,024个从叶节点到脊节点的连接

• 如果有核心交换机的话,还需要1,024个连接(可选)

图19. 包含A级、B级、C级布线的4个可扩展单元(SU)集群/POD

通过应用我们已探讨的不同布线层级,可以得出以下结论:

• 数据中心运营商可以在可扩展单元中使用A级布线,进行服务器到叶节点的布线,使用点对点跳线或束状跳线组件。这将需要每个可扩展单元256个独立的8芯跳线(长度可变),或者仅需8个每个含 256芯的束状跳线(长度可变)。

• 数据中心运营商可以使用B级布线,进行叶节点到脊节点的布线,采用结构化布线。这将需要安装单根跳线或束状跳线、适配器面板、配线架和高芯数主干光缆作为主干布线。通过这种主干布线,我们可以轻松使用64条干线(每个叶节点16条干线,每条144芯),这将替代点对点连接中的单根跳线和束状跳线。这种方法允许使用备用端口,更好地管理复杂性,并提高数据中心中的通道空间。

• 如果部署核心交换机,数据中心运营商可以使用C级布线,进行脊节点到核心的布线,使用点对点跳线、束状跳线组件或DAC(直连铜缆)。

2.6.2 连接8个可扩展

单元(SU)集群/POD的布线

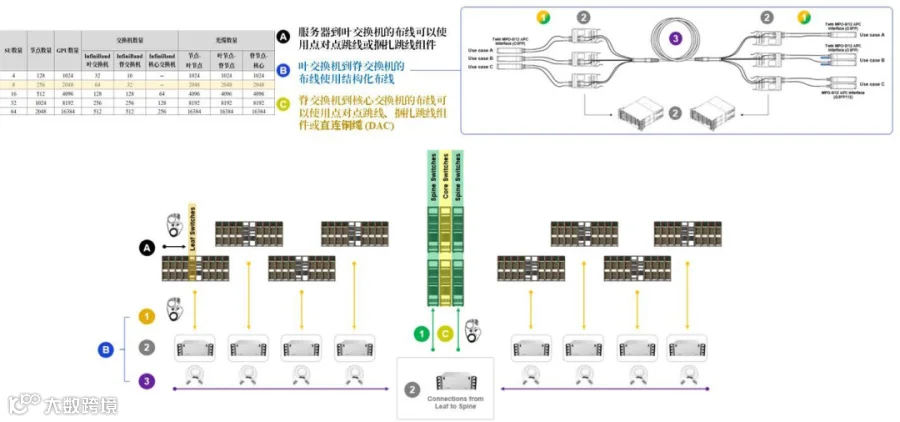

在图20中,将8个SU POD与256台服务器、64台叶节点交换机和32台脊节点交换机进行布线需要:

• 2,048个从节点到叶节点的连接

• 2,048个从叶节点到脊节点的连接

• 如果有核心交换机的话,还需要2,048个连接(可选)

图20. 包含A级、B级、C级布线的 8个可扩展单元(SU)集群/POD

通过应用我们已探讨的不同布线层级,可以得出以下结论:

• 数据中心运营商可以在可扩展单元中使用A级布线,进行服务器到叶节点的布线,使用点对点跳线或束状跳线组件。这将需要每个可扩展单元256个独立的8芯跳线(长度可变),或者仅需8个每个含256芯的束状跳线(长度可变)。

• 数据中心运营商可以使用B级布线,进行叶节点到脊节点的布线,采用结构化布线。这将需要安装单根跳线或束状跳线、适配器面板、配线架和高芯数主干光缆作为主干布线。通过这种主干布线,我们可以轻松使用128条干线(每个叶节点16条干线,每条144芯),这将替代点对点连接中的单根跳线和束状跳线。这种方法允许使用备用端口,更好地管理复杂性,并提高数据中心中的通道空间。

• 如果部署核心交换机,数据中心运营商可以使用C级布线,进行脊节点到核心的布线,使用点对点跳线、束状跳线组件或DAC(直连铜缆)。

2.6.3 连接16个可扩展

单元(SU)集群/POD的布线

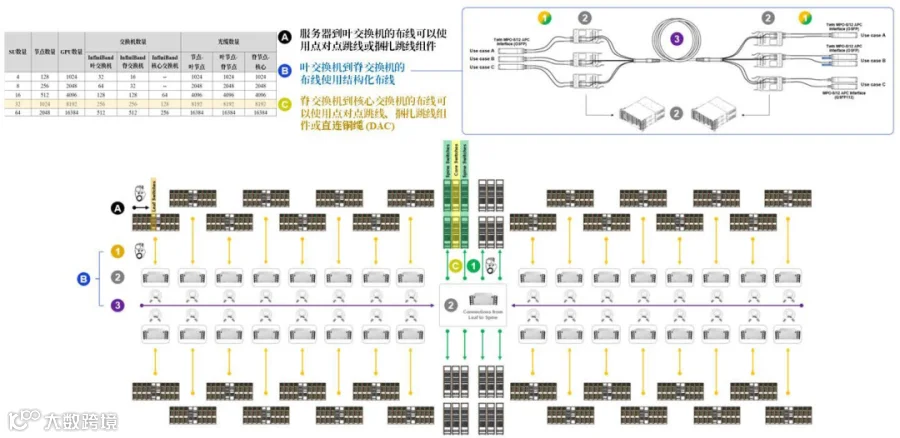

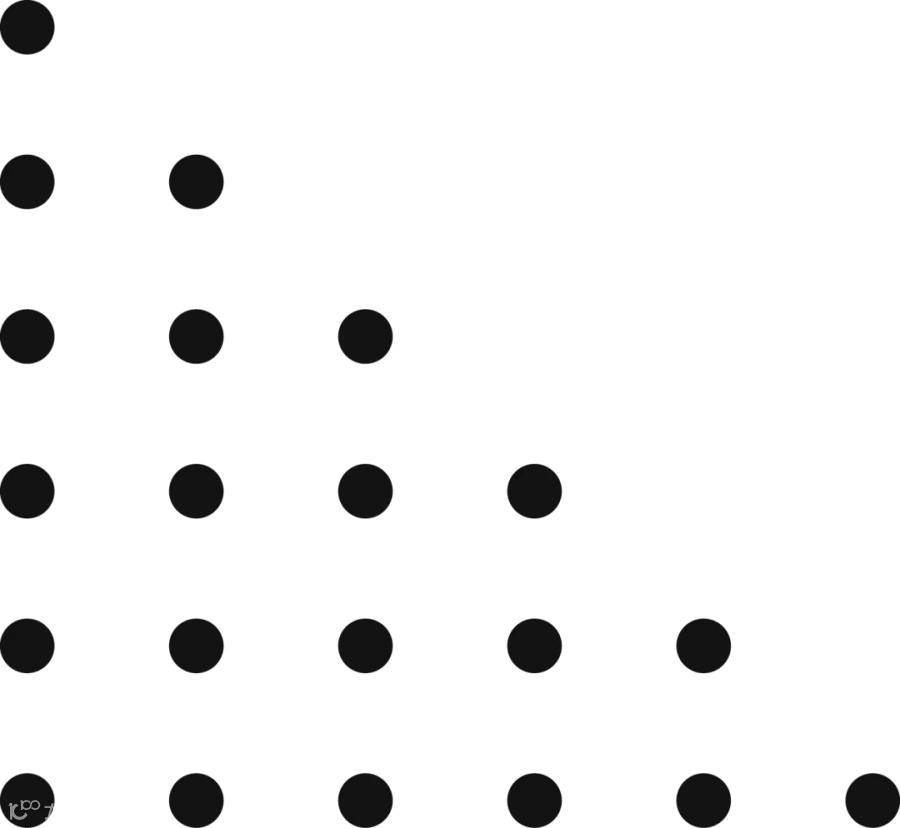

在图21中,将16个SU POD与512台服务器、128台叶节点交换机和128台脊节点交换机进行布线需要:

· 4,096个从节点到叶节点的连接

· 4,096个从叶节点到脊节点的连

· 如果有核心交换机的话,还需要4,096个连接(可选)

图 21. 包含A级、B级、C级布线的16个可扩展单元(SU)集群/POD

通过应用我们已探讨的不同布线层级,可以得出以下结论:

• 数据中心运营商可以在可扩展单元中使用A级布线,进行服务器到叶节点的布线,使用点对点跳线或束状跳线组件。这将需要每个可扩展单元256个独立的8芯跳线(长度可变),或者仅需8个每个含256芯的束状跳线(长度可变)。

• 数据中心运营商可以使用B级布线,进行叶节点到脊节点的布线,采用结构化布线。这将需要安装单根跳线或束状跳线、适配器面板、配线架和高芯数主干光缆作为主干布线。通过这种主干布线,我们可以轻松使用256条干线(每个叶节点16条干线,每条144芯),这将替代点对点连接中的单根跳线和束状跳线。这种方法允许使用备用端口,更好地管理复杂性,并提高数据中心中的通道空间。

• 如果部署核心交换机,数据中心运营商可以使用C级布线,进行脊节点到核心的布线,使用点对点跳线、束状跳线组件或DAC(直连铜缆)。

2.6.4 连接32个可扩展

单元(SU)集群/POD的布线

在图22中,将32个SU POD与1,024台服务器、256台叶节点交换机、256台脊节点交换机和128台核心交换机进行布线需要:

• 8,192个从节点到叶节点的连接

• 8,192个从叶节点到脊节点的连接

• 8,192个从脊节点到核心的连接

图 22. 包含A级、B级、C级布线的 32个可扩展单元(SU)集群/POD

通过应用我们已探讨的不同布线层级,可以得出以下结论:

• 数据中心运营商可以在可扩展单元中使用A级布线,进行服务器到叶节点的布线,使用点对点跳线或束状跳线组件。这将需要每个可扩展单元256个独立的8芯跳线(长度可变),或者仅需8个每个含256芯的束状跳线(长度可变)。

• 数据中心运营商可以使用B级布线,进行叶节点到脊节点的布线,采用结构化布线。这将需要安装单根跳线或束状跳线、适配器面板、配线架和高芯数主干光缆作为主干布线。通过这种主干布线,我们可以轻松使用512条干线(每个叶节点16条干线,每条144芯),这将替代点对点连接中的单根跳线和束状跳线。这种方法允许使用备用端口,更好地管理复杂性,并提高数据中心中的通道空间。

• 如果部署核心交换机,数据中心运营商可以使用C级布线,进行脊节点到核心的布线,使用点对点跳线、束状跳线组件或DAC(直连铜缆)。

2.6.5 连接64个可扩展

单元(SU)集群/POD的布线

在图23中,将64个SU POD与2,048台服务器、512台叶节点交换机、512台脊节点交换机和256台核心交换机进行布线需要:

• 16,384个从节点到叶节点的连接

• 16,384个从叶节点到脊节点的连接

• 16,384个从脊节点到核心的连接

图23. 包含A级、B级、C级布线的64个可扩展单元(SU)集群/POD

通过应用我们已探讨的不同布线层级,可以得出以下结论:

• 数据中心运营商可以在可扩展单元中使用A级布线,进行服务器到叶节点的布线,使用点对点跳线或束状跳线组件。这将需要每个可扩展单元256个独立的8芯跳线(长度可变),或者仅需8个每个含256芯的束状跳线(长度可变)。

• 数据中心运营商可以使用B级布线,进行叶节点到脊节点的布线,采用结构化布线。这将需要安装单根跳线或束状跳线、适配器面板、配线架和高芯数主干光缆作为主干布线。通过这种主干布线,我们可以轻松使用1,024条干线(每个叶节点16条干线,每条144芯),这将替代点对点连接中的单根跳线和束状跳线。这种方法允许使用备用端口,更好地管理复杂性,并提高数据中心中的通道空间。

• 如果部署核心交换机,数据中心运营商可以使用C级布线,进行脊节点到核心的布线,使用点对点跳线、束状跳线组件或DAC(直连铜缆)。

2.7 结论

总之,了解每个级别(A、B和C)的详细布线要求对于优化DGX SuperPOD的部署至关重要。此外,在可能的情况下实施结构化布线可以提高可管理性和效率,特别是在大规模设置中。

在设计阶段与康宁工程团队合作,确保布线策略与特定的数据中心布局和客户要求保持一致。

附件1 -高密度配线架

EDGE8®HD配线架安装在19英寸机架或机柜中,与EDGE8模块、面板、线束、中继器和跳线结合使用时,可提供业界领先的超高密度连接。

由于每个客户和项目都有特定的需求,请在BOM中添加最适合您需求的配线架:

表11. 高密度配线架

附件2 -极性图纸

极性图,通常被称为光纤极性图,在使用光纤布线设计和实施数据中心链路时是必不可少的。它们在确保不同网络组件之间的适当连接、信号完整性和兼容性方面发挥着至关重要的作用。

本节将介绍适用于前面描述的每种场景的特定极性图。

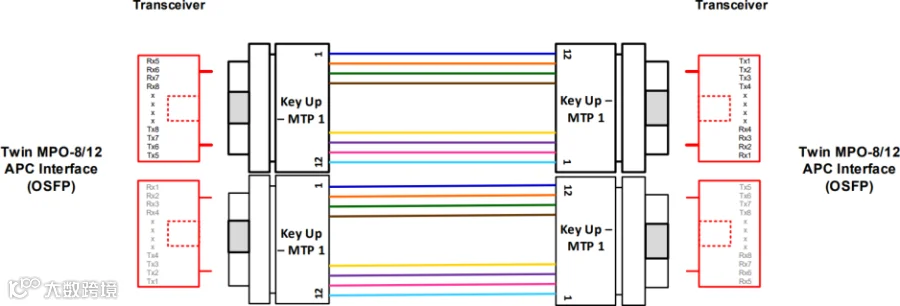

场景1—800G和400G—服务器到交换机应用

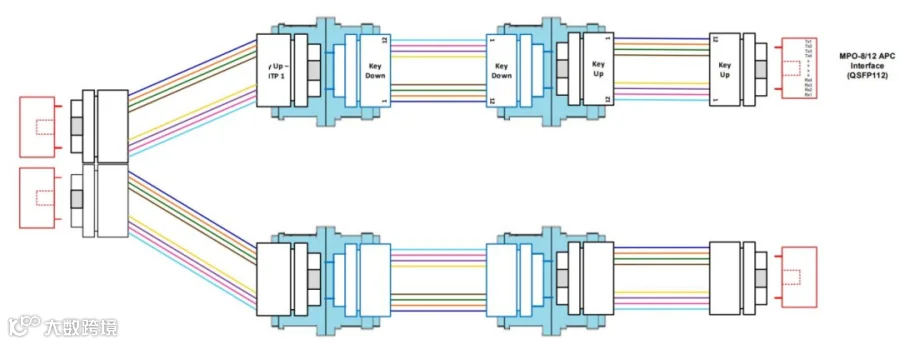

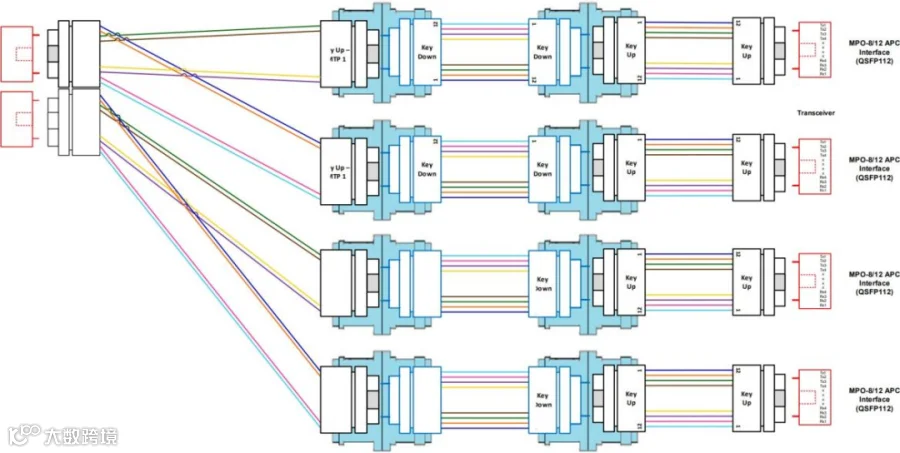

MPO-8/12 APC到MPO-8/12 APC使用点对点布线

用例A:

图24. 场景1-800G和400G-交换机到服务器本地 - 用例A

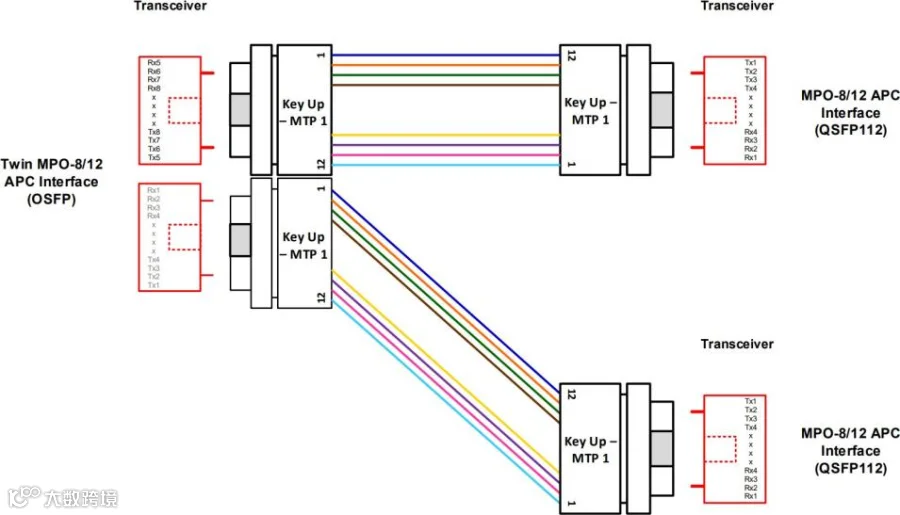

用例B:

图25. 场景1-800G和400G-交换机到服务器本地 - 用例B

用例C:

图26. 场景1 - 800G和400G -交换机到服务器本地 - 用例C

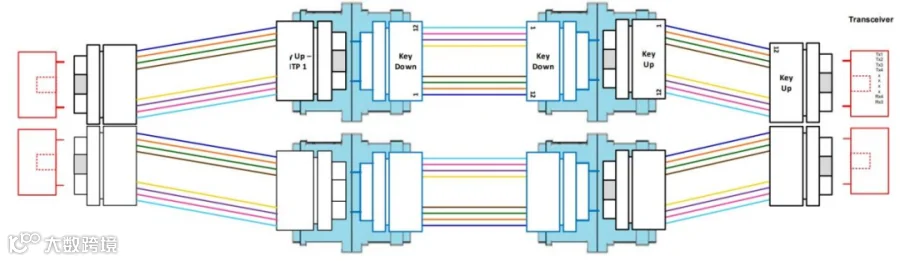

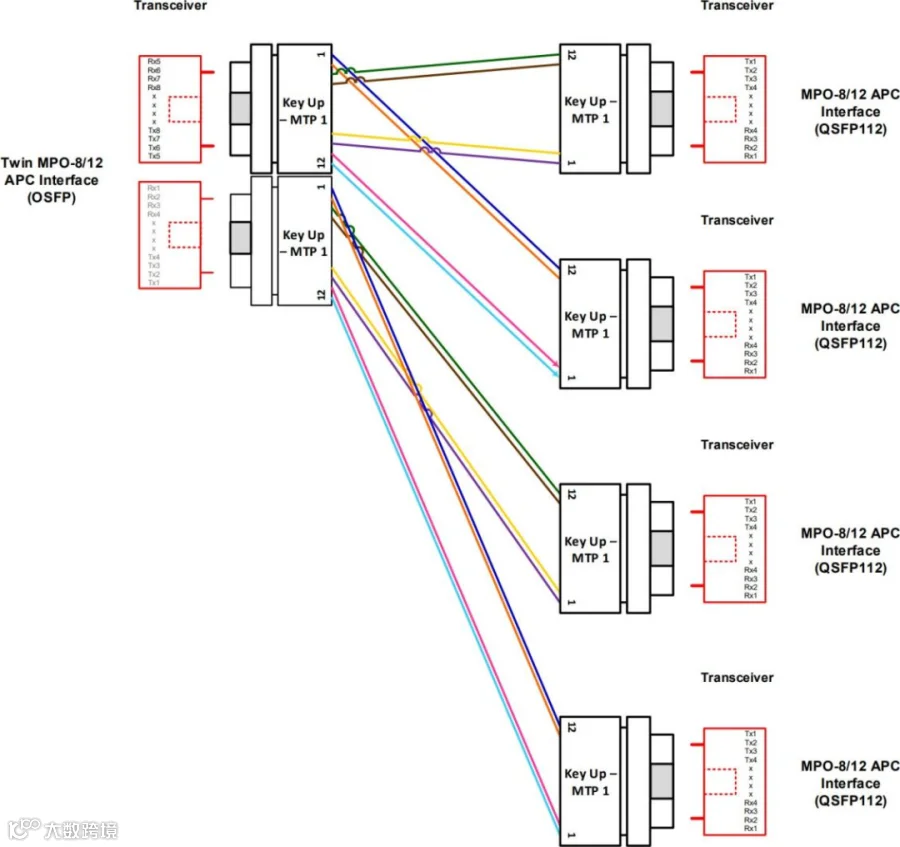

场景2 - 800G和400G -交换机到交换机应用

MPO-8/12 APC到MPO-8/12 APC通过主干结构化布线跨数据中心连接

用例A:

图27. 场景2 - 800G和400G -交换机到交换机通过主干跨数据中心连接 - 用例A

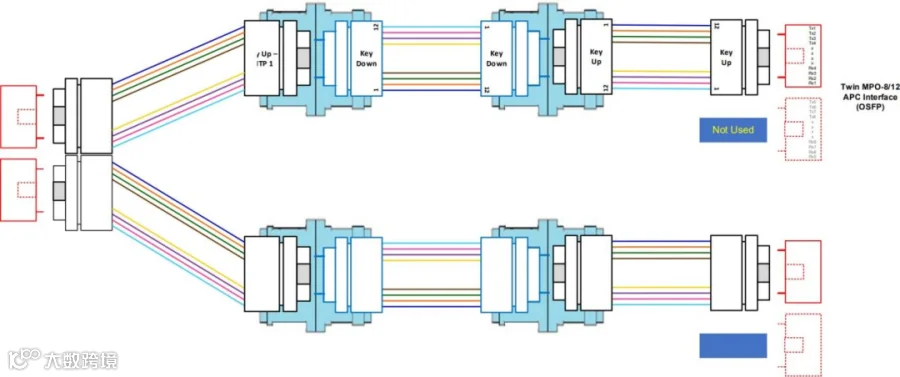

用例B:

图28. 场景2 - 800G和400G -交换机到交换机通过主干跨数据中心连接 - 用例 B

用例C:

图 29. 场景2 - 800G和400G -交换机到交换机通过主干跨数据中心连接 - 用例C

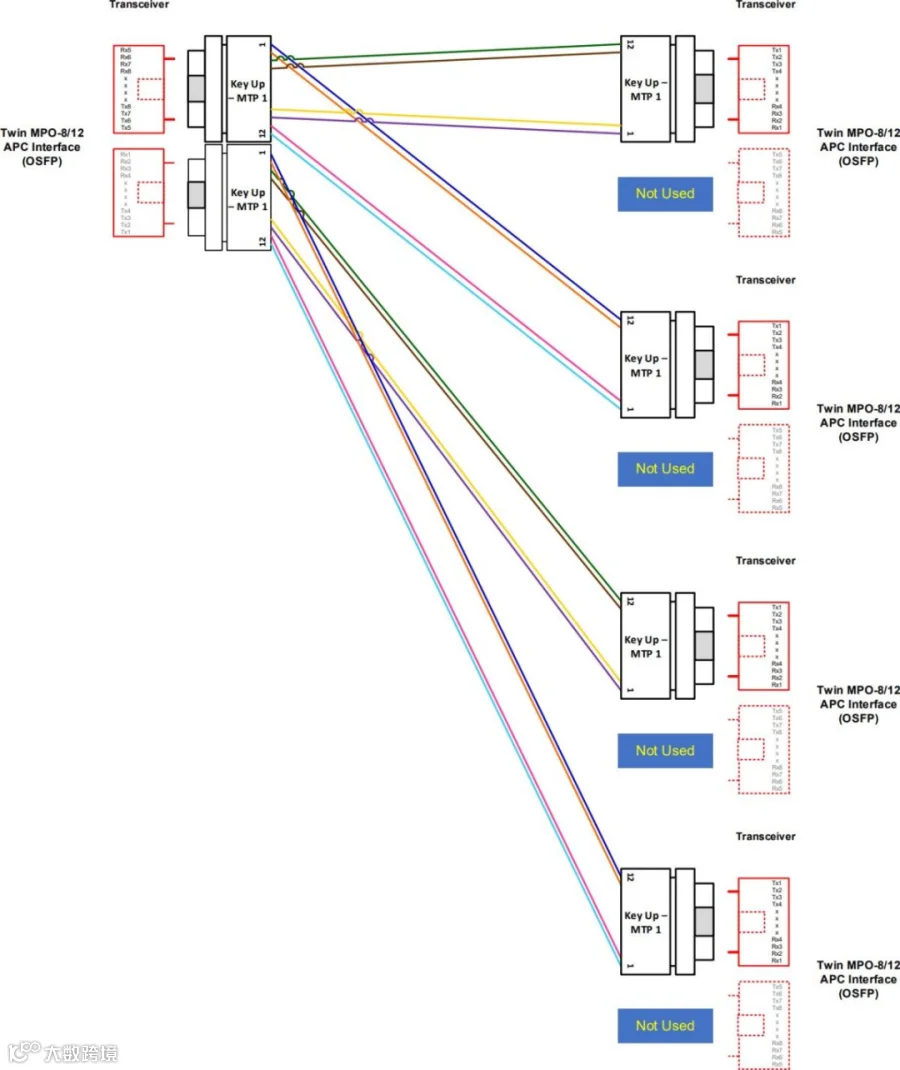

场景3 - 800G和200G -服务器到交换机应用

MPO-8/12 APC到MPO-8/12 APC采用点对点布线

用例A:

图30. 场景3 - 800G和 200G -交换机到服务器本地-用例A

用例B:

图31. 场景3 - 800G和200G -交换机到服务器本地-用例B

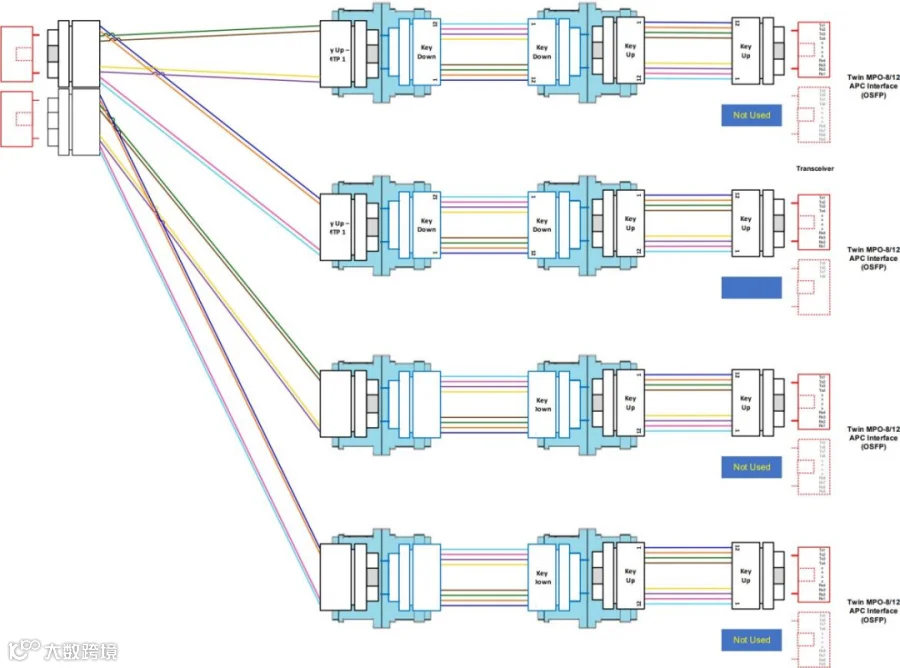

场景4—800G和200G—交换机到交换机应用

MPO-8/12 APC到MPO-8/12 APC,使用结构化布线跨数据中心连接

用例A:

图32. 场景4 - 800G和200G -交换机到交换机通过主干跨数据中心连接 - 用例A

用例B:

图33. 场景4 - 800G和200G -交换机到交换机通过主干跨数据中心连接 - 用例B

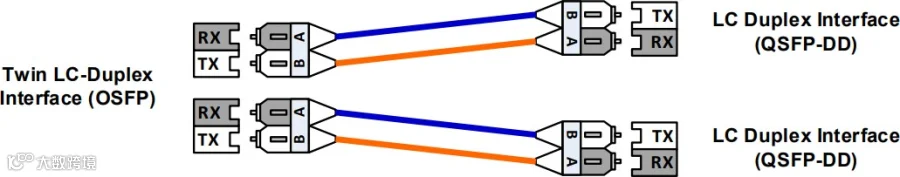

情景 5 - 800G 和 400G - 交换机到交换机应用 LC-双工到 LC-双工使用点对点布线

用例A:

图34. 场景5 - 800G和400G -交换机到交换机本地-用例A

用例B:

图35. 场景5 - 800G和400G -交换机到交换机本地-用例B

场景6 - 800G和400G -交换机到交换机应用

LC-双工UPC到LC -双工UPC使用结构化布线通过数据中心的主干连接

用例A:

图36. 场景6 - 800G和400G -交换机到交换机通过主干跨数据中心连接 - 用例A

用例B:

图37. 场景6 - 800G和400G -交换机到交换机通过主干跨数据中心连接 - 用例B

附件3 -参考文献和联系人

本节包含NVIDIA概述白皮书的部分参考列表。有关NVIDIA产品的更多详细信息,请访问https://docs.nvidia.com/

收发器:

• MMS4X00-NM 800Gbps Twin-port OSFP 2x400Gb/s Single Mode 2xDR4, 500m

https://docs.nvidia.com/networking/display/mms4x00nm800g500m/application+overview

• MMS4X00-NS 800Gbps Twin-port OSFP 2x400Gb/s Single Mode 2xDR4, 100m

https://docs.nvidia.com/networking/display/800gmms4x00ns/overview

• MMA4Z00-NS 800Gb/s Twin-port OSFP, 2x400Gb/s Multimode 2xSR4, 50m

https://docs.nvidia.com/networking/display/800gmma4z00ns/overview

• MMS4X50-NM 800Gb/s Twin-port OSFP, 2x400Gb/s Single Mode 2xFR4, 2km

https://docs.nvidia.com/networking/display/mms4x50nm800g2kmpub

英伟达光缆:

• MFP7E30-Nxxx,单模直交叉光纤线缆

https://docs.nvidia.com/networking/display/mfp7e30nxxxpub/specifications

• MFP7E40-Nxxx,单模分路交叉光纤线缆

https://docs.nvidia.com/networking/display/mfp7e40nxxxpub/specifications

• MFP7E10-Nxxx,多模直交叉光纤线缆

https://docs.nvidia.com/networking/display/mfp7e10nxxx/specifications

• MFP7E20-Nxxx,多模分路交叉光纤线缆

https://docs.nvidia.com/networking/display/mfp7e20nxxx/specifications

DGX SuperPOD架构:

• DGX H100

https://docs. nvidia. com/dgx-superpod/reference-architecture-scalable-infrastructure- h100/latest/dgx-superpod-architecture.html

• DGX B200

https://docs. nvidia. com/dgx-superpod/reference-architecture-scalable-infrastructure- b200/latest/dgx-superpod-architecture.html

• DGX GB200

https://www.nvidia.com/en-us/data-center/dgx-superpod-gb200/

联系我们

请邮件回复lis44@corning.com,提供您的姓名和组织名称,以及您在项目中遇到的问题和想要获得的支持。我们的专业服务团队成员将迅速作出回应。

往期回顾