上周,苹果公司在官网发布了2020款iPad Pro。

新款iPad Pro亮点之一就是配备了dToF LiDAR(dToF激光雷达扫描仪)技术,iPad Pro也因此成为了ToF技术在苹果产品的首发平台。

ToF是Time of flight(飞行时间)的简写。通过给目标连续发送光脉冲,然后用传感器接收从物体返回的光,通过探测光脉冲的飞行(往返)时间来得到目标物距离。

深度传感器,测量深度的机制一般有结构光、双目和ToF三种,其中结构光(iPhone目前的Face ID就是使用了基于结构光的深度传感器)和双目技术都是基于几何原理做间接深度估计,而ToF则是测量发射光和反射光之间的飞行时间并根据光速来直接估计深度。

LiDAR技术传统上是用在自动驾驶领域的关键技术,那么LiDAR和ToF又有什么关系呢?

LiDAR都是根据发射光和反射光之间的飞行时间来直接估计目标距离(因为双目和结构光无论是距离还是精度和可靠性都无法应用在自动驾驶中),换句话说如果从测量原理来看所有的LiDAR都是ToF。那么,ToF LiDAR这种说法是不是重复概念呢?事实上,在LiDAR语境里的ToF传感器主要强调的是可以通过高密度ToF传感像素阵列来得到测量场景的高分辨率距离/深度分布,主要是与传统上只能获得低密度点云的线扫描式LiDAR作区分。

综上,当我们在说ToF LiDAR的时候,事实上我们指的是那些基于测量发射和反射光之间的飞行时间来获得高分辨率场景深度/目标距离分布的传感器。

按照测量的原理,ToF又可以分为iToF(间接飞行时间)和dToF(直接飞行时间)两类。这两类ToF又有什么区别呢?

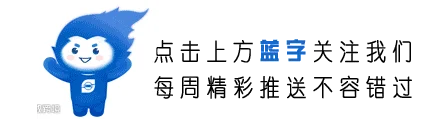

首先,从发出信号来看, dToF是单个脉冲, iToF多是正弦波。

iToF和dToF的信号模式

其次,iToF和dToF在sensor上有不小的区别:iToF目前更多是使用global shutter sensor或者是在这个基础上改进的专用sensor;而dToF则使用雪崩二极管的方式。

iToF原理示意图

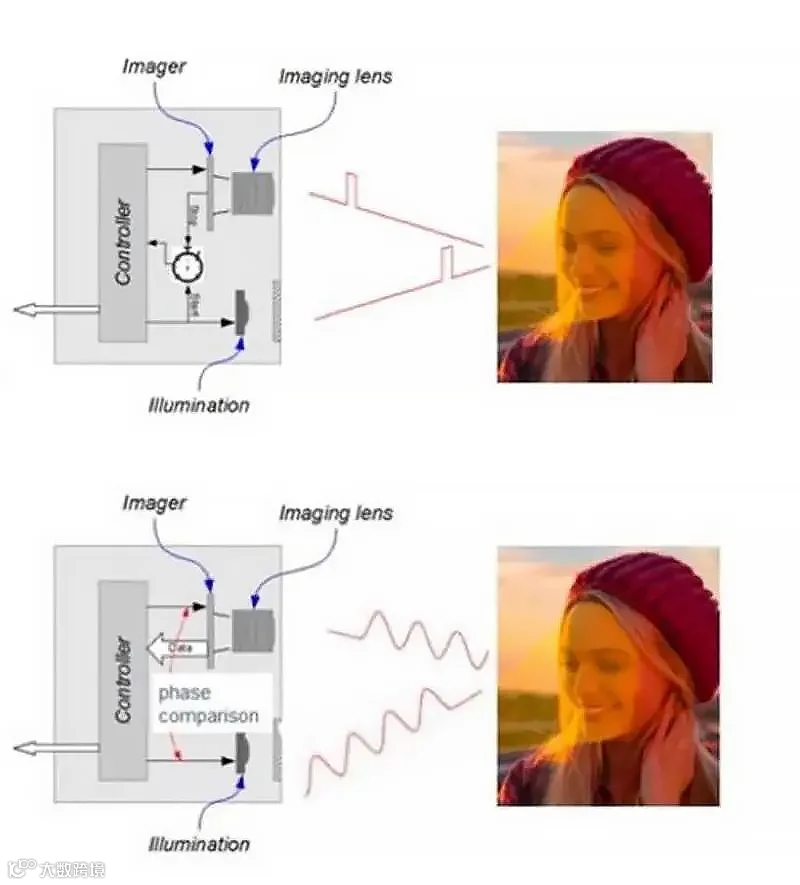

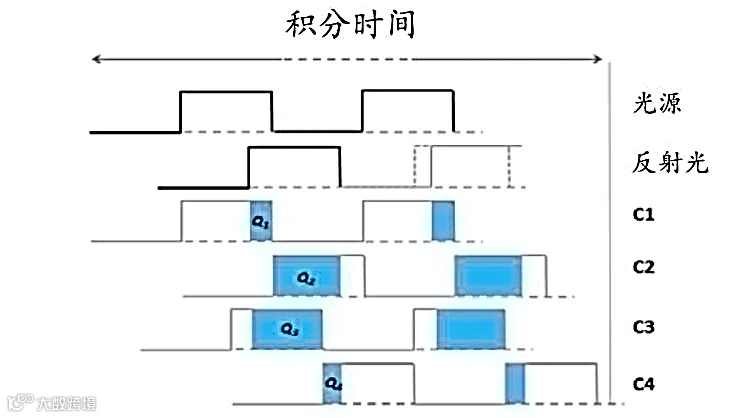

dtof原理

(该图缺少转换的TDC的器件,只做示意,今后会更详细的介绍SPAD技术)

再者iToF和dToF在算法上也有不小的区别,iToF的算法是基于正弦波的相位计算,一般需要使用多帧图像通过相位计算得到距离;dToF则通过像素的脉冲输出直接进行简单的模数转换就可以得到光子回来的时间和个数,这大大增大了侦测距离,减少了功耗和运算量。

其实dToF并不是第一次在消费类设备上使用,最早在手机上是在后摄的激光对焦和苹果Face id的测距使用的。以前dToF sensor的限制主要是来自于SPAD难以小型化导致sensor的分辨率很难提高,而这次苹果的dToF在这个上面是有所突破的,分辨率比之前设备上的dToF都要高。

由于采用dToF方法,iPad Pro背部的激光雷达将能解决直接测距面临的低时间分辨率难题,达ps(皮秒)级时间分辨率,精度也不会随距离拉远有大的衰减。换句话说,iPad Pro的ToF相机性能将提升的不是一点半点,它带来了一颗进化版的ToF镜头,AR体验的精准度、流畅度将大大提高,功耗也会大大降低。

同时有媒体大胆预测,苹果的规划应该是通过dToF激光雷达扫描仪和iPadOS软硬一体,把新iPad Pro打造成集开发AR和体验AR的工具。以此来吸引那些AR应用开发的程序员使用iPad Pro来进行调试和编写AR应用。进而将在今年下半年推出带有ToF功能的iPhone12, 苹果如意算盘应该是将iPad和iPhone组合起来,增强AR硬件和应用,逐步丰富苹果的AR生态。从苹果的产品来看,后置深度传感器的应用主要有三大方向。一是相机拍照优化,能使景深虚化、美颜等效果更好;二是AR体验,比如人物识别(比如视频直播中的应用)、MR游戏、体型测量、AR尺子、Emoji表情、三维建模、AR导航等;三是人脸解锁、手势操作等更复杂的功能。

未来,也将有越来越多的国内外高端机型厂商开始专注于3D摄像头进行动作识别和交互,并围绕这些智能硬件内嵌的3D摄像头进行研发,让更多用户直接通过智能硬件体验沉浸感更强的AR体感教育课程和体感游戏。3D摄像头等AR硬件尽快普及,将最大程度促进AR体感技术在教育、安防、游戏、医疗等领域的应用与发展。