阅读本文预计需要10分钟,欢迎任何意见、建议及收藏转发!

作者 - 独钓寒江雪

本期核心关键词 - AR眼镜“完全体”

欢迎回到第二期微纳市场,接上文,我们看到了Meta早已开始布局智能眼镜产品并已经取得了长足进步,但这距离真正的AR眼镜还相距甚远,至少,AR眼镜最基本的虚拟影像显示功能暂时还是缺失的。

点击下方,即可查看上篇稿件

延伸阅读:AR眼镜“完全体”应该是什么样的(上篇)

包括Meta、Apple、Google等科技巨头在内的业界头部企业坚信,可全天候穿戴的AR眼镜是下一代个人计算平台,人们与数字世界的互动界面将从现有的2D屏幕变为我们身边的3D世界。这意味着需要新的计算模式与互动模式:可识别情境、高度个性化、自然地互动。以使用者为中心的多模态“具身人工智能”(Embodied AI)是未来AR眼镜的大脑与灵魂,与此同时,这对硬件提出了更高的要求。

理想的“完全体”AR眼镜应该能够感知并理解使用者所处的情境,通过人的感官及肢体动作建立人与外部世界的互动,实时传递声音、影像等信息给使用者,实现真正的增强现实。

我们可以从Meta的Aria项目来管窥一下未来AR眼镜“完全体”。

《Aria AR眼镜爆炸图》

来源:Meta官网

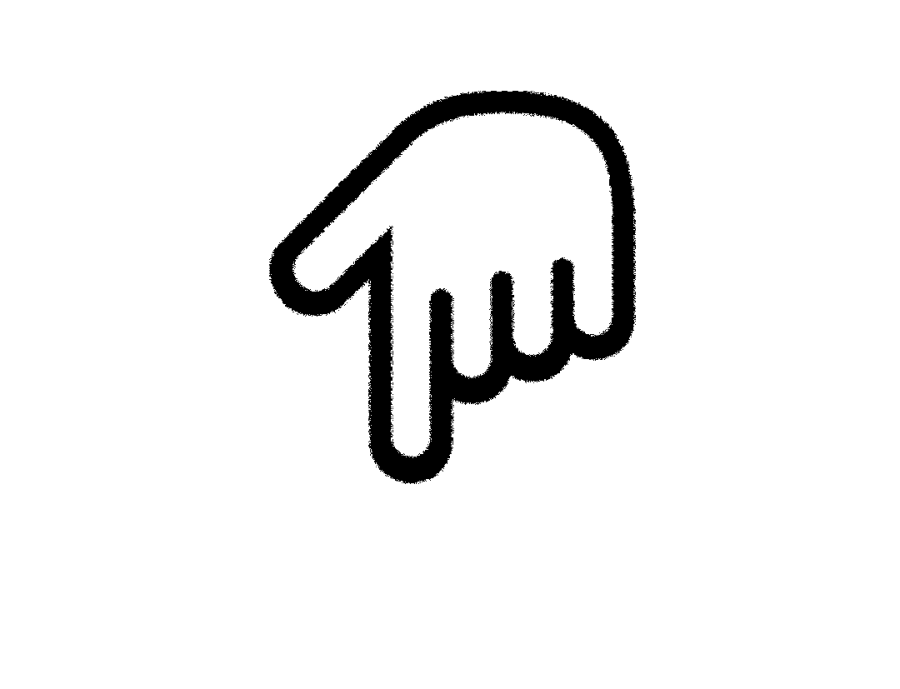

截止到本文发布的日期,Aria项目AR眼镜的主要配置(数据来源:Meta官网)如下:

光学传感器:

非光学传感器:

2颗惯性测量器(IMU)、7声道空间麦克风阵列、1个磁强计、1个气压计及温度计、1个全球导航卫星系统接收器(支持GPS与伽利略系统)、WiFi(2.4G及5G)、蓝牙

计算单元:

高通SD835芯片、4GB RAM、128G内存、闪存、安卓7.1 操作系统

以上硬件在机器视觉平台的支持下,通过软件调教,借助视觉惯性测程(VIO)以及即时定位与地图构建(SLAM)系统生成设备的轨迹信息实现头部6自由度(6DoF)、手势追踪、眼动追踪等功能。

其实,其中最为亮眼的升级项是Meta在新一代的智能眼镜上集成了自家的Meta AI助手功能。

AR眼镜的应用方向举例:

1)长周期建图与重新本地化

依靠SLAM实现精准6DoF本地化定位通常是很多应用的第一步,AR/VR上也是这样。但处于自然环境中时,光线、天气以及人类活动(道路、建筑等)会频繁地发生很大的变化,这需要实时地更新地图。有AI加持的AR眼镜便是很好的记录工具,可以轻松实现长周期的地图更新与重新本地化的功能。

2)以使用者为中心的场景重建并理解所处的场景

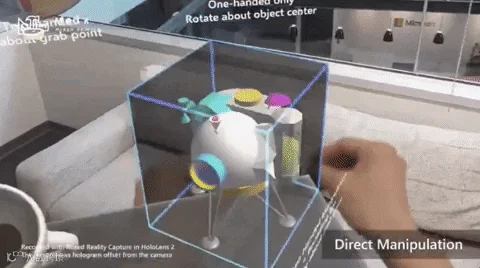

3)与虚拟对象互动、操控虚拟对象

《HoloLens 2 Hand Interaction on display》

来源:Microsoft官网

4)总结、问题解答

通过检测使用者的注视点、语音指令、手势活动等信息,结合AR眼镜所理解的情境,可以对长时间跨度的活动进行总结、对问题进行解答。

现有的Aria AR眼镜的总重量约为75克,很好地实现了人体工学要求,但其软硬件配置还不是理想的AR眼镜“完全体”状态。要达到理想的“完全体”,笔者认为至少还需要增加以下功能:

- 近眼显示(增加显示系统,如:波导+光机)

- 视力矫正(增加处方镜片,面向近视、远视人群)

- 遮光方案(增加电致/光致变色功能,以适应不同的光照环境)

- 深度检测(如dToF、结构光等,更好地构建3D环境)

- 生物识别解锁(如虹膜识别等)

- 具有5G甚至未来6G的通讯能力

受制于消费者/人类自身生理及物理条件的需求,最终的AR眼镜要美观、重量要轻、能耗要低、续航要久、功能要强大到能取代智能手机……

围绕上述的每一项需求都有着大量的技术、工艺及成本等方面的难题等着人们去克服,每一项的背后都有着大量的不同专业与行业的课题等着行业专家去攻克。

期待尽快能够与 “Orion”AR眼镜原型机(Meta计划在2024年公布)见面,同时期待这款原型机能够引领增强现实的发展向前迈出一大步。

未经授权,任何人或机构不得以任何形式或方式转载、摘编或引用本文中的全部或部分内容,感谢配合。