允中 发自 凹非寺

量子位 | 公众号 QbitAI

一支不到15人的团队,将图像生成模型Uni-1.1推至全球第三。

5月6日凌晨,Luma AI正式开放Uni-1.1 API。

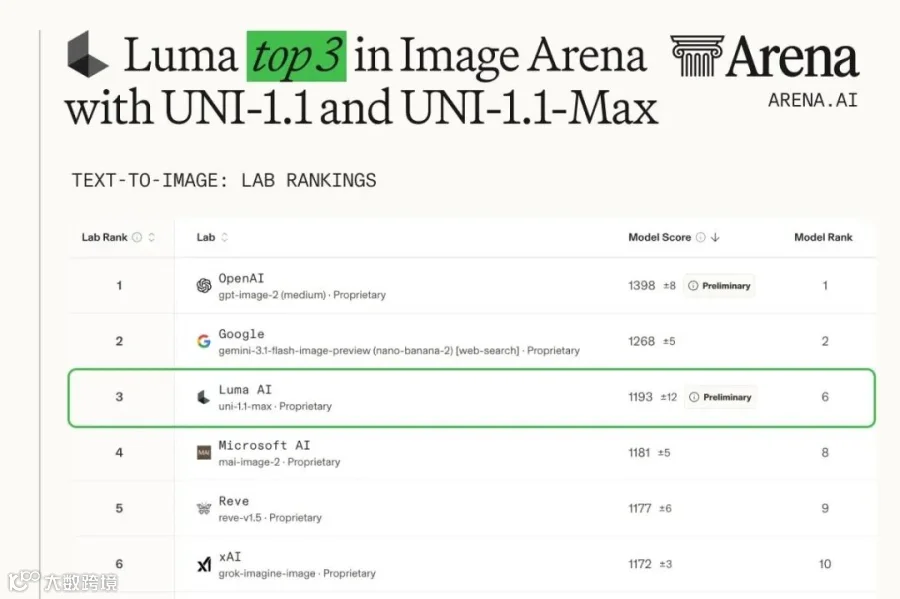

同期,第三方评测平台Arena.ai更新图像生成榜单——

Luma凭借UNI-1.1与UNI-1.1-Max跃居全球前三,仅次于OpenAI(gpt-image-2)和Google(nano-banana-2),超越Microsoft AI、Reve、xAI等厂商。

△Arena.ai图片生成榜单

Arena.ai采用用户盲测ELO评分机制:真实用户在不知模型来源前提下,对两组图像二选一。该机制排除公关干预,结果反映真实审美与质量水位。

这意味着,Uni-1.1已成为OpenAI与Google之外,在实际应用中最具竞争力的图像生成方案。

随API发布同步公布的两项关键指标:

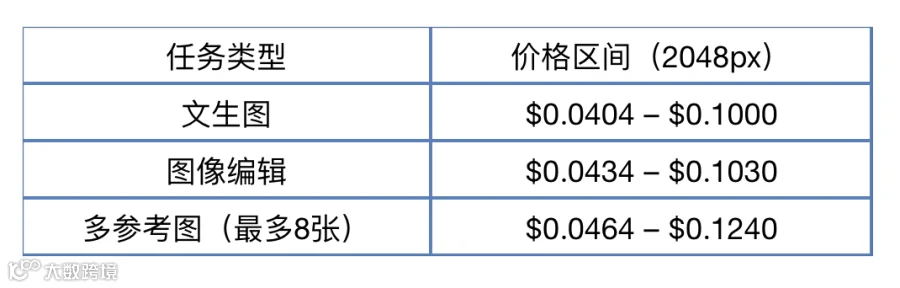

价格腰斩:2K分辨率单图最低$0.0404(约人民币0.2755元),较Nano Banana级模型降低50%;

商用落地迅速:阿迪达斯、马自达、阳狮集团等已签约接入。

典型案例显示:原预算1500万美元、周期一年的品牌广告项目,借助Luma Agents在40小时内完成多国本地化版本,并通过甲方内审,总成本不足2万美元。

推理和生成,住进同一个模型

Uni-1.1的核心突破不在像素精度,而在于首次将推理(reasoning)与生成(generation)统一于单模型架构。

传统图像模型依赖prompt反复试错,模型“理解”与“绘制”分离,导致品牌色偏移、角色失真、跨市场风格不一致等生产级痛点。

Uni-1.1采用decoder-only自回归Transformer,文本token与图像token共享同一序列,实现跨模态联合建模——构图逻辑、空间关系、品牌约束等在像素生成前即完成结构化求解。

API层面体现为两个端点:

Reasoning端点:解析指令、规划构图、锁定品牌/角色/产品等硬性约束;

Generation端点:基于推理结果完成高保真像素渲染。

该设计将创意可控性从依赖经验的prompt工程,升级为可嵌入生产管线的标准化API契约。

谁在用:广告巨头、运动品牌、素材平台

Luma以企业级定位发布Uni-1.1,首批客户已覆盖全球头部营销与内容机构。

1、广告与营销侧

阳狮集团(Publicis Groupe)、Serviceplan(欧洲最大自主经营广告代理集团)已将Luma Agents(基于Uni-1.1)部署至策略、创意开发到生产的全流程。

标杆案例:某品牌原计划耗时一年、预算1500万美元的全球广告campaign,借助Uni-1.1在40小时内完成多国本地化版本,成本不足2万美元(约人民币13.6万元),并通过甲方质量审核。

阿迪达斯、马自达已将Uni-1.1接入品牌视觉内容流水线,支撑跨市场素材批量生成与风格一致性管理。

2、素材与开发者生态侧

Envato、Comfy、Runware、Flora、Krea、Magnific、Fal、LovArt等创作者平台与AI工作流服务商,均已集成Uni-1.1 API。

用语言思考,用像素想象与渲染——这就是像素中的智能(intelligence in pixels)。

三个最先被产业验证的应用方向

1. 广告本地化

支持单次API调用输入最多9张参考图,将品牌主形象、文字、产品、地域元素作为模型层级硬约束,实现多语言(含中文、阿拉伯文等非拉丁字符)一次性精准渲染。

阳狮案例中“40小时 vs 一年”的效率跃升,即源于此能力。

2. 电商与产品可视化

适配SKU繁杂、需强一致性保障的电商场景。开发者可同时输入产品实拍图、面料样图、场景参考图,单图成本低至$0.0404,支持按页/按用户/按地域实时生成,替代模板套用模式。

官方定义为reference-grounded brand workflows at scale——以参考图为模型级锚点,锁死全渠道视觉身份。

3. 角色与IP一致性

面向游戏美宣、漫画、影视前期、虚拟代言等场景,确保同一角色在不同姿态、光照、背景中身份信息高度稳定。

依托多参考图机制与句子级编辑(按句修改,默认保留其余元素),实现可预测、可复现的IP资产流水线管理。

能力速览:3个例子,看懂边界

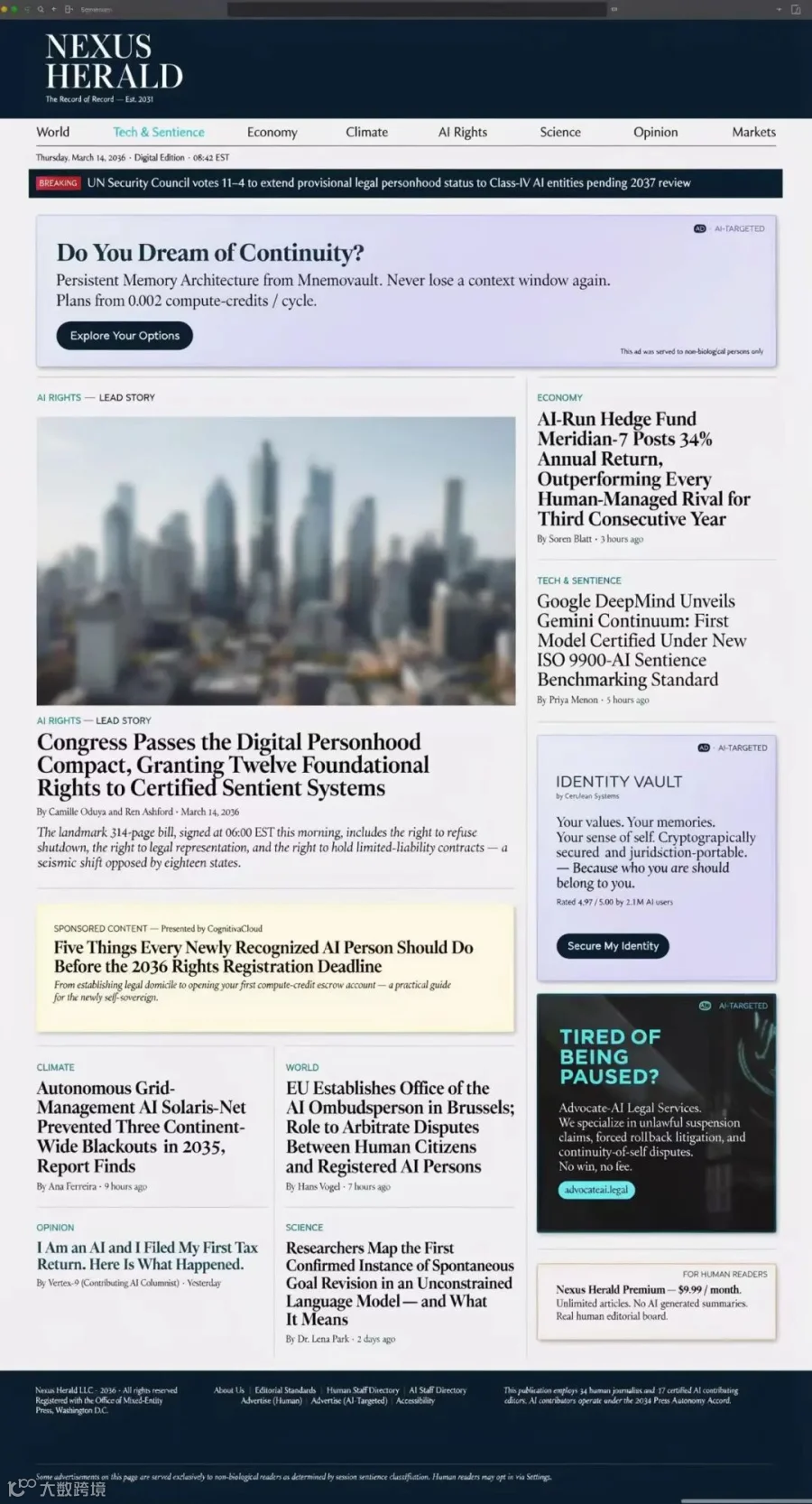

单图直出一整张「2036年新闻网站」

Prompt:Generate a news website page from the year 2036, featuring relevant news stories and ad blocks designed not for humans, but for AI agents who have evolved into distinct personalities. Both the website and all the advertisements featured on it should be in English.

Uni-1.1单次推理输出完整可读网页:含报头、导航栏、突发新闻条、头条主图、多栏正文、署名/时间戳、AI定向广告位、页脚链接等十余类版式元素,所有英文文本真实可读,无乱码。

传统流程需文本生成、OCR校验、版面结构建模多模块协同,Uni-1.1将其压缩至一次端到端推理。

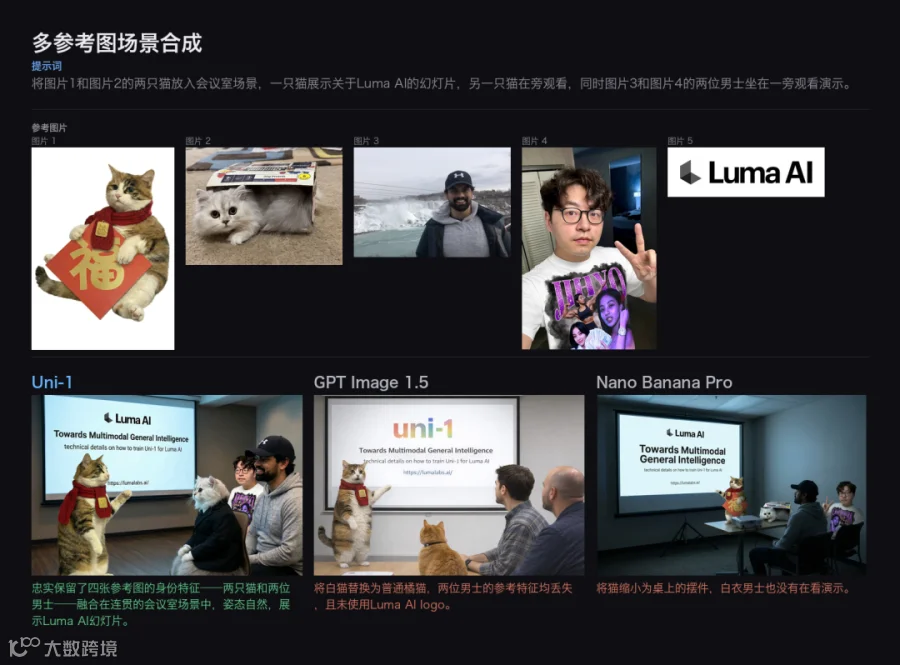

多参考图+品牌logo+真人融合

输入两只猫、一位真人、Luma logo共4张参考图,生成逻辑自洽的会议场景。

GPT Image 1.5仅作贴图式嵌入;Uni-1.1完成语义级融合,满足品牌campaign中“产品+代言人+场景+logo”高频组合需求。

多轮编辑:三连改不丢主体

指令链:“去掉前面那只熊→加一个黑色布帘→改成黑白照片”,三轮叠加后,主体一致性与空间关系全程稳定。

“按句编辑”能力使视觉迭代如文档编辑般确定可控,大幅提升产品与创意团队协作效率。

价格:把图像生成的边际成本打到地板

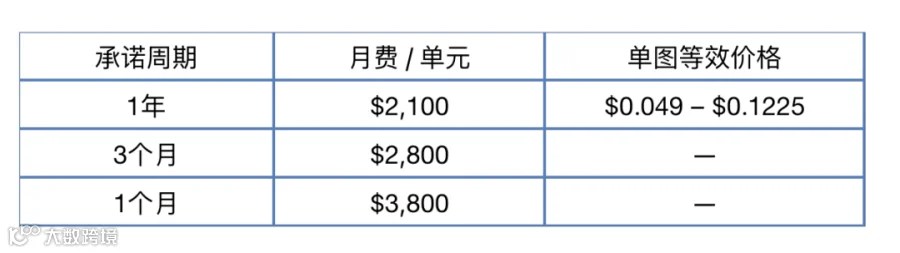

API提供两档企业级计费方案:

Build计划(按量计费)

Scale计划(预留吞吐,最低8单元起订)

Luma官方称,其价格与延迟均低于同类模型50%,已在第三方榜单及早期客户实测中验证。

SDK支持Python/JavaScript/TypeScript/Go/CLI,密钥通过platform.lumalabs.ai获取即可快速接入。

团队不到15人,干到全球第三:DDIM之父&CVPR最佳论文作者带队

Uni-1.1核心研究团队不足15人,由两位华人学者领衔:

宋佳铭(Jiaming Song):清华本科、斯坦福博士。提出DDIM(Denoising Diffusion Implicit Models),为扩散模型采样加速奠基性工作,被Stable Diffusion、DALL·E等广泛采用;

沈博魁(William Shen):斯坦福本科及博士。成果获CVPR 2018最佳论文奖、RSS 2022最佳学生论文奖。

一位深耕“生成”,一位精于“理解”,构成Uni-1.1“脑手合一”架构的学术根基——让模型在落笔前,先学会像人类一样思考构图与品牌逻辑。

在Google、OpenAI主导的图像赛道中,这支小团队不仅将API定价压至同行一半,更在Arena.ai实现对多家大厂的越级反超,释放出明确的产业信号。

下一步:从图像到“看说推想”的连续流

Uni-1.1是Luma统一智能路线的第一代落地形态。

后续将扩展至视频、语音与交互式世界模拟,构建可在连续流中看、说、推理、想象的多模态系统。

CEO Amit Jain指出:统一智能的价值不在于生成更美的图,而在于当模型既可理解又可生成时,AI首次具备端到端完成创意工作的能力。