在图像编辑领域,拖拽式编辑以其直观性和便捷性深受用户喜爱。然而,随着深度学习技术的发展,尤其是Diffusion Transformer(DiT)架构的兴起,传统的拖拽式编辑方法面临着新的挑战。

今天,我们为大家介绍一项前沿研究——DragFlow,这是首个基于 DiT 架构的图像拖拽编辑器。它利用 FLUX 的强大先验信息,通过一种新颖的基于区域的范式实现了高质量的拖拽编辑,并在图像拖拽编辑基准测试中取得了新的 SOTA 成绩。

相关链接

-

论文:https://arxiv.org/abs/2510.02253 -

源码:https://github.com/Edennnnnnnnnn/DragFlow -

项目:https://huggingface.co/datasets/Edennnnn/ReD_Bench

论文介绍

拖拽式图像编辑允许用户通过简单的拖拽操作实现图像内容的精准操控。然而,传统方法多基于UNet架构,如Stable Diffusion,存在先验能力不足和架构不匹配的问题,导致编辑后的图像出现扭曲、模糊等失真伪影。随着DiT架构的兴起,其强大的生成先验为解决这些问题提供了可能,但如何将传统拖拽策略迁移到DiT架构上并有效提升性能,成为了一个亟待解决的问题。

方法概述

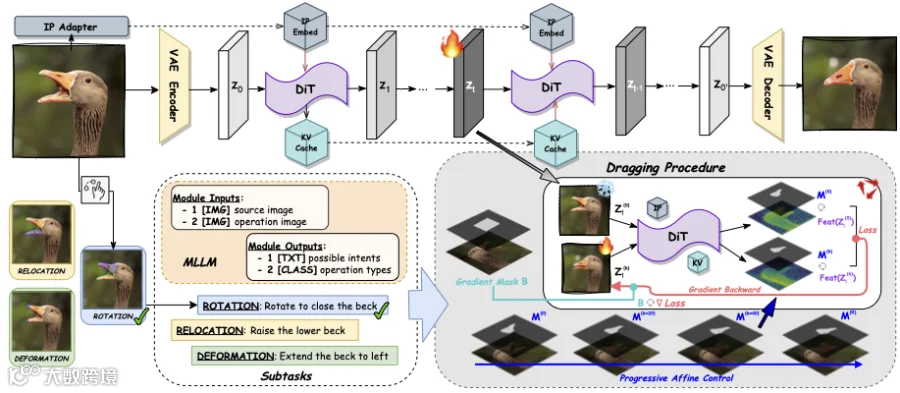

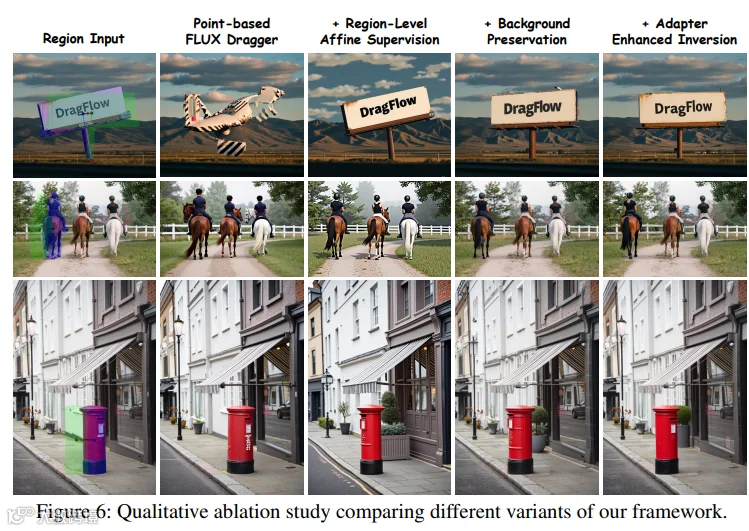

区域级仿射监督:

-

核心思想:摒弃传统的“逐点追踪”思路,采用区域仿射变换作为监督信号,为DiT提供更丰富、更稳定的梯度信号。 -

实现方式:将用户指定的源区域作为一个整体,通过仿射变换逐步移动到目标位置,同时优化噪声化的潜在向量,使变换后的目标区域特征与源区域特征保持一致。

适配器增强的反演:

-

目的:提升在CFG-distilled模型(如FLUX.1)上的主体一致性与反演保真度。 -

实现方式:集成预训练的IP-Adapter等特征提取与适配器,通过额外注入ID Embedding来增强反演效果。

硬约束背景保持:

-

目的:避免背景污染问题,保持背景不变。 -

实现方式:通过自适应梯度掩码对背景非编辑区域施加硬性保护,直接将背景区域的潜在向量重置为原始未编辑分支的值。

实验论证:

-

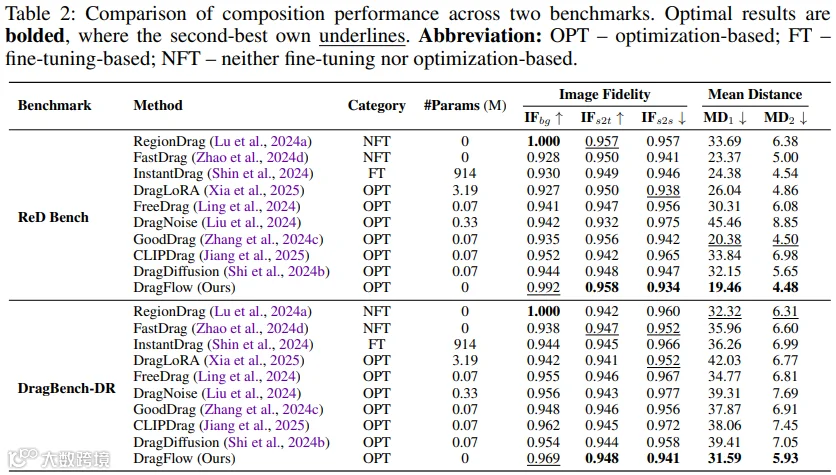

数据集:构建了新的区域级拖拽基准ReD Bench,包含120个样本,每个样本都有精确的拖拽指令和意图标签。同时,在现有的DragBench-DR上进行了兼容测试。 -

评估指标:采用平均距离(Mean Distance, MD)和图像保真度(Image Fidelity, IF)等指标进行评估。

实验

-

定量分析:DragFlow在基于两大基准的多个指标上取得了最佳表现,MD指标显著降低,IF指标名列前茅。

-

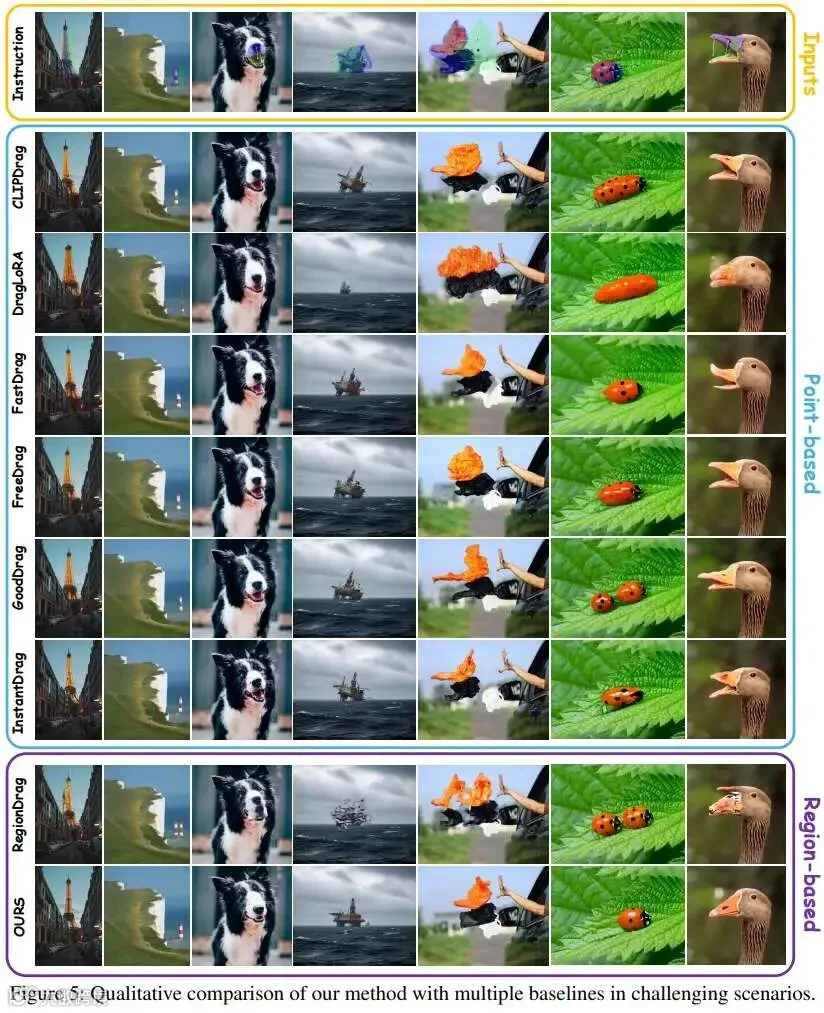

定性分析:无论是复杂的结构、非刚性形变还是精细内容,DragFlow都能精准地执行拖拽指令,同时保持场景的整体连贯性和真实质感。

结论

DragFlow作为首个基于DiT架构的图像精确区域编辑框架,通过区域级仿射监督、适配器增强的反演和硬约束背景保持等创新方法,成功解决了DiT架构下的编辑难题。实验结果表明,DragFlow在各项指标上全面超越现有方法,为拖拽式图像编辑领域树立了新的标杆。未来工作将进一步优化算法效率,探索更多应用场景,推动DiT架构在图像编辑领域的广泛应用。

感谢你看到这里,添加小助手 AIGC_Tech 加入官方 AIGC读者交流群,下方扫码加入 AIGC Studio 星球,获取前沿AI应用、AIGC实践教程、大厂面试经验、AI学习路线以及IT类入门到精通学习资料等,欢迎一起交流学习💗~