编者按:上篇文章16万个喇叭?拉斯维加斯巨型球Sphere背后的听觉秘密武器(一)分析了巨型球Sphere内的声音设计为什么很难,接下来看看难题是如何被克服的!

秘密武器:Holoplot X1 波场合成

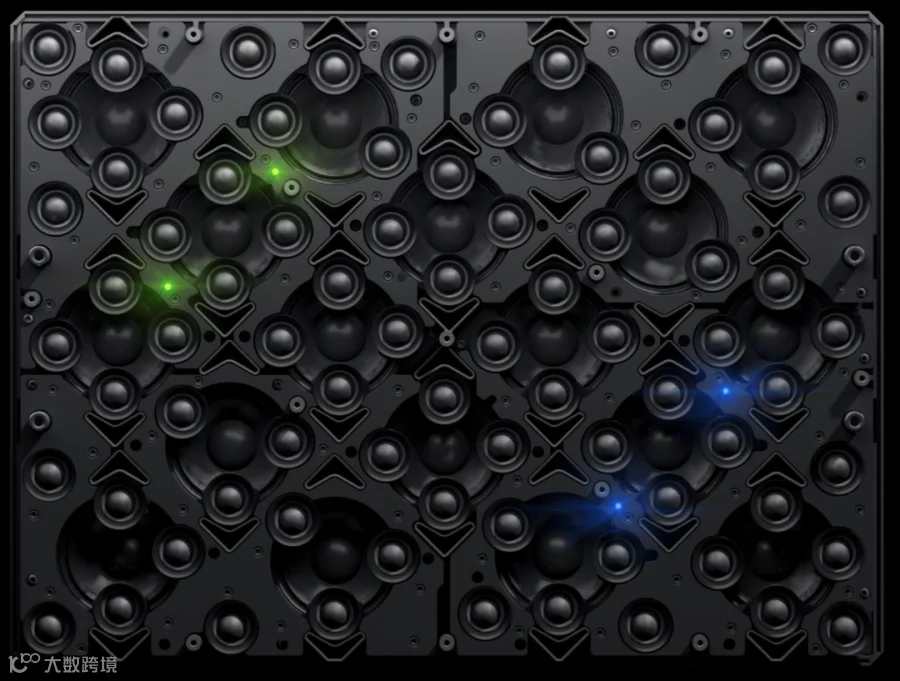

上文提到的拉斯维加斯巨型球声音控制的难点,总结下来就意味着需要一套能自由控制声波束传播方向和覆盖形状的系统,还需要能实现多通道环绕声或其他沉浸式音频。解决方案就是由德国柏林Holoplot公司研发的基于波场合成技术(Wave Field Synthesis) 实现了软件层面可控的波束导向 (Beam Steering)的X1 可拓展式矩阵音响系统。波场合成技术是一种重建音源空间位置的技术,基础原理是惠更斯-菲涅耳原理(Huygens-Fresnel Principle),通过对多个驱动单元的相位,延时和增益形成多个“小波前”,再叠加形成统一的声场,从而营造出与扬声器位置有区别的听觉定位。下图是单个X1-MD96模块,由96个高频和低频驱动单元组成。每个单元都有一个独立的信号处理通道,并由音响背后的嵌入式系统提供处理需要的参数,从而实现波场合成的波束(Beam)。

图自:holoplot.com X1-MD96 Module

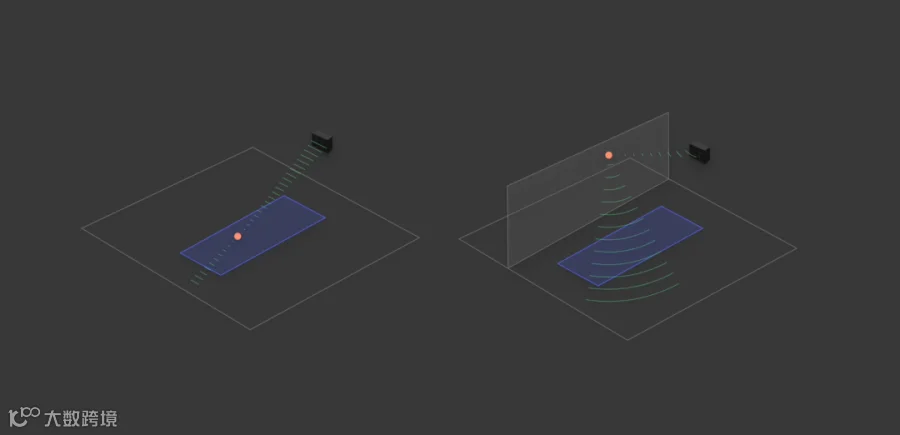

这技术不仅能模拟出音源的控制感,还意味着系统能控制某个空间点所应该呈现的听觉效果,比如某一个观众的耳朵的位置。如果把这个单一点拓展到多个点,则能控制一个面或区域所需要实现的效果。这就是该系统能实现声音控制的核心之一。

图自:holoplot.com 虚拟点音源空间位置的重塑

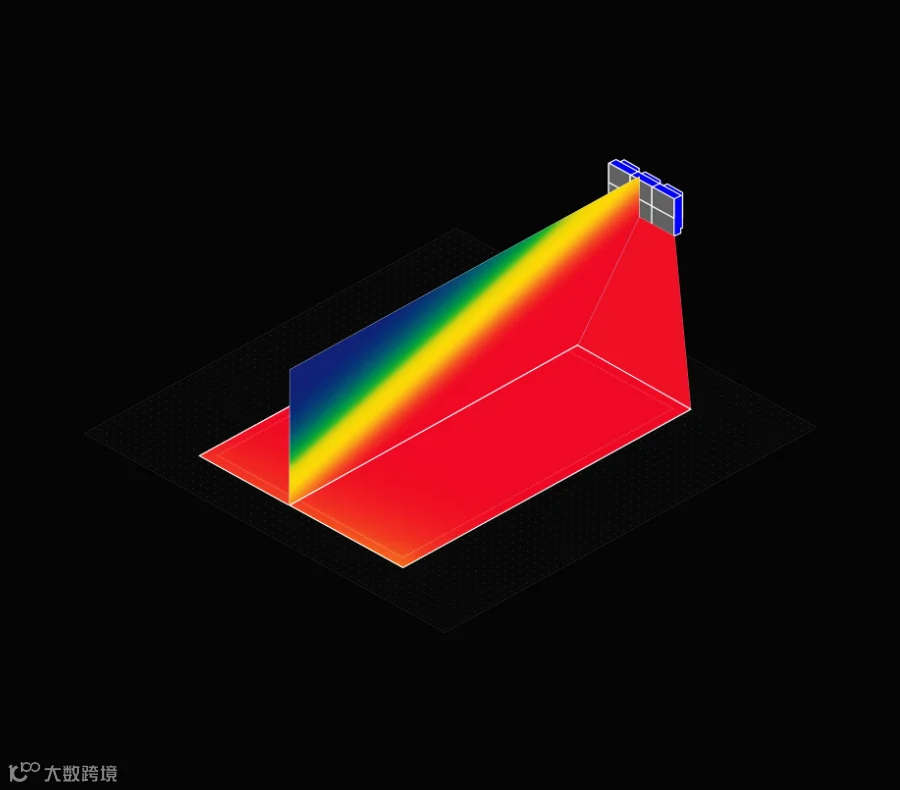

基于上述,再通过矩阵形式由水平和垂直方向叠堆音响模块,则可以让系统实现可拓展性,并可以根据需要,对不同形状大小的区域实现精准的控制。如下图所示,有一组模块形成的矩阵可以对一个区域实现高度一致的声压控制。

图自:holoplot.com 矩阵模式的区域覆盖效果

1. 透声屏幕+后置音响

这种以软件控制为核心的波束控制是解决Sphere声学难题的核心。这代表,音响能够被布局在屏幕背后,然后再通过软件来实现对多个观众区域的进行覆盖和音质优化。Sphere的LED屏幕由约6.4万块面板组成。其特别之处是它们具备透声性。

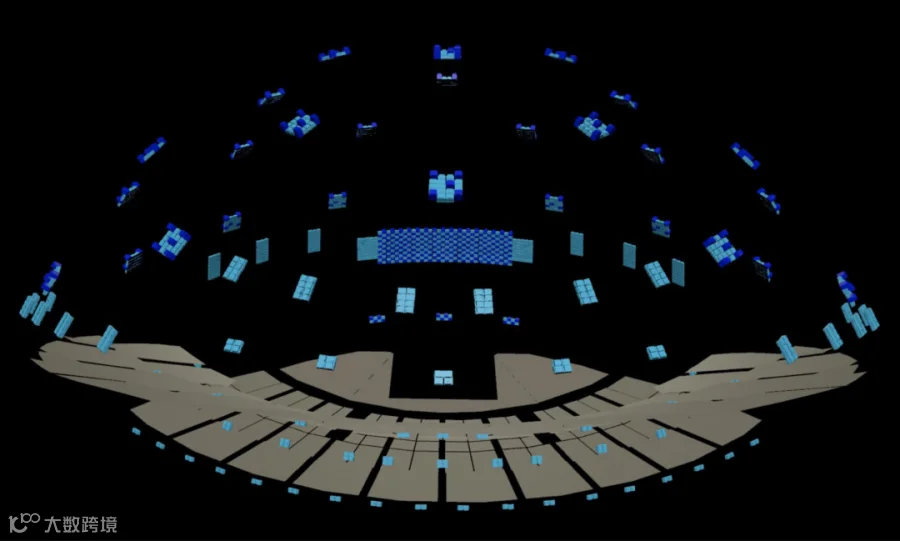

下图就是Sphere的音响系统覆盖示意图。我们能看到除了舞台背后一个主矩阵(Proscenium Array)外,在整个球面各个方位都布置了多个X1小型矩阵。这些模块都被藏在了屏幕后面,不会影响观影感受。

图自:holoplot.com Sphere的X1覆盖系统设计图

2. 多种波束控制

X1通过使用三种不同的波束算法实现覆盖和优化:

-Coverage Beam

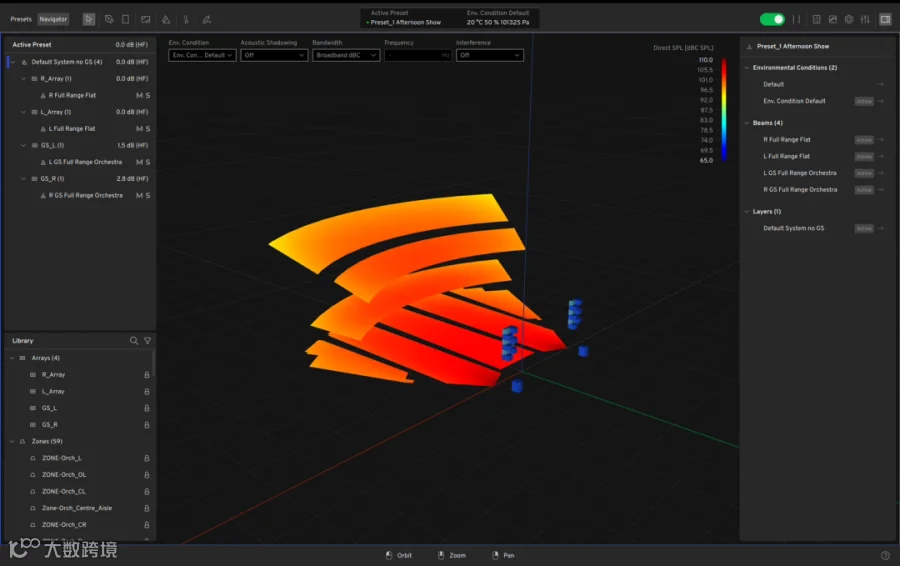

可在软件中定于所需要覆盖的区域形状,算法则会根据该区域进行运算得到优化效果所需要的对每个驱动单元所需要的信号处理参数。

下图是Holoplot的系统设计软件Plan,图中可以把一个场地根据实际的观众席分成了多个目标区域(Target Zone), 而颜色的分布则是声学模拟后得到应有声压分布图(SPL)。针对某区域的优化也意味着区域外能量的衰减。这种衰减可以很大程度减少声音在建筑面的反射,从而提高了清晰度。

值得额外一提的多个区域的独立广播还能激发一些有趣的应用,比如场地可以根据观众的语音分区,那么在同一时间,不同语音偏好的观众都可以根据自己的语音去体验一场电影或活动。

-Parametric Beams

更接近传统的的阵列音响的指向性beam,波束的指向(即垂直/水平转向角)和宽度(张角)都可以在软件里定义。比更轻量化更容易计算的,每个矩阵群可以同时生成更多的波束。

-Virtual Source

虚拟点音源能把音源放置在空间任何一个位置,可以通过它实现对象音频(Object-based audio)的空间音频实现。为于许多沉浸式体验场景提供了听觉上的身临其境的体验可能性。

图自:avinteractive.com Illuminarium会馆的森林探险体验配合Holoplot X1的空间音频技术

3. 解决大场地的sweet spot问题

如果靠传统 7.1 或 5.1 环绕,只要场地一大,除了中央区域外,其他观众往往感受不到真正的环绕或会有明显的声道失真。而波场合成可将大场地细分为多个小覆盖区,每个区域都能经过精确的延时、相位、EQ 调校,从而“人人都有甜点区”

如何处理这么庞大的信号量

Sphere的演出声音设计也是极为复杂,这衍生出数百甚至上千个独立音频通道,那又是如何保证传输的呢?若采用传统的模拟或点对点数字音频传输,线量将极为庞大,还要进行繁琐的延时补偿,随之而来的也是复杂的运维成本,和极高的排障难度。

为了解决这些问题,Sphere和Holoplot采用了基于开始式AoIP(Audio Over IP)的AES67/Ravenna协议。这是一种通过互联网协议的媒体传输方式。通过把把音频信号及信号的相关信息打包成网络数据包,就可以在以太网上进行超低延时,多通道的实时传输。通过定义音频参数如比特率,采样率等,配合PTP(Precision Time Protocol)进行高精度时钟同步和多播(multicast),上百个音频通道可仅通过一根RJ45网线和交换机就能实现极低延时音频数据实时广播。

网络音频还有一个非常重要的好处就是可以高效得实现冗余。只需相对简单的布置就是完全布置一套备用的局域网给备用音频。通过软件控制,如果在现场出现某种故障时也可以很快得切换到备用通道,保障演出的顺利进行。

结语

Sphere将球型建筑与大规模LED屏幕结合,对音响系统提出了独特的挑战:

如何能让扬声器“消失”在视觉中?

如何在球体内部客服电话反射和聚焦?

如何让每一层观众都获得的一致的声音体验?

如何在两万人的空间里实现沉浸式的立体声?

Holoplot 的波束合成方案结合网络音频标准,既满足了这些苛刻的覆盖要求,也打开了更多艺术创新的可能性。除了常见的环绕声,杜比全景声(Dolby Atmos)与对象音频,还可做多语言广播、多区域差异化播放等有趣尝试。因为此文的主要目的是介绍声音控制的基础需求,这里不对其他方面的应用和技术逐一介绍了。

感兴趣的读者推荐一篇文章关于U2的主FOH工程师Joe O’Herlihy和制作人Steve Lilywhite如果利用此系统实现更具艺术性的混音设计,例如将The Edge的吉他效果通道投向穹顶, 借助建筑的自然反射营造更宏大的音色。详见:《Mixing U2’s Mighty Sound for the Sphere》https://www.mixonline.com/live-sound/venues/mixing-u2s-mighty-sound-within-the-sphere。

其实再往深一点也还有许多其他难题,比如频段波长导致的指向性区别,系统冗余的具体实现,庞大信号处理的实现,第三方音响系统(如VIP室)的Downmix等,这里同样不一一列举了。

今年后街男孩也会登场Sphere,相信他们也是无数我们这些7,8,90后们的音乐启蒙之一。最后祝福所有能去现场体验的朋友, 走一趟回忆大道。

作者简介:杨佳俊,毕业于英国约克大学音乐科技博士,随后加入德国比勒菲尔德大学的Ambient Intelligence小组从事Sonification 方向的博士后工作。2020年加入Holoplot的软件组,热爱编程和音频技术,熟悉AES67和Dante网络音频,最近也随大流掉入Rust坑。