音乐结构分析(MSA)作为能够识别音乐作品中具有功能性意义的段落(如前奏、主歌、副歌)并精准检测其边界的关键技术,正在成为音乐理解和可控音乐生成的重要基础。然而,现有的MSA方法通常会因训练数据的限制、标注不一致、依赖复杂预处理流程等原因而在泛化能力和标注效率上受到限制。

近期,西北工业大学音频语音与语言处理研究组(ASLP@NPU)联合香港科技大学、美国西北大学、康奈尔大学以及M-A-P,开源了一个音乐结构分析模型SongFormer,该模型通过融合不同时间粒度的自监督音频表示,并引入可学习的数据源嵌入,在音乐结构分析任务中取得了当前最优的严格边界检测性能(以HR.5F指标衡量),并实现了当前最优的功能标签准确率。鉴于在音乐结构分析方面缺乏大规模的训练数据以及统一完备的测试集,我们同时发布了两个数据集:训练集 SongFormDB,包含超过一万首多语言、多流派歌曲的大规模训练数据集;以及高质量评估集 SongFormBench,包含300首由专家标注并验证的歌曲数据。

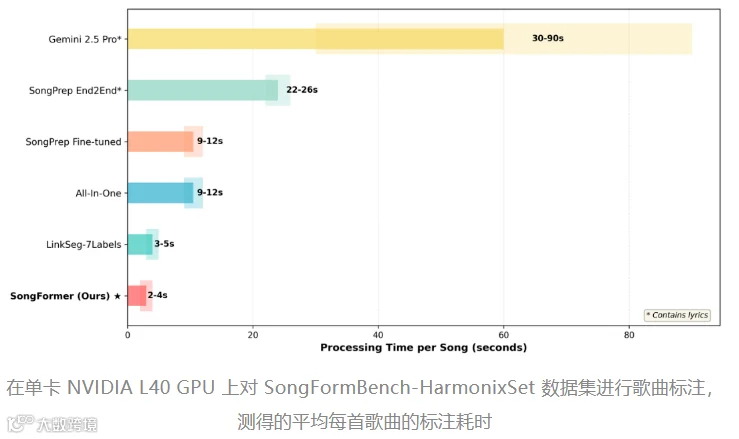

与此同时,SongFormer 在易用性与推理速度方面实现了双重突破!提供灵活多样的部署方式,包括 Hugging Face Spaces 在线体验、Hugging Face Model 即插即用,以及本地多进程标注等。我们在单卡 NVIDIA L40 GPU 上对 SongFormBench-HarmonixSet 中的 200 首歌曲进行了标注测试(排除模型加载时间),结果显示SongFormer 平均每首歌的标注耗时仅需 2 至 4 秒,高效实用。技术报告已公开,现对方案进行简要解读。

论文题目:SongFormer: Scaling Music Structure Analysis with Heterogeneous Supervision

合作单位:香港科技大学、美国西北大学、康奈尔大学、M-A-P

作者列表:郝春博*, 袁锐斌*, 姚继珣, 邓棋心, Xinyi Bai, 雪巍, 谢磊†

在线体验: https://huggingface.co/spaces/ASLP-lab/SongFormer

论文预印版: https://arxiv.org/abs/2510.02797

Github: https://github.com/ASLP-lab/SongFormer

Hugging Face: https://huggingface.co/ASLP-lab/SongFormer

SongFormDB: https://huggingface.co/datasets/ASLP-lab/SongFormDB

SongFormBench:https://huggingface.co/datasets/ASLP-lab/SongFormBench

论文预印版截图

扫码看论文

背景动机

音乐结构分析(MSA)旨在将一首歌曲划分为具有功能性意义的部分(如前奏、主歌、副歌)并检测其边界,是音乐理解和可控生成的基础技术。随着音乐生成系统的快速发展 [1, 2, 3],利用 MSA 作为结构先验变得愈发重要。目前,MSA 通常被视为一种时间序列标注任务,但现有方法在性能和泛化能力上仍存在明显不足。现有的公开音乐数据集稀少且差异性大,样本数量有限(例如 HarmonixSet 仅有 912 首歌曲),标注标准和格式不统一,获取受限,导致许多研究基于小规模数据训练模型,泛化能力受限。从方法上看,许多系统仍是从零开始训练,而非利用强大的自监督或音频基础模型,一些流程还依赖于复杂的预处理步骤如节拍追踪和音源分离,提升了系统复杂性,限制了扩展性。尽管通用的多模态大语言模型(如 Gemini 2.5 Pro)也能生成音乐结构标注,但其时间分辨率较低,难以精确检测边界,且存在标注对齐和格式问题。为此,我们提出了 SongFormer,这是一种简单且可扩展的框架,能够利用异构监督信息并保持高时间精度。SongFormer 融合了来自 MuQ 和 MusicFM 的短窗口(30 秒)与长窗口(420 秒)自监督音频表示,以同时捕捉细粒度和长距离依赖关系,并引入了可学习的来源嵌入(source embedding)以考虑不同数据集的来源信息,使其能够在部分标注、含噪声或标注规范不一致的数据上有效训练。为了支持模型的大规模训练与公平评估,我们还发布了包含超过 1 万首曲目的大型多语言多流派音乐库 SongFormDB,以及由专家验证的 300 首歌曲评估集 SongFormBench。实验结果表明,SongFormer 在 SongFormBench 上实现了当前最优的严格边界检测(HR.5F)和最高的功能标签准确率,超越了多个强基线方法和 Gemini 2.5 Pro,同时保持了较高的计算效率。

模型架构

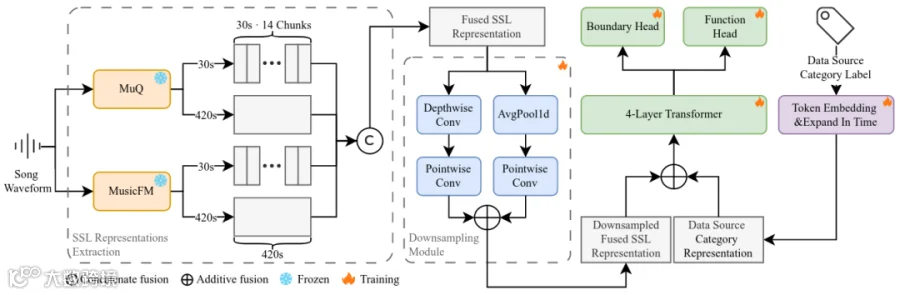

SongFormer 的核心思想是通过融合不同尺度的自监督学习(SSL)音频表征,在统一框架下实现高精度音乐结构分析。其整体流程包括多尺度表示融合、异构监督学习、以及两个任务头分别进行边界检测和功能标签预测。

图1 SongFormer 总体架构

首先,SongFormer 使用预训练的 SSL 模型(MuQ 和 MusicFM)从输入音频波形中提取多尺度表示。原始音频以 25Hz 的采样频率提取自监督表征,随后通过一个残差下采样模块,将其时间分辨率降至约 8.33Hz,提高计算效率。为了支持异构监督训练,模型引入了一个可学习的“数据源嵌入”向量,标记训练样本的来源。这样,模型能够学习不同数据集的标注风格和噪声模式,从而提升泛化能力。相加后的表示输入至一个 4 层的 Transformer 编码器中,采用 RoPE 位置编码建模时间依赖关系。最后,Transformer 输出通过两个任务头分别输出二分类边界检测结果和多类别功能标签。

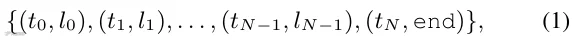

在边界检测任务中,原始 logits 经过 sigmoid 函数转化为概率分数,通过局部最大值滤波选取候选边界峰,并利用峰值选取算法将帧级边界转换为时间戳,实现歌曲分段。对于每个分段,则在其所含帧的功能标签概率中取均值,选择最大均值对应类别作为段落标签。最终输出为格式化的结构标注列表,形如:

SSL 表示的融合——SongFormer 同时提取局部(30 秒)和全局(420 秒)特征。具体来说,对连续 14 个 30 秒片段提取局部特征,并拼接成 420 秒长度,与全局特征对齐。随后在特征维度上融合,并将 MuQ 与 MusicFM 的表示进一步融合。这一多分辨率策略在保留局部细节的同时,也捕捉了音乐的长结构依赖关系。为了提高效率,融合后的特征通过一个双分支下采样模块进一步压缩,包括深度可分离卷积和平均池化卷积分支,最后通过逐元素相加合并,在保持关键信息同时将时间分辨率降低为原来的三分之一。

异构监督策略——为了解决训练数据标注不一致的问题,SongFormer 引入了异构监督训练策略。通过统一不同数据集的标签方案,并引入数据源嵌入,模型能够学习不同数据源的标注习惯和噪声情况。在推理阶段,统一使用高质量的 HarmonixSet 标注作为数据源类别,以提高结构分析的准确性和稳定性。

训练目标——SongFormer 采用帧级处理方式,并通过两个任务头分别优化边界检测和功能标签预测。边界检测任务采用二分类交叉熵损失(BCE)并引入时间平滑性约束,使用一种边界感知的一维总变分损失(TV Loss),权重根据是否处于真实边界区域自适应调整,避免过平滑。功能标签预测使用帧级别的交叉熵损失,并采用 softmax focal loss 强调预测不确定的帧,提升模型鲁棒性。总损失为边界与功能目标的加权和,参数通过经验设定控制各部分权重。此外,为了适应不同数据集的特点,模型还引入了帧级别的损失掩码,在特定数据集中仅对有效区域计算损失(如在 SongForm-Hook 中只在有边界延展 5 秒的区域计算功能标签损失,在 SongForm-Gem 中忽略边界损失),进一步提升模型在复杂标注环境下的训练效果。

综上,SongFormer 通过融合多尺度 SSL 表示、引入数据源嵌入支持异构训练,结合高效且合理的训练目标和损失设计,实现了在大型异构数据上训练的音乐结构分析模型,能够精确检测边界并准确预测功能标签,具备良好的泛化能力和计算效率。

数据集

我们采用了 [4] 中的映射规则,并保留了前副歌标签以更好地刻画音乐结构之间的过渡关系。为了进一步缓解训练数据不足的问题,我们构建了 SongFormDB —— 一个大规模的带标注的歌曲数据库;以及 SongFormBench —— 一个配套的高质量基准测试集。具体来说,从 HarmonixSet 中的 912 首歌曲中,我们随机选取 512 首用于训练,200 首用于验证,剩下的 200 首则经过人工精细标注,形成了 SongFormBench-HarmonixSet。数据划分信息在发布时一并提供,以确保实验的可复现性。

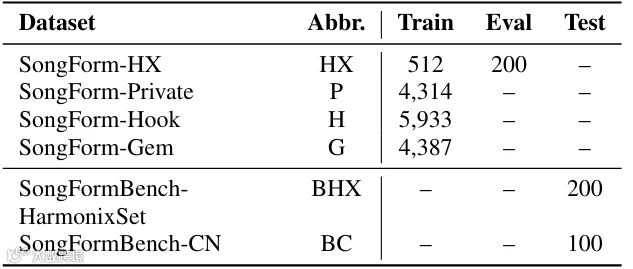

表1 数据集统计。上半部分为 SongFormDB,下半部分为 SongFormBench。在 SongForm-Hook 中,仅有小部分歌曲片段被标注

SongFormDB

该数据库由多个子集组成,包括 SongForm-HX、SongForm-Private 和 SongFormGem 等。SongForm-HX 是通过对 HarmonixSet 的官方音频进行重建得到的,使用了 BigVGAN [5] 这种基于 Mel 频谱图的声码器,并基于 1,300 首内部歌曲数据进行训练。这一处理步骤避免了使用 DTW [6] 算法对 YouTube 音频进行对齐时可能产生的不匹配问题。接着,我们通过基于规则的方法(如音频活动检测)对音频的结构标注进行了优化和修正。

SongForm-Private——最初包含 6,000 首歌曲,标注来源于歌词数据,但未涵盖无歌词部分的结构信息。我们使用 SOFA 工具(Singing-Oriented Forced Aligner)修正了时间戳对齐问题,并剔除了存在较大对齐偏差的样本,最终保留了 4,314 首对齐良好的歌曲作为训练数据。随后,我们利用在 SongForm-HX 上训练出的 SongFormer 模型为 SongForm-Private 生成伪标注(pseudo annotations),并通过这些伪标注对其进一步优化。

SongForm-Hook——包含 5,933 首歌曲,具有较为准确的结构标注,但只覆盖歌曲的部分片段,标注片段可能是连续的也可能是非连续的。

SongForm-Gem——经过采样后来源于多种语言的歌曲集,覆盖 47 种语言,节奏上按照每分钟节拍数(BPM)划分为 10 个区间以确保平稳节奏分布,并涵盖了广泛的音乐风格。标注数据由 Gemini 2.5 Pro 的 API 生成,在自动清洗之后,保留了格式正确、时间顺序合理和总时长正常的 4,387 条结构标注。虽然其边界检测颗粒度较粗,但仍然具有较高的准确性和良好的泛化能力。

SongFormBench

为实现公正且严格的评估,我们引入了高质量的基准数据集 SongFormBench,涵盖 200 首从 HarmonixSet 中精选的歌曲和 100 首中文歌曲。这些标注经过专家仔细审校,标注人员结合音频、原始标签、Gemini 2.5 Pro 的输出及来自 MusixMatch 和 Genius 的歌词信息进行交叉验证,最终形成标注作为真实标签(ground truth)使用。这种多源验证方式确保了标注的准确性和一致性。

此外,SongFormBench 补足了多语言结构分析任务中中文歌曲数据稀缺的问题,并为不同模型提供了一个统一的评估基准,推动了标准化、可比性强的评估机制的发展。

实验

评测指标主要包括:

HR.5F,在 0.5 秒范围内边界检测正确的 F 值;

HR3F,在 3 秒范围内边界检测正确的 F 值;

Accuracy(ACC),衡量逐帧功能标签预测的准确率。

实验设置

实验设置方面,训练使用 SongFormDB 数据集,测试则采用 SongFormBench。每首歌曲在预处理时最多截断到 420 秒,或保留其原始长度。我们使用高斯核对边界进行平滑处理,核长度约为 2.4 秒,对应每帧采样率为 8.33Hz。

SongFormer 采用 4 层的 Transformer 结构,隐藏层大小为 512。训练中使用余弦学习率调度策略,峰值学习率为 1e-4,经历 300 warm-up 步后,在 12000 步后逐渐降至 0;若在多次验证集测试的 HR.5F 或 ACC 未提升,则触发早停。所有实验在 NVIDIA L40 GPU 上进行三次随机种子重复,最后取平均值。在评估时,将模型预测归一化至七类标签(包括将 pre-chorus 归为 verse),部分基线模型则沿用原始论文中的结果(标记为⋆)。对于 All-In-One 模型,我们将 start/end 归为 silence,break/solo 归为 inst。LinkSeg 则使用其七类别模型进行推理。Gemini 2.5 Pro Preview 则生成结构化注释用于评估,在部分预测结果中出现短暂边界间隙时,我们将后续段落的起点作为前一个段落的边界进行修正。

主实验

主实验结果表明,SongFormer 在两个测试集 SongFormBench-HarmonixSet 和 SongFormBench-CN 上均优于所有基线模型。

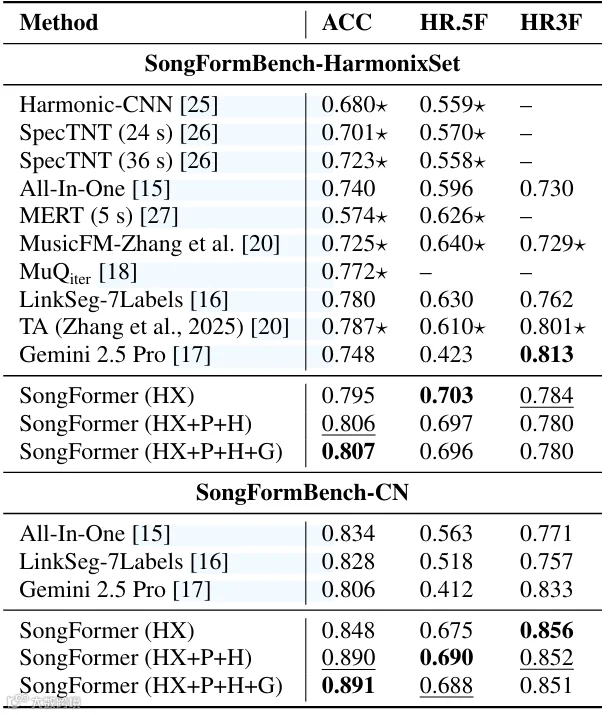

表2 模型在 SongFormBench 上的性能。* 表示来自原始论文的结果;(HX, P, H, G) 表示表 1 中的训练数据集

在 SongFormBench-HarmonixSet 中,SongFormer(HX+P+H+G)达到了最高的 ACC(0.807),优于 TA(0.787)和 LinkSeg-7Labels(0.780)。在严格边界检测(HR.5F)方面,SongFormer(HX)表现最好(0.703),明显优于 All-In-One(0.596)和 LinkSeg(0.630)。尽管 Gemini 2.5 Pro 的宽泛边界检测性能(HR3F)稍好(0.813 vs 0.784),但它缺乏边界检测的精确性。随着训练数据的扩展(从 HX 到 HX+P+H+G),ACC 有提升(0.795 → 0.807),但 HR.5F 有所下降(0.703 → 0.696),这表明 HarmonixSet 数据标注质量较高,而其他数据的质量略差,边界标签不够精准。

在 SongFormBench-CN 数据集上,SongFormer 的优势更为显著。SongFormer(HX+P+H+G)的 ACC 达到 0.891,而 SongFormer(HX+P+H)在 HR.5F 上达到 0.690,远超 All-In-One(0.563)和 LinkSeg(0.518)。在此设置下的 HR3F,SongFormer(HX)达到 0.856,甚至高于 Gemini 2.5 Pro 的 0.833。

实验总结出三个关键发现:

SongFormer 在所有功能标签准确率(ACC)上表现最优;

SongFormer 在边界检测方面表现更为精准,尤其是在严格评估下的 HR.5F,而基于大语言模型 (Gemini) 的方法虽然在宽松边界下表现更好(HR3F),但在 HR.5F 和 ACC 上表现较差;

增加训练数据有助于提升分类鲁棒性,但边界检测精度略有下降,这显示了额外标注数据中存在的时间戳不准确问题。

消融实验

在消融实验中,模型在 HX、P、H 数据子集上训练,并在包含 300 首歌曲的 SongFormBench 上评估性能。

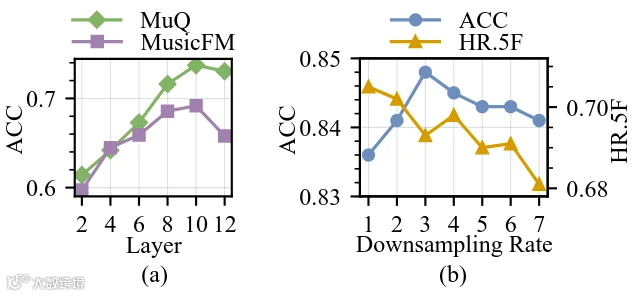

图2 SSL 隐藏特征层和下采样倍率对模型性能的影响。(a) MuQ 和 MusicFM 取各层的表征的 ACC。(b) 不同下采样倍率下的 ACC 和 HR.5F

如图 2 (a),我们使用线性后端在 HX 数据集上训练,自监督表示(SSL)在第 10 层达到最佳性能。同时,在保证效率的前提下,适度下采样能够平衡边界检测与分类准确率的表现。图 2 (b)表明,增加下采样会降低 HR,而 ACC 则先上升后下降,表明适度的下采样在效率和准确性之间提供了最佳权衡。

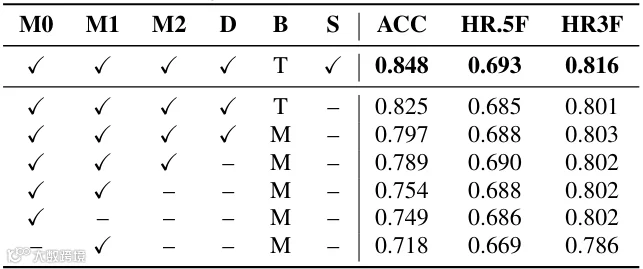

表3 不同组件对模型性能的影响。模型在 HX、P 和 H 数据集上进行训练,并在 SongFormBench 上进行评估。M0/M1:分别为 MuQ 和 MusicFM;M2:多分辨率自监督表示;D:下采样策略;B:后端架构(T:Transformer,M:线性层);S:数据源嵌入

表 3 展示了 SongFormer 中各个组件贡献的系统性消融研究。结果表明,多分辨率表示、下采样和异构监督策略显著提升了性能,而结合 MuQ 与 MusicFM 则产生了更鲁棒的表示。移除其中任意组件均会导致性能下降,凸显了这些组件的重要性。

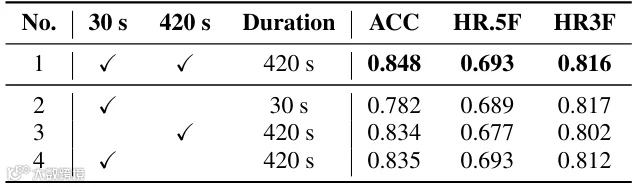

表4 使用不同 SSL 嵌入(MuQ 和 MusicFM)以及窗长配置的模型性能。30 秒和 420 秒表示使用 30 秒或 420 秒的 SSL 嵌入,而 Duration 表示输入到 SongFormer 的时间长度

在表 4 中,我们评估了多分辨率自监督表示的影响。使用 30 秒的 SSL 嵌入作为 30 秒的 SongFormer(No.2)时,准确率(ACC)最低,因为较短的时间窗口无法捕捉整首歌曲的上下文信息。将 SSL 窗口扩展至 420 秒(No.2→No.3)可提高准确率,但边界检测性能(HR)下降,这反映了 420 秒嵌入与 SSL 模型训练窗口之间的不匹配,与 [7] 的发现一致。相比之下,将 30 秒的嵌入拼接成 420 秒的输入(NO.4)带来了显著提升,在使 SSL 推理过程与其训练窗口保持一致的同时,实现了长序列的建模。将此方法与 420 秒的嵌入相结合(NO.1)取得了最佳性能,凸显了多分辨率 SSL 表示的优势。

总结

SongFormer 是一种可扩展的音乐结构分析框架,融合了多分辨率自监督表示与异构监督。大量实验和消融研究验证了其强大的泛化能力,并确认了各个组件的有效性。为缓解数据稀缺问题,我们发布了 SongFormDB——迄今为止最大的训练语料库,以及 SongFormBench,一个经过精心整理的基准测试集(包含 200 首人工修订的 HarmonixSet 和 100 首中文歌曲),以实现高质量、公平且可复现的评估,推动音乐结构分析在可控音乐生成和音乐信息检索中的融合应用。

效果展示

体验地址:https://huggingface.co/spaces/ASLP-lab/SongFormer

输入:一首完整的歌曲音频文件(支持上传或直接录制)

输出:音乐结构信息(以下三种格式呈现)

表格形式:清晰展示各小节的起止时间及对应的功能标签

JSON格式:结构化数据

MSA对应TXT格式

使用流程:

上传本地音频文件或使用麦克风录制歌曲

点击“分析”按钮,系统将在2~4秒内完成处理

查看分析结果,包含上述三种格式的输出

在页面底部,可浏览模型预测的边界检测概率图与功能标签预测概率图,直观了解模型的判断依据

参考文献

[1] Ziqian Ning, Huakang Chen, Yuepeng Jiang, Chunbo Hao, Guobin Ma, Shuai Wang, Jixun Yao, and Lei Xie, “Diffrhythm: Blazingly fast and embarrassingly simple end-to-end full-length song generation with latent diffusion,” arXiv preprint arXiv:2503.01183, 2025.

[2] Ruibin Yuan, Hanfeng Lin, Shuyue Guo, Ge Zhang, Jiahao Pan, Yongyi Zang, Haohe Liu, Yiming Liang, Wenye Ma, Xingjian Du, et al., “Yue: Scaling open foundation models for long-form music generation,” arXiv preprint arXiv:2503.08638, 2025.

[3] Huakang Chen, Yuepeng Jiang, Guobin Ma, Chunbo Hao, Shuai Wang, Jixun Yao, Ziqian Ning, Meng Meng, Jian Luan, and Lei Xie, “Diffrhythm+: Controllable and flexible full-length song generation with preference optimization,” arXiv preprint arXiv:2507.12890, 2025.

[4] Ju-Chiang Wang, Yun-Ning Hung, and Jordan BL Smith, “To catch a chorus, verse, intro, or anything else: Analyzing a song with structural functions,” in ICASSP 2022-2022 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP). IEEE, 2022, pp. 416–420.

[5] Sang-gil Lee, Wei Ping, Boris Ginsburg, Bryan Catanzaro, and Sungroh Yoon, “Bigvgan: A universal neural vocoder with large-scale training,” in The Eleventh International Conference on Learning Representations, 2023.

[6] Hiroaki Sakoe and Seibi Chiba, “Dynamic programming algorithm optimization for spoken word recognition,” IEEE transactions on acoustics, speech, and signal processing, vol. 26, no. 1, pp. 43–49, 2003.

[7] Yixiao Zhang, Haonan Chen, Ju-Chiang Wang, and Jitong Chen, “Temporal adaptation of pre-trained foundation models for music structure analysis,” arXiv preprint arXiv:2507.13572, 2025.

留言

写留言