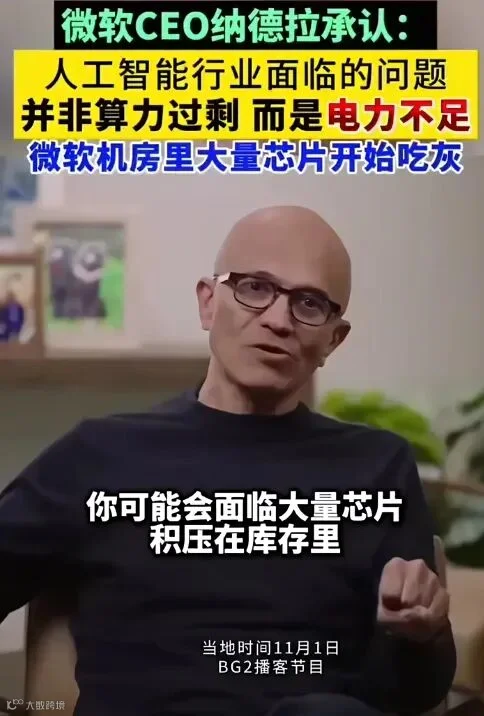

近日,微软 CEO 纳德拉对着满仓库的先进 AI 芯片发愁 ——“芯片多到用不完,却找不到足够的电让它们启动”;亚马逊想在亚利桑那州建个新数据中心,直接被当地政府驳回,理由直白到残酷:“你这项目太耗电,我们电网扛不住”。

图片来自视频号:半导体俱乐部

另一边,中国内蒙古的某个数据中心里,服务器正满负荷运转,电费却比美国低近一半。有人算过一笔账:ChatGPT 每天响应 2 亿个请求,耗的电够 1.7 万个美国家庭用;而到 2035 年,美国 AI 的电力需求还要翻番,但他们的电网大多是几十年前的老基建,北美电网运营商早警告过:“未来几年,停电会成常态”,摩根士丹利更预测,2030 年美国部分区域电力缺口会高达 20%。

美国 AI,卡在了 “有电才能玩” 的死胡同里。但很少有人知道,中国能在这场 “电力竞赛” 里占得先机,不是运气,是早在 3 年前就埋下的一步 “先手棋”。

2022 年,AI 还没像现在这样 “疯狂吃电” 时,我们就启动了 “东数西算” 工程 —— 把东部北上广深这些 “算力饥渴” 的城市需求,搬到西部内蒙古、贵州去。为啥?因为那里的煤电、风电、光电资源多到用不完,电力成本只有东部的 1/3。当时有人看不懂:“把数据折腾到几千公里外,图啥?” 现在答案藏不住了:当 AI 变成 “电老虎”,西部那片 “用不完的便宜电”,突然成了我们的 “底气”。

而真正让美国警惕的,不是我们有便宜电,是最近这招 “组合拳”—— 用国产 AI 芯片,电费最高补 50%!别以为这只是 “贴钱给企业省钱”,这里面藏着破局的关键:国产芯片和英伟达比,确实有差距 —— 算同样的算力,要多花 30%-50% 的电;更麻烦的是,英伟达有个 “CUDA 生态”,就像 AI 界的 Windows,全球程序员十几年写的代码、练的模型,都绑在这个系统上。想换国产芯片?得推倒重来,光适配就要 6-18 个月。

成本高、门槛高,企业自然不敢试。但现在,“东数西算 + 电费补贴” 把这笔账算活了:西部的基础电费先降一截,再加上 50% 的补贴,相当于直接把国产芯片的 “用电成本劣势” 抹平了;企业敢试了,华为的 CANN 等国产生态就能在实际应用里打磨,慢慢补上 “生态短板”。

这哪是补贴?这是给国产芯片争取 “成长时间”—— 用我们的电力优势,把 “芯片性能差” 的短板,一点点补回来。

现在再看这场 AI 竞争,早就不是 “谁的芯片更快” 那么简单了。英伟达靠 CUDA 生态统治了 AI 上半场,拼的是技术硬实力;但到了下半场,当 AI 要从实验室走向千万家企业,拼的是 “谁能扛住持久战”—— 谁的电力更充足、成本更低,谁就能把模型练得更久、迭代得更快。

美国的困境在于,电网老了、电力缺口大了,想补却没那么快;而中国的优势在于,我们有西部用不完的清洁能源,有能调度全国电力的 “东数西算”,还有帮国产芯片破局的智慧。

有人说:“美国最怕的不是华为的芯片,是中国的能源,是中国的电网。”

其实不是怕电网本身,是怕我们用 “电力优势” 重新定义了 AI 竞争的规则 —— 当别人卡在 “缺电” 的瓶颈里,我们却能用 “便宜电 + 国产芯片” 的组合,慢慢跑赢这场持久战。

当然,我们也没躺平:芯片性能的差距要补,生态建设要熬,但至少我们找对了路 —— 用能源换时间,用时间换技术,用技术换未来。毕竟 AI 再厉害,没了电,再先进的芯片也只是块废铁。

中国这步 “电力棋”,或许就是 AI 下半场的反超密码。