最近准备把家里承载了 10 多年的老电脑换掉。

通宵达旦的从各类电商平台上收集、整理并分析各配件的价格。

得到一个感受:

Nvidia 显卡真贵,Intel CPU 真便宜~

这种现状与 20 年前去中关村攒机器成为了鲜明对比。

那时候 CPU 很贵,显卡很便宜~

记得那会儿的 Intel 正处于鼎盛时期,一块儿配置高一点的 CPU 动辄上千块。

别忘了那时候的上千元是种什么概念...

时至今日,一块儿最新型的 Intel Ultra CPU 还依然卖千元左右。

难道是进入了「物价魔幻」之地?

前一阵子看到一个消息,Intel 这家国际著名芯片公司已经得靠美国政府及英伟达来投资救助了,只能感叹市场变化瞬息万变。

一、Inter 的自我救赎之路

这家曾经定义了硅谷的「硅」的巨头,面对 AMD、苹果、高通等后起之秀的多线夹击,一度在设计与制造两端双双失速。

从错过移动手机市场的爆发,PC 市场主导地位逐渐被蚕食,到各种技术决策失误,昔日的硅谷巨人疲态尽显。

在人工智能(AI)技术以前所未有的速度重塑世界的今天,算力已成为驱动创新的核心引擎。

从科学研究到工业生产,从内容创作到日常生活,其影响力无处不在。

在这场波澜壮阔的智能革命背后,是一场关于计算核心的激烈博弈。

无论是训练复杂的深度学习模型,还是在端侧设备上实现实时智能交互,计算硬件的选择直接决定了应用的性能、成本和用户体验。

在这样的大背景下,中央处理器(CPU)与图形处理器(GPU)之间的关系变得尤为引人注目。

它们是彼此替代,还是协同进化?

Intel 能否靠即将最新发布的「18A」工艺芯片「Panther Lake」闲鱼翻身?

根据 Intel 的官方介绍,Panther Lake 是一款面向 PC 的系统级芯片(SoC),集成了 CPU、GPU 以及专用 AI 加速器。

它统一了以往强调效率的 Lunar Lake 与强调性能的 Arrow Lake,让 OEM 不再在「电池寿命或峰值性能」之间二选一。

它提供从 8 核到 16 核的不同版本,并搭载全新 Xe3 图形核心。顶配型号内建 12 个 GPU 核心与光线追踪单元,性能据称较上一代提升逾 50%。

在 AI 性能方面,Panther Lake 算力最高可达 180 TOPS(每秒万亿次运算)。

Panther Lake 的真正看点是工艺。Panther Lake 是英特尔首款基于 18A 工艺打造的产品,英特尔将其定调为:

迄今在美国本土开发并制造的最先进半导体工艺

18A 这个数字,意思是「1.8 纳米」,1A 等于 0.1 纳米。这是英特尔首个 2 纳米级节点,该节点在英特尔位于俄勒冈的工厂完成开发、获得制造资格并启动早期生产。

其工艺的突破在于两项底层技术,RibbonFET 与 PowerVia。

前者是 Intel 十余年来首个全新晶体管架构,据称有很强的缩放能力和开关特性。

后者是新的背面供电系统,把传统堆叠在晶体管之上的供电金属层搬到背面,让正面的布线主要承载信号、背面承载电源,减少电压下陷与布线拥堵。

结合两者,Intel 声称 18A 相比前一代 Intel 3 工艺,可实现最高 15% 的性能提升与约 30% 的芯片密度改进。

18A 工艺将为其未来「至少三代」客户端与数据中心产品奠定基础。

据业界预计 Panther Lake 仍是典型的异构封装,即 CPU 计算芯片由 Intel 18A 工艺生产,而 I/O 控制器与 GPU 模块预计仍由外部代工制造。

所以英伟达投资 Intel 可不是闲得蛋疼,自然是出于自家的战略考虑...

但与此同时,也带出来一个疑问?

既然 CPU 中已经集成了 GPU 模块,那为什么还需要单独的显卡呢?把能力都集成到 CPU 里不就完了?

这就要从先理解 CPU 与 GPU 在 AI 时代的角色,必须首先追溯其设计哲学的根本差异了。

二、CPU 与 GPU 的本质差异:从通用大脑到并行引擎

这两种芯片并非简单的尺寸或核心数量之别,而是源于对「计算」这一概念不同维度的理解。

用比较通俗的话理解,就是:

CPU 是计算机系统的「指挥官」,而 GPU 则是其强大的「执行部队」。

1、指挥官 CPU

CPU 的设计初衷是为了处理各种各样的指令集负载,它擅长的是快速响应和执行顺序性、逻辑复杂度高的任务。

在面对 AI,特别是深度学习(Deep Learning)的工作负载时,却显得力不从心。

我们都知道深度学习的核心是神经网络,其计算过程可以概括为大规模的矩阵和向量运算。

例如,在训练一个大型语言模型(LLM)时,需要进行数万亿次的乘加运算,而这些运算之间相互独立,可以同时进行。这种“高吞吐量”但“低延迟”要求不高的并行计算模式,恰好与 CPU 的设计理念背道而驰。

让 CPU 来执行这些任务,就如同让一位外科医生去完成数亿个简单的重复性动作,虽然每个动作都能完成,但整体效率极其低下。

2、执行部队 GPU

相比之下,GPU 最初是为了解决 3D 游戏中的图形渲染问题而生,也就是我们为了玩 PC 游戏而购买的高端显卡,它的本质是一个高度并行化的计算架构。

GPU 拥有成百上千甚至数万个专为执行简单重复计算任务而设计的小型核心。

这些核心可以同时处理海量的数据流,非常适合矩阵运算、向量运算等可被分解为大量相同指令块的任务。

简单说就是:帮你把一个大任务细分拆解为无数个小任务!

同时将这些小任务分配给不同的核心同时处理,从而实现惊人的计算吞吐量。

正是这种与生俱来的并行处理能力,使其在 AI 领域大放异彩!

当深度学习的研究者们发现,神经网络的训练过程与图形渲染在计算模式上高度相似时,GPU 的命运便发生了转折。

因此,GPU 能够以极高的吞吐量处理 AI 所需的密集计算,从而将原本需要数天甚至数周的模型训练时间缩短至数小时。

将复杂的神经网络运算映射到 GPU 的并行架构上,实现了相比 CPU 数十倍甚至上百倍的加速。

这一重大发现,直接引爆了 2012 年以来的深度学习革命,同时也奠定了 英伟达(NVIDIA)等 GPU 厂商在 AI 领域的霸主地位。

所以,CPU 与 GPU 的关系并非简单的竞争替代,而是一种天然的互补。

CPU 扮演着「指挥管」的角色,负责规划、调度和协调整个计算流程;而 GPU 则如同一支高效的「执行部队」,负责执行那些 CPU 难以高效处理的、规模庞大且高度规则的并行计算任务。

这种分工合作的关系,构成了现代计算系统的基础,并在 AI 时代得到了前所未有的放大与强调。

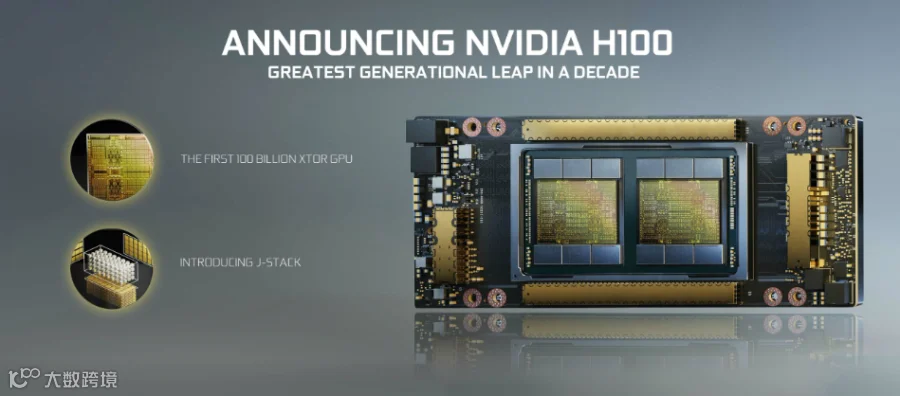

三、在 AI 时代,GPU 占据绝对主导地位

当计算需求从传统的事务处理转向复杂的 AI 模型训练时,CPU 与 GPU 的角色转换便显得尤为明显。

在构建 AI 数据中心的过程中,GPU 凭借其独特的架构优势,无可争议地成为了算力底座的绝对主力,而 CPU 则退居幕后,承担起支持和服务的职能。

AI 模型的训练过程本质上是一个求解巨大参数空间的过程,其中包含了海量的矩阵乘法和卷积运算,这些运算具有高度的可并行性。

GPU 为此类任务而生,其数千个并行核心能够同时处理数以百万计的浮点运算,这是 CPU 所无法比拟的。

网上有一项数据现实,在深度学习训练中,GPU 的性能比 CPU 快上 10 倍以上,更有甚者,在某些特定场景下,性能差距可达数十倍乃至上百倍。

举个例子:当时一票难求的英伟达 H100 GPU 采用了其革命性的 Transformer Engine,在 GPT-3 这类大型语言模型的训练性能上,可以达到前代旗舰 A100 的 4 到 9 倍,而在推理性能上更是高达 16 到 30 倍。

而在实际的成本效益对比中,使用 GPU 方案训练一个 1750 亿参数的模型,成本仅为 45 万美元,而纯 CPU 方案则高达 460 万美元,后者几乎是前者的 10 倍。

这种巨大的性能和成本优势,使得 GPU 成为 AI 训练事实上的唯一选择。

在当时,全球顶尖的科技公司纷纷将巨额资本投入到 GPU 的采购中,也包括字节跳动和腾讯各自采购了约 23 万张。

除了性能上的碾压,软件生态的成熟度也是 GPU 占据主导地位的关键因素。

卧薪尝胆 10 年之久的英伟达自 2006 年推出 CUDA 平台以来,已经发展成为一个包含 cuBLAS、cudnn、TensorRT 等一系列核心库的强大生态系统,覆盖了从底层硬件抽象到高级模型部署的方方面面。

目前,绝大多数的主流 AI 框架,如 PyTorch 和 TensorFlow ,都将对英伟达(NVIDIA)硬件的支持放在首位。

这种深厚的技术积累和庞大的开发者社区,为英伟达(NVIDIA)建立了一道难以逾越的护城河。

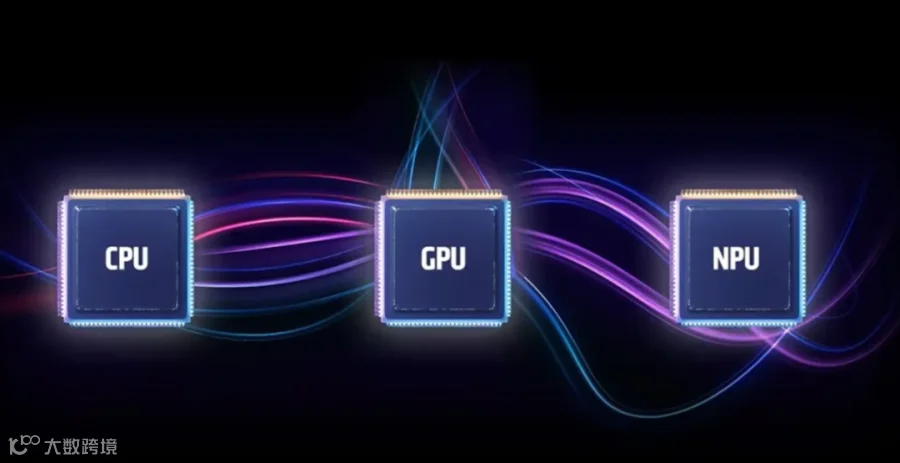

四、AI PC 元年,成为 CPU + NPU 协同作战的新战场

如果说 AI 数据中心是 GPU 的主场,那么随着 AI 能力逐渐向终端下沉,一场关于 PC 算力的变革正在悄然发生。

2024 年被视为「AI PC 元年」,标志着个人电脑正在从单纯的通用计算工具,转变为具备本地智能处理能力的终端设备。

在这场变革中,CPU 的地位非但没有被削弱,反而通过与神经处理单元(NPU)的深度融合,找到了新的价值定位和增长空间。

传统上,PC 主要依赖 CPU 处理所有任务,这个毋庸置疑。

然而,随着 Windows Studio Effects、实时背景虚化、智能剪辑等 AI 功能的普及,仅靠 CPU 处理这些日益繁重的神经网络推理任务,不仅会消耗大量系统资源,导致其他应用程序卡顿,还会大幅增加功耗,缩短电池续航。

此时,专用的 NPU 应运而生~

NPU 是一种受人脑启发的专用处理器架构,专为高效执行 AI 推理任务而设计,其核心优势在于并行处理能力和远超 CPU 的能效比。

看到这里,是不是觉得 NPU 的架构设计有点儿像 GPU 了,特别是它的并行处理能力~

Intel 率先在第 14 代酷睿 Ultra 处理器中引入了集成 NPU,其 AI 算力据称能达到 50 TOPS。

据 Intel 官方基于 OpenVINO 工具链的测试,在运行 ResNet-50 模型时,搭载 NPU 的处理器相比纯 CPU,在延迟模式下平均延迟从 24.73ms 锐减至 1.70ms ,降幅超过 90%;在吞吐量模式下,FPS(每秒帧数)从 62.69 飙升至 936.05 ,提升近 15 倍。

上述数据直接体现了 NPU 在加速 AI 推理方面的巨大威力。

而如上文所述,Intel 即将推出的第三代(代号为 Panther Lake)的酷睿 Ultra 处理器无疑是最引人注目的里程碑之一。

消息一放出,Intel 市值涨了 85%。

这款处理器不仅是 Intel 技术路线图上的关键一步,更代表了 CPU 在 AI 时代寻求战略突围和重新定义自身角色的雄心。

同时这场变革也催生了一个全新的混合计算架构「CPU + NPU + GPU」。

在这个架构中,三者分工明确:

1、CPU:继续扮演「指挥官」的角色,负责操作系统运行、通用应用程序执行、任务调度和I/O管理等核心职责。

2、NPU:成为 AI 推理任务的专职执行者。当用户启动 PC 的实时翻译、智能搜索或内容生成等功能时,这些请求会被交由 NPU 处理,从而确保低延迟和低功耗。需要说明的是,NPU 的优势在于其专用性,它可以直接在系统内存中处理数据,无需像 GPU 那样需要将数据从主内存拷贝到高速显存,这极大地降低了功耗与延迟!

3、GPU:在 AI PC 中的角色有所转变。对于我们普通大众使用的消费级 AI PC 而言,其内置的集成 GPU 主要用于图形渲染和一些较轻量级的 AI 计算。而对于配备了独立高性能 GPU 的 AI PC(比如服务器),GPU依然可以用于运行更大规模的 AI 模型。

不难看出,这个新架构的意义就在于,它解决了 PC 在 AI 时代面临的功耗墙和性能墙问题。

通过将 AI 任务卸载到专用的 NPU 上,CPU 得以从繁重的计算中解放出来,专注于其最擅长的通用计算和控制工作,从而实现了整体系统效率的最大化。

因此,在 AI PC 这个新兴战场上,CPU 的重要性并未减弱,而是通过与 NPU 的协同,完成了自身的进化,共同构建了一个更加智能、高效和节能的计算平台。

写在最后

在对 CPU 与 GPU 在 AI 时代的角色进行了深入的剖析之后,特别是当审视了 Intel Panther Lake 所代表的 CPU 在 AI 能力上的巨大飞跃之后,似乎可以得出一个较清晰的结论:

关于“谁更重要”的辩论,好像已经不再是一个富有成效的问题。

AI 时代的现实远比这种二元对立的框架要复杂和丰富。

未来不属于 CPU ,也不属于 GPU ,而属于一个由「CPU + GPU + NPU + 各种专用加速器(ASIC)」深度融合、协同工作的「异构计算」生态系统。

在这个生态系统中,每一种处理器都有其独特且不可替代的价值,它们共同构成了驱动智能革命的动力核心。

既然看到这儿了,如果觉得还不错,就给土著哥随手点个赞、在看、转发三连;如果想第一时间收到推送,也可给我加个星标★,我的辛苦输出+你的耐心输入才是绝配~