【导读】DeepSeek V4正式发布:百万级上下文、开源Agent新标杆

DeepSeek V4系列预览版正式发布,标志着开源大模型在长上下文处理、Agent能力与推理性能三大维度实现重大突破。

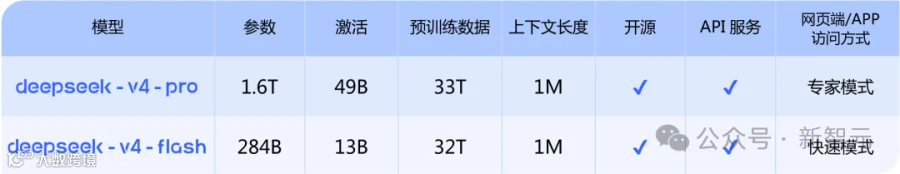

该系列包含两个核心版本:面向高性能场景的DeepSeek-V4-Pro,以及强调效率与成本效益的DeepSeek-V4-Flash。技术报告已同步公开。

论文地址:https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/blob/main/DeepSeek_V4.pdf

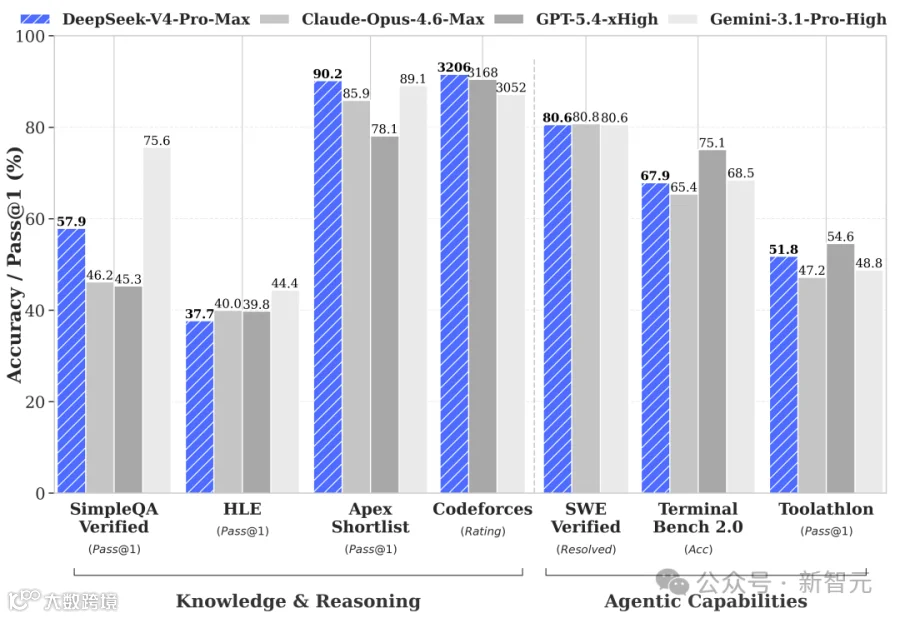

DeepSeek-V4-Pro:性能比肩顶级闭源模型

DeepSeek-V4-Pro拥有1.6T总参数、49B激活参数,代表当前开源模型最高水平,综合能力对标全球顶尖闭源模型。

其核心优势体现在三方面:

- Agent能力领先开源界:Agentic Coding水平居开源首位,编码体验超越Sonnet 4.5,交付质量接近Opus 4.6(非思考模式),已成为企业内部Agent编程首选。

- 世界知识深厚:知识测评显著优于同类开源模型,与Gemini-Pro-3.1差距极小。

- 逻辑推理卓越:在数学、STEM及高难度竞赛代码等硬核领域表现冠绝开源社区,具备挑战最强闭源模型的实力。

底层技术三大创新

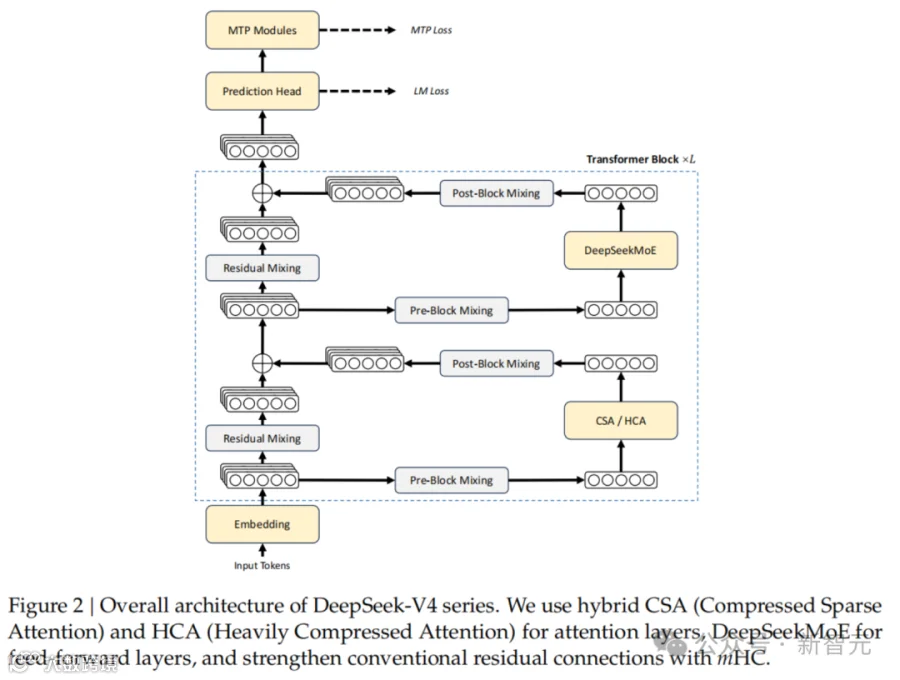

支撑V4-Pro卓越性能的是三项关键架构升级:

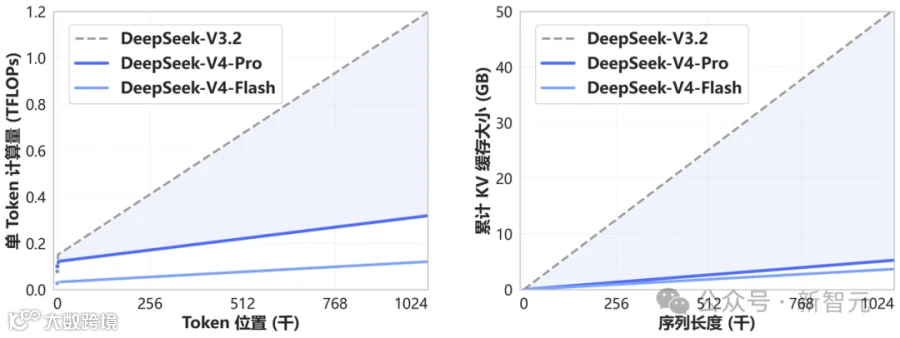

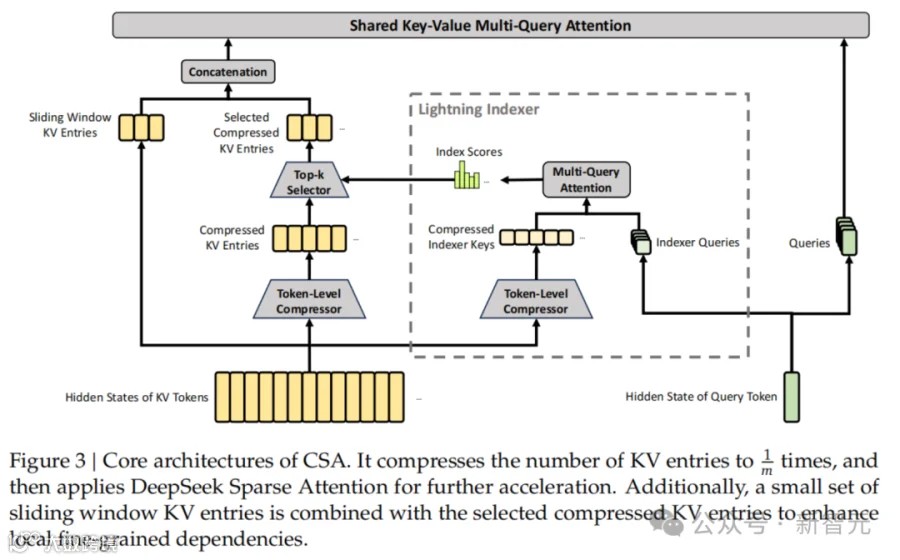

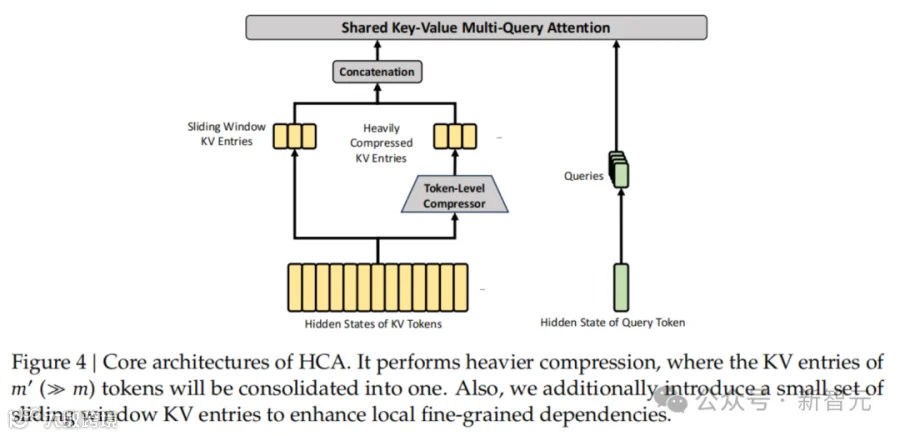

- 混合注意力机制(CSA + HCA):压缩稀疏注意力(CSA)与重压缩注意力(HCA)协同工作,在百万token上下文中大幅降低计算量与显存需求。

- 流形约束超连接(mHC):升级残差连接结构,提升深层网络信号传播稳定性与建模能力。

- Muon优化器:全新训练优化器,加速收敛并增强训练稳定性。

在100万token上下文场景下,V4-Pro单token推理计算量仅为前代27%,KV缓存占用降至10%。

DeepSeek-V4-Flash:极致效能与性价比平衡

V4-Flash采用284B总参数、13B激活参数设计,定位高效经济型方案。

虽在世界知识深度略逊于Pro版,但逻辑推理能力接近;响应更快、API接入成本更低,基础Agent任务表现与Pro版相当,复杂任务仍有提升空间。

架构革新:重塑长上下文效率

V4引入革命性注意力机制,结合Token维度高效压缩与DSA稀疏注意力(DeepSeek Sparse Attention),实现业界领先的长文本处理能力,显著降低计算与显存依赖。

即日起,1M(100万tokens)超长上下文将成为DeepSeek官方服务标准配置。

DeepSeek-V4和V3.2的计算量与显存容量随上下文长度变化对比

Agent能力深度优化

V4针对Claude Code、OpenClaw、OpenCode、CodeBuddy等主流Agent生态深度适配,在代码编写、自动化文档生成等场景效率显著提升。

V4-Pro在特定Agent框架下自动生成的PPT页面实例

API全面升级,旧版模型倒计时

开发者可立即通过API调用新模型:

- 追求性能:model_name = deepseek-v4-pro

- 追求效率:model_name = deepseek-v4-flash

原deepseek-chat与deepseek-reasoner将作为V4-Flash的过渡别名,将于2026年7月24日正式停用。

论文解读

两种压缩,一套组合拳

V4-Pro采用双路径注意力压缩策略:

- CSA(压缩率4):每4个token KV缓存合并为1条目,Lightning Indexer筛选Top-1024条目参与计算,索引使用FP4精度。

- HCA(压缩率128):极致压缩后保留全部KV条目参与计算,兼顾全局视野与计算效率。

CSA精细检索、HCA全局感知、滑动窗口捕捉局部依赖,三者协同提升长文本建模能力。

|

|

在100万token下,KV缓存仅约为BF16 GQA8基线的2%;混合精度存储(RoPE维度BF16,其余FP8)进一步减半体积;推理端支持磁盘级缓存,避免重复prefill。

mHC:6.7%代价换来的稳定性

mHC将残差映射矩阵约束于双随机矩阵流形(Birkhoff多面体),确保谱范数≤1,防止深层信号发散;通过Sinkhorn-Knopp算法迭代投影,工程开销仅增加6.7%墙钟时间。

训练万亿参数的「土办法」

Muon优化器基于Newton-Schulz正交化梯度动量,10次混合迭代实现快速收敛与精确稳定。

另两项关键训练技巧:

- Anticipatory Routing:解耦路由索引计算与主干更新,历史参数预缓存,loss spike时自动触发,日常开销可忽略。

- SwiGLU Clamping:线性分量钳制在[-10, 10],门控上界设为10,简单有效。

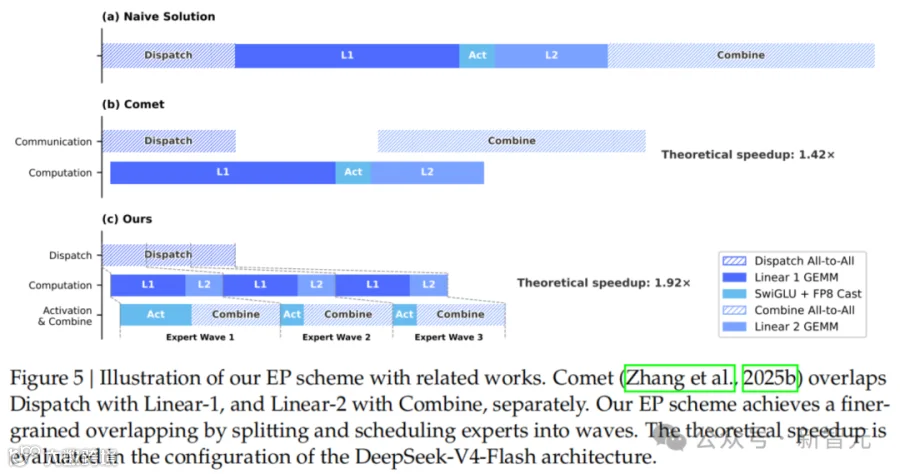

V4开源MegaMoE,融合通信与计算至单pipeline kernel,在通用场景加速1.5–1.73倍,延迟敏感场景最高达1.96倍。

专家分训,蒸馏合一

采用On-Policy Distillation(OPD)替代V3.2混合RL:先独立训练数学、代码、Agent等领域专家,再以学生模型对十余位专家进行全词表logit蒸馏。

关键技术包括:

- 不缓存教师logits(显存受限),仅缓存最后一层隐藏状态,按需重建logits;

- TileLang专用kernel加速KL散度计算;

- 引入Generative Reward Model(GRM),actor网络兼作奖励模型,联合优化评判与生成能力;

- 后训练阶段开展FP4量化感知训练,MoE专家权重与CSA索引器均支持FP4量化,且FP4→FP8反量化无损。

DeepSeek再度证实开源的力量

从V3到V4,DeepSeek持续以开源方式释放前沿技术,回应“百万长上下文”与“高性能Agent”两大趋势。

架构创新证明:无需牺牲性能,即可显著降低大模型应用门槛。

用户现已可通过官方App或chat.deepseek.com体验1M上下文能力——这不仅是对话框,更是能容纳整部百科全书、理解万行代码逻辑的「第二大脑」。