在工业自动化、智能监控、质量检验等诸多领域,2D视觉识别检测技术扮演着至关重要的角色。其核心任务在于通过二维图像信息,准确、高效地定位、识别并分析目标物体。然而,实际应用场景的复杂性与非理想化,使得目标物体常面临部分遮挡与相互粘连两大挑战,这直接影响了2D视觉识别检测系统的鲁棒性、精确度与可靠性。本文旨在对这两个关键难题进行解析分析,并探讨相应的技术应对思路。

一、部分遮挡:信息缺失的挑战与应对

部分遮挡是指目标物体在成像过程中,其部分区域被场景中的其他物体所遮盖,导致目标视觉信息不完整。这对依赖于目标整体或关键局部特征的2D视觉识别检测算法构成严重干扰。

影响机制分析:

特征提取失效:传统的特征描述子(如SIFT、HOG)或基于深度学习的特征提取网络,通常依赖于目标可见部分的特定纹理、边缘或轮廓模式。遮挡会破坏这些模式的连续性与完整性,导致特征匹配失败或描述向量失真。

定位与分割偏差:在目标定位(如包围框回归)和实例分割任务中,遮挡区域可能被误判为背景,或者导致预测的边界框向内收缩,无法完整覆盖目标。

分类置信度下降:对于需要识别目标类别的任务,关键判别区域的遮挡会显著降低分类模型输出的置信度,甚至引发误分类。

主要应对策略:

鲁棒性特征学习:利用大规模带遮挡样本训练深度学习模型,迫使网络学习对遮挡不敏感的全局或冗余局部特征。注意力机制(如空间注意力、通道注意力)可被引入,使网络能够动态聚焦于目标未被遮挡的显著性区域,抑制遮挡部分的干扰。

上下文信息利用:当目标部分被遮挡时,其周围的场景上下文(如共现物体、空间布局关系)可以提供重要的辅助判别信息。通过图神经网络(GNN)或长短期记忆网络(LSTM)等模型建模目标与环境的关联,有助于在遮挡下维持识别与检测的稳定性。

分块与匹配策略:将目标模型划分为多个局部区域或关键点进行描述。识别检测时,即使部分区域被遮挡,剩余可见区域的匹配得分仍能支持目标的判断与粗略定位。

生成与补全技术:基于生成对抗网络(GAN)或变分自编码器(VAE)等模型,尝试对遮挡区域的内容进行合理预测与图像补全,为后续的识别检测提供更完整的输入。

二、目标粘连:边界模糊的困境与破解

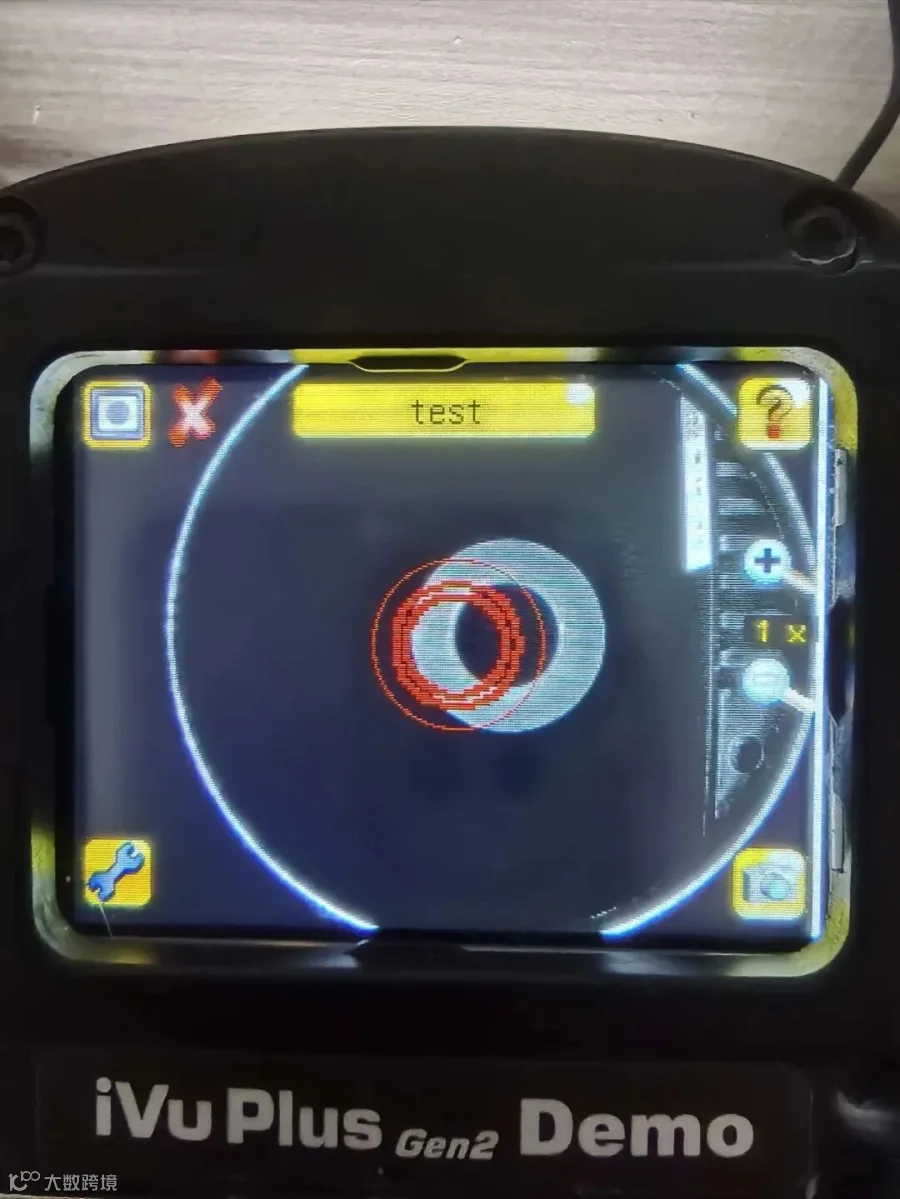

目标粘连是指两个或多个目标物体在图像中因接触、重叠或距离极近而导致其边缘或轮廓相互连接,在2D视觉图像中形成一个连通域,难以直接分离出独立个体。

影响机制分析:

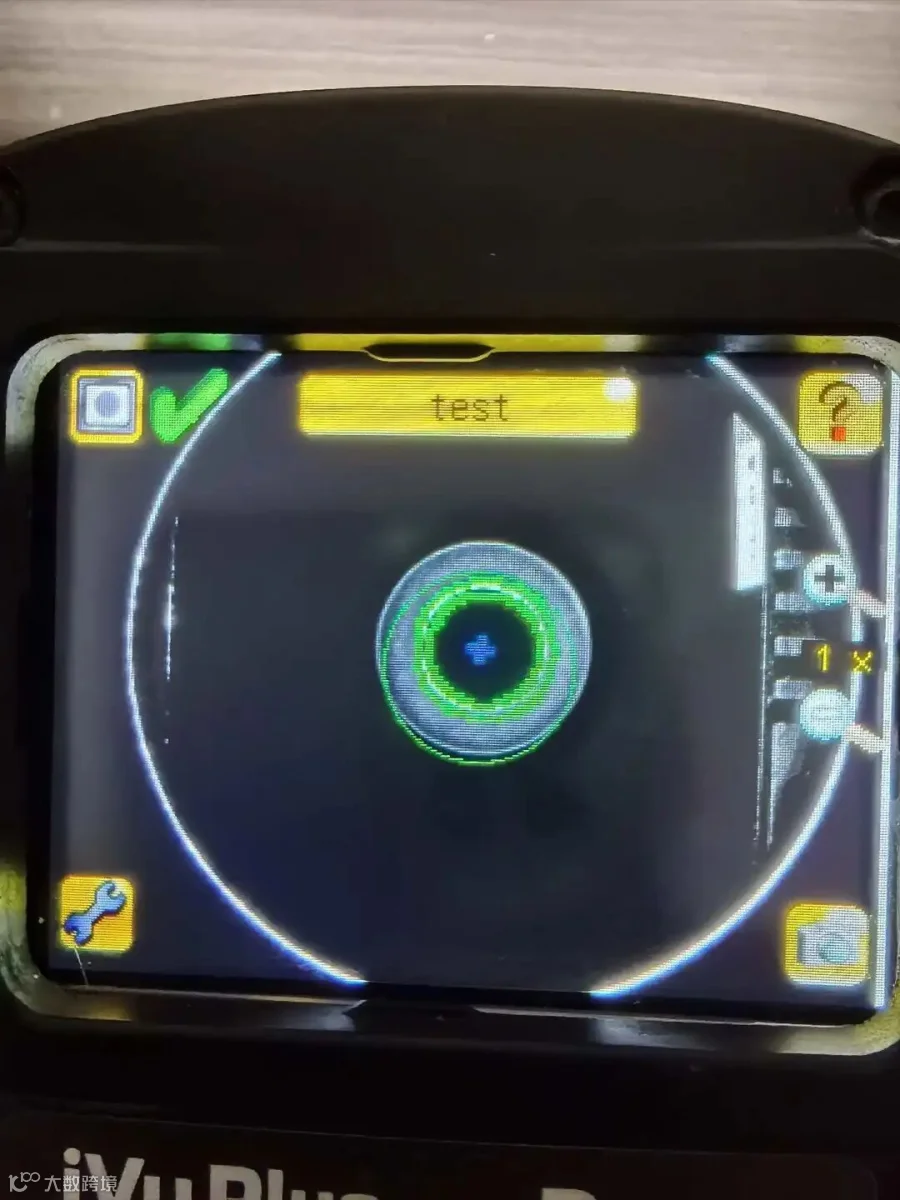

分割与计数困难:这是粘连问题最直接的影响。传统的阈值分割、边缘检测等方法无法在粘连处找到有效的分割边界,导致多个目标被误判为单个大型目标,严重影响后续的计数、测量和分析。

特征混淆:粘连区域的特征可能混合了多个目标的属性,干扰基于区域的特征提取与分类。

定位框重叠:在基于锚框(Anchor)的检测器中,高度粘连的目标会产生大量高度重叠的候选框,给非极大值抑制(NMS)等后处理步骤带来困难,容易导致漏检或误检。

主要应对策略:

凹点检测与轮廓分析:粘连通常会在目标接触边界形成“凹陷”。通过检测轮廓的凹点,并结合几何约束(如接触部分的凹陷深度、角度),可以作为分割的切入点。形态学操作(如开运算、腐蚀)有时也能在一定程度上分离轻微粘连。

基于深度学习的实例分割:以Mask R-CNN为代表的实例分割网络,通过并行的掩码预测分支,能够直接为每个实例生成像素级分割掩码。这类方法通过特征图的竞争与区分性学习,在特征空间层面实现粘连物体的分离,对复杂粘连具有更强的处理能力。

分水岭算法的改进:经典分水岭算法对噪声和边界梯度敏感易导致过分割,但通过结合距离变换(确定前景标记)或深度学习预测的概率图作为输入,可以显著提升其在粘连目标分割上的性能,得到准确的分离边界。

回归关键点或边界:不直接分割整个目标,而是设计网络回归出每个目标的特定关键点(如中心点、极点)或者预测目标间的分离线。通过后处理这些关键信息来实现粘连个体的区分与定位。

三、总结与展望

部分遮挡与目标粘连是2D视觉识别检测技术走向成熟化、普适化必须攻克的核心难题。两者本质上都源于2D成像过程中三维世界信息在二维平面投影所固有的局限——信息损失与歧义。

当前的主流解决方案已深度转向数据驱动的深度学习范式。通过设计更精巧的网络架构(如引入注意力、图模型、多任务学习)、利用更丰富的上下文信息、以及采用更贴合问题的损失函数与训练策略(如针对遮挡的增强数据、针对粘连的分离感知损失),2D视觉识别检测系统在这些挑战上的表现不断提升。

未来,随着视觉Transformer等新架构的探索、多模态信息(如与2.5D/3D视觉结合)的融合,以及自监督、半监督学习在减少对精细标注数据依赖方面的进步,2D视觉识别检测技术在应对遮挡与粘连等复杂场景时,必将展现出更强大的感知能力、推理能力和泛化能力,从而在更广阔的工业与生活场景中实现精准、可靠的自动化视觉洞察。