在智能制造的深水区,3D视觉引导技术正从实验室走向复杂的工业一线。然而,许多项目在落地时遭遇了“最后一公里”的瓶颈:在强反光、低纹理、严重遮挡或背景杂乱的极端工况下,机器人频频出现识别失败或抓取偏差。究其根源,往往不在于硬件算力的不足,而在于算法底层对三维点云数据的特征提取与描述鲁棒性缺乏深度优化。

如何构建一套能在多变环境中“稳如泰山”的视觉感知系统?本文将从三个维度深度解析核心突围路径。

一、特征提取:从“脆弱几何”到“抗扰基石”

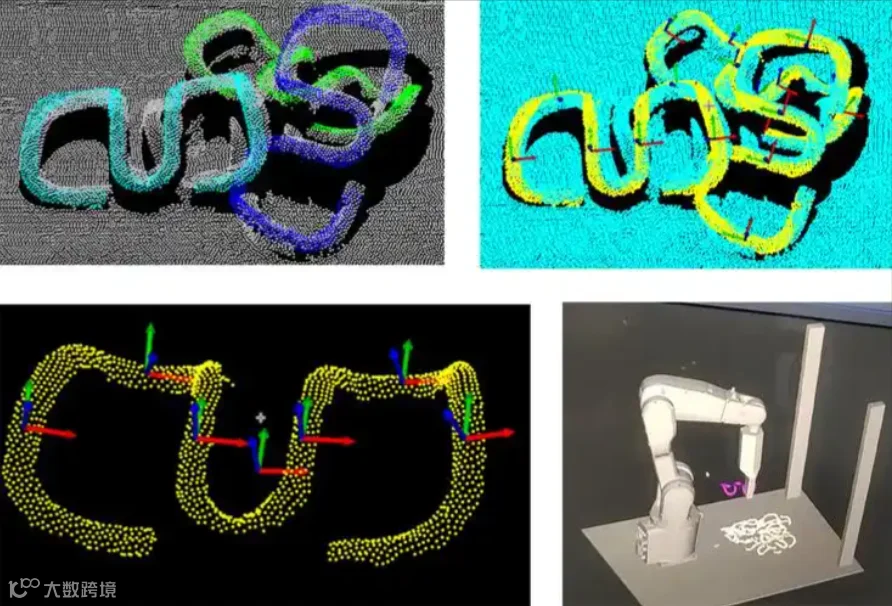

在传统认知中,法向量、曲率等几何特征是描述三维物体的基础。但在真实的3D视觉引导场景中,传感器噪声、点云密度不均以及物体表面的高反光特性,极易导致这些基础特征发生畸变。一旦特征提取环节失守,后续的位姿解算便成了无本之木。

提升鲁棒性的关键策略:

-

多尺度融合: 不再依赖单一尺度的几何信息,而是结合局部邻域的拓扑结构与全局形状上下文,构建对噪声不敏感的“强健特征”。

-

预处理优化: 引入体素化滤波与统计离群点去除,先期剔除环境噪点,确保输入数据的纯净度。

-

抗缺失设计: 即使点云缺失率达30%以上(严重遮挡),系统仍能通过剩余可见部分锁定物体的关键几何骨架。

二、特征描述:打造“唯一身份码”的抗干扰能力

如果说特征提取是“看清”,那么特征描述就是“认对”。在3D视觉引导中,描述子需要将几何信息编码为高维向量,用于跨视角、跨状态的快速匹配。工业现场最大的挑战在于“不确定性”:工件摆放角度随机、部分被料框遮挡、甚至表面纹理重复。

高鲁棒性描述子的三大核心属性:

- 1.旋转不变性: 无论机器人从哪个角度拍摄,生成的特征“指纹”保持一致。

- 2.尺度不变性: 无论物体距离远近,特征向量的相对关系稳定。

- 3.局部支撑性: 即使物体被部分遮挡,剩余可见部分的特征仍能保持唯一性,避免误匹配。

技术趋势: 基于深度学习的描述子生成技术正在重塑这一领域。通过海量工业场景数据训练,神经网络能够自动挖掘出人类难以定义的深层特征模式,在低纹理金属件或重复结构件的匹配中,展现出远超传统手工算子的泛化能力。

三、系统级突围:多级验证与动态融合架构

单点的算法优化虽重要,但系统级的架构设计才是3D视觉引导稳定运行的终极保障。面对极端工况,单一匹配策略往往独木难支。

构建稳健的系统闭环:

-

粗配准定位: 利用全局特征快速锁定目标区域,缩小搜索范围,提高计算效率。

-

精配准微调: 采用迭代最近点(ICP)或其变种算法,进行亚毫米级的姿态精修。

-

残差动态剔除: 实时计算匹配残差,自动剔除异常点,防止个别错误数据拉偏整体结果。

-

时序约束融合: 引入时间维度,利用连续帧间的运动逻辑修正单帧误差,大幅提升动态作业下的稳定性。

结语

3D视觉引导的下半场竞争,本质上是算法鲁棒性的较量。只有攻克了特征提取与描述在复杂环境下的适应性难题,才能真正打破工业自动化的场景限制,让机器人在强光、遮挡与杂乱中依然游刃有余。这不仅是技术的迭代,更是智能制造从“自动化”迈向“智能化”的必由之路。