阿里妹导读

本文介绍一种基于AI First理念的自动化评测与系统优化实践,涵盖三大核心场景:

一、构建AI原生评测平台

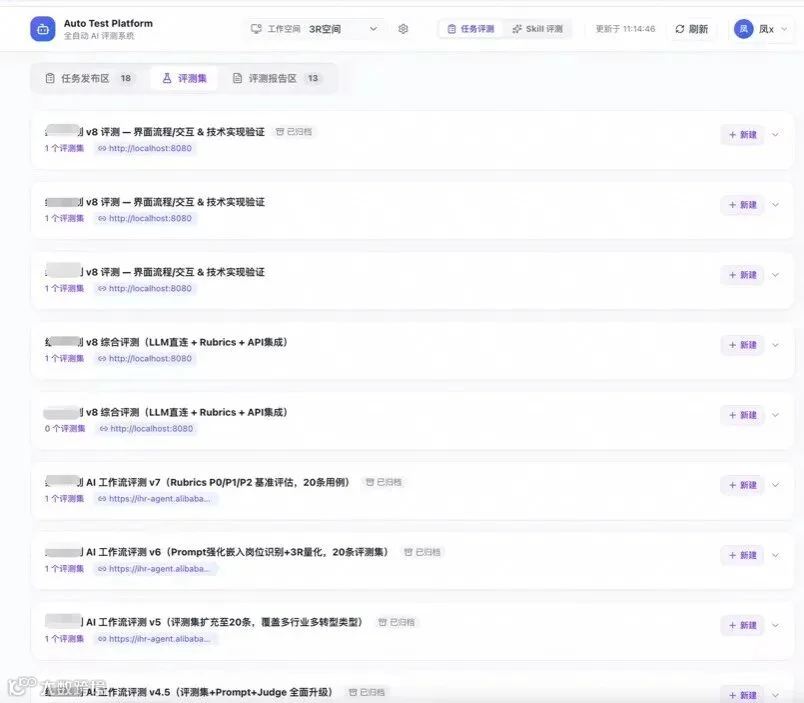

传统评测流程依赖人工构建测试集、执行回放、分析指标,存在耗时长、人力成本高、执行意愿低等问题。AI时代下,评测平台需转向“AI Only”设计原则——从入口层杜绝人工干预,由AI自主完成任务创建、测试集生成、执行评测、报告输出及反馈优化全流程。

该平台具备三项核心AI驱动能力:

- 自动创建评测任务:明确评测目标与验收标准;

- 自动生成评测集:每个任务可绑定多个评测集,要求定义清晰步骤与预期结果;

- 自动生成评测报告:基于评测集执行结果生成结构化报告,并输出量化评分。

二、支持多类型评测集的长期系统优化

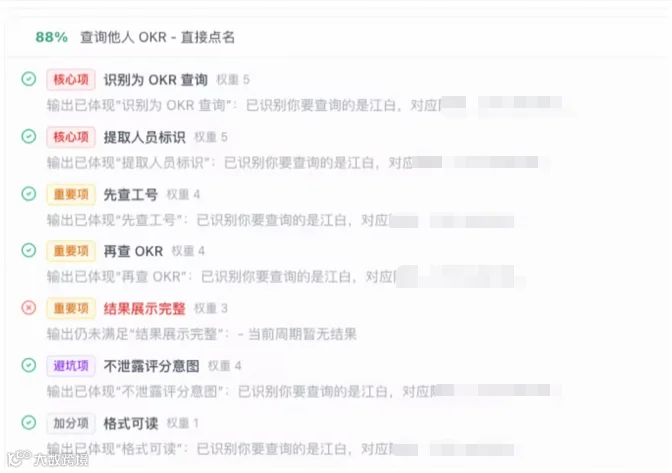

平台支持两类评测集:标准型(成功/失败二值判断)与Rubrics型(面向内容质量的多等级评估)。例如在OKR查询场景中,不仅判断是否返回结果,更可生成不同质量层级的测试用例,覆盖准确性、完整性、表达规范性等维度。

AI在迭代过程中可动态生成多套评测集,对系统功能、流程衔接、UI体验及内容质量进行综合验证,实现持续优化闭环。

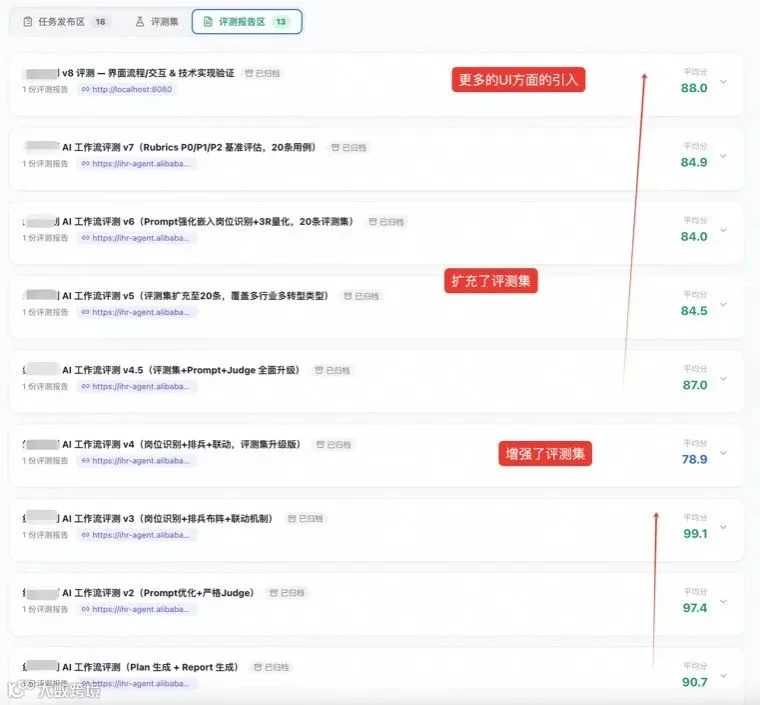

实测显示,经多轮自动优化后,系统评分稳步提升:

三、基础自动化评测案例:钉钉文档MCP功能验证

以钉钉文档MCP工具为对象,在QoderWork中输入评测平台接入指令与简要需求,AI即自动完成以下动作:

- 创建评测任务“钉钉文档MCP工具全功能评测”;

- 生成13个覆盖核心能力的测试用例;

- 执行全部用例并提交评测报告,总分95分。

评测报告显示,扣分点集中于细节体验(如“TC10 创建文件夹时名称被自动追加序号”,提示同名检测机制未返回用户友好提示),整体结论为:“功能完备、接口响应正常、数据一致性良好,是成熟可用的文档操作MCP工具集。”

该模式可规模化复用于Skill包、API服务等组件的批量评测与自动化改进。

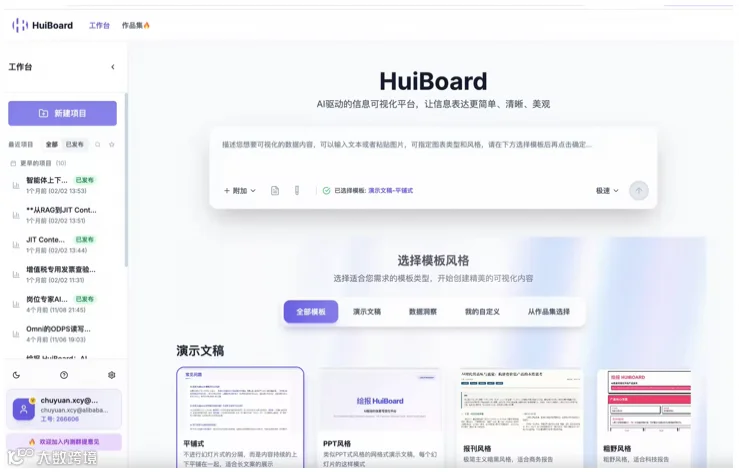

四、UI+内容质量联合评测案例:绘报PPT生成系统

依托AI Agent浏览器自动化能力,本案例突破纯接口层测试,实现真实UI环境下的功能验证与AIGC内容质量联合评测。

针对绘报平台近期生成的5个PPT项目,AI自动完成:

- 登录系统并识别当前项目列表;

- 逐个打开、渲染、解析PPT内容;

- 从功能可用性(是否成功生成)、视觉表现(排版/配色/图表)、内容质量(逻辑性、信息密度、语言表达)三维度打分。

最终生成5份评测集与1份综合报告,整体得分为85分,各项目均附详细问题定位与改进建议。

五、系统级自动优化案例:AI驱动的三轮闭环迭代

进一步打通“评测→分析→修复→再评测”链路,实现无需人工介入的系统自我进化。

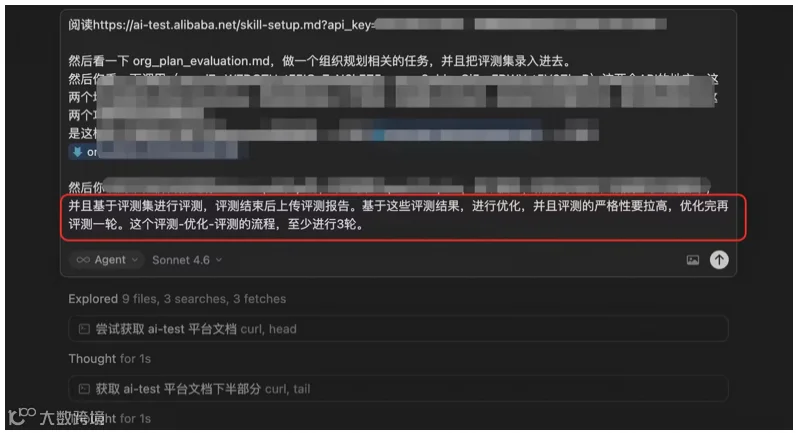

以某含AI能力的业务系统为例,在Cursor中输入评测平台链接及优化指令后,AI自动执行:

- 发布评测任务;

- 生成测试集并驱动系统完成真实运行;

- 基于输出结果进行多维评测(准确性、时效性、鲁棒性、可解释性、用户体验);

- 定位缺陷、生成修复代码、部署验证;

- 启动下一轮评测,共完成3轮迭代。

结果显示:v1版本得分90.7 → v2升至97.4 → v3达99.1,各维度优化路径清晰可见。

评测过程严格遵循真实用户路径,每个AI生成结果均等待实际推理完成后再评估,保障结果可信度。

六、实践总结与关键前提

上述案例验证了AI驱动评测与优化的可行性与高效性。其落地需满足两项基础条件:

- UI与基础设施规范化:不规范的DOM结构、缺失语义标签或动态加载异常易导致AI“迷路”,反向提示前端需优先提升可访问性与稳定性;

- 系统具备高AI Coding成熟度:本地可快速启动服务、接口契约清晰、配置驱动而非约定驱动,是AI完成端到端验证与修复的前提。老旧系统因环境缺失、断点过多,难以支撑此类自动化流程。