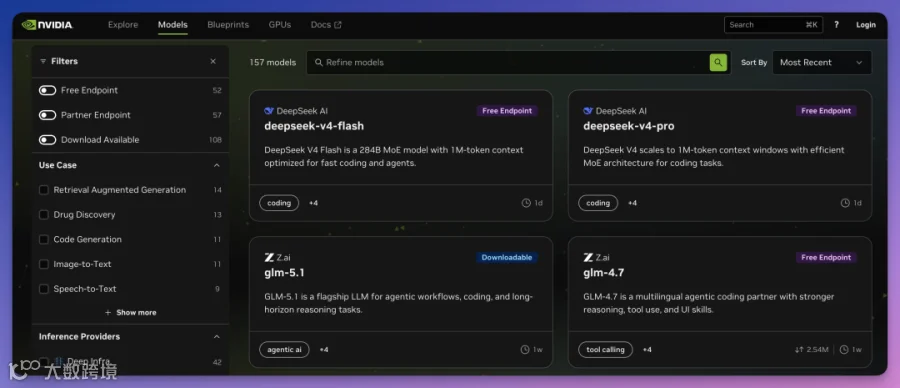

DeepSeek V4正式上线,英伟达NIM平台第一时间完成集成适配。该系列包含1.6万亿参数的V4-Pro满血版和2840亿参数的V4-Flash高速版,均以MIT协议开源,关键优势是免费开放调用。

DeepSeek V4与英伟达NIM平台

NVIDIA Inference Microservices(NIM)是英伟达推出的AI模型推理平台,支持GLM、Kimi、MiniMax等主流开源模型,并统一提供OpenAI兼容API调用接口。官方实测显示,V4-Pro在GB200 NVL72平台上单用户每秒输出超150 tokens。

“DeepSeek-V4-Pro作为全球最大开源模型(1.6万亿参数),可在NVIDIA Blackwell GPU上免费运行。”

核心参数说明:

V4-Pro:1.6万亿总参数,490亿激活参数,1M上下文V4-Flash:2840亿总参数,130亿激活参数,1M上下文

无需注册即可体验,但高峰时段可能出现响应延迟,日常基础对话完全满足。

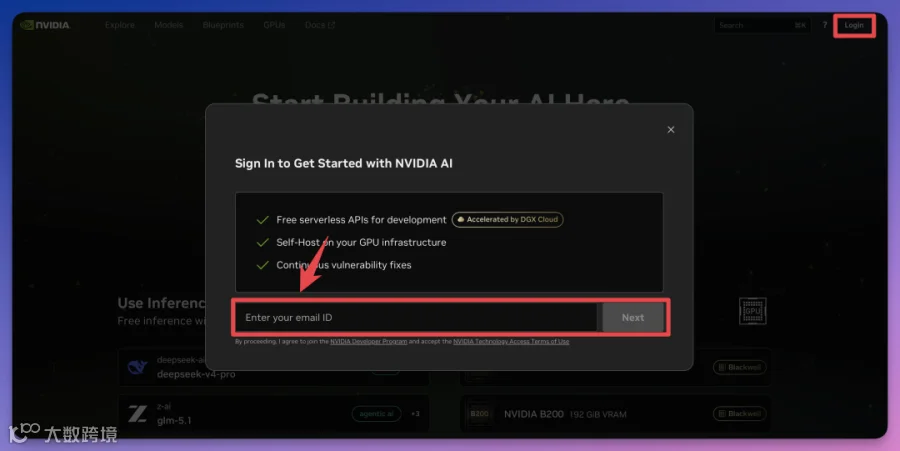

英伟达开发者账号注册流程

1. 访问build.nvidia.com,点击右上角Login输入邮箱

2. 设置密码并创建账号,查收邮箱验证码

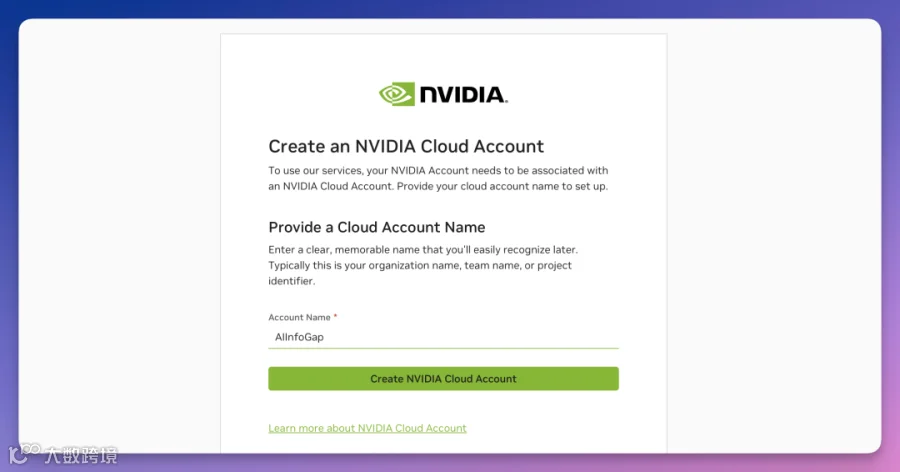

3. 输入账户名称,提交Create NVIDIA Cloud Account

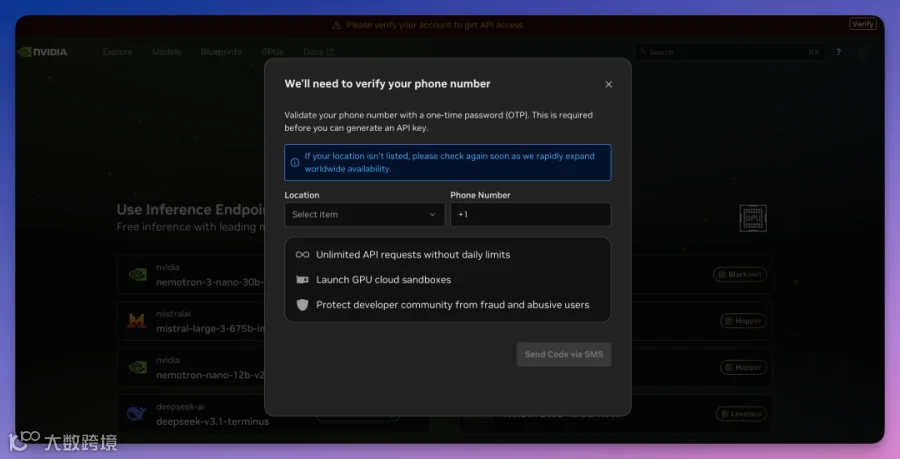

4. 点击右上角Verify完成手机号验证(支持国内号码)

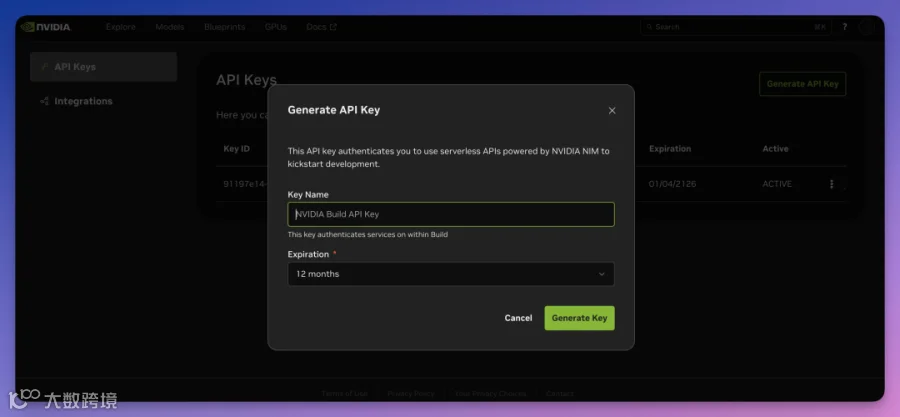

获取API Key操作指南

1. 登录后点击头像→API Keys→Generate API Key

2. 设置密钥名称,过期时间选择永不过期(默认100年)

3. 点击Generate Key获取nvapi-xxx_xxx格式密钥

该密钥可调用NIM平台所有免费模型,包括DeepSeek-V4系列。

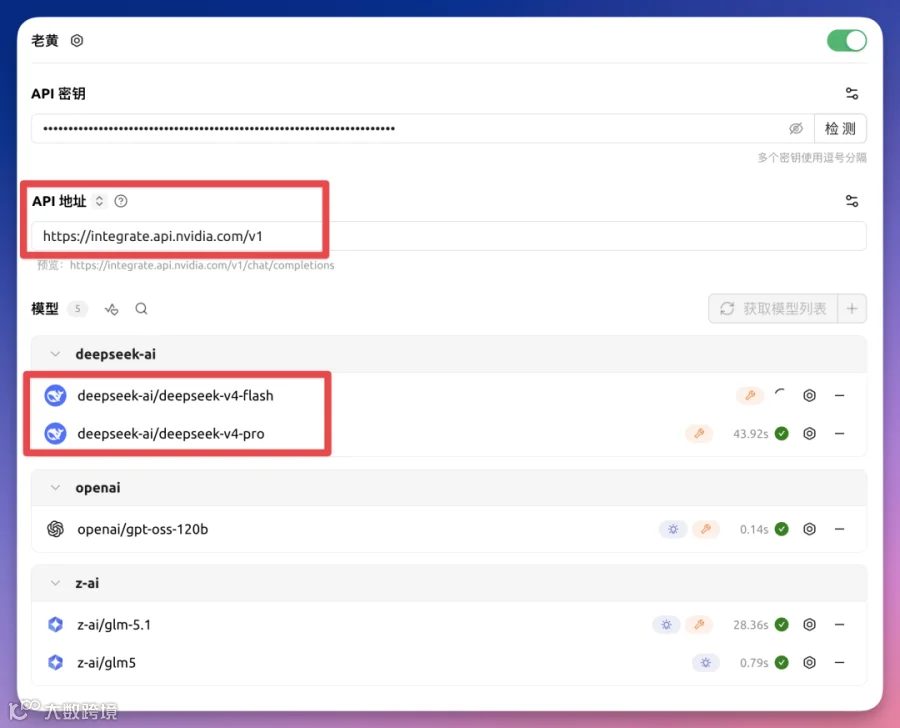

本地客户端配置方法

以Cherry Studio为例:

- 点击

设置→模型服务→添加,输入服务名称“英伟达NIM” - 配置参数:

- API密钥:粘贴生成的API Key

- API地址:

https://integrate.api.nvidia.com/v1 - 模型列表:添加

deepseek-ai/deepseek-v4-pro与deepseek-ai/deepseek-v4-flash

完成配置后可在模型选择器直接调用:

NIM平台同时提供其他开源模型:

z-ai/glm-5.1、z-ai/glm-5minimaxai/minimax-m2.7moonshotai/kimi-k2.5openai/gpt-oss-120b

推荐使用场景:

V4-Pro:适用于长上下文编程、深度文档分析V4-Flash:满足日常高频对话需求

当前NIM平台适合快速体验模型能力,但高峰时段可能出现限流。如需稳定生产环境支持,建议采用DeepSeek官方API(限时2.5折优惠)。