最近我在搞一个事儿,用GPT Image-2来做广告素材。我想大家最近两天一定被这样

这样

的AI生成作品刷屏了吧。虽然不得不感叹image2确实牛逼,但它实际用于生产力的能力怎么样呢,过程中又有哪些问题?

于是,在经过一天的尝试之后,就有了这篇文章。整个过程我是正儿八经的,按照真实投放标准,去尝试复刻高转化广告模板。

其实图片在我自己的工作流程中使用量是远小于视频的,之前确实也会AI图片或者单独生成封面之类的,但整体产量仍是以视频为主,倒不是有意而为之,说到底,还是人效和产能

作为投放,每天最头疼的就是素材产能。设计师永远不够用,外包质量参差不齐,自己用Canva拼又太慢。

长期不重视图片的弊端还是挺明显的,一方面图片在主流渠道就像FB、Google以及TT,往往很容易被忽略,同样的人力其实精力是更愿意分配在视频上的。但这会有一个弊端,就是很多图片原生流量位置其实是有机会跑出来的,但因为没什么深耕的,导致直接或间接错过一些流量。另外,像Mintegral、Applovin等网盟渠道,对比主渠道天然就喜欢图片类素材。不过如果你想做好一张图片素材,说实话,精力占比是丝毫不亚于一条爆款视频的。

直到这波GPT Image-2横空出世,看着全网刷屏的马斯克在dy直播间卖裤子,总统版恋与深空,我也试了一把,确实有意思,但紧接着我一想,不对,这么精细的控制能力,之前遇到的问题就都不是问题了呀

切回正题,这次更新的GPT Image-2 它到底NB在哪里?根据官方描述和我自己的体验,总结下来就3个点

1、言出法随,长prompt的理解更精准,包括录屏,产品细节,并且它自己是会思考的

2、多条件组合能力 人物、场景、光线等

3、商业需求方面的支持更好了,比方说产品图,banner、UI这些的支持会更好

于是,我花了差不多一天时间,从APP growing上面找了一堆各个赛道的头部素材,从里面抽出3个比较具有代表性的例子,延展聊聊GPT Image-2怎么用,以及边界在哪里,还有,如何控制。based on这套问题,我搞了一套Skill系统来解决它,并且将其开源在问末,大家如果有兴趣都可以试用。

先从最简单的开始。

电商广告。我找了一张近一个月在TT有6000w展示的护肤品广告图。

素材与数据来源于AppGrowing

我先让AI把这张图的设计逻辑拆了一遍。构图比例、字体层级、色彩搭配、信息优先级做一遍拆解。然后我把这些拆解结果喂给GPT Image-2,让它按照同样的结构生成一张新的护肤品广告。

出来的效果,怎么说呢,还不错。

真的还不错。构图比例几乎一模一样,产品摆放的位置、标题的大小关系、CTA按钮的颜色对比,都对了。如果你不仔细看,会觉得这就是同一个设计师出的第二版方案。

但我心里清楚,这只是"复制模板"。AI理解了广告设计的基础逻辑,能把视觉结构精准复刻下来,这个能力确实让我有点惊喜。甚至我们可以在此基础之上再做创新,根据不同产品卖点去调整信息层级,根据目标人群的审美偏好去微调色彩情绪,它可以一次批量输出100个不同角度的微调方案,谁能拒绝基于此的整整100组A/B test呢。

它是一个非常优秀的"执行者",但不是"策略者"。

不过作为第一个案例,我给它打个七八分吧。底子是有的。

顺着这个信心,我开始搞游戏方向的内容。

游戏广告。这次我选了一个2D卡通风的游戏横版图片素材

素材与数据来源于AppGrowing

我没有做很详细的画面拆解,因为我想留更多随机的发挥空间,所以这次的prompt很简单:

我这次想试的不只是复刻,而是风格迁移。

结果出来的那一刻。

我愣了一下。不是因为不好,是因为太好了。3D转2D,无需原稿,直接生成,结构与风格统一,甚至根据游戏性做了适配

风格迁移这个事儿,Image-2是真的强。它不是简单地换了个颜色滤镜,而是真的理解了"游戏调性"里应该有什么元素,然后把这些元素融进了原来的广告构图里。人物、配色甚至是防御塔等背景细节,该有的全有了,而且不突兀。

这已经不是复制了,这是定制化创新。

做完游戏这个案例,我是真的有点兴奋了。我心想,这玩意要是能稳定输出这个水平,广告行业的素材产能问题真的能解决一大半。

然后我就信心满满地开始了真人+产品风格融合的场景测试。

将一个美区的社交广告,迁移到中东市场。

这个案例的特殊之处在于,它是阿拉伯语的。

我给Image-2的brief是这样的,将人物换成中东女性,画面主色调暧昧粉红,文案是阿拉伯语,主标题、按钮文字、聊天气泡里的内容,都要是阿语。

图生成出来之后,第一眼看过去,视觉上依然很能打。粉红色调的渐变很梦幻,人物的表情和姿态都对,手机屏幕上的聊天界面设计感也不错。单纯看画面,我觉得至少八分。

但是。

我多看了一眼文字,emm 看不懂,不过 以我对于AI的了解,文字多多少少是会有点问题的。

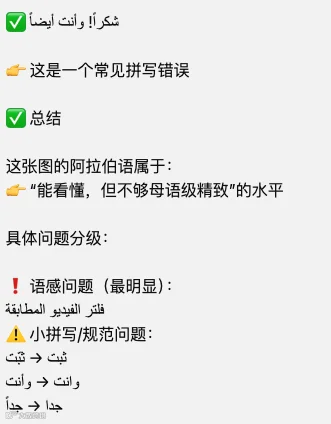

于是我让GPT帮我直接校准了一次,emm,问题还真不少

主标题就有问题。Image-2生成的阿语表达是一个很生硬的直译,那种一看就是机器翻译的感觉。语法结构没错,但是没有任何一个阿语母语者会这么说话。就好比你看到一个中文广告写着"请下载此应用以获取社交体验",你不会觉得它有语法错误,但你会觉得,这啥啊,说人话。

按钮文字更离谱。少了重音符号。你可能觉得一个重音符号有什么大不了的,但在阿语里,一个重音符号的差异可以改变整个单词的意思。

这种素材肯定是没办法用的,这就是目前AI的硬伤,文本不准确,不解决这个是很难大规模商用的。如果真的投出去了会怎样?中东用户看到一个社交App的广告,文字读起来一股机翻味,按钮上的字还拼错了,聊天内容像机器人在说话。转化率也肯定跟着大打折扣

但这一下反倒给我整清晰了,GPT Image-2最牛逼的点在哪里?视觉上的问题已经解决的差不多了,生图会像大模型一样思考,有细节,会模仿。构图、配色、风格、氛围感,Image-2做得真的很好,有时候好到让你忘记它是AI生成的。

但文本是另一回事。

尤其是小语种文本。阿语、西班牙语、法语、日语、韩语,这些语言每一种都有自己独特的语法规则、标点系统、书写方向、敬语体系、文化禁忌。AI目前在英文文本生成上已经做得不错了,但一旦涉及到这些小语种,翻车概率直线上升。

而广告恰恰是最不能容忍文本错误的场景。

一个品牌广告上的拼写错误,杀伤力比一封邮件里的拼写错误大一百倍。因为广告是花了钱推到用户面前的,用户会下意识地认为"这是这个品牌最认真的样子"。如果最认真的样子都有错别字,那产品质量能好到哪去?

想到这儿,我就开始琢磨一个事儿。

只靠Image-2生成图像是不够的。必须在图像生成之前,把文本问题彻底解决掉。不是"大概看看差不多就行",这里一定要是零错误的,一个标点都不能错。

回到我自己的工作流这块。

我做投放这么多年,其实一直有一套自己的素材审核流程。但以前审的是设计师做的图,主要看构图合不合理、卖点突不突出、CTA够不够醒目。文本校对这块,因为以前都是人工写的文案,错误率本来就低,所以不太需要专门的校验环节。

但AI生成的素材,完全是另一个逻辑。它的视觉能力远超文本能力,这就导致你很容易被漂亮的画面骗过去,忽略了里面藏着的文字雷区。

所以我搞了一个Skill,一个可以在AI工作流里反复调用的标准化流程。

这套Skill的核心原则就一句话,强制多轮文本校验加母语化改写,零错误之前绝不允许进入图像生成环节。

听着很简单对吧?但真正做起来,里面还是有蛮多细节的。

整个流程分七步走。

第一步,结构分析。拿到一个跑得好的广告模板,先用AI把它的设计逻辑完全拆解,构图网格、色彩系统、字体层级、信息优先级、CTA设计、视觉动线,全部量化记录下来。这一步就是我在电商案例里做的那个事儿,但要更系统化。

第二步,用户信息收集。明确目标市场、目标语言、目标人群画像、产品核心卖点、品牌调性。这一步很多人会觉得是废话,但我跟你说,90%的AI广告素材翻车,根源都在这一步信息没给够。你不告诉AI目标人群是中东25-35岁的女性白领,它怎么知道用什么语气什么措辞?

第三步,文案生成。基于前两步的信息,先让AI生成广告文案的初稿。注意,这一步只生成文本,不生成任何图像。主标题、副标题、CTA按钮文字、画面内的所有文字元素,全部先以纯文本的形式产出。

第四步,第一轮校正,语法和拼写。找AI做一次基础的语法检查和拼写检查。这一轮主要抓硬伤,缺失的重音符号、错误的语法结构、拼写错误、标点位置问题。

第五步,第二轮校正,母语化改写。这一轮是最关键的。把第四步校正过的文本,交给目标语言的母语校对(可以是母语同事,也可以是专门的母语AI模型),从"语法正确但不自然"改写成"母语者真的会这么说"。这一轮改动往往是最大的,因为AI生成的小语种文本,最大的问题不是"错",而是"不像人话"。

第六步,第三轮校正,文化适配和终审。检查文案是否触犯目标市场的文化禁忌、宗教敏感词、政治敏感表达。中东市场尤其需要这一轮,很多在英语世界完全正常的表达,翻译成阿语之后可能会有完全不同的含义。这一轮必须由了解目标文化的人来做终审确认。

做完这三轮校正之后,文本锁定,一个字都不能再改。

然后才进入第七步,视觉锁定和图像生成。把锁定的文本和第一步分析出来的设计结构一起喂给Image-2,让它生成最终的广告素材。生成之后还要做一次最终比对,确认画面中的文字和锁定版本完全一致,没有AI在图像生成过程中"自作主张"改了某个字。

整个流程走完,出来的素材才算达标。

你可能会觉得,这也太繁琐了吧,做个广告至于的吗?

我是真的觉得至于的。

你想想看,一条广告投出去,如果因为一个拼写错误导致点击率下降哪怕5%,乘以你的投放预算,那是多少钱?

顺着这个再聊聊,为什么小语种这么重要。

做出海的朋友应该都有感觉,全球移动广告市场的增长引擎,已经从英语市场转向了中东、东南亚、拉美这些新兴市场。这些市场的共同特点是什么?非英语。

阿拉伯语,从右往左书写,字母在词首词中词尾形态不同,有些元音不写出来需要靠上下文推断。西班牙语,有倒问号倒感叹号,动词变位极其复杂,拉美西语和西班牙西语用词还不一样。法语,有各种重音符号,性数配合规则严格,一个形容词的阴阳性用错了原生法语用户一眼就能看出来。日语,有汉字假名罗马字三套书写系统,敬语体系复杂到能写一本书。

这些语言的复杂性,目前任何一个AI模型都没有完全搞定。GPT-4也好,Claude也好,在这些小语种的文本生成上,都会犯各种微妙的错误。这些错误不是"文盲级"的低级错误,而是"外国人说中文"那种微妙的不自然,但对母语用户来说,一眼就能看出来。

而广告,是你给用户的第一印象。

所以我把这套Skill在设计的时候,针对每个目标语言都内置了一份专属的检查清单。阿语要查书写方向、字母连接形态、重音符号、宗教敏感词。西语要查倒标点、动词变位、地区用词差异。法语要查性数配合、重音符号、连字符规则。日语要查敬语等级、汉字选用、假名正确性。

这些清单不是我拍脑袋想出来的,是真的在实际投放中一个坑一个坑踩出来的。

说到这儿,聊聊我对未来的一些想法吧。反正我觉得这个方向是确定的。

AI图像生成的能力会越来越强,这个趋势不可逆。Image-2已经证明了AI在视觉创作上的潜力,未来的迭代只会更好。构图会更精准,风格迁移会更自然,细节会更丰富。这一波AI生成的广告素材在视觉层面已经能达到专业设计师90%的水平。

但文本呢?

我有时候觉得,文本生成其实比图像生成更难。因为图像的"好"是连续的、模糊的,差一点点色调、差一点点构图,用户可能感觉不到。但文本的"对"是离散的、精确的,一个字母错了就是错了,一个标点少了就是少了,没有"差不多对"这一说。

所以我的判断是,未来AI广告创作的瓶颈,不在视觉,在文本。更准确地说,在"去AI味"和"母语化表达"这两件事上。

谁能解决这个瓶颈,谁就能在出海广告这个赛道上建立真正的壁垒。

而解决方案,我觉得不会是某一个更强的模型横空出世就搞定了,至少短期内不会。我们仍需要给它加一些约束和矫正。

我始终坚信,工具越强大,流程就越重要。

好了,最后说点实际的。

这套Skill我已经整理好了,会开源放到GitHub上。里面包括完整的七步流程定义、各语种的专属检查清单、还有我在三个案例里踩过的所有坑的详细记录。

https://github.com/AgentGrowing/chatGPT-image-2-SKILL

欢迎大家使用,提提建议。

还有一件事想特别提醒所有在做投放的小伙伴。

不管你用不用AI做素材,请一定要重视文本校验。

这话听起来像废话,但非母语者确实很容易在一些小细节上翻车,甚至自己完全没有意识到。

文本是广告的最后一公里,也是最容易被忽略的一公里。

以上,这就是我用GPT Image-2做广告的全部实验心得。从电商的"还不错",到游戏的"卧槽真强",再到社交的"差点翻车",最后总结了一套三层校验的Skill系统。

既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐

谢谢你看我的文章,我们,下次再见。