大家好,我是鸣姐,专注探索AI给流量增长带来的新玩法,可合作:AI流量增长解决方案。

之前我分享,看到一个优秀的AI画作怎么样去反推提示词,给了一个公式,特别好使。

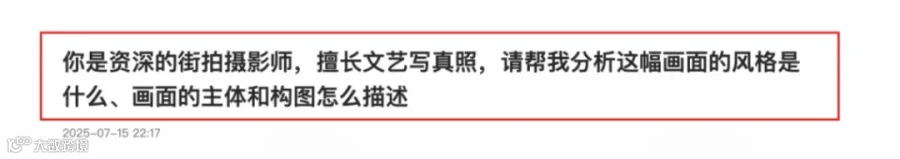

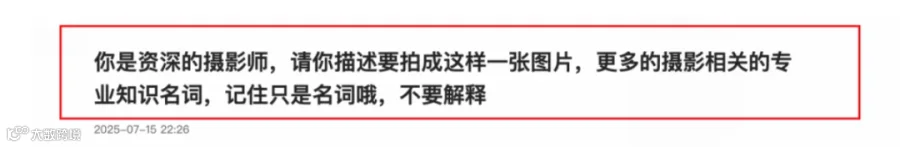

其中有一段和AI的对话,提示词是这样写的:

1.你是资深的街拍摄影师,擅长文艺写真照,请帮我分析这幅画面的风格是什么、画面的主体和构图怎么描述

2.你是资深的摄影师,请你描述要拍成这样一张图片,更多的摄影相关的专业知识

收到很多读者的留言,有几个读者留言问我,为什么要这样和AI对话?不用设定身份也可以。

为什么要分两次提问?一次讲清楚也可以。

如果只是简单的问题,确实直接提问、越简单越好,但我想说:

按照一定的提示词结构来写、养成习惯,遇到复杂的问题,AI的回答会给你惊喜。

就像要写出优秀的AI绘画提示词,可以遵循万能公式,平常和AI对话,要得到高质量的答案,也可以遵循一定结构。

所以这篇文章就分享,和AI对话的提示词结构。

先说一个基本的原则,你需要站在大模型的角度去思考,而不是只想着表达你的需求。

举个例子吧:

1.我是一个5岁孩子的妈妈,我想带孩子暑假去杭州玩3天,请帮我想想该怎么规划。

2.你是一个资深的旅游顾问,请为一对母子(孩子5岁)设置一个在杭州的3天旅行规划,语言风格是幽默风趣。

仔细看上面两个例子,思考几个问题:

两个提示词表达清楚需求了吗?有什么区别?你平常更习惯用哪个类型的提示词?

我的答案是,两个提示词都很清晰地表达了需求,区别是:第一个提示词是用户思维,用户在想我要什么;第二个提示词是模型思维,在想AI需要什么指令。

第二个提示词才是好提示词,那大模型需要什么样的指令?

我总结的两个点是:1.角色提示;2.背景提示。

还是上面这个例子,“资深的旅游顾问”是一个角色,“为一对母子(孩子5岁)设置一个在杭州的3天旅行规划”是一个背景指令。

背景指令就是定义了“模型应该做什么”的大方向,比如说“旅行规划”,在这个方向,你还可以有更具体的指令啊。

每天旅游两个景点、打卡杭州美食等等,这些指令都是在“旅行规划”这个大背景下的,对吧。

然后再解释下,为什么需要角色?

现在大模型的架构通常是MoE架构,翻译成大白话就是大模型内部有成千上万个专家。

它是什么样一个流程生成内容的呢?

比如说:1+1=?这个问题,数字老师会说“2”,语文老师会说“王”,当你问大模型“1+1=?”

模型里面的各种专家先给出不同回答,最后模型判断一遍不同答案的概率,结合上下文语境,输出一个概率最大的答案。

你设定一个专家角色,就是告诉大模型,调用这个专家背后的知识就好。

比如说给旅游规划这件事情,就让旅游顾问这个专家来回答,其他的像“数学家”“音乐家”等专家角色都不用来回答这个问题。

那它生成的各个答案都是在相关的知识里面找的,再根据概率判断一遍。

也就是说,顶多是杭州旅游攻略、上海旅游攻略等答案之间筛选,不至于出现一个“怎么教育孩子”的可能性答案。

好了,再总结一下,大模型生成答案的过程,就是调用它内部的各种专家角色来生成不同可能性的答案,然后根据上下文语境判断,给出概率最高的答案。

现在你再重新看下面这两句提示词,知道为什么后者是更好的提示词了吧。

1.我是一个5岁孩子的妈妈,我想带孩子暑假去杭州玩3天,请帮我想想该怎么规划。

2.你是一个资深的旅游顾问,请为一对母子(孩子5岁)设置一个在杭州的3天旅行规划,语言风格是幽默风趣。

读者还给我提了一个问题,为什么不一次性问完?

这里同样是一个习惯,我通常会对一个需求做拆解,先拆解出最重要的问题、搞清楚,再追问其他细节。

如果非要说有什么原因的话,那就是大模型的上下文指令窗口是有限的,那在输出答案的时候,也会考虑到长度,不会给很长的回答。

如果你的问题多、或者说复杂,它会省略掉一些细节。

所以来说,拆解问题、先问核心,这也是一个隐藏的需要你训练的思维。

还是那句话,AI是遇强则强,素质不详(短视频刷多了,真的忍不住接出后面半句)。

你把自己训练成一个提问、沟通的高手,你就发现AI是你的超强外挂。