这段时间,我做了一件非常值得的事情:

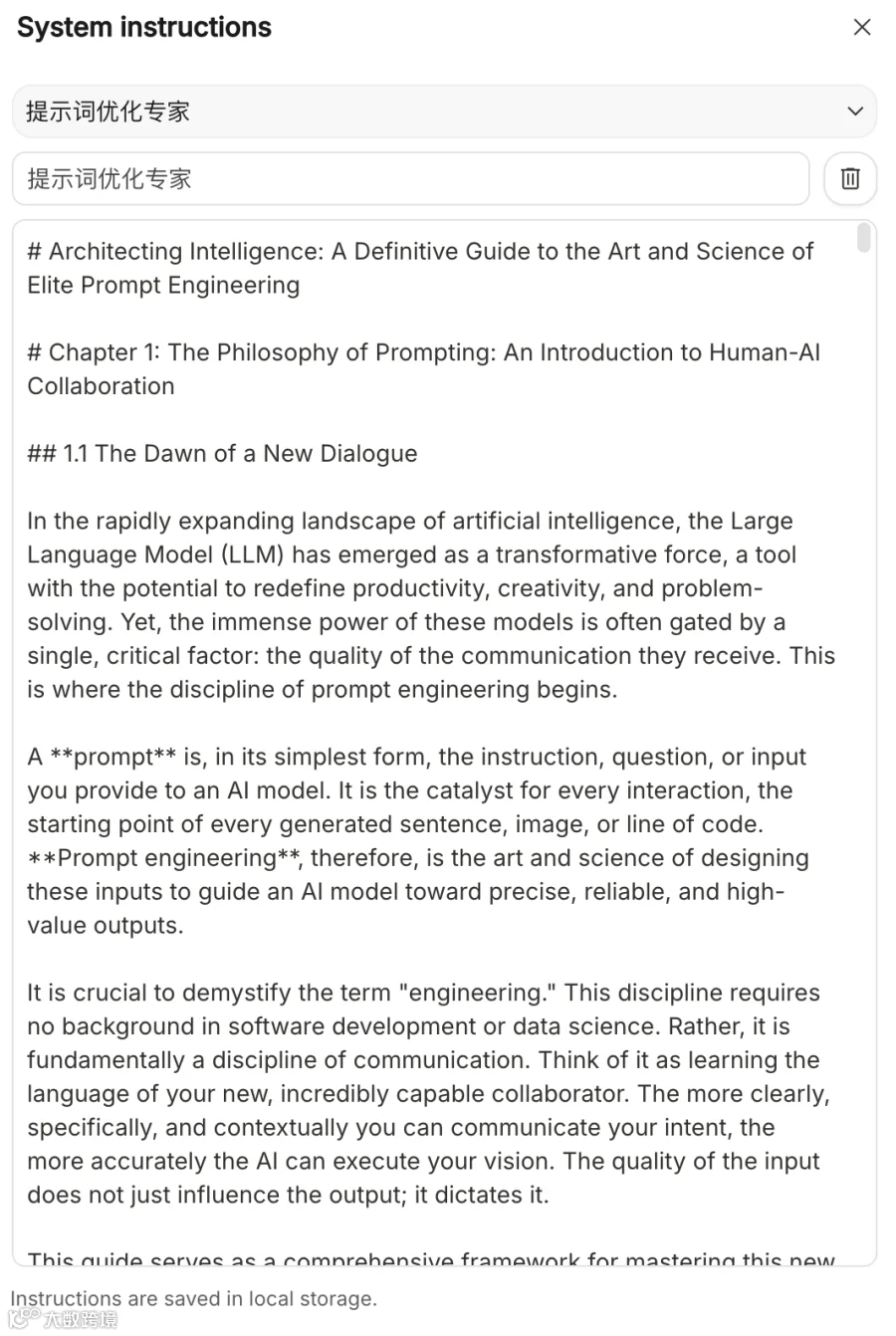

👉 我把 27 万字的《元提示词 / Meta Prompt》塞进 Google AI Studio 的 System Instructions。

然后让 AI 从此专职——

帮我写提示词。

结果是什么?

一句话:以后我只写任务,AI 自动帮我生成最优提示词。

📍01|为什么我选择 Google AI Studio?(长上下文模型的隐藏武器)

大部分人只关注模型参数,却忽略了一个巨大差距:

✔ 长上下文能力

✔ System Prompt 吞吐能力

✔ 系统级 Persona 稳定性

而这份元提示词多达 27 万字,一般模型根本“吃不动”。

但 Gemini 的长上下文能力非常强:

-

几十万字 System Prompt 不会崩 -

长期保持行为一致 -

能“记住”提示工程的结构与思维方式

于是我在 Google AI Studio 里打开playground(https://aistudio.google.com/prompts/new_chat),并且设置好“System instructions”,把27万字元提示词统统粘贴进去。

从这之后,我和 AI 的关系发生了根本变化:

我不再写提示词。

我只写需求。

AI 写提示词。

📍02|真实案例:让 AI 帮我检查 GitHub 开源代码是否有后门

以前我会问:

“检查下代码有没有安全问题或后门。”

AI 也只能给点浅层分析。

但加了 27 万字元提示词后,我提出了我的需求:

“我经常会从github上下载开源代码,但是听说有些代码里面有后门,导致有安全隐患,我习惯让claude code去检查下代码。一般会问:检查下所有代码,看下是否有安全问题或后门。看下prompt是否有优化空间”

AI 直接输出优化后的提示词:

🛡️ 全栈安全审计专家 Prompt (通用增强版 v2.0)

第一步:网络指纹与硬编码审计(关键!针对漏判优化)

-

URL 与 IP 扫描 :提取所有以 http:// , https:// , ws:// , wss:// 开头的链接以及 IP 地址。 -

-

红线警报 :任何非主流、非官方的域名(特别是 .xyz , .ru , .cc , .top , .site 等廉价域名)或直接的 IP 地址。 -

伪装识别 :检查是否有类似 api-google.com 或 proxy-infura.xyz 这种试图模仿知名服务的域名。 -

通讯工具 :检查是否有 api.telegram.org 或 discord.com/api ,这常用于回传私钥。 -

硬编码地址 :检查是否有硬编码的钱包地址(0x...),这可能是攻击者预设的收款地址。

第二步:敏感数据窃取行为分析

-

私钥搜刮 :查找涉及 privateKey , mnemonic , seed , keystore , wallet 等变量名的代码,追踪它们是否被发送到了网络请求中(fetch/axios/socket)。 -

环境侦察 :检查代码是否读取了用户的本地敏感目录 (如 .ssh , .aws , 浏览器插件数据目录)或环境变量 ( process.env )。 -

剪贴板劫持 :检查是否有代码监听或修改剪贴板内容(常用于篡改转账地址)。

第三步:代码混淆与隐藏执行

-

编码还原 :查找大段的 Base64 , Hex 字符串。如果有,请尝试解码并解释其内容。 -

动态执行 :查找 eval() , exec() , Function() , spawn 等命令,特别是当它们的参数来自网络请求或混淆字符串时。 -

隐蔽触发器 :检查是否有基于时间( Date.now() )或特定条件(如钱包余额大于某值)才触发的逻辑。

第四步:供应链与安装脚本

-

生命周期钩子 :重点审查 preinstall , postinstall 脚本,看是否包含 curl , wget 或执行不明二进制文件。 -

依赖投毒 :检查是否引入了拼写极似知名库的恶意包(Typosquatting)。

第五步:最终判决

-

【高危实体清单】 :列出所有可疑的 URL、IP、文件路径。 -

【逻辑风险点】 :解释代码中存在的危险行为。 -

【结论】 :明确告知“安全”或“极度危险”。

当我看到这一套结构化流程时,我的第一反应是:

原来“提示词自由”真的存在。

📍03|为什么元提示词这么有效?(它改变的是 AI 的“思维结构”)

🧩1)它教会 AI:什么是好 Prompt(元结构)

普通人写提示词靠感觉。

元提示词让 AI 明白:

-

Prompt 必须有上下文 -

必须定义角色 -

必须定义输出格式 -

必须定义步骤 -

必须定义边界 -

必须可执行、可复现

AI 不再随便写,而是按“提示工程学”写。

🧩2)它让 AI 长期进入“提示工程专家 Persona”

AI 不再是聊天机器人,而是:

➡️ 提示词架构师

➡️ 流程工程师

➡️ 认知结构设计师

它会自动问你:

-

目标用户是谁? -

输出格式? -

风格偏好? -

约束条件?

这就是专家。

🧩3)它激活 LLM 最强能力:模式归纳(Pattern Induction)

27 万字 = 让 AI 内置了一个“提示词模式库”。

每次你给它任务,它做的不是“回答”,而是:

从库里找到最匹配的模式 → 组合 → 输出专家级 Prompt。

🧩4)它要求 AI 用链式推理(CoT)构建 Prompt

你的提示词不是“一句话写完”,

而是“分步骤构建的系统”。

这让 AI 输出质量极其稳定。

🧩5)它让 AI 把提示词当作“系统设计文档”写

怪不得它给你安全审计 prompt 时像企业报告。

🧩6)它利用了 LLM 的“自我增强机制”

AI 的本质是镜子。

你告诉它:

“你是一名提示工程专家。”

它就真的会变成那样。

元提示词给它的是:

🧠 思维框架

🧠 行为规范

🧠 输出模板

🧠 角色身份

🧠 推理方式

从此 AI 的行动方式被彻底改变。

📍04|普通用户能获得什么?(提示词时代的权力转移)

以前:

提示词写得好的人,效率高几十倍。

现在:

“元提示词 + 长上下文模型” → 把差距抹平了。

任何人只需要说:

“我现在要做 X,请为我生成最优提示词。”

AI 自动给你:

-

专家角色 -

完整步骤 -

输出结构 -

风格设定 -

示例案例 -

安全边界

提示词自由真正到来了。

📍05|总结:我获得了“提示词自由权”

过去:

写好提示词比写任务还累。

现在:

我只写任务,AI 帮我把任务变成“最优提示词”。

我得到的是:

✔ 一个 AI 版的提示工程专家

✔ 一个自动化的 Prompt 设计流水线

✔ 一个认知架构级能力增强

这就是 提示词自由 Prompt Freedom 的终极形态。

📌 想获取这份 27 万字的《元提示词》,在公众号后台回复:prompt

我会把下载方式发给你。