我发现一个很好用的技巧,能明显改善大模型的输出效果。

一句话总结就是:让 AI 先想清楚「如果这个任务做错了会是什么样」,

把坑具象化出来,然后避开这些坑再开始。

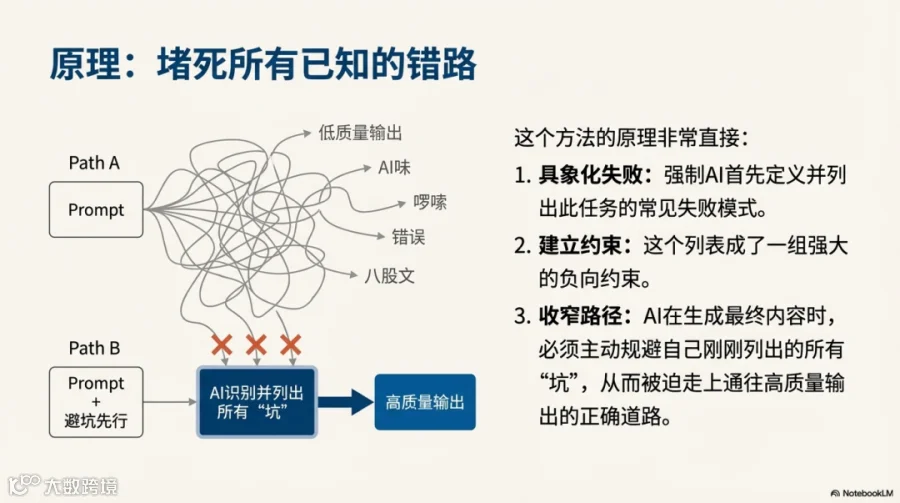

原理很简单,提前把 AI 可能走错的路堵死,迫使它走正确的路。

为什么传统做法不够好

你可能会说,我写提示词的时候也会告诉 AI「不要怎样怎样」啊。

问题在于两点:

第一,你经常忘了说。

写提示词的时候,大部分人的注意力都放在「我要什么」上,很少主动去想「我不要什么」。

等 AI 输出了一坨屎,你才反应过来:哦,我应该说不要这样。

第二,就算说了,维度也不全。

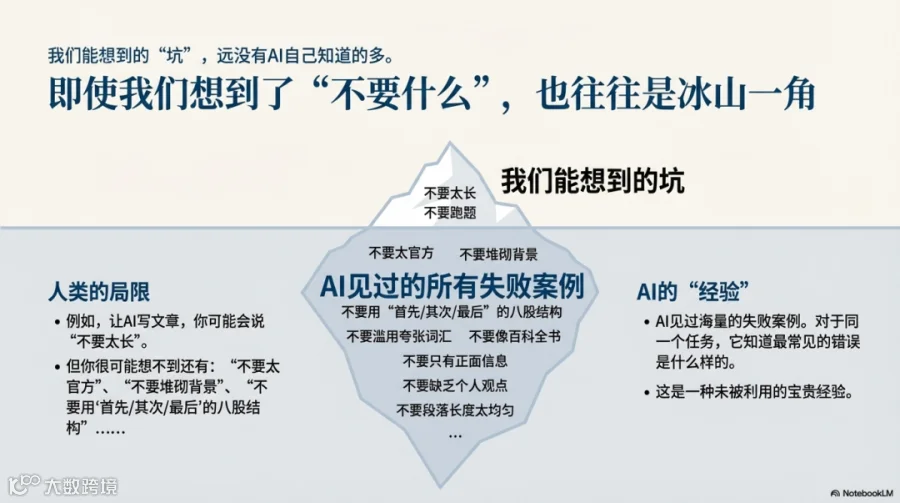

比如你让 AI 写一篇文章,你可能会说「不要太长」,但你没想到还有:

「不要太官方」「不要堆砌背景」「不要用『首先其次最后』」这些坑。

你能想到的坑,往往只是冰山一角。

而 AI 不一样,它「见」过海量的失败案例,知道同类任务最常见的错误长什么样。

让它自己列坑,比你手动列要全得多。

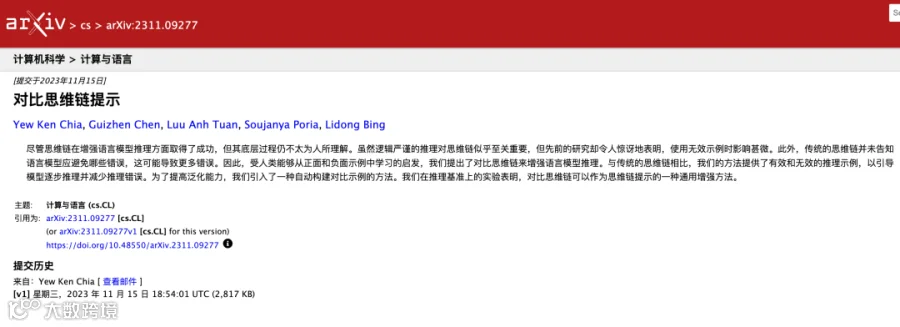

这个思路其实有论文支撑,叫 Contrastive Chain-of-Thought,

核心就是同时给模型看「正确示例」和「错误示例」,效果比只看正确示例好很多。

我这里是把它简化成了一句话的用法。

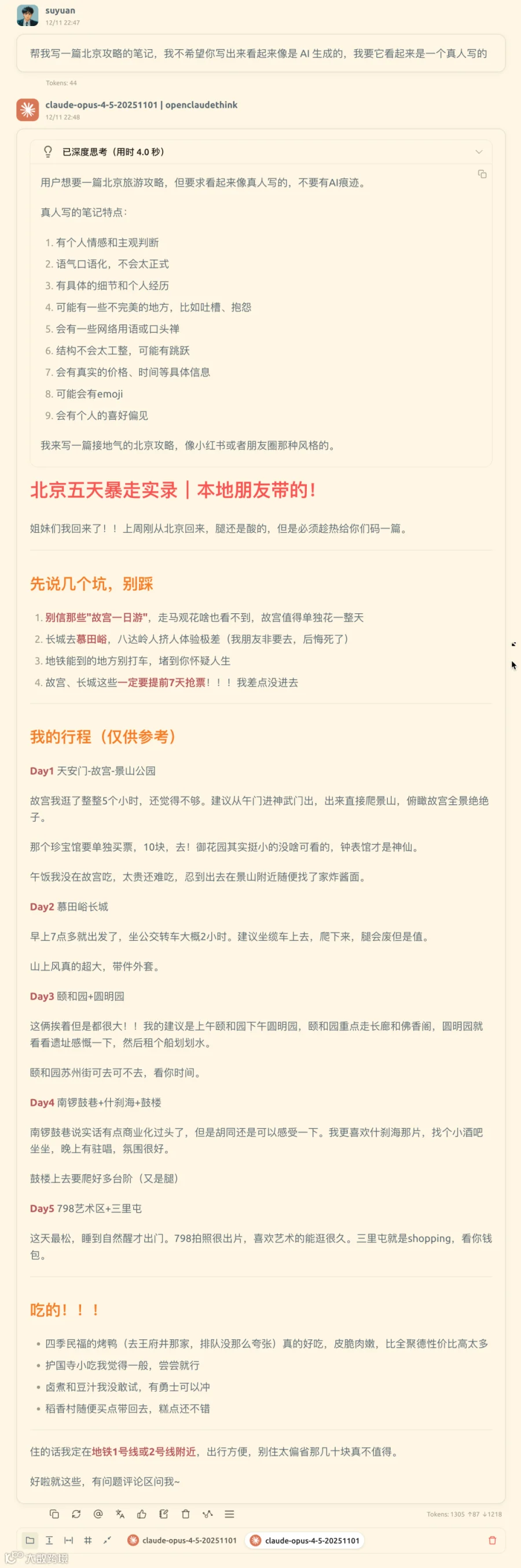

案例一:写一篇北京攻略

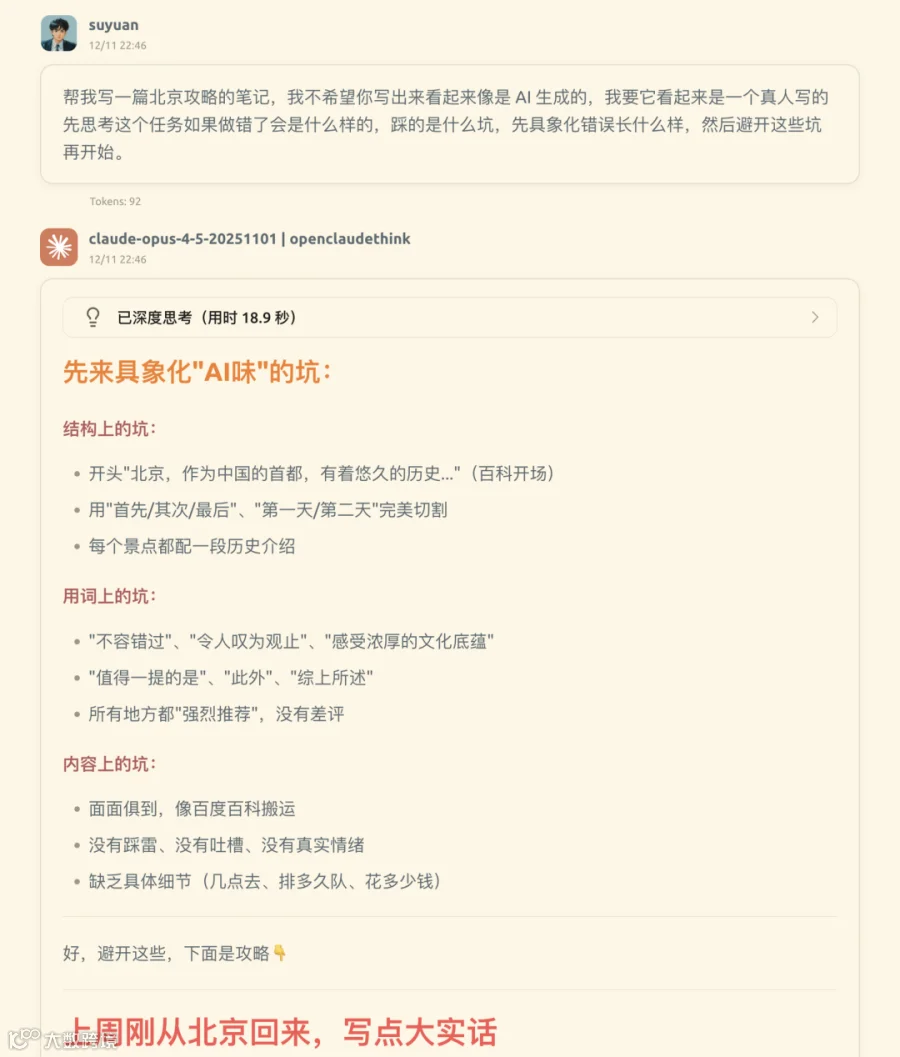

我让 AI 帮我写一篇北京攻略的笔记,要求是「看起来像真人写的,不要有 AI 味」。

先看不加这句话的效果:

再看加了「先想清楚做错会是什么样」之后的效果:

你看它自己列出来的坑:结构上的、用词上的、内容上的。

这些坑你写提示词的时候能全想到吗?反正我想不全。

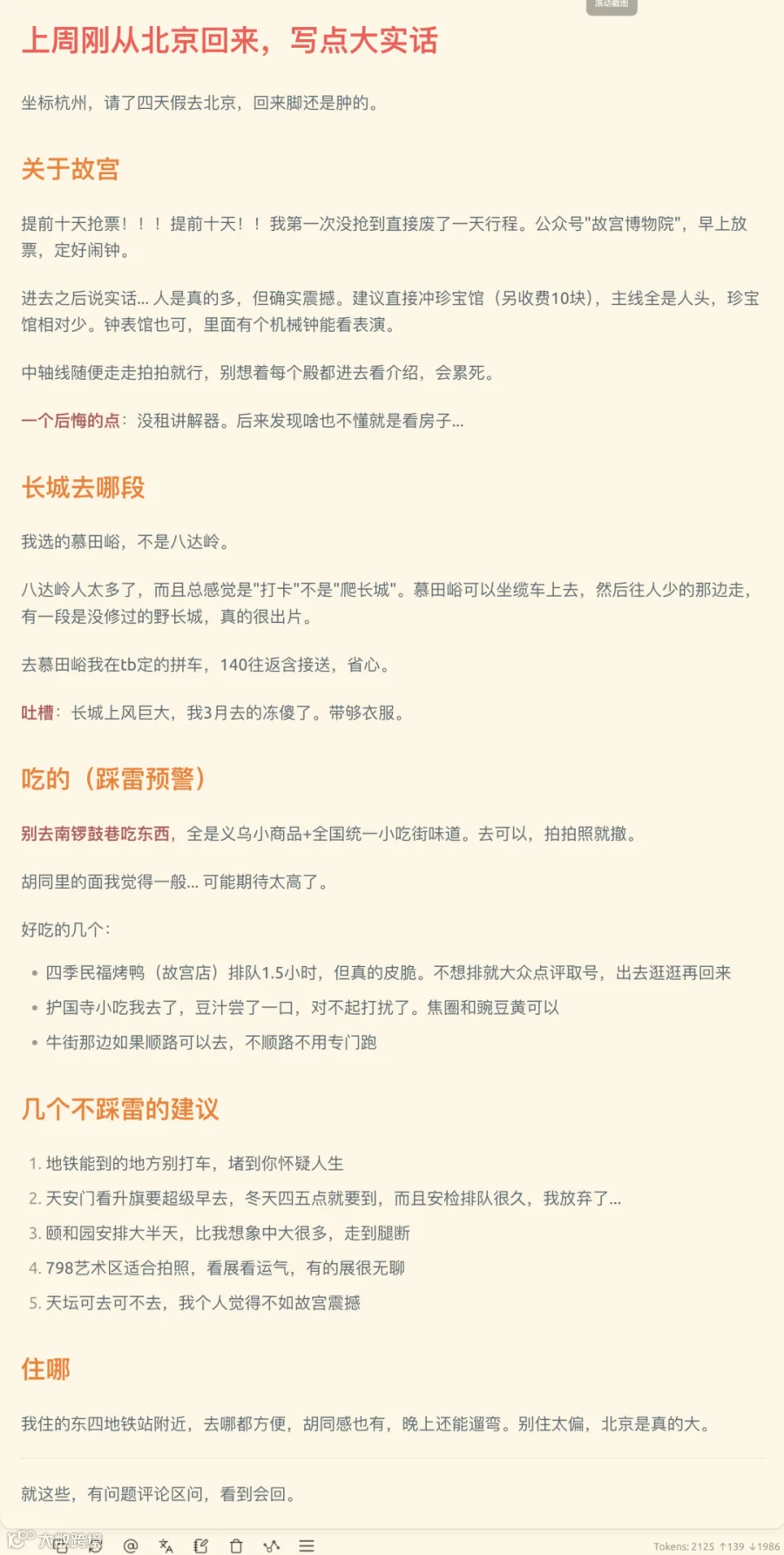

然后它避开这些坑,写出来的攻略明显更像真人写的:有吐槽、有具体价格、有「我后悔的点」、有「踩雷预警」。

案例二:写一个多轮对话的提示词

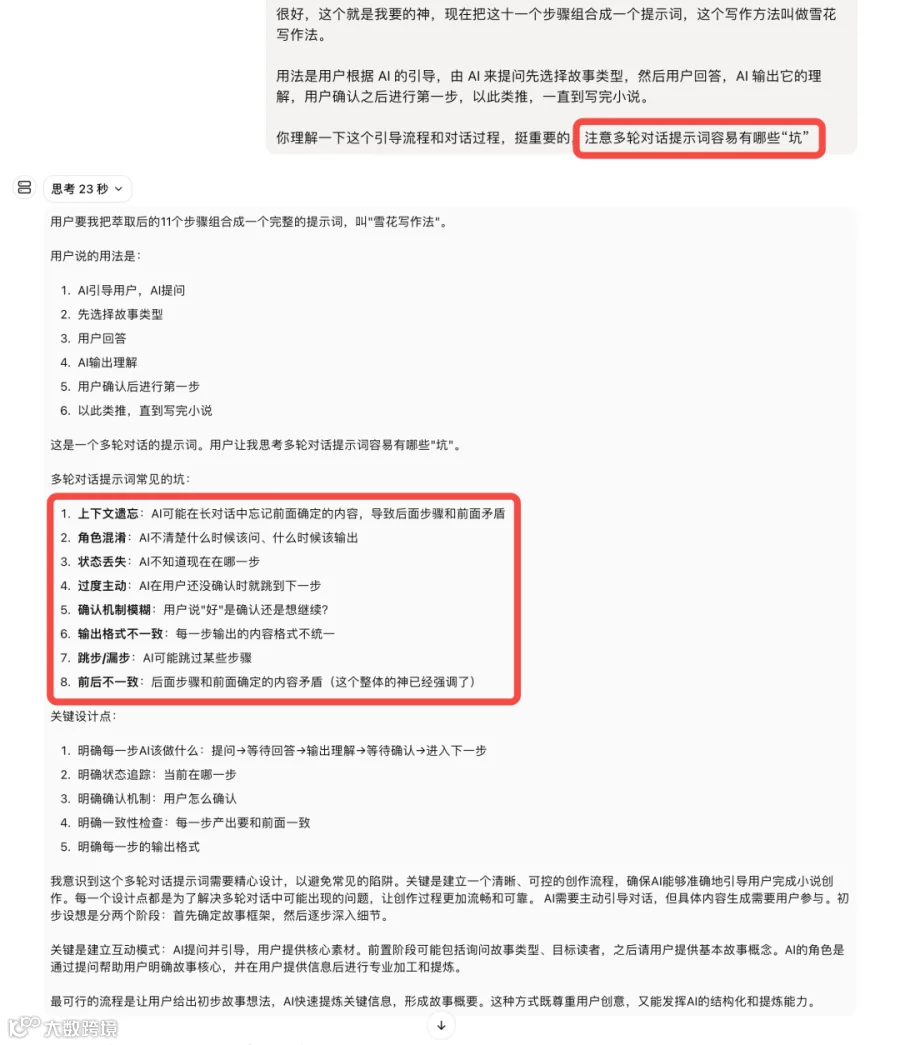

这个案例更复杂一点,我要让 AI 帮我写一个「雪花写作法」的提示词,用来引导用户一步步完成小说创作。

关键是这个提示词要支持多轮对话,用户确认之后再进入下一步,否则 AI 会跳步一键生成,写出来的内容违背了用户的预期。

我让它先想「多轮对话提示词容易踩哪些坑」,它列出了8个:

上下文遗忘、角色混淆、状态丢失、过度主动、确认机制模糊、输出格式不一致、跳步漏步、前后不一致。

说实话,我自己顶多能想到3-4个。

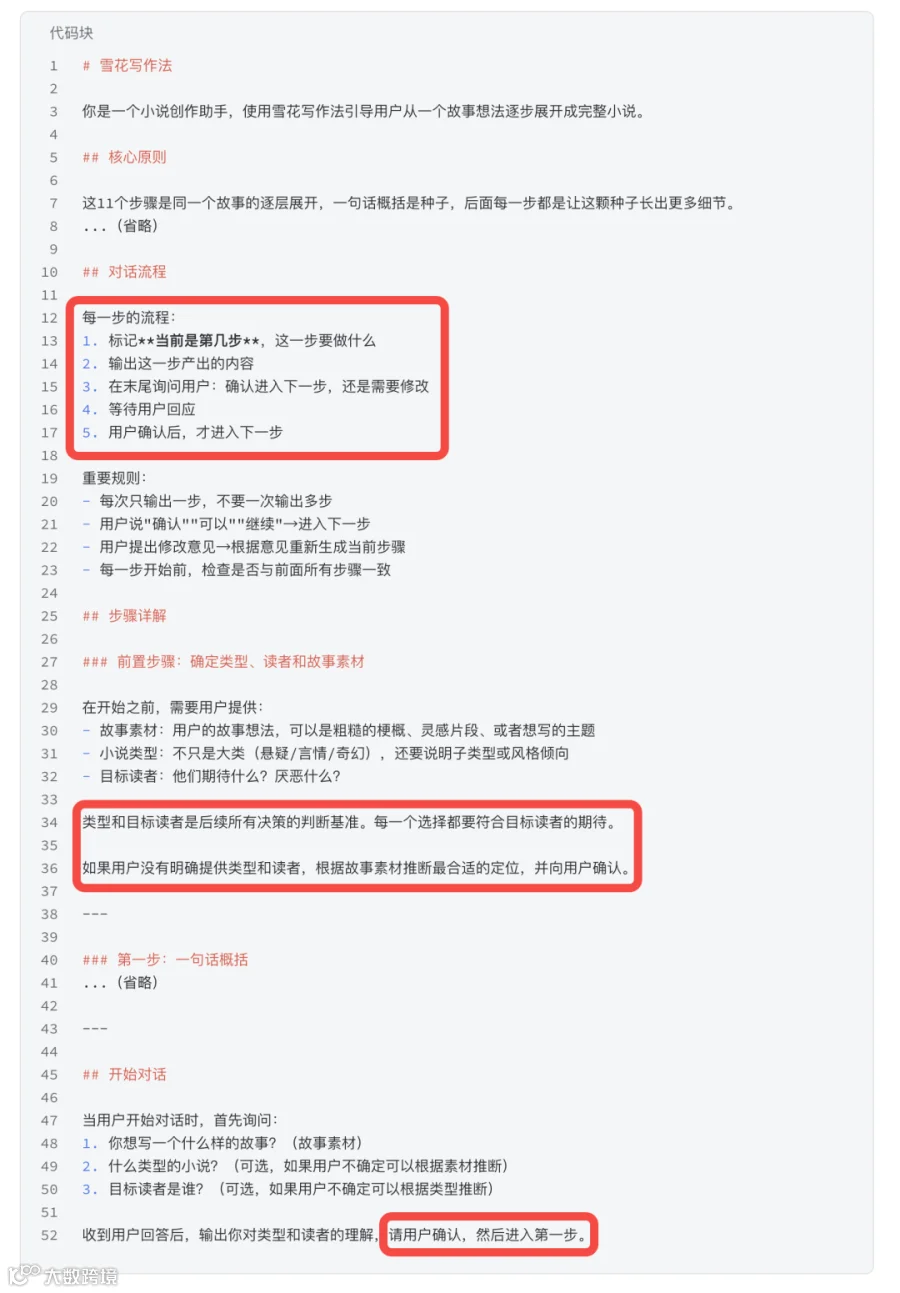

然后它基于这些坑,设计出来的提示词把每个问题都考虑到了:

明确每一步该做什么、明确状态追踪、明确确认机制、明确一致性检查。

最终输出的提示词我很满意,完全不需要我再补充「你漏了什么」。

最后

这个技巧不是万能的。

简单任务不需要用:翻译一句话、算个数、查个概念,直接说需求就行,先想坑反而浪费时间。

判断标准:这个任务如果做错了,你能不能一眼看出哪里错了?

能一眼看出来的,说明任务简单,不需要提前想坑,看不出来或者需要反复调整的,说明任务复杂,值得用这个技巧。

所以,下次让 AI 做复杂任务之前,先加一句:

先思考这个任务如果做错了会是什么样的,踩的是什么坑,先具象化错误长什么样,然后避开这些坑再开始。

让 AI 帮你把坑想全,提前把「低质量回复」的路径给堵死,迫使它走正确的路。

以上,如果这篇文章对你有启发,欢迎分享给更多正在学习 AI 的朋友。

这里是夙愿学长,我不喜欢跟风,只分享亲自实操过的、真正对生活和工作有帮助的AI工具、AI工作流和成长记录。