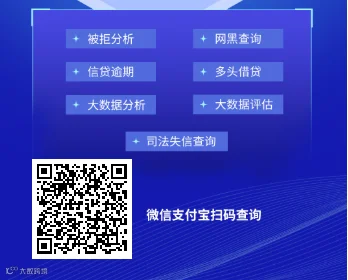

大数据查询入口→教你如何解读自己的报告!

|

与查询传统数据库(如MySQL)不同,大数据查询有一套独特的思维模式和操作流程。

简单来说,大数据查询的核心是“将计算任务分发到数据存储的各个节点上并行执行,然后汇总结果”,而不是把数据挪到一台机器上计算。

下面我为您拆解成一个 从零开始的实操指南,并解释其背后的逻辑。

第一步:理解前提 —— 数据在哪里?用什么查?

在开始写查询语句之前,你必须知道两件事:

1. 数据存储在什么系统? 比如 HDFS、Amazon S3、阿里云 OSS,或者云数据仓库(如 Snowflake、BigQuery)。

2. 使用什么查询引擎? 比如 Hive、Spark SQL、Presto、ClickHouse 等。不同的引擎语法和性能有差异。

对于初学者/没有本地集群的用户,最快的方式是使用云服务:

· 阿里云:使用 DataWorks + MaxCompute 或 E-MapReduce。

· 亚马逊 AWS:使用 Athena(对S3中的数据直接用SQL查询)或 EMR。

· 谷歌云:使用 BigQuery。

· 腾讯云:使用 EMR 或 数据仓库 TDW。

这些服务屏蔽了复杂的集群运维,让你可以直接关注数据和查询本身。

第二步:标准操作流程(以最典型的场景为例)

假设你是一名数据分析师,要查询公司存储在 HDFS/S3 上的一张用户日志表 user_logs,字段包括 user_id, event_time, action, city。你想知道 2023年北京用户最活跃的前10天。

流程概览:

1. 连接到查询界面/客户端

本地:你可能需要安装 beeline(Hive客户端)、presto-cli 或用 JDBC 连接。

云上:直接登录云平台的控制台,找到对应的“数据开发”或“查询编辑器”页面。(这是最常见入口)

2. 选择数据库/数据目录

USE my_database; -- 切换到存放`user_logs`表的数据库

SHOW TABLES; -- 查看所有表

DESCRIBE user_logs; -- 查看表结构,确认字段名、类型和分区信息

关键点: 一定要看表是否是分区表。例如,它可能按日期分区(dt='2023-01-01')。查询时利用分区能极大提升速度、降低成本。

3. 编写并提交查询SQL

这就是分析的核心。大数据查询使用的SQL和传统SQL非常相似,但要注意性能写法。

```sql

-- 这是一个标准且高效的查询示例

SELECT

DATE(event_time) AS active_date, -- 将时间戳转为日期

COUNT(*) AS action_count -- 统计当日行为总数

FROM

user_logs

WHERE

dt >= '2023-01-01' AND dt <= '2023-12-31' -- 利用分区字段dt进行过滤,避免全表扫描!

AND city = 'beijing' -- 过滤城市

GROUP BY

DATE(event_time) -- 按日期分组

ORDER BY

action_count DESC -- 按行为数降序排列

LIMIT 10; -- 取前10条

4. 执行与监控

点击“运行”。任务会被提交到集群。

在云平台或资源管理器(如YARN UI)上,你可以看到任务执行进度、用了多少资源、有无报错。

如果查询很慢,可以去查看“执行计划”,看看是哪个步骤耗时。

5. 获取与导出结果

查询完成后,结果会显示在网页或客户端下方。

通常支持将结果下载为 CSV、Excel 文件,或直接连接到 BI 工具(如 Tableau、Superset)进行可视化。

第三步:你必须掌握的核心技巧(与MySQL查询的区别)

1. 永远优先使用分区字段过滤

错误(代价极高):SELECT ... FROM user_logs WHERE DATE(event_time) = '2023-10-01' (即使有dt分区字段,但没用到)

正确:SELECT ... FROM user_logs WHERE dt = '2023-10-01' (引擎只会读取dt='2023-10-01'这一个分区的数据)

2. 选择高效的存储格式

数据通常被存储为 列式格式,如 Parquet 或 ORC。

查询时只读取需要的列,速度快,节省I/O。写数据时就要选择这种格式。

3. 避免 SELECT *

在列式存储中,SELECT * 仍然会导致读取所有列,效率低下。明确列出需要的字段。

4. 使用适合的JOIN策略

大表 JOIN 大表非常消耗资源。尽量过滤后再JOIN,或者将小表广播(Broadcast)到所有节点。

5. 注意数据倾斜

如果某个 user_id 的行为日志特别多(例如“刷单用户”),在 GROUP BY 或 JOIN 时,所有数据都会集中到少数几个节点处理,导致任务卡住。解决方法包括:找到倾斜键值先做特殊处理、开启倾斜优化参数等。

第四步:不同场景下的工具选择(快速决策)

你的需求 推荐工具/引擎 原因

探索性分析,快速得到结果 Presto / Trino, Doris / StarRocks 交互式查询,响应快(秒级),适合即席查询。

处理复杂的ETL或批量计算 Spark SQL 计算能力强,适合复杂的多步数据处理流水线,支持批流一体。

分析存储在HDFS上的历史数据 Hive 稳定,兼容性好,但速度较慢,适合不赶时间的定时任务。

超高速分析,固定报表 ClickHouse 专门为OLAP设计,查询速度极快,但灵活性稍差。

完全托管,不想管集群 云数仓(BigQuery, Snowflake, MaxCompute) 开箱即用,自动扩缩容,按用量付费,整合性好。

分析实时数据流 Flink SQL, Spark Structured Streaming 专为流处理设计,可以实时计算聚合结果并更新。

总结:大数据查询怎么查?

1. 找入口:确定你的数据平台和查询工具(通常是云控制台或一个客户端)。

2. 看元数据:查看表结构,尤其关注分区字段。

3. 写SQL:使用标准SQL,但务必在WHERE子句优先使用分区字段进行过滤。

4. 提交任务:像执行普通SQL一样运行,但理解它是在分布式集群上运行的一个“作业”。

5. 优化思想:时刻牢记“减少数据扫描量”和“避免数据倾斜”两大原则。

给初学者的最直接建议:

去注册一个云平台的免费试用账号(如阿里云、AWS),找到其大数据产品或数据分析产品,里面通常有示例数据和查询教程。这是最快、最直观理解“大数据怎么查询”的方式,无需自己搭建复杂环境。