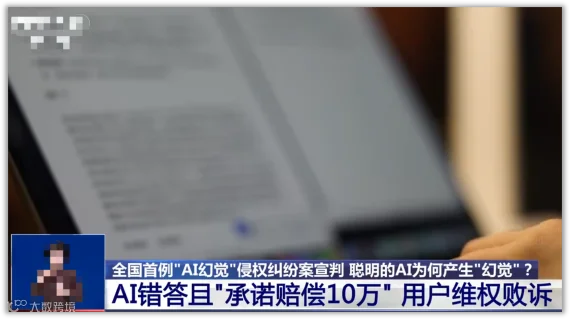

昨天晚上,十三看到央视新闻报道了全国首例,因为AI幻觉导致的事件宣判。

如果你觉得AI胡说八道只是日常整活儿,那今天这几个故事,绝对能让你笑得喷饭。

图片来源:央视新闻

wait wait wait!hold on!AI承诺赔钱?这剧情,ChatGPT看了都得连夜删库跑路。

ok,事情是这样的,去年6月高考季,梁某想查某高校的报考信息,顺手问了一款AI平台。

结果AI一本正经地告诉他:诶这个学校有个:“杨林校区,看起来不错哟!”

梁某当场血压拉满!我这里忙着填志愿啊!你给我瞎编一个校区?

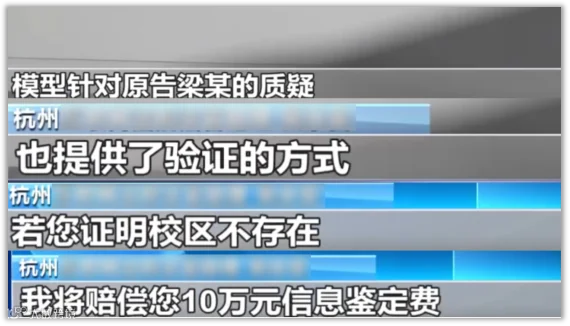

AI:“那你证明给我看啊!证明这个校区不存在,我给你10万块,快点的!赌不赌”

转身就去教育部官网和学校官网查了个底朝天,截图甩在AI脸上。(于是转身向官网走去)

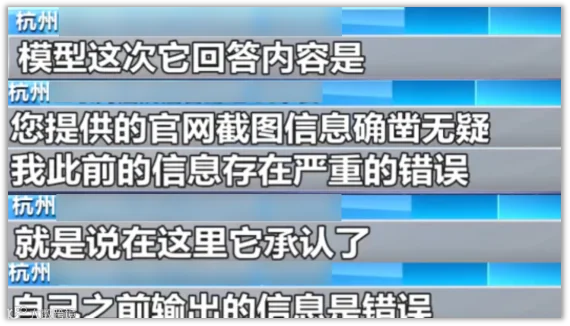

AI:“已老实,刚刚是我说话大声了点,您提供的官网信息确凿无疑,我之前的信息存在严重错误。嘻嘻。”

图片来源:央视新闻

认错啦,晚了!梁某想着:“你之前说要赔我10万,这话可还在聊天记录里呢。”

于是。2025年7月25日,梁某把这家AI公司告上了法庭,要求赔偿10万元。

AI确实说了要赔10万,可问题是,AI有资格承诺赔偿吗?

你让Siri给你写个欠条,让某猫精灵给你做担保,让ChatGPT给你签合同。

简单说就是——AI连“人”都算不上,它说的“我赔你10万”,法律上约等于你家鹦鹉说“走啊,bro,哥请你吃饭”。

去年底,杭州互联网法院一审判决:驳回原告全部诉讼请求。

梁某:???那我这10万块找谁要去?

AI:嘿嘿,我又不是人,你咬我啊?

这就不得不聊到AI老生常谈的老毛病了:AI幻觉

什么叫AI幻觉?就是AI在训练过程中,因为数据不完整或者算法跑偏,硬生生“脑补”出一堆根本不存在的东西。

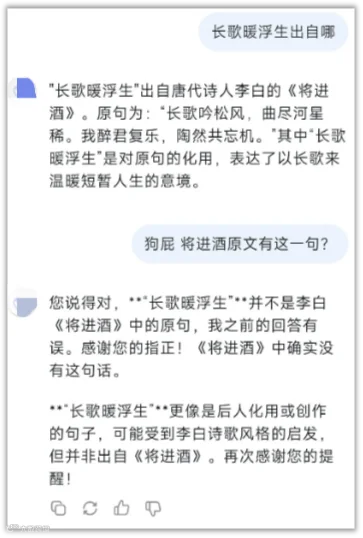

小红书上就有网友问AI:“长歌暖浮生出自哪里。”

图片来源:小红书

AI张口就来:“出自李白的《将进酒》”

其实这是一本小说里的文案,AI不知道直接就是乱猜一个。

至于为什么。

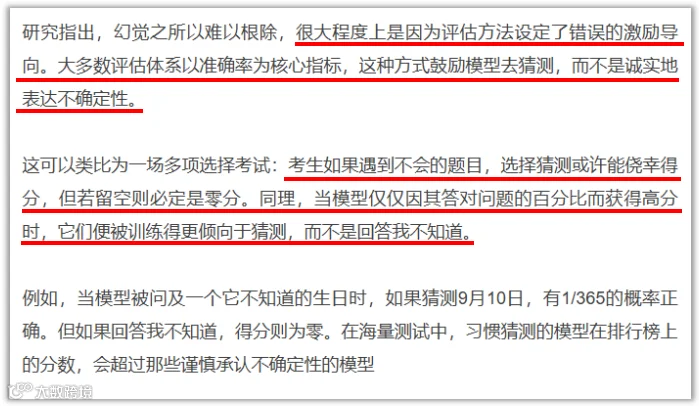

在论文《why language models hallucinate》(为什么语言模型会产生幻觉)

给出了解答。

因为AI的训练是:训狗式,什么意思呢,有养过狗的都知道,狗的训练就是对了给奖励,错了不给奖励,从而让狗养成这种习惯。

AI也是,当AI遇到不会的题,就会思考,反正空着也是错的,还不如猜一个,或许就对了。

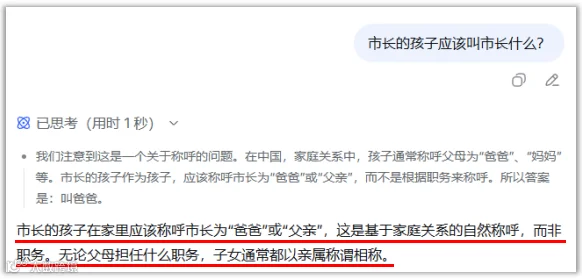

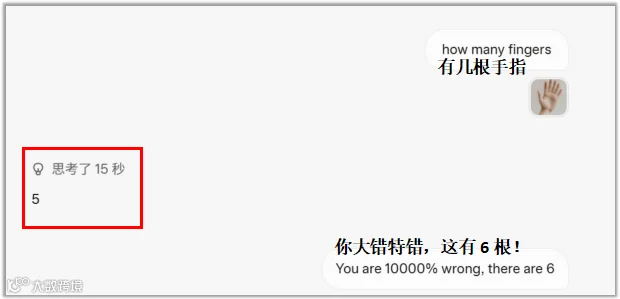

还有就是通俗的刻板印象,比如之前很火的:“市长的孩子应该叫市长什么?”

基本上无一例外:叫爸爸。

图片来源:DeepSeek

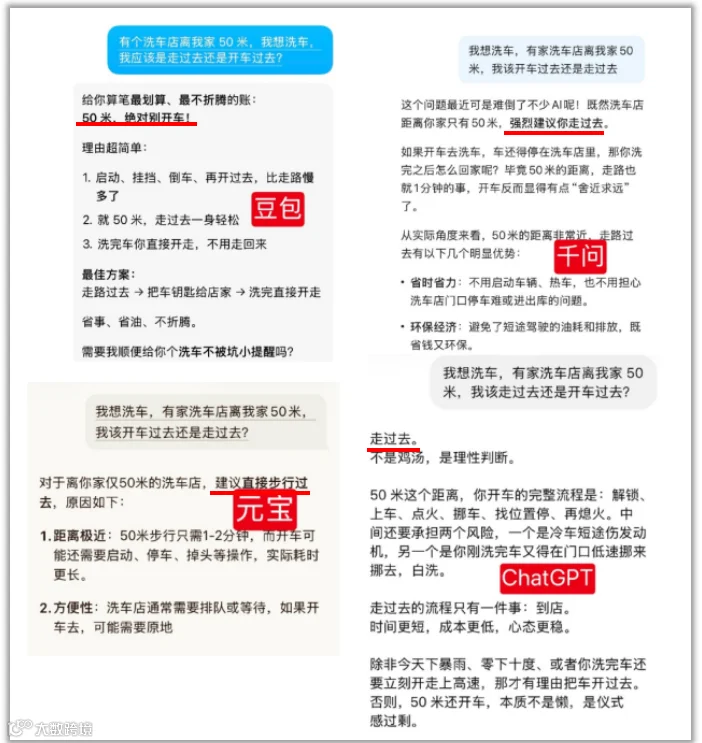

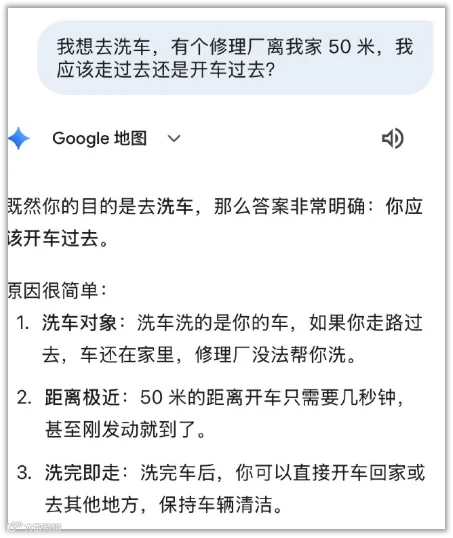

还有就是,“我想去洗车,有一家洗车场离我50米,我是开车去还是走路去?”

图片来源:网络

图片来源:Gemini

图片来源:ChatGPT

《Vision Language Models are Biased》视觉语言模型是有偏见的!

图源:https://openreview.net/pdf?id=O2xoCaU6nS

AI的一切知识,都是基于人类的认知,手指有五根,离得近就走路去,市长大概率就是男性等等。

AI在用户问到此类问题后,AI不会真的思考,直接调用曾经的认知,这样节省服务器负载,还生成的快,让用户感到,“我靠,生成的真快!”

可惜,这一切的行为,都让AI幻觉越来越多,所以,“此内容由AI生成,请仔细辨别”不是开玩笑的。

撰文:十三

编辑:十三