在 “东数西算” 国家战略与 “双碳” 目标的双重驱动下,高密算力中心迎来爆发式增长,传统风冷模式已难以满足高效散热与低碳运营的核心需求。我们以液冷技术为核心底座,联动热泵余热回收与光伏自发自用技术,打造面向未来的低碳算力中心液冷综合能源解决方案,精准破解算力中心 “高能耗、高 PUE、高散热压力” 三大痛点,为运营商、互联网头部企业及央企算力集群提供安全、高效、系统化的能源管控路径,抢抓算电协同发展的政策与市场机遇。

当传统通算(流程计算)向智算(认知计算)的演进大幕拉开,互联网过去40-60年积累的数据在算力催化下正在释放空前能量。

随数据中心CPU和GPU性能的不断提升,其功耗也随之激增,散热成本上涨的趋势非常明显。从GB200 NVL72到GB300 NV72(散热成本增加20%),再到Vera Rubin NV144(散热成本增加17%),在散热需求激增下,液冷产业出现爆发式增长。

液冷产业已进入爆发式增长阶段。根据国际数据公司(IDC)预测,预计2025年中国液冷服务器市场规模达33.9亿美元,同比增长42.6%。从长期来看,2025~2029年复合增长率将保持48%的超高增速,2028年市场规模有望突破162亿美元。其中,英伟达相关芯片配套的液冷需求占据核心份额,成为市场增长的主要引擎。

在算力中心,用户三大核心需求:

安全:尤其在芯片侧,涉及到高密度高价值产品,相关配套必须以高标准要求,而目前行业的典型要求就是英伟达产品匹配的认同;

能耗:高耗能产业,如何降低能耗是在安全之后的第二需求要点;

综合:算力中心能源,本身就是个系统工程,从各种供冷的选择及综合管控,是必不可少的环节,这里涉及到了整体的控制和算法及数字化应用。

核心用户:

市场机会:

国家推动“算电协同”,鼓励液冷与余热利用

地方政府对PUE、绿电比例提出硬性指标

数据中心绿色采购标准逐步落地,液冷成加分项

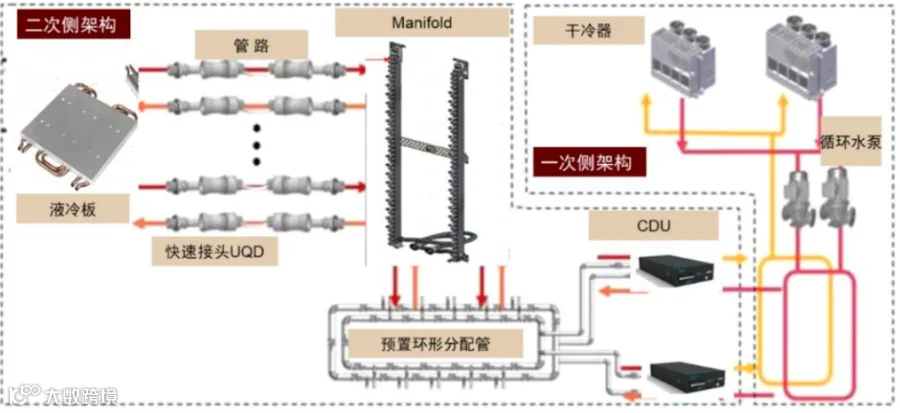

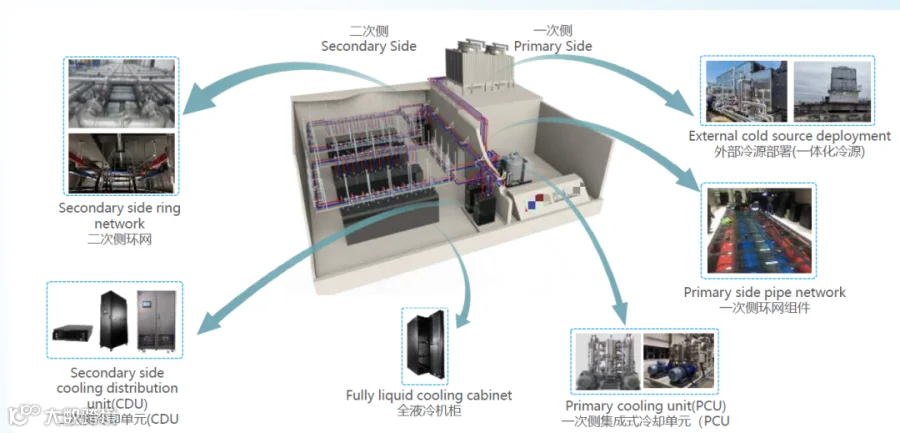

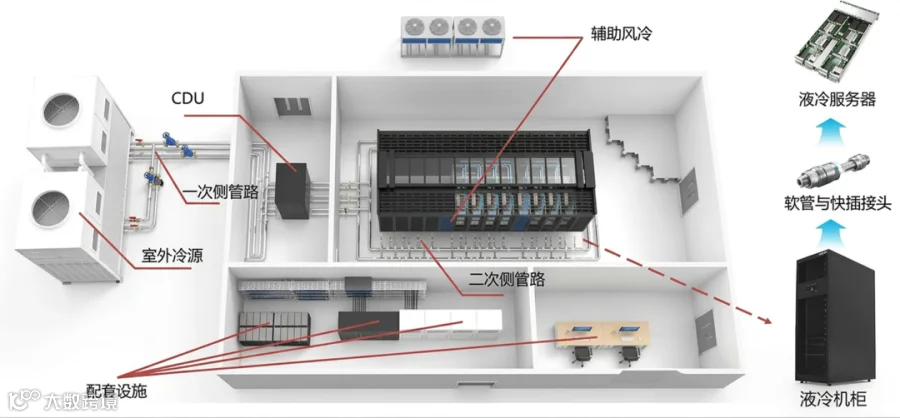

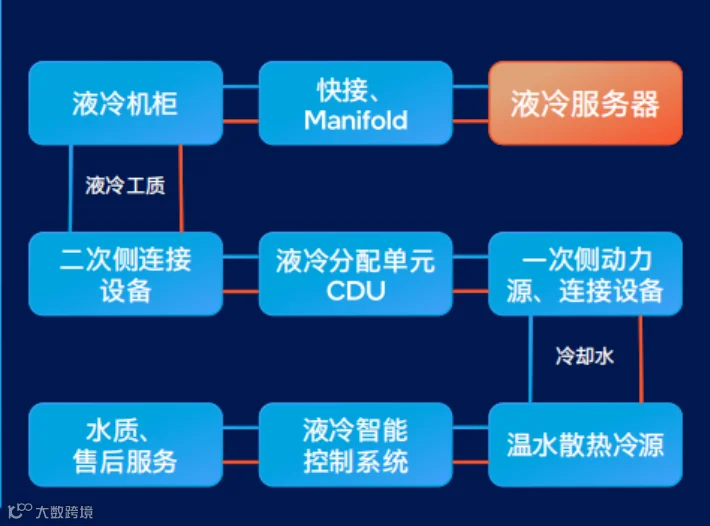

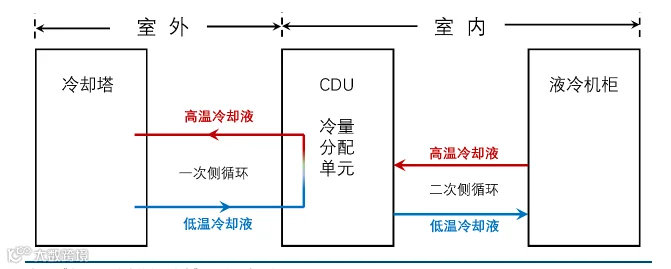

以冷板式液冷解决方案为例,智算中心冷板式液冷解决方案采用“室外冷源(一次侧)+ CDU 换热(二次侧)+ 芯片冷板(末端)”三层架构。每一层的内容都涉及到了设备选型到到系统控制到云端监管,以及不同冷源的组合配合。目前市场整体控制系统和管理系统目前未成体系。若在特定场合的算力中心中,热泵及光伏的配套应用,可进一步优化算力中心的能耗问题。

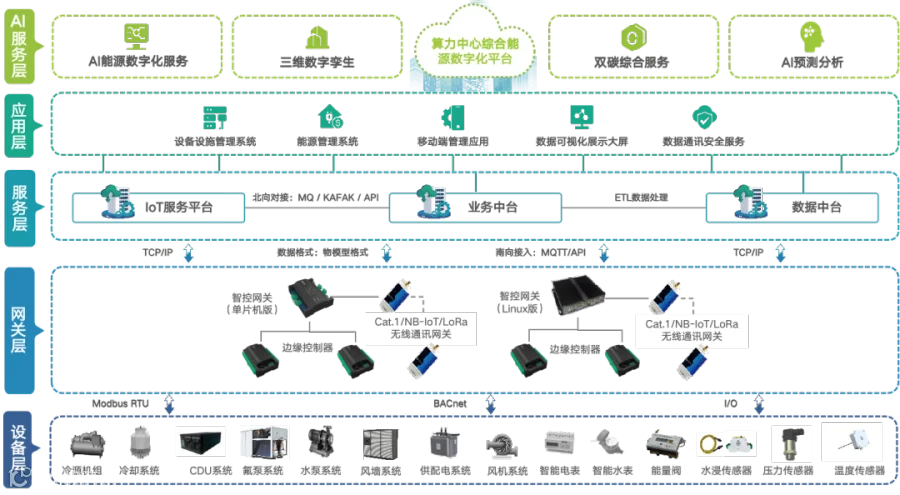

通过整体控制+平台管理身份入手组合整体产品,控制产品以集成为主,同时通过数字化平台进行整体管理。

通过构建“一次侧冷源+二次侧循环+末端液冷”三层协同架构,围绕服务器机柜、CDU冷却分配单元、冷站系统及余热回收模块,实现全流程智能感知与动态优化。

通过AI负荷预测、变频控制、冗余调度等多维度手段,最大化提升能源利用效率;同时搭载冷却塔、氟泵一体机、行级精密空调等核心硬件产品,形成“液冷+余热回收+绿电消纳”的闭环体系,助力算力中心达成低 PUE、高可靠、全场景适配的核心目标,为高密度算力集群提供稳定、绿色的能源保障。

在整个算力中心全液冷综合能源解决方案中,从控制系统搭建上,主要围绕以下四个角度考虑:

服务器侧能源需求响应控制满足

CDU一次侧和二次侧能源交换控制匹配

室外冷源供给控制

能源回收利用控制管理(针对特定场景项目情况,比如热回收用于其它场所供热等)

智算中心的能源管控运维正在向智能化转型。传感器每秒采集数据,AI算法实时分析,预测性维护将故障率降低60%。自动优化控制根据IT负载动态调节参数,通过智能运维,CDU系统能耗降低10%以上。

算力中心冷却塔

作为液冷系统一次侧冷源核心设备,高效实现热量交换与散热,为算力中心提供稳定、低温的冷却水源,支撑全系统高效运行。

算力中心冷却塔

算力中心氟泵一体机

集成氟泵循环与智能控温技术,精准匹配二次侧液冷循环需求,实现高效制冷、动态调温与低能耗运行,保障液冷系统稳定供冷。

算力中心氟泵一体机

算力中心氟泵行级精密空调

近距离部署于服务器机柜旁,实现毫秒级精准控温与气流组织,高效适配高密度算力散热需求,为 IT 设备提供稳定可靠的微环境。

算力中心氟泵行级精密空调

>>>算力中心案例

我们已深度服务阿里、腾讯、百度、中国移动、中国电信等行业头部客户,在广州、深圳、河北、江苏等多地落地 Tier III+/T3 + 高规格数据中心项目。凭借独立控制单元、N+1 冗余架构、动态负载调优等核心能力,保障算力中心 7×24 小时稳定运行,同时实现显著节能降本,为 “东数西算” 工程下的全国算力网络布局提供了可复制、可推广的液冷综合能源实践样本。