4月10日,米哈游创始人蔡浩宇旗下AI公司 Anuttacon 在arXiv发布论文,公开其新一代视频生成模型 LPM 1.0(Large Performance Model),并同步上线项目主页。

LPM 1.0 是一个基于 170 亿参数扩散 Transformer 架构的视频模型,主打角色表演生成能力。

与传统视频生成模型相比,该模型不仅关注画面生成,还尝试实现角色在视频中的连续表达,包括说话、倾听和实时反应,更注重于“表演”。

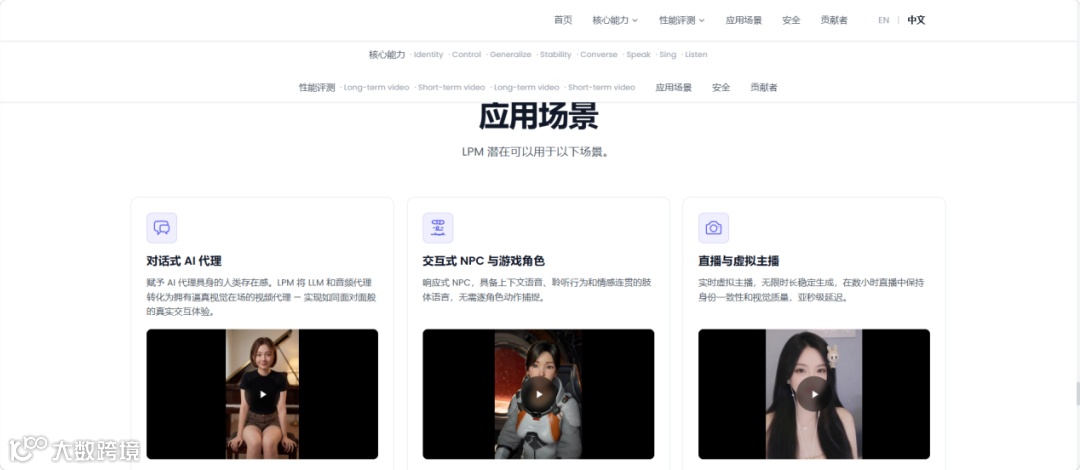

团队介绍,LPM 1.0 可以根据输入图像生成具有稳定身份特征的视频角色,在对话过程中保持外观与行为一致,同时完成语音驱动、表情变化和动作反馈。

模型支持流式推理,可实现低延迟实时生成,并具备生成长时视频内容的能力,可应用于对话式智能体、虚拟直播角色以及游戏NPC等场景。

在技术实现上,团队构建了大规模人类音视频数据,用于训练模型学习“说话”与“倾听”的配对关系,并在模型中引入语音与文本等多模态条件,实现统一驱动。同时,通过蒸馏方法,将离线生成能力迁移至可实时运行的系统中。

论文信息显示,项目标注的Project Lead 包括曾爱玲(Ailing Zeng)。其个人主页显示目前就职于Anuttacon,且曾出现在《星之低语》的技术人员名单中。据悉,曾爱玲此前在腾讯混元团队及AI Lab 从事计算机视觉与生成模型相关研究工作。

目前,LPM 1.0 仍处于研究阶段。团队表示不会开源模型权重或提供相关 API,项目仅用于学术交流。

参考资料:

LPM 1.0项目页:https://large-performance-model.github.io/

LPM论文:https://arxiv.org/abs/2604.07823

Ailing Zeng主页:https://ailingzeng.site/