今年以来,全球多家科技厂商陆续发布多模态大模型,如谷歌的PaLM-E大模型、OpenAI的GPT-4大模型以及百度的“文心一言”大模型,让大模型生态必备的基础——算力,再次受到万众瞩目。

无论AI大模型还是AI初创企业、传统产业转型都需要算力的支撑,带来海量算力需求的同时,算力成本也与此增加。 算力租赁应运而生,用户只要按需付费,无需承担硬件设备的采购、维护、升级等费用,也不用担心设备闲置或者过时造成浪费,是一种灵活、高效、成本低廉的计算服务,适用于各种大规模计算需求的场景,且未来有望成为算力供给的主流模式之一。

全球算力规模将呈现高速增长态势(图片来源:信通院)

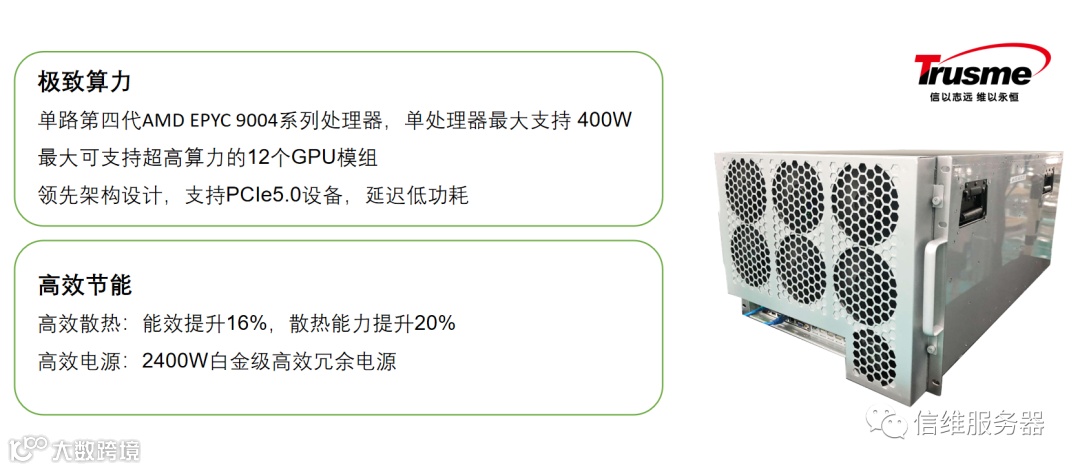

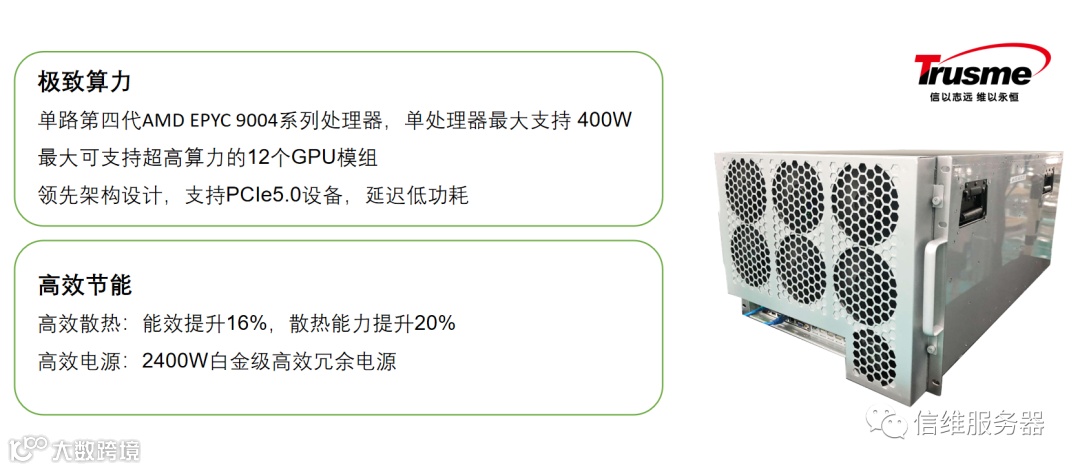

国内某知名算力租赁企业,基于其在云计算网络资源及技术方面优势,可根据业务需求灵活调度算力资源,提供CPU、GPU等多种算力服务,向人工智能、云游戏、工业互联网等行业提供实时算力的需求。然而要实现提供多种算力服务,强大的算力必不可少。算力是人工智能产业创新的基础,大模型更是需要处理海量的计算任务,这就要求更高计算性能。在了解客户需求后,信维量身定制拥超强性能的AI服务器H5800G5。它是一款支持单路AMD EPYC 9004最大支持TDP400W处理器,双12通道内存,支持12片双宽GPU卡,助力于AI深度学习、机器学习领域。

H5800G5服务器为8U单路处理器系统,采用8U的机箱是有原因的,首先具备更好的散热效果,并且提供更多的扩展选项。8U空间最大支持12个最先进的GPU卡,为满足不同需求的不同工作负载,H5800G5可以通过简单的线缆布线调整来支持GPU和CPU之间的多种拓扑和带宽。支持AMD 3D V-Cache技术,针对分析、训练和推理工作负载进行了优化设计。

H5800G5旨在加速高性能计算和AI应用,凭借基于第四代AMD EPYC 9004系列处理器和支持多达12个GPU的PCIe 5.0扩展,可实现GPU和CPU比例的动态平衡。此外,为了促进数据训练,并行计算的效率至关重要,具有高带宽PCIe互连的架构将推动高效的点对点通信,并最大限度地减少延迟。H5800G5拥有12个DDR5 DIMM插槽,最大支持6TB 12*256GB DRAM;支持以太网、Infiniband、OPA等多种不同网络连接和互联需求。

为了实现系统可靠性和降低运营成本,信维H5800G5拥有独立的GPU和CPU散热分区设计,确保系统在最苛刻的工作负载下性能和稳定性不受影响。同时板载集成BMC、支持通过RAID卡超级电容、支持IPMI 2.0远程管理等,非常方便用户对AI算力设备的维护管理。

随着技术的不断进步和算力租赁的不断完善,算力租赁市场将会迎来更加广阔的发展空间。作为服务器领域的领军企业,信维将持续带来更多领先的技术和产品,通过定制智算解决方案能力助力AI相关研发和推进,制胜AI时代!