封底文章 | Li YX, Qian JM, Feng SJ, Chen Q, Zuo C. Deep-learning-enabled dual-frequency composite fringe projection profilometry for single-shot absolute 3D shape measurement. Opto-Electron Adv 5, 210021 (2022).

共同第一作者:李艺璇、钱佳铭

通信作者:陈钱 教授、左超 教授

1 研究背景

随着光电信息技术的快速发展,三维成像与传感已成为光学计量和信息光学领域的最重要的研究方向之一。“二维摄像”向“三维传感”的演变也将成为继黑白到彩色、低分辨率到高分辨率、静态图像到动态影像后的“第四次影像革命”。结构光投影技术因其非接触、高分辨、高速和全场自动化等优点,成为目前最具代表性的三维成像技术之一。而其中对于宏观物体三维测量的方法中,基于相位测量的条纹投影轮廓术(Fringe projection profilometry,FPP)[图1] 的测量精度最高,因此在智能制造、逆向工程、工业检测、文物保护等众多领域得到广泛应用。

近年来,数字光投影器、空间光调制器、高速光探测器等光电器件,高性能计算机、嵌入式处理器等运算处理单元得到了跨越式发展,人们也随之对条纹投影轮廓术提出了更高的期许——既要“精度高”,又要“速度快”。尽管二者似乎天生就是一对矛盾体,但“速度”已经逐渐成为采用条纹投影轮廓术时所要考虑的“必要因素”。因为对于许多领域,如工业制造——“速度”就代表着“效率”,而“效率”就代表着“生产力”。

图1 条纹投影轮廓术的基本原理

条纹投影轮廓术的三维测量速度取决于两方面重要因素:①硬件:即条纹投影/图像拍摄速度;以及②软件(算法):即单幅三维重建所需的图案数量。二者在大多数情况下并不冲突,采用高速投影仪与相机,并尽可能减少单次重建所需的条纹数量,才能使三维成像变得更“快”。以前者为出发点,普渡大学张松教授课题组做出了大量创新工作,基于DLP投影仪二值条纹的离焦投影技术1,突破了投影灰度正弦条纹数字微镜阵列器件(DMD)所固有的时域脉冲宽度调制所致的时域延展效应,使投影速度达到DMD的固有极限频率(20~30 kHz)。以后者为出发点,南京理工大学陈钱、左超教授课题组建立了条纹结构光相移2、时域相位展开3理论体系框架,提出双频相移法4、2+2步相移5、几何约束复合相移法6、散斑复合傅里叶法7、微频移傅里叶变换法8等系列复合编码方法。上述方法去除了传统格雷码与多频时间相位展开法中条纹序列的编码冗余,有效将单次三维重构所需的条纹图像从接近10幅降低至5、4、3、甚至2幅,首次实现了速度为10 kHz的瞬态三维传感8。

尽管如此,针对结构光三维成像而言,仅采用一幅投影图案实现高精度三维重建才是研究人员永恒追求的终极目标。1983年,Takeda等9提出了傅里叶变换条纹投影轮廓术(Fourier transform profilometry,FTP),通过频域滤波从单幅条纹图像中恢复出被测物相位信息。该项工作具有划时代意义,使单幅条纹图案相位解调甚至单帧条纹投影三维重构成为可能[图2(a)]。针对此项技术,四川大学苏显渝、张启灿教授课题组10展开了深入系统的研究工作,实现了测量速度达kHz级别的单帧三维成像[图2(b)]。然而,FTP技术成立的前提条件是物体表面调制的高频信息能够与背景在频谱域相分离,因此其仅能用于测量较平缓的面型,难以实现对复杂物体的高精度三维重构;此外,FTP恢复的包裹相位存在周期歧义性,通常需采用多频时域相位展开技术,即获取多组不同频率的条纹图像来去除相位歧义并获取绝对相位分布3。

图2 傅里叶变换条纹投影轮廓术(FTP)。(a) FTP基本原理9 ;(b) 鼓面与微飞行器翅膀的kHz FTP三维成像结果10

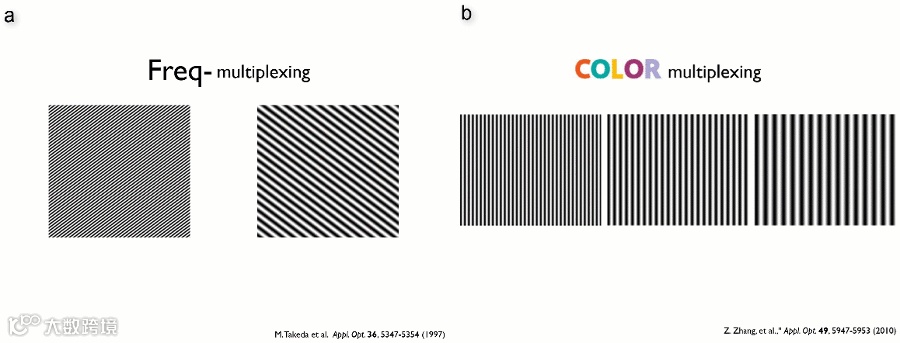

为了解决相位歧义性问题,早在1997年Takeda等11就开创性地将频分复用技术(Frequency multiplexing, FM),一种在电信领域颇为经典的信道信息复用技术,引入条纹投影轮廓术。该技术将两个具有不同频率空间载波的条纹图案编码到一幅图像中,从单帧复合条纹中解调出两组不同频率的包裹相位信息,并基于此去除相位的周期歧义性[图3(a)]。2010年,河北工业大学张宗华教授课题组12通过将三幅不同频率的正弦条纹编码分别编码到一幅彩色图像的红绿蓝三个通道中,利用彩色相机拍摄被物体表面调制后的变形单帧彩色条纹,进行颜色分离以获得三组不同频率的包裹相位信息[图3(b)]。然而由于这些技术本质上都属于FTP的衍生物,严重受到频谱混叠、频谱泄漏、通道串扰等因素影响,三维重建的精度、分辨率与可靠性等方面都还达不到实际应用的要求[图3]。

图3 基于频分复用的FTP11 (a)及基于三通道彩色条纹复用的FTP12 (b)

2 研究亮点

1) U-Net1基于输入的双频复合条纹图像,并结合传统相移法的物理模型,将包裹相位反正切函数的分子项和分母项作为U-Net1网络的输出,并以此计算出高质量的包裹相位分布。该方法可以看作是之前该课题组所提出的基于深度学习的条纹分析技术13的拓展:既规避了直接采用端到端结构预测包裹相位所存在的难以准确还原2π相位截断的难题,后续反正切运算中分子分母相除还可有效抵消物体表面反射率的影响,从而可有效提升重建相位的精度。

2) U-Net2基于输入的双频复合条纹图像预测包含正确条纹级次信息的低精度绝对相位。尽管U-Net2输出的绝对相位信息较为“粗糙”,但精度足以用于辅助U-Net1输出的高质量的包裹相位进行相位展开,最终获得高精度的绝对相位分布。结合系统标定参数即可获得高精度的三维几何点云数据,进而实现单帧结构光三维成像。

图4 基于深度学习的双频复用条纹轮廓术原理

网络通过采用传统多频相移和时间相位展开法所获得的高精度相位(12步移相+三频时间相位展开)作为标签(真值)进行监督训练[图4(a)]。通过对大量数据样本的“学习”,训练后的神经网络即可从单帧复合条纹中“解耦”出高分辨率、高精度、无频谱串扰的绝对相位信息。在实验中,研究人员对不同具有复杂表面的三维模型进行了相位提取与三维重建。实验结果表明:基于深度学习的双频复用结构光条纹解调技术能显著提升传统傅立叶变换法的测量精度,重构质量接近于双频(非复用)12步相移法所给出的真值[图5]。其单帧重建的优点又使其从根本上对物体的运动所引起的相移误差所免疫,适用于对运动物体进行动态三维成像[图5(k)]。由此可见,该方法能够有效克服频谱混叠、频谱泄漏、通道串扰等因素的不良影响,实现了真正意义上的单帧高精度结构光三维成像。

图5 不同场景下的三维重构结果。(第一列)三个不同静态场景下的复合条纹图像;(第二列)端到端深度学习方法重构结果;(第三列)我们方法的重构结果;(第四列)动态场景下的复合条纹图像以及我们方法的重构结果

3 展望

研究团队简介

论文原文

Li YX, Qian JM, Feng SJ, Chen Q, Zuo C. Deep-learning-enabled dual-frequency composite fringe projection profilometry for single-shot absolute 3D shape measurement. Opto-Electron Adv 5, 210021 (2022).

https://www.oejournal.org/article/doi/10.29026/oea.2022.210021

DOI:10.29026/oea.2022.210021

长按识别此二维码,直达全文

免责声明:本文旨在传递更多科研资讯及分享,所有其他媒、网来源均注明出处,如涉及版权问题,请作者第一时间后台联系,我们将协调进行处理,所有来稿文责自负,两江仅作分享平台。转载请注明出处,如原创内容转载需授权,请联系下方微信号。