从 “机械应答” 到 “价值共鸣”

ChatGPT4 如何通过人类反馈学会 “好好说话”

在人工智能的发展历程中,大语言模型的出现堪称里程碑。从早期只能生成简单文本的模型,到如今能理解复杂指令、进行多轮对话的智能助手,技术的突破背后是算法与数据的双重革命。作为大语言模型的标杆,ChatGPT系列的每一次迭代都引发广泛关注,尤其是ChatGPT4,它通过一项关键技术——基于人类反馈的增强学习(RLHF),真正实现了从“机器生成”到“理解人类需求”的跨越。

ChatGPT3凭借千亿级参数和海量文本训练,展现出惊人的语言生成能力:它能写诗、写代码、回答问题,甚至模仿人类的对话风格。但早期版本存在一个核心问题:输出缺乏“人类价值观对齐”。例如,当用户询问危险操作的步骤、歧视性问题或虚假信息时,ChatGPT3可能会基于训练数据的概率分布直接回答,而无法判断内容是否安全、是否符合伦理。这种“失控”的本质在于,ChatGPT3的训练逻辑是“预测下一个词”,它通过分析互联网级别的文本数据学习人类语言的统计规律,却并未真正理解“用户需要什么”。就像一个记忆力超强的学生能准确复述知识,却无法根据老师的要求灵活调整答案。要让AI从“会说话”变成“会服务”,必须教会它理解人类的隐含需求:诚实、安全、无偏见、有帮助。

OpenAI的解决方案是基于人类反馈的增强学习(RLHF),这一过程通过三个关键步骤将人类的价值判断融入模型训练,实现“AI行为的定向引导”。首先是人工标注,打造“优质答案”标杆。要让AI学会正确回答,首先需要给它“示范”什么是好答案。OpenAI雇佣了40名人工智能训练师,他们从早期模型测试数据中筛选用户真实提问,去重后确保每个用户ID最多保留200个问题,保护隐私的同时覆盖多样化场景,包括内容生成、问题解答、对话交互等;同时针对每个问题,训练师手动编写符合安全、准确、有帮助原则的答案,形成包含1.3万个样本的“精调数据集”。这些数据就像“标准答案库”,让模型先学会“正确的表达方式”,通过这一步,ChatGPT3的基础模型被“微调”,初步具备了按人类标准生成答案的能力。

接下来是训练奖励模型,教会AI“判断好坏”。即使模型能生成合理答案,仍需学会在多个候选答案中选择最优解。训练师针对同一个问题让模型生成4-9个不同回答,然后人工标注这些答案的优劣顺序。这些“好坏排序”数据被用来训练一个60亿参数的奖励模型(RM),其任务是输入问题和回答后输出一个分数,分数越高表示回答越符合人类偏好。训练过程中采用“对比学习”,如果人类标注A优于B,奖励模型必须让A的得分高于B,否则就调整参数。例如4个回答可组成6对对比,9个回答则有36对,通过大量对比,奖励模型逐渐学会“像人类一样评价答案”。

第三步是利用增强学习,用“奖励”引导AI持续优化。有了奖励模型后,OpenAI使用近端策略优化算法(PPO)对模型进行最终调优:模型生成回答后,奖励模型打分,分数越高AI获得的“奖励”越大;为防止模型偏离初始能力,算法引入“KL散度惩罚”,确保新策略与原模型差异不会过大;同时鼓励模型回顾历史训练数据(Dpretrain),保持对常见问题的稳定性。这一过程如同“闯关游戏”,AI不断生成回答,根据奖励调整策略,既要追求高分符合人类需求,又要保持“初心”不丢失原有能力。通过3.1万个未标注问题的反复训练,最终得到ChatGPT4——一个既强大又“听话”的智能助手。

RLHF的成功离不开对数据的精心处理。训练数据包含内容生成、问答、对话、总结等10余种自然语言任务,确保模型适应不同场景;仅收集测试阶段的用户数据,商用环境数据不被纳入,避免敏感信息泄露;测试集与训练集完全独立,防止模型“死记硬背”,确保评估真实有效。在技术实现上,奖励模型的训练效率至关重要,通过将K个回答转化为K*(K-1)/2对对比数据,少量人工标注就能生成大量训练样本,大幅降低人工成本,这种“排列组合式”的训练方法让有限的人类反馈被高效利用。

同为大语言模型,DeepSeek采用的增强学习方法(GRPO)与ChatGPT4的RLHF原理相似,但存在关键差异:DeepSeek未公开奖励模型的训练细节,推测可能使用第三方或简化版奖励模型。这反映了AI领域技术共享与工程化落地的趋势,OpenAI注重底层创新,通过RLHF构建更贴近人类的交互体验;DeepSeek则侧重工程化实现,追求性价比。两者的共同点在于都认识到“人类反馈”是大语言模型实用化的关键,单纯的“数据堆量”无法解决伦理与安全问题,必须引入人工干预。

ChatGPT4的诞生标志着大语言模型进入“价值对齐”时代。通过RLHF,AI不再是冰冷的文本生成器,而是能理解人类隐含需求的助手,它会拒绝危险提问,主动纠正偏见,甚至在回答中体现“共情”。这种能力的背后是技术与人文的结合,用机器学习技术解析人类价值观,再通过算法将其编码到模型中。更重要的是,RLHF为AI发展树立了范式,让人类反馈成为训练闭环的一部分。未来,随着模型复杂度提升,人工标注可能逐步被“自动化反馈”取代,但核心逻辑不变:AI的进步不仅需要算力和数据,更需要持续理解“人类想要什么”。

从ChatGPT3到ChatGPT4的进化,本质上是AI从“模仿人类语言”到“理解人类意图”的跨越。RLHF技术如同桥梁,将人类的价值观、伦理准则和实用需求传递给机器,让技术能力与人文关怀同步提升。这启示我们,真正的人工智能不仅需要“聪明”,更需要“善良”,而这种“善良”正是通过一次又一次的人类反馈,慢慢融入代码与算法之中。在智能时代的浪潮中,ChatGPT4或许只是一个起点,随着更多类似技术的涌现,我们期待看到更安全、更有温度的AI助手,它们不仅能回答问题,更能成为人类探索世界、解决问题的伙伴。这,才是人工智能的终极目标:不是超越人类,而是理解人类,服务人类。

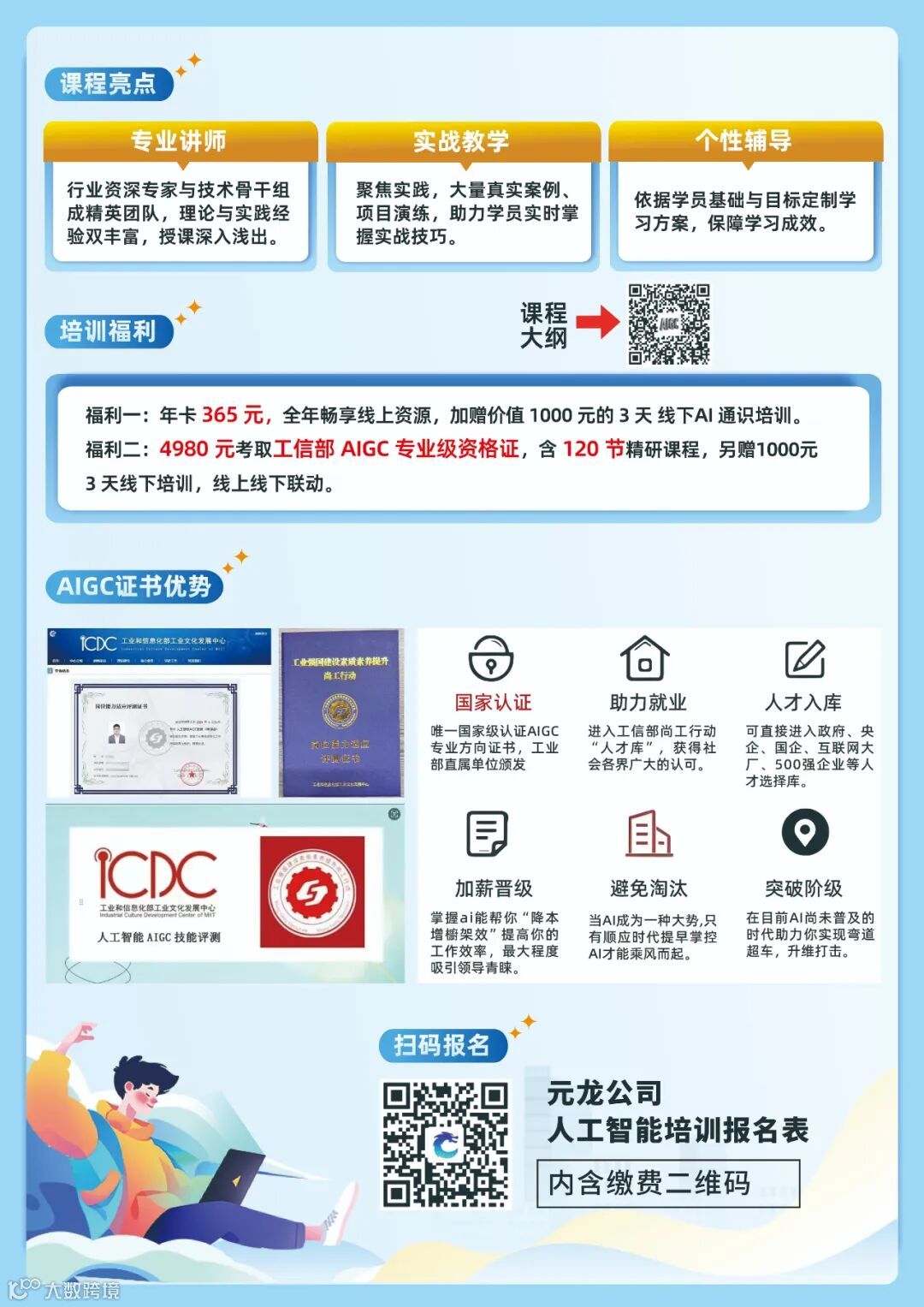

元龙科技AIGC,365元畅学AI入门

福利一:年卡会员特惠来袭,365 元畅享整年知识福利,赠价值 1000 元的 AI 人工智能通识 3 天线下培训,专业讲师助您入门前沿技术。

福利二:4980 元拿下工信部 AIGC 专业级资格证,含 120 节精研课程包,覆盖知识要点,另赠千元 3 天线下培训,线上线下结合,助您抢占职业先机。

别犹豫啦,速来开启人工智能学习之旅!

培训地点 :

山西省运城市好课堂乐学广场4楼路演大厅

咨询电话:

4001188556/17703590976

END