版 DS 导读:

计算机视觉在未来几年都将可能是 AI 主要的技术应用,在全部应用场景中占比超过40%。根据 IDC 的预测,市场规模到 2022 年有望达到146.08亿元,2017-2022 年的年均复合增速有望到56.72%。

自1966年机器视觉学科建立至今,受益于深度学习算法的不断迭代,限定场景识别准确率持续提升、场景应用迈向成熟,侧重于感知智能的图像分类技术在工业界已逐步实现商用化。目前,计算机视觉的典型应用包括:

· 安防领域:疑犯追踪、视频结构化;

· 金融及互联网领域:刷脸认证;

· 手机及娱乐领域:影像分类、影像处理及AR特效;

· 零售领域:商品识别;

· 广告营销领域:自动化挖掘影像内容广告位;

· 工业领域:产品质检、3D分拣;

· 医疗领域:医疗影响分析;

· 自动驾驶领域:环境感知、高精地图;

· 无人机/机器人领域:定位、自动避障。

文章主要介绍了计算机视觉领域最新的研究方向,一起来看看吧。

全文约5292字,阅读时长:8分钟。

来源 | 本文选自知乎问答,产业智能官整理。

2020年,计算机视觉领域会有哪些新的研究方向值得提前探索?

https://www.zhihu.com/question/330153893

版 作者:罗浩.ZJU

https://www.zhihu.com/question/330153893/answer/721238966

1. 作者:育心

https://www.zhihu.com/question/330153893/answer/740254474

结合计算机视觉、机器人领域5大顶会(CVPR/ICCV/IROS/ICRA/ECCV),以及产业界的需求,总结3个当下热门及前沿的研究领域。

三维视觉是传统的研究领域,但最近5年内得到快速发展。三维视觉主要研究内容有:

三维感知(点云获取及处理)、位姿估计(视觉SLAM)、三维重建(大规模场景的三维重建、动态三维重建)、三维理解(三维物体的识别、检测及分割等)。

版 视频理解

版 小结

2. 作者:商汤科技SenseTime

https://www.zhihu.com/question/330153893/answer/721471978

谢邀!商汤及联合实验室CVPR 2019论文精选,研究一下?

商汤及商汤联合实验室入选CVPR 2019的代表性论文,从五大方向阐释计算机视觉和深度学习技术最新突破,以下是从论文中提取的精华部分~

版 高层视觉核心算法——物体检测与分割

代表性论文:基于混合任务级联的实例分割算法

在这篇论文中,我们提出了一种新的框架Hybrid Task Cascade (HTC)。

该框架是一个多阶段多分支的混合级联结构,对检测和分割这两个分支交替地进行级联预测,除此之外,我们还引入了一个全卷积的语义分割分支来提供更丰富的上下文环境信息。

HTC在COCO数据集上相对Cascade Mask R-CNN获得了1.5个点的提升。基于提出的框架,我们获得了COCO 2018比赛实例分割任务的冠军。

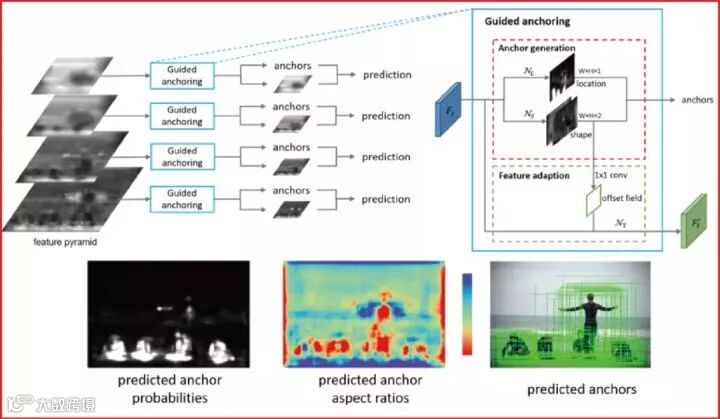

代表性论文:基于特征指导的动态锚点框生成算法

锚点框(Anchor)是现代物体检测技术的基石。目前主流的物体检测方法大多依赖于密集产生静态锚点框的模式。在这种模式下,有着预定义的大小和长宽比的静态锚点框均匀的分布在平面上。

本文反思了这一关键步骤,我们提出了一种基于特征指导的动态锚点框生成算法,该算法利用语义特征来指导锚点框生成的过程,具有高效率和高质量的特点。

本算法可以同时预测目标物体中心区域和该区域应产生的锚点框的大小和长宽比,以及根据锚点框的形状来调整特征,使特征与锚点框相吻合,从而产生极高质量的动态锚点框。

本方法可以无缝使用在各种基于锚点框的物体检测器中。实验表明本方法可以显著提高三种最主流的物体检测器(Fast R-CNN, Faster R-CNN, RetinaNet)的性能。

版 底层视觉核心算法——图片复原与补全

代表性论文:基于网络参数插值的图像效果连续调节

图像效果的连续调节在实际中有着广泛的需求和应用, 但是目前基于深度学习的算法往往只能输出一个固定的结果,缺乏灵活的调节能力来满足不同的用户需求。

具体地,我们对两个或多个有联系的网络的参数进行线性插值,通过调节插值的系数,便可以达到一个连续且光滑的效果调节。

我们把这个在神经网络的参数空间中的操作方法称为网络参数插值。本文不仅展示了网络参数插值在许多任务中的应用,还提供了初步的分析帮助我们更好地理解网络参数插值。

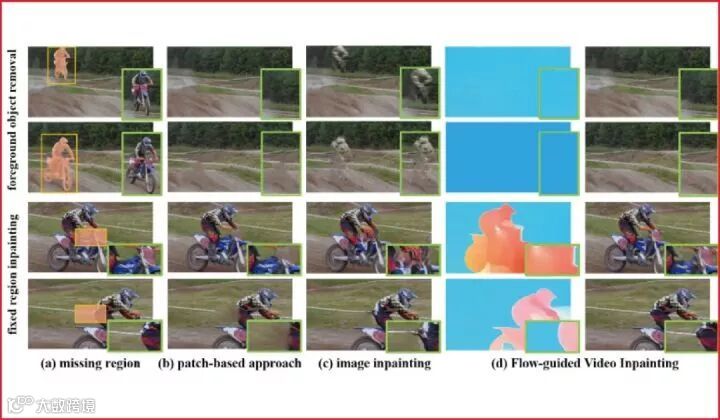

代表性论文:基于光流引导的视频修复

本文关注视频中的修复问题,虽然近年来图片修复(Image Inpainting)问题取得了很大的进展,可是在视频上完成像素级的修复仍然存在极大的挑战。其困难主要在于:1)保证时序上的连续型;2)在高分辨率下实现修复;3)降低视频对于计算的开销。

所以我们的框架主要由两部分组成,第一部分是通过深度神经网络实现光流的补全,之后通过补全的光流在整个视频间做像素的传导,从而形成一条在时序上保持一致的像素链。这样缺失的区域就可以通过它来实现修复,并且还能够保证视频的清晰度。

版 面向自动驾驶场景的3D视觉

代表性论文:PointRCNN: 基于原始点云的3D物体检测方法

本文首次提出了基于原始点云数据的二阶段3D物体检测框架,PointRCNN。3D物体检测是自动驾驶和机器人领域的重要研究方向。

已有的3D物体检测方法往往将点云数据投影到鸟瞰图上再使用2D检测方法去回归3D检测框,或者从2D图像上产生2D检测框后再去切割对应的局部点云去回归3D检测框。

而这些方法中,前者在将点云投影到俯视图上时丢失了部分原始点云的信息,后者很难处理2D图像中被严重遮挡的物体。

我们观察到自动驾驶场景中物体在3D空间中是自然分离的,从而我们可以直接从3D框的标注信息中得到点云的语义分割标注。

在阶段二中,前面生成的3D初始框将通过平移和旋转从而规则化到统一坐标系下,并通过点云池化等操作后得到每个初始框的全局语义特征和局部几何特征,我们将这两种特征融合后进行了3D框的修正和置信度的打分,从而获得最终的3D检测框。

在提交到KITTI的3D检测任务上进行官方测试时,我们提出的方法在只使用点云数据的情况下召回率和最终的检测准确率均超越了已有的方法并达到了先进水平。目前我们已将该方法的代码开源到了GitHub上。

版 面向AR/VR场景的人体姿态迁移

代表性论文:基于人体本征光流的姿态转换图像生成

本文主要关注人体姿态转移问题,即在给定一幅包含一个人的输入图像和一个目标姿态的情况下,生成同一个人在目标姿态下的图像。我们提出利用人体本征光流描述不同姿态间的像素级对应关系。

在该光流预测模块的基础上,我们设计了一个图像生成模型,利用本征光流对人体的外观特征进行空间变换,从而生成目标姿态下的人体图像。我们的模型在DeepFashion和Market-1501等数据集上取得了良好的效果。

版 无监督与自监督深度学习前沿进展

代表性论文:基于条件运动传播的自监督学习

本文提出一种从运动中学习图像特征的自监督学习范式。

1)在自然场景中,物体的运动具有高度的复杂性,例如人体和常见动物都具有较高的运动自由度。2)同时,从单张图片中推测物体的运动具有歧义性。现有基于运动的自监督学习方法由于没有很好地解决这两个问题,因而未能高效地从运动中学习到较好的图像特征。

经过分析,我们发现条件运动传播任务从运动中学习到了物体的刚体性、运动学属性和一部分现实世界中的物理规律。利用这些特性,我们将它应用到交互式视频生成和半自动实例标注,获得了令人满意的效果;而整个过程,没有用到任何人工的标注。

3. 作者:Shawn Tsien

https://www.zhihu.com/question/330153893/answer/729391245

要想彻底解决视觉问题,眼前是指望不上学术界了,真要等学术界进化,可能还得几百年,而工业界又在等学术界的结果,所以似乎还遥遥无期,但不妨碍继续写论文。图像分割是三块中最难的一块,却是听起来最low的一块,当然我所指通用分割,所以选这块来写论文,风险太大。

三维重建相对最简单,但已经走过半个多世纪了,SLAM也基本跑到了山穷水尽的悬崖边。而模式识别却是风光独好,因为这块的工作量最大,涉及的方面很多,难度却不大,适合写论文。

由于基础缺失,所以不可能获得精确的结果,但也尽量要用最复杂的数学公式,这样更利于论文发表,对啦,还要好好利用深度学习这个炼丹炉。