prompt-optimizer是一个旨在系统性解决用户撰写AI提示词(Prompt)时常见痛点的智能工具。其核心价值在于将提示词工程从“手工作坊”升级为“自动化流水线”,显著提升效率和质量。

一、它解决了什么问题?

当前用户在撰写提示词时主要面临三大痛点,而许多现有优化工具也存在不足:

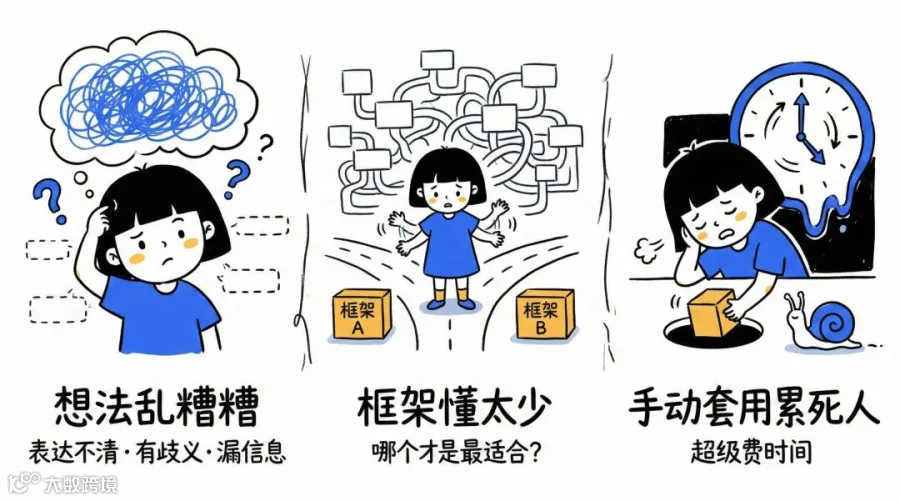

用户痛点:

1. 表达不清:需求描述存在遗漏、歧义。

2. 框架选择少:了解的提示词框架有限,难以挑选最合适的。

3. 套用耗时:即使知道框架,手动套用也非常耗时。

现有工具缺点:

1. 缺乏澄清:对用户输入的错误或歧义信息直接生成,缺乏确认环节。

2. 产出太通用:生成的提示词虽然结构化,但多为通用框架,缺乏针对性。

3. 支持模型有限:通常只适配少数特定模型。

二、它的核心功能是什么?

prompt-optimizer通过以下方式针对性解决上述问题:

1. 智能匹配专业框架:根据用户描述的场景,从内置的 50多个全球顶尖的提示词框架库(如RACEF、CRISPE、BAB、Tree of Thought等)中自动选择最匹配的。

2. 主动澄清与确认:在生成前,会主动分析用户输入,若发现缺失、歧义或可能错误的信息,会与用户沟通确认,确保理解无误。

3. 自动套用与生成:确认需求后,自动将用户需求套用到选定的最佳框架中,一键生成专业、结构化的提示词。

4. 模型兼容性:生成的提示词可以自由用于用户喜欢的各种大模型,不受限。

当用户提出提示词的需求时,我们的预训练提示词库会自动匹配并调用该提示词框架。用户可以观察到它完整的工作流程:读取摘要 -> 匹配场景与框架 -> 澄清需求 -> 输出优化后的提示词。

我们自身的业务智能体提示词也采用此方法生成和优化,使用专业框架(如CRISPE框架、COT模型)能挖掘出更深、更发散的价值。

总结与启示

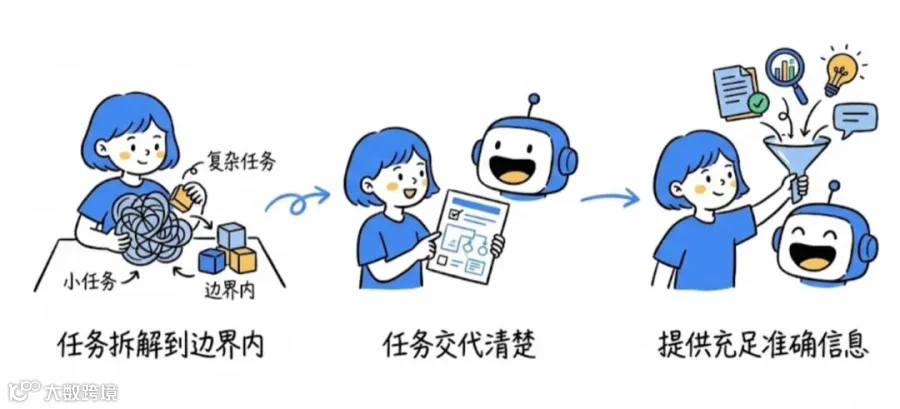

prompt-optimizer 展示了当前AI应用开发的一个趋势:“Do”(执行)的成本已大大降低,关键转向“Think”(思考与设计)。它的成功依赖于:

1)清晰的思考与需求拆解:将复杂任务拆解到大模型能力边界内。

2. )充分的上下文供给:为AI提供充足、准确、结构化的信息(如50多个专业框架)。

3. )有效的工具化封装:利用Skill和MCP等机制将能力产品化。

同时,其效果依赖于模型能力,模型越强大,潜力发挥得越好。它并非万能,适用于相对专业、需要结构化思考的场景,简单需求直接描述即可。