1.目标

通过已有数据对现房价进行描述性分析探测并构建模型预测房屋价格。

2. 实现方案

借助 sklearn 库构建回归模型预测房价。

3. 开发环境

Jupyter Notebook

4. 步骤

利用 sklearn 库构建线性回归模型探测人口占比与房价的关系(计算出参数:斜率和截距);

构建多元回归模型,借助交叉验证法评估此模型的拟合性(分别计算出在训练集和测试集上的均方误差和r2评分值);

构建多项式回归模型探测平均房间数与房价的关系。在此过程中分别构建了线性模型、二次模型以及三次模型,分别计算这三种模型下的R2评分值来评估此模型的拟合性;

5. 数据来源

说明:项目中使用的数据集 house_data 是已经提供好的,具体下载地址见:

http://pan.baidu.com/s/1o7Hb5v8

6. 具体实现

6.1 探索房屋数据集

import pandas as pd# 读取房屋数据集df = pd.read_csv("house_data.csv")# 通过 head 方法查看数据集的前几行数据df.head()

结果如下图所示:

6.2 查看数据集中制定维度间的相关性

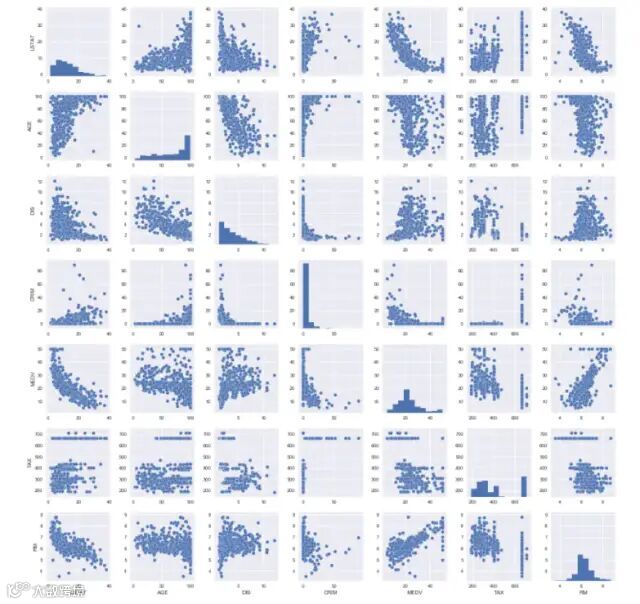

import matplotlib.pyplot as pltimport seaborn as sns# 设置内容,使得图在 jupyter notebook 中显示出来sns.set(context = 'notebook')#设置维度:LSTAT(人口百分比), AGE(房屋年限), DIS(与市中心的距离), CRIM(犯罪率),MEDV(房价), TAX(税), RM(平均房间数)cols = ['LSTAT','AGE','DIS','CRIM','MEDV','TAX','RM']# 画图:后台显示sns.pairplot(df[cols],size=2.5)# 在前台展示图片:两两维度j间的相关性plt.show()

维度相关性结果如下图所示:

从图中得出的结论如下:

1.对角线上的图分别代表各个维度间的直方图;

2.MEDV(房价)与RM(平均房间数)呈正相关;

3.MEDV(房价)与LSTAT(人口占比)呈反相关。

6.3 模型构建

尝试使用 sklearn 构建线性回归模型探测MEDV(房价)与LSTAT(人口占比)的关系:

# 引入线性回归模块from sklearn.linear_model import LinearRegression# 初始化模型sk_model = LinearRegression()# 训练模型,但是不需要对数据进行预处理sk_model.fit(X, y)# 打印斜率print('Slope: %.3f'% sk_model.coef_[0])# 打印截距print('Inercept:%.3f'% sk_model.intercept_)# 画出回归图Regression_plot(X, y, sk_model)# 设置x轴坐标标签plt.xlabel('Percentage of the population')# 设置y轴坐标标签plt.ylabel('House Price')plt.show()

展示结果如下:

从图中得出的结论:通过线性模型拟合房价与人口比例间的关系,计算出了在线性模型下的两参数:斜率和截距。

接下来构建多元回归模型,利用交叉验证法评估此模型:

# 引入 train_test_split 将训练集和测试集分开from sklearn.cross_validation import train_test_split# 制定维度cols = ['LSTAT','AGE','DIS','CRIM','TAX','RM']# 给自变量取值X = df[cols].values# 给因变量取值y = df['MEDV'].values# 将数据集中75%数据归为为训练集,25%归为测试集X_train, X_test, y_train, y_test = train_test_split(X, y, test_size = 0.25, random_state = 0)# 初始化回归模型sk_model = LinearRegression()# 训练模型sk_model.fit(X_train, y_train)# 计算X在训练集上的预测值y_train_predict = sk_model.predict(X_train)# 计算X在测试集上的预测值y_test_predict = sk_model.predict(X_test)# 画出在训练集上的预测值与(真实值和预测值)在测试集上的误差散点图plt.scatter(y_train_predict, y_train_predict - y_train, c = 'red', marker = 'x', label = 'Trainning data')# 画出在验证集上的预测值与(真实值和预测值)在验证集上的误差散点图plt.scatter(y_test_predict, y_test_predict - y_test, c = 'black', marker = 'o', label = 'Test data')# 将X轴的坐标标签设置为预测值plt.xlabel('Predicted values')# 将y轴的坐标标签设置为预测值plt.ylabel('Residuals')# 增加一个图例在左上角plt.legend(loc = 'upper left')# 画一条平行于x轴,y值为0的直线plt.hlines(y=0,xmin=0,xmax=50,lw=1,color='green')# 设置取值范围plt.xlim([-10,50])plt.show()

结果如下所示:

从图中得出的结论如下:多元回归模型在测试集和验证集上的拟合性都比较好。

接着计算多元回归模型在预测集和验证集上的残差:

# 第一种评估的标准:MSE(均方误差)# #引入均方误差模块from sklearn.metrics import mean_squared_error# 输出均方误差print('MSE train %.3f, test %.3f'%(mean_squared_error(y_train,y_train_predict),mean_squared_error(y_test,y_test_predict)))#第二种评估标准:r2_score(r2评分)# # 引入R2评分模块from sklearn.metrics import r2_score# 输出r2评分print('R^2 train %.3f, test %.3f'%(r2_score(y_train,y_train_predict),r2_score(y_test,y_test_predict)))

MSE train 25.106, test 36.671

R^2 train 0.706, test 0.551

分析输出结果:

1. 均方误差:验证集上的值大于训练集上的误差;

2. r2评分(r2评分值越接近于1说明拟合性越好):训练集上的值接近于1,验证集上只有1的一半;

3. 从1、2结论可以看出:此多元模型有些过拟合。

于是构建多项式回归模型来探测MEDV(房价)与RM(平均房价)的关系:

# 给自变量(平均房间数)取值X= df[['RM']].values# 给因变量(房价)取值y = df['MEDV'].values#初始化线性回归模型Regression_model = LinearRegression()# 引入多项式特征库(目的是对多项式进行多项变换)from sklearn.preprocessing import PolynomialFeatures#初始化二次变换quadratic = PolynomialFeatures(degree = 2)#初始化三次变换cubic = PolynomialFeatures(degree = 3)# 对X进行二次变换X_squared = quadratic.fit_transform(X)# 对y进行三次变换X_cubic = cubic.fit_transform(X)# 找出X上的所有点,并增加一维([:,np.newaxis])X_fit = np.arange(X.min(), X.max(), 0.01)[:,np.newaxis]# 训练线性回归模型Linear_model = Regression_model.fit(X, y)# 计算出X-fit这些点在线性直线上的y值y_line_fit = Linear_model.predict(X_fit)# 计算线性回归模型上的r2评分linear_r2 = r2_score(y, Linear_model.predict(X))#训练二次回归模型Squared_model = Regression_model.fit(X_squared, y)# 计算出X-fit这些点在二次曲线上的y值y_quad_fit = Squared_model.predict(quadratic.fit_transform(X_fit))# 计算二次回归模型上的r2评分quadratic_r2 = r2_score(y,Squared_model.predict(X_squared))# 训练三次回归模型Cubic_model = Regression_model.fit(X_cubic, y)# 计算出X-fit这些点在三次曲线上的y值y_cubic_fit = Cubic_model.predict(cubic.fit_transform(X_fit))# 计算三次回归模型上的r2评分cubic_r2 = r2_score(y,Cubic_model.predict(X_cubic))# 画出原始数据集的散点图plt.scatter(X,y,label='Trainning point',color = 'lightgray')# 画出线性回归图plt.plot(X_fit, y_line_fit, label ='linear,$R^2=%.2f$' % linear_r2, color = 'blue',lw = 2, linestyle = ':')# 画出二次回归图plt.plot(X_fit, y_quad_fit, label ='quadratic,$R^2=%.2f$' % quadratic_r2, color = 'red',lw = 2, linestyle = '-')# 画出三次回归图plt.plot(X_fit, y_cubic_fit, label ='cubic,$R^2=%.2f$' % cubic_r2, color = 'green',lw = 2, linestyle = '--')# 将X轴的标签设置为房间数plt.xlabel('Room number')# 将y轴的标签设置为房价plt.ylabel('House price')# 在图的左上角添加图例plt.legend(loc = 'upper left')plt.show()

结果如图所示:

从图中得出的结论:三次回归模型的r2评分更接近1,因此三次回归模型的拟合性是最好的。